Python爬虫知识点四--scrapy框架

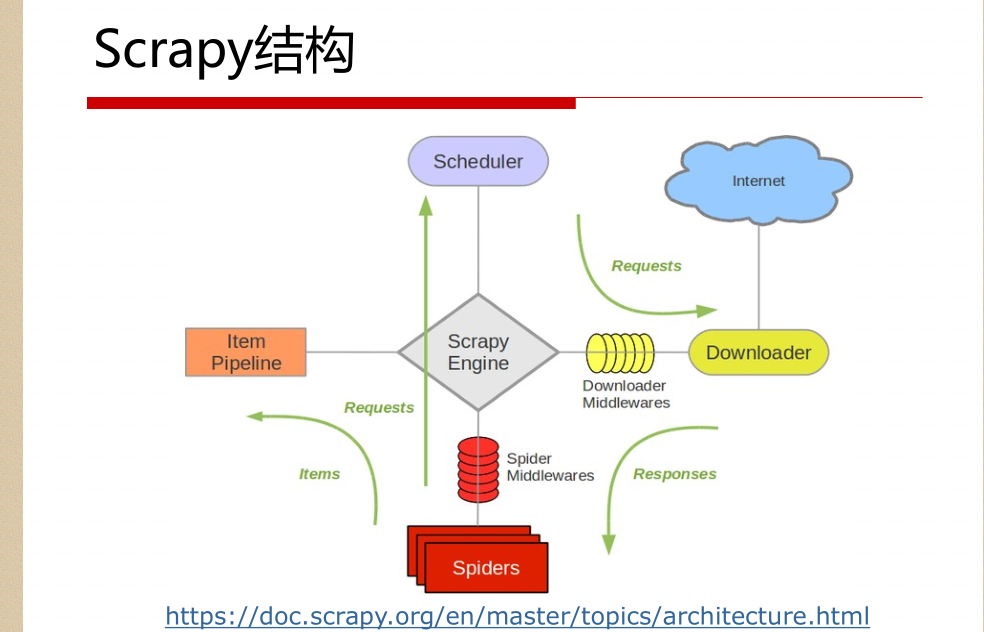

一。scrapy结构数据

解释:

1.名词解析:

o 引擎(Scrapy Engine)

o 调度器(Scheduler)

o 下载器(Downloader)

o 蜘蛛(Spiders)

o 项目管道(Item Pipeline)

o 下载器中间件(Downloader Middlewares)

o 蜘蛛中间件(Spider Middlewares)

o 调度中间件(Scheduler Middlewares)

2.具体解析

绿线是数据流向

从初始URL开始,Scheduler会将其交给Downloader进

行下载

下载之后会交给Spider进行分析

Spider分析出来的结果有两种

一种是需要进一步抓取的链接,如 “下一页”的链接,它们

会被传回Scheduler;另一种是需要保存的数据,它们被送到Item Pipeline里,进行

后期处理(详细分析、过滤、存储等)。

在数据流动的通道里还可以安装各种中间件,进行必

要的处理。

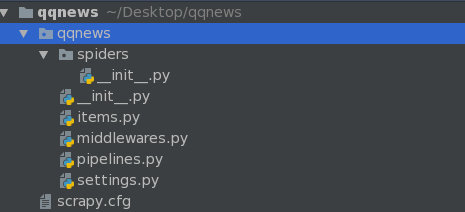

二。初始化爬虫框架 Scrapy

命令: scrapy startproject qqnews

ps:真正的项目是在spiders里面写入的

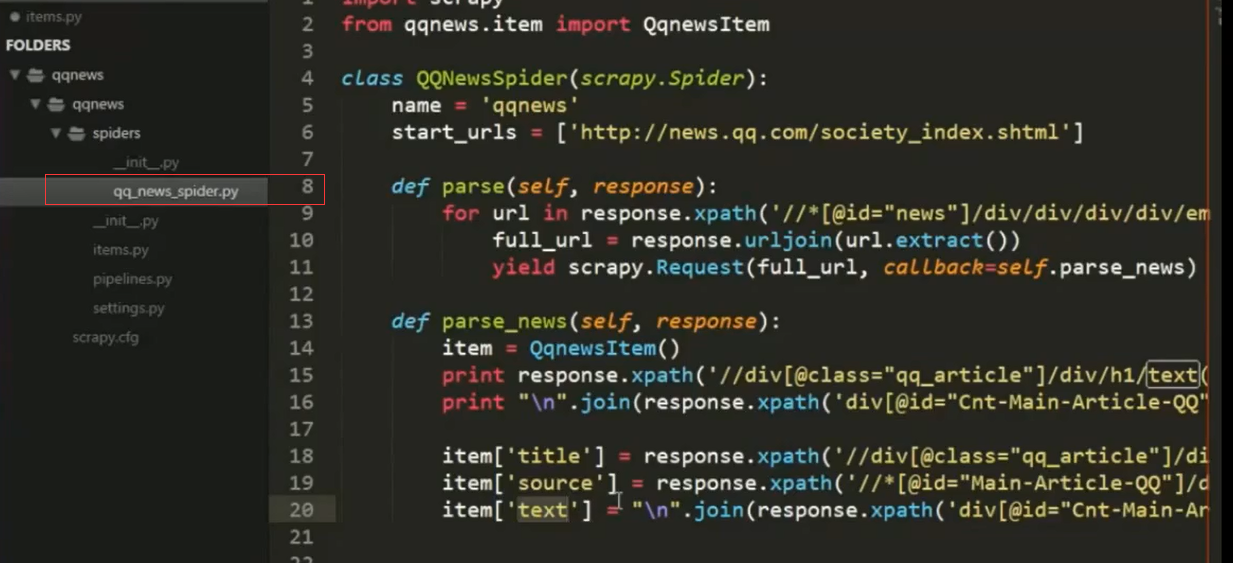

三。scrapy组件spider

爬取流程

1. 先初始化请求URL列表,并指定下载后处

理response的回调函数。

2. 在parse回调中解析response并返回字典,Item

对象,Request对象或它们的迭代对象。

3 .在回调函数里面,使用选择器解析页面内容

,并生成解析后的结果Item。

4. 最后返回的这些Item通常会被持久化到数据库

中(使用Item Pipeline)或者使用Feed exports将

其保存到文件中。

标准项目结构实例:

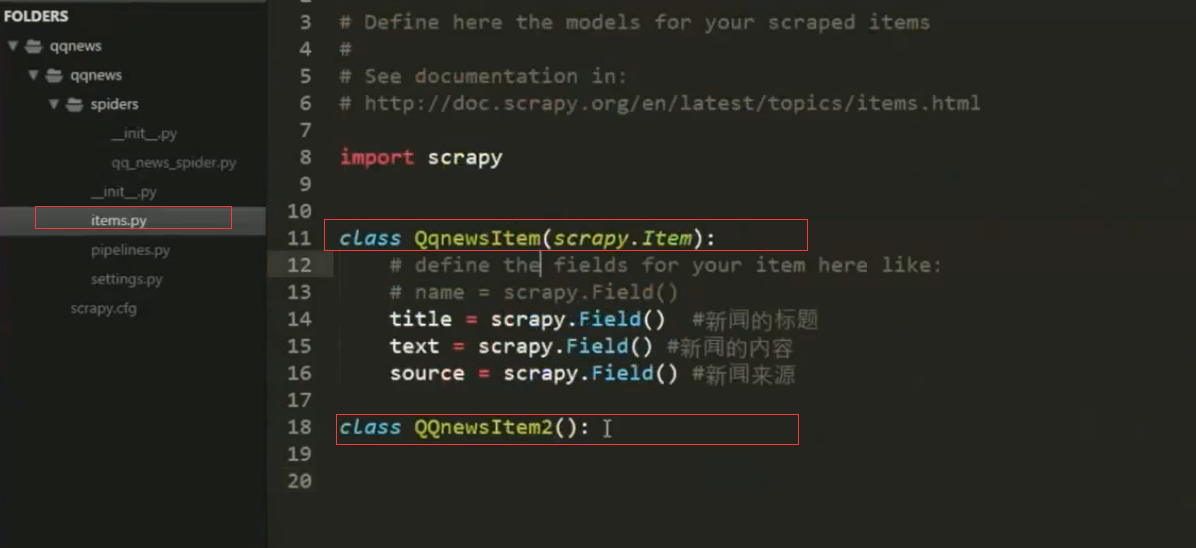

1.items结构:定义变量,根据不同种数据结构定义

2.spider结构中引入item里面,并作填充item

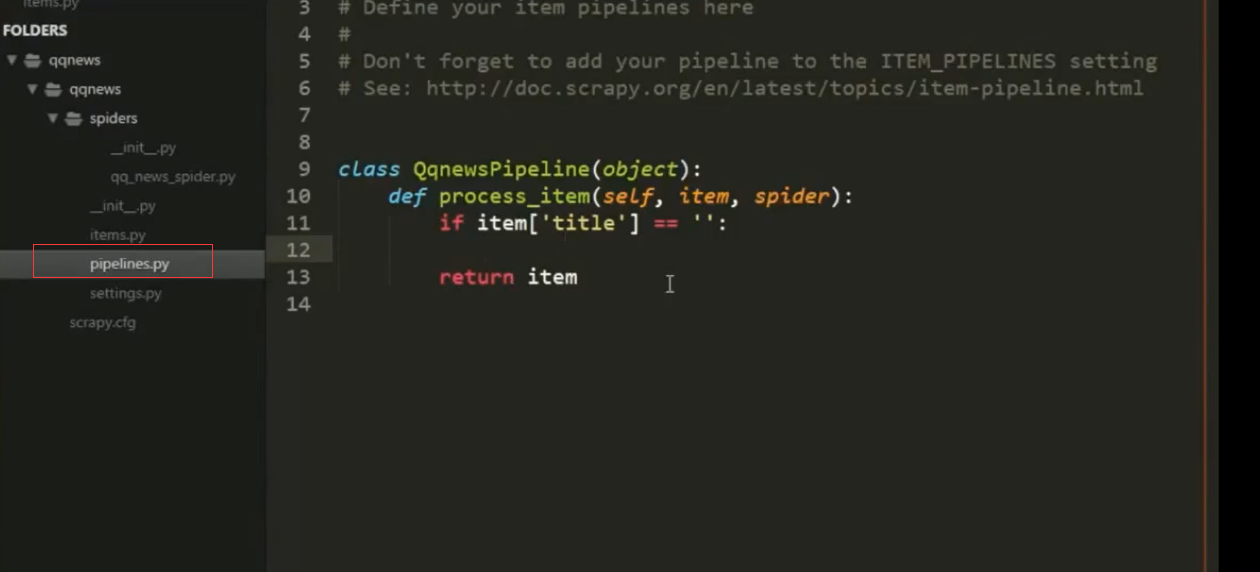

3。pipline去清洗,验证,存入数据库,过滤等等 后续处理

Item Pipeline常用场景

清理HTML数据

验证被抓取的数据(检查item是否包含某些字段)

重复性检查(然后丢弃)

将抓取的数据存储到数据库中

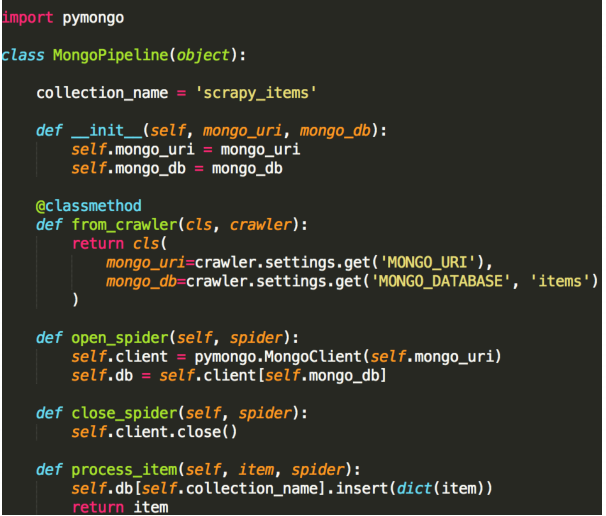

4.Scrapy组件Item Pipeline

经常会实现以下的方法:

open_spider(self, spider) 蜘蛛打开的时执行

close_spider(self, spider) 蜘蛛关闭时执行

from_crawler(cls, crawler) 可访问核心组件比如配置和

信号,并注册钩子函数到Scrapy中

pipeline真正处理逻辑

定义一个Python类,实现方法process_item(self, item,

spider)即可,返回一个字典或Item,或者抛出DropItem

异常丢弃这个Item。

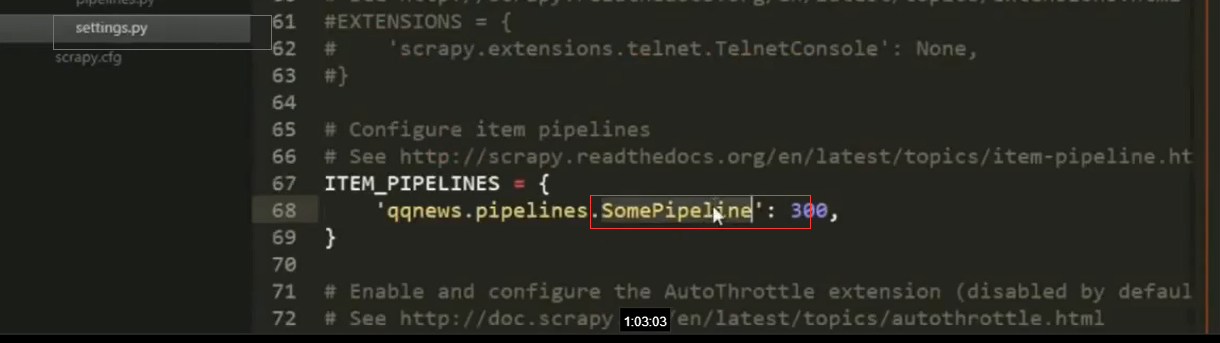

5.settings中定义哪种类型的pipeline

持续更新中。。。。,欢迎大家关注我的公众号LHWorld.

Python爬虫知识点四--scrapy框架的更多相关文章

- Python爬虫进阶之Scrapy框架安装配置

Python爬虫进阶之Scrapy框架安装配置 初级的爬虫我们利用urllib和urllib2库以及正则表达式就可以完成了,不过还有更加强大的工具,爬虫框架Scrapy,这安装过程也是煞费苦心哪,在此 ...

- python爬虫入门(六) Scrapy框架之原理介绍

Scrapy框架 Scrapy简介 Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应用框架,用途非常广泛. 框架的力量,用户只需要定制开发几个模块就可以轻松的实现一个爬 ...

- 零基础写python爬虫之使用Scrapy框架编写爬虫

网络爬虫,是在网上进行数据抓取的程序,使用它能够抓取特定网页的HTML数据.虽然我们利用一些库开发一个爬虫程序,但是使用框架可以大大提高效率,缩短开发时间.Scrapy是一个使用Python编写的,轻 ...

- python爬虫学习之Scrapy框架的工作原理

一.Scrapy简介 Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架. 可以应用在包括数据挖掘,信息处理或存储历史数据等一系列的程序中. 其最初是为了 页面抓取 (更确切来说, 网 ...

- PYTHON 爬虫笔记十一:Scrapy框架的基本使用

Scrapy框架详解及其基本使用 scrapy框架原理 Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架. 其可以应用在数据挖掘,信息处理或存储历史数据等一系列的程序中.其最初是为了 ...

- python 爬虫相关含Scrapy框架

1.从酷狗网站爬取 新歌首发的新歌名字.播放时长.链接等 from bs4 import BeautifulSoup as BS import requests import re import js ...

- 芝麻HTTP:Python爬虫进阶之Scrapy框架安装配置

初级的爬虫我们利用urllib和urllib2库以及正则表达式就可以完成了,不过还有更加强大的工具,爬虫框架Scrapy,这安装过程也是煞费苦心哪,在此整理如下. Windows 平台: 我的系统是 ...

- 【Python爬虫实战】Scrapy框架的安装 搬运工亲测有效

windows下亲测有效 http://blog.csdn.net/liuweiyuxiang/article/details/68929999这个我们只是正确操作步骤详解的搬运工

- 第三百三十四节,web爬虫讲解2—Scrapy框架爬虫—Scrapy爬取百度新闻,爬取Ajax动态生成的信息

第三百三十四节,web爬虫讲解2—Scrapy框架爬虫—Scrapy爬取百度新闻,爬取Ajax动态生成的信息 crapy爬取百度新闻,爬取Ajax动态生成的信息,抓取百度新闻首页的新闻rul地址 有多 ...

随机推荐

- JAVA提高五:注解Annotation

今天我们学习JDK5.0中一个非常重要的特性,叫做注解.是现在非常流行的一种方式,可以说因为配置XML 比较麻烦或者比容易查找出错误,现在越来越多的框架开始支持注解方式,比如注明的Spring 框架, ...

- Ubuntu16.04下Office替代品Office Online

Ubuntu16.04下Office替代品 Ubuntu16.04下的office Libreoffice 这个是Ubuntu自带的Office,总是存在各种问题,如果用来阅读还是不错的,但是编辑就不 ...

- 关于scanf 与 cin gets(),getline()......输入输出字符串的区别

很对人对于字符串的输入输出一直是比较模糊的,今天总结一下几个常用的输入流符号对于输入字符串时的区别: 1.scanf(),首先 它遇到空格或回车键(\n)就会结束,并且会将回车符算入字符串中: 2.c ...

- Locust性能测试框架,从入门到精通

1. Locust简介 Locust是使用Python语言编写实现的开源性能测试工具,简洁.轻量.高效,并发机制基于gevent协程,可以实现单机模拟生成较高的并发压力. 主要特点如下: 使用普通的P ...

- JAVA提高八:动态代理技术

对于动态代理,学过AOP的应该都不会陌生,因为代理是实现AOP功能的核心和关键技术.那么今天我们将开始动态代理的学习: 一.引出动态代理 生活中代理应该是很常见的,比如你可以通过代理商去买电脑,也可以 ...

- HTTP 简要

HTTP协议就是客户端和服务器交互的一种通迅的格式. 当在浏览器中点击这个链接的时候,浏览器会向服务器发送一段文本,告诉服务器请求打开的是哪一个网页.服务器收到请求后,就返回一段文本给浏览器,浏览器会 ...

- 【Win 10 应用开发】UI Composition 札记(一):视图框架的实现

在开始今天的内容之前,老周先说一个问题,这个问题记得以前有人提过的. 设置 Windows.ApplicationModel.Core.CoreApplicationView.TitleBar.Ext ...

- Vue源码后记-vFor列表渲染(1)

钩子函数比较简单,没有什么意思,这一节搞点大事情 => 源码中v-for的渲染过程. vue的内置指令包含了v-html.v-if.v-once.v-bind.v-on.v-show等,先从一个 ...

- ABAP开源项目清单

因为曾经的“SAP Code Exchange”平台已经于2013年倒闭,现在无论在SCN还是网络上都比较难找到一个地方来关注全部的优秀ABAP开源项目. 本文将这些项目的地址和他们的描述列出,以供参 ...

- [板子]segTree

segTree 参考:http://www.cnblogs.com/TenosDoIt/p/3453089.html#c 初学者建议先参考上面“一步一步理解线段树”学习理论. 在这里Code分别为区间 ...