deep learning的一些知识点

softmax loss:

softmax:  softmax的作用,将fc的输出映射成为(0,1)的概率,并将其差距拉大。

softmax的作用,将fc的输出映射成为(0,1)的概率,并将其差距拉大。

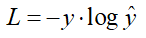

cross entropy loss:  y是样本的真实标签,为1,y'是样本的分数。单个样本的交叉熵计算方法。

y是样本的真实标签,为1,y'是样本的分数。单个样本的交叉熵计算方法。

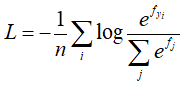

softmax loss:  计算n个样本的交叉熵,然后取均值。

计算n个样本的交叉熵,然后取均值。

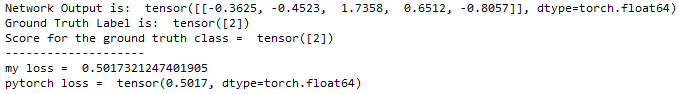

pytorch 的crossentropy loss的测试demo:

#coding=utf-8 import torch

import torch.nn as nn

import math

import numpy as np # output = torch.randn(1, 5, requires_grad = True) #假设是网络的最后一层,5分类

output=np.array([[-0.3625, -0.4523, 1.7358, 0.6512, -0.8057]],dtype='float')

output=torch.from_numpy(output)

# label = torch.empty(1, dtype=torch.long).random_(5) # 0 - 4, 任意选取一个分类

label=np.array([2],dtype='int64')

label=torch.from_numpy(label) print ('Network Output is: ', output)

print ('Ground Truth Label is: ', label) score = output [0,label.item()].item() # label对应的class的logits(得分)

print ('Score for the ground truth class = ', label) first = - score

second = 0

for i in range(5):

second += math.exp(output[0,i])

second = math.log(second) loss = first + second

print ('-' * 20)

print ('my loss = ', loss) loss = nn.CrossEntropyLoss()

print ('pytorch loss = ', loss(output, label))

输出:

在计算方式上:

cross entropy loss:

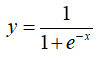

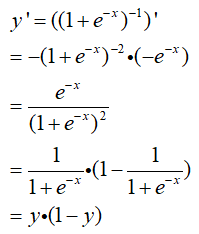

sigmoid:

sigmoid的导数:

deep learning的一些知识点的更多相关文章

- Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现(转)

Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些论文, ...

- Deep Learning 学习笔记——第9章

总览: 本章所讲的知识点包括>>>> 1.描述卷积操作 2.解释使用卷积的原因 3.描述pooling操作 4.卷积在实践应用中的变化形式 5.卷积如何适应输入数据 6.CNN ...

- 机器学习(Machine Learning)&深度学习(Deep Learning)资料【转】

转自:机器学习(Machine Learning)&深度学习(Deep Learning)资料 <Brief History of Machine Learning> 介绍:这是一 ...

- Deep Learning论文笔记之(八)Deep Learning最新综述

Deep Learning论文笔记之(八)Deep Learning最新综述 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些论文,但老感觉看完 ...

- Deep Learning论文笔记之(六)Multi-Stage多级架构分析

Deep Learning论文笔记之(六)Multi-Stage多级架构分析 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些 ...

- Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现

https://blog.csdn.net/zouxy09/article/details/9993371 自己平时看了一些论文,但老感觉看完过后就会慢慢的淡忘,某一天重新拾起来的时候又好像没有看过一 ...

- 深度学习的集成方法——Ensemble Methods for Deep Learning Neural Networks

本文主要参考Ensemble Methods for Deep Learning Neural Networks一文. 1. 前言 神经网络具有很高的方差,不易复现出结果,而且模型的结果对初始化参数异 ...

- Deep Learning论文笔记之(一)K-means特征学习

Deep Learning论文笔记之(一)K-means特征学习 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些论文,但老感 ...

- 机器学习(Machine Learning)&深度学习(Deep Learning)资料汇总 (上)

转载:http://dataunion.org/8463.html?utm_source=tuicool&utm_medium=referral <Brief History of Ma ...

随机推荐

- python可以提高程序执行速度N倍你知道吗?

1.1.Numba的约5分钟指南 Numba是Python的即时编译器,它最适用于使用NumPy数组和函数以及循环的代码.使用Numba的最常用方法是通过其装饰器集合,可以应用于您的函数来指示Numb ...

- unittest报告出现dict() -> new empty dictionary错误解决办法

unittest报告出现dict() -> new empty dictionary错误解决办法 说一下原因,这是由于unittest中采用了ddt驱动. 由于版本问题导致 问题如图: 解决办 ...

- 微信扫描二维码安卓弹出默认浏览器(苹果打开App Store)打开下载链接

使用微信推广的用户经常都会遇到推广链接被拦截导致无法下载app的情况,此时用户在微信中打开会提示“ 已停止访问该网页 ”.这对于使用微信营销的商家来说就很不友好且损失非常大,因为用户是不知道为什么打不 ...

- Linux基础命令---iostat显示设备状态

iostat iostat指令用来显示cpu状态,系统IO设备的状态,以及相关磁盘和NFS使用状态.iostat命令通过观察设备相对于其平均传输速率的活动时间来监视系统输入/输出设备负载.iostat ...

- Android的JSON数据解析

一. 使用原生方式解析 准备工作:准备一个布局文件,用来显示元数据与转换之后的数据 <?xml version="1.0" encoding="utf-8" ...

- matlab飞机飞行

function donghua4 %首先建立一个飞机模型 %然后写一个旋转仿射矩阵 %利用仿射变换改变飞机方向 clear;clc;TR=[1 50 41;1 51 50;2 51 1;3 51 2 ...

- Insert 导致死锁的两种情况

官档原文,懒得翻译了 https://dev.mysql.com/doc/refman/5.7/en/innodb-locks-set.html INSERT sets an exclusive lo ...

- PHP共享内存yac操作类

http://www.laruence.com/2013/03/18/2846.html 鸟哥介绍 https://www.cnblogs.com/willamwang/p/8918377.htm ...

- 启动Weblogic问题集锦

报错1:Could not obtain the localhost address. The most likely cause is an error in the network configu ...

- HDOJ1312 Red and black(DFS深度优先搜索)

There is a rectangular room, covered with square tiles. Each tile is colored either red or black. A ...