TensorFlow 中的张量,图,会话

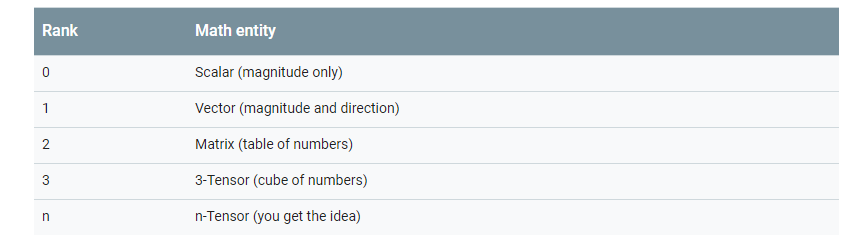

tensor的含义是张量,张量是什么,听起来很高深的样子,其实我们对于张量一点都不陌生,因为像标量,向量,矩阵这些都可以被认为是特殊的张量。如下图所示:

在TensorFlow中,tensor实际上就是各种“数”的统称。而flow是流动的意思。所以TensorFlow的意思就是“数”的流动,可以说TensorFlow这个名字很形象。一般来说,编程模式有两种,一种是命令式的,一种是符号式的。命令式便于理解和调试,而符号式便于对复杂代码进行封装和抽象(就想我们把一些操作封装成函数,每次调用根据不同的输入值来得到返回值)。TensorFlow是一个符号主义的库,在TensorFlow内部,需要先定义各种变量,然后建立一个计算图(计算流图),计算图指定了各个变量之间的计算关系。计算图就像工厂里的流水线,流水线决定了每一道工序是如何对原料进行加工的。TensorFlow中的原料就是计算图输入的数据,只有输入了数据,形成了数据流(tensor开始flow了),才能形成输出。

张量

import tensorflow as tf

"""

TensorFlow中的张量有三个属性:name,shape,dtype

1.name第一个属性是张量的一个标识符name=’参数为字符串类型’,如果没有指定,会根据张量是通过什么操作(运算)自动添加,后面的0表示张量d是计算节点add的第一个输出.

2.shape,描述张量的维度信息

3.dtype,张量的类型,如果在创建节点时没有指定dtype,没有小数点默认tf.int32,有小数点默认tf.float32.tensorflow会对参与计算张量的类型进行检查,不匹配会报错

"""

#张量的属性

result = tf.add(1,2)

print(result) # Tensor("Add:0", shape=(), dtype=int32)

result2 = tf.add(2,3,name='result2')

print(result2) # Tensor("result2:0", shape=(), dtype=int32)

result3 = tf.add(3,4,name='result2')

print(result3) # Tensor("result2_1:0", shape=(), dtype=int32)

# 创建图

a = tf.constant(1, name='input_a')

b = tf.constant(2, name='input_b',dtype=tf.int8)

f = tf.add(a,b, name='add_ab')

#每一个节点(上面的a,b,f)都是一个Op(Operation),每个Op可以接受或输出多个或0个tensor对象,如tf.constant()创建一个常量Op,

#TensorFlow可接收Python数值、布尔值、字符串、数组。单个数值转化为0阶张量(标量)。数值列表转化为1阶张量(向量)。由列表构成的列表转化为2阶张量(矩阵)。

#TensorFlow数据类型基于NumPy。任何NumPy数组都可以传递给TensorFlow Op。使用时指定所需数据类型比不指定的代价小。

#TensorFlow返回的张量都是NumPy数组

图和会话

"""

计算图(graph):只定义计算过程和数据(tensor)的操作方式,计算图中并不保存任何数据。

会话(session):会话分配计算资源(一台或者多台的机器)去执行计算图或计算图中的一部分运算操作。当前的变量和结果保存在会话中。

"""

#定义一个会话

graph = tf.Graph()

with graph.as_default():

var = tf.Variable(initial_value=1,name='var1')

initialize = tf.global_variables_initializer()

assign = var.assign(value=33)

#如果创建Op前,没有显式的创建计算图,TensorFlow将会在接下来的会话中使用使用默认的计算图

#在会话中运行计算图中定义的计算过程

"""

在TensorFlow中计算图的任何操作都需要在为计算图创建的会话中来运行。会话(session)会给相关的变量分配内存

"""

with tf.Session(graph=graph) as sess:

sess.run(initialize)

sess.run(assign)

print(sess.run(var))

# Output: 13

#变量只在一个session中有效,比如下面的代码会提示变量没有初始化。

with tf.Session(graph=graph) as sess2:

print(sess2.run(var))

# Error: Attempting to use uninitialized value var1

#当然,也可以在多个会话session中使用同一个计算图,但是每个会话中的变量是独立的,就像在多个车间中使用同样规格的生产线。

# 变量的保存和恢复

import tensorflow as tf

import numpy as np

#保存的目录

save_file = './ckpt/mymodel'

#创建用来处理保存操作的类

graph = tf.Graph()

with graph.as_default():

x = tf.placeholder(dtype=tf.float32,shape=[None,2])

y = tf.placeholder(dtype=tf.float32,shape=[None,2])

w = tf.Variable(initial_value=np.random.rand(1,2),dtype=tf.float32)

b = tf.Variable(initial_value=[1.0,1.0],dtype=tf.float32)

y_pred = x * w + b

loss=tf.reduce_mean(tf.square(y_pred-y))

optimizer = tf.train.GradientDescentOptimizer(learning_rate=0.1)

train = optimizer.minimize(loss)

saver = tf.train.Saver()

initialize = tf.global_variables_initializer()

x_data = np.random.rand(1000,2)

with tf.Session(graph = graph)as sess:

sess.run(initialize)

_, tmp_loss = sess.run([train, loss], feed_dict={x: x_data, y: x_data * [[2, 2]]})

print('loss:',tmp_loss)

for i in range(5000):

_,tmp_loss=sess.run([train,loss],feed_dict={x:x_data,y:x_data*[[2,2]]})

_, tmp_loss = sess.run([train, loss], feed_dict={x: x_data, y: x_data * [[2, 2]]})

print('loss:',tmp_loss)

print('w:',sess.run(w))

saver.save(sess,save_path=save_file)

with tf.Session(graph = graph) as sess_restore:

saver.restore(sess_restore,save_file)

print('w:',sess_restore.run(w))

"""

注意:tf.train.Saver()需要在你想要保存的变量的定义后在创建,并且要求和这些变量在同一个计算图中,否则将会导致TensorFlow的ValueError: No variables to save 错误。

"""

TensorFlow 中的张量,图,会话的更多相关文章

- TensorFlow计算图,张量,会话基础知识

import tensorflow as tf get_default_graph = "tensorflow_get_default_graph.png" # 当前默认的计算图 ...

- AI学习---TensorFlow框架介绍[图+会话+张量+变量OP+API]

TensorFlow的数据流图 TensorFlow的结构分析: 图 + 会话 TensorFlow = 构图阶段(数据与操作的执行步骤被描绘出一个图) + 执行图阶段(使用回话执行构建好的图中操作) ...

- 对Tensorflow中tensor的理解

Tensor即张量,在tensorflow中所有的数据都通过张量流来传输,在看代码的时候,对张量的概念很不解,很容易和矩阵弄混,今天晚上查了点资料,并深入了解了一下,简单总结一下什么是张量的阶,以及张 ...

- Tensorflow中的图(tf.Graph)和会话(tf.Session)详解

Tensorflow中的图(tf.Graph)和会话(tf.Session) Tensorflow编程系统 Tensorflow工具或者说深度学习本身就是一个连贯紧密的系统.一般的系统是一个自治独立的 ...

- Tensorflow学习笔记——张量、图、常量、变量(一)

1 张量和图 TensorFlow是一种采用数据流图(data flow graphs),用于数值计算的开源软件库.其中 Tensor 代表传递的数据为张量(多维数组),Flow 代表使用计算图进行运 ...

- TensorFlow笔记-变量,图,会话

变量 存储一些临时值的作用或者长久存储.在Tensorflow中当训练模型时,用变量来存储和更新参数.变量包含张量(Tensor)存放于内存的缓存区.建模时它们需要被明确地初始化,模型训练后它们必须被 ...

- TensorFlow中的 tensor 张量到底是什么意思?

详见[Reference]: TensorFlow中的“Tensor”到底是什么? 以下摘录一些要点: 这个图好生动呀!~ 标量和向量都是张量(tensor).

- tensorflow中张量_常量_变量_占位符

1.tensor 在tensorflow中,数据是被封装在tensor对象中的.tensor是张量的意思,即包含从0到任意维度的张量.常数是0维度的张量,向量是1维度的张量,矩阵是二维度的张量,以及还 ...

- tensorflow中张量的理解

自己通过网上查询的有关张量的解释,稍作整理. TensorFlow用张量这种数据结构来表示所有的数据.你可以把一个张量想象成一个n维的数组或列表.一个张量有一个静态类型和动态类型的维数.张量可以在图中 ...

随机推荐

- 用ES5实现ES6的数组方法map

先举个常见的栗子: var arr = [1,2,3,4,6,7,8,9,12,3,25,63,100] var arr2 = arr.map(item => item += 1) consol ...

- 这份前端面试小册子dog cheng带来啦~

写在前面 没有错,就是我啦dog cheng,好久不见,从17年在博客园写下第一篇文章,转身间已然两年,从大二到现在的大四预备毕业生,我仍然在这条道路上前进.秋招早已经结束,在拿到用友,滴滴的offe ...

- Mac重装操作系统系统

恢复出厂设置 第一种 1.开机 2.commond + R,进入recover模式. 3.选择磁盘工具 4.显示所有设备 5.抹掉硬盘.格式选择 (1):Mac OS 扩展(日志式). (2): Ma ...

- 《C++Primer》第五版习题答案--第一章【学习笔记】

C++Primer第五版习题解答---第一章 ps:答案是个人在学习过程中书写,可能存在错漏之处,仅作参考. 作者:cosefy Date: 2022/1/7 第一章:开始 练习1.3 #includ ...

- PS/2的相关知识

PS/2接口 很多微机上采用PS/2口来连接鼠标和键盘.PS/2接口与传统的键盘接口除了在接口外型.引脚有不同外,在数据传送格式上是相同的.现在很多主板用PS/2接口插座连接键盘,传统接口的键盘可以通 ...

- 流程控制-物流费用计算(嵌套if)

题目描述 快递公司规定,如果物品体积超过2.5立方米,不允许快递.如果重量超过40kg,不允许快递.快递收费价格为: 小于等于1kg,一口价10块钱: 大于1kg,小于等于5kg,10块钱的基础上,每 ...

- QGIS WGS84转其它坐标系并计算坐标

需求: 将带有经度.纬度(WGS84坐标系)坐标的文本(*.txt)转换成指定投影坐标系的shp文件并计算x,y坐标. 环境和工具: WIN10.QGIS2.16.带有经纬度坐标的文本.格式如下图: ...

- 2、Automapper安装及配置

一. 安装 我们安装是在 vs 中使用Nuget的方式进行安装 不过安装时需注意一件事情就是,版本问题,我示例使用的是.net framework 4.5.2,所以我安装AutoMapper的版本是7 ...

- 5.JavaSE之数据类型详解

数据类型: 强类型语言: 要求变量的使用严格要求符合规定,写错了就不行,所有变量都必须先定义后才能使用,否则是不能使用的. 比如Java.C++都是强类型语言,也就是说,一旦定义了一个变量,只定义了某 ...

- .NET Core Install for Ubuntu 14.04

Add the dotnet apt-get feed In order to install .NET Core on Ubuntu or Linux Mint, you need to fir ...