HashMap底层原理分析

自动扩容

- 节点的元素无后继节点:

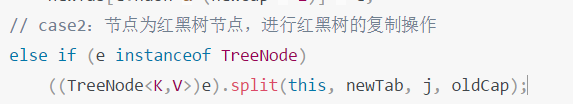

- 节点为树节点:

1 final void split(HashMap<K,V> map, Node<K,V>[] tab, int index, int bit) {

2 // 获取自身树节点

3 TreeNode<K,V> b = this;

4 // Relink into lo and hi lists, preserving order

5 // 低位链表的头尾节点

6 TreeNode<K,V> loHead = null, loTail = null;

7 // 高位链表的头尾节点

8 TreeNode<K,V> hiHead = null, hiTail = null;

9 // 低位链表节点数量、高位链表节点数量

10 int lc = 0, hc = 0;

11 for (TreeNode<K,V> e = b, next; e != null; e = next) {

12 next = (TreeNode<K,V>)e.next;

13 // 这步操作不是多余的,在e为低位或高位链表最终尾节点时起到赋空作用

14 e.next = null;

15 // 如果仍然在原位置,则加入低位链表

16 if ((e.hash & bit) == 0) {

17 if ((e.prev = loTail) == null)

18 loHead = e;

19 else

20 loTail.next = e;

21 loTail = e;

22 ++lc;//低位链表数量+1

23 }

24 else {

25 // 如果是在新的位置(原索引值+oldcap),加入高位链表

26 if ((e.prev = hiTail) == null)

27 hiHead = e;

28 else

29 hiTail.next = e;

30 hiTail = e;

31 ++hc;// 高位链表数量+1

32 }

33 }

34 // 低位链表不为空

35 if (loHead != null) {

36 // 低位链表数量不超过6,则深拷贝低位树节点链表得到普通节点新链表,并将新链表头部放入数组

37 if (lc <= UNTREEIFY_THRESHOLD)

38 tab[index] = loHead.untreeify(map);

39 else {

40 tab[index] = loHead;

41 // 如果高位链表为空,说明全部元素都在低位链表中,因为原链表已经是树化的了,所以不用再转为红黑树

42 if (hiHead != null) // (else is already treeified)

43 loHead.treeify(tab);

44 }

45 }

46 // 高位链表不为空

47 if (hiHead != null) {

48 // 高位链表数量不超过6,则深拷贝树节点高位链表得到普通节点新链表,并将新链表头部放入数组

49 if (hc <= UNTREEIFY_THRESHOLD)

50 tab[index + bit] = hiHead.untreeify(map);

51 else {

52 tab[index + bit] = hiHead;

53 // 如果低位链表为空,说明全部元素都在高位链表中,因为原链表已经是树化的了,所以不用再转为红黑树

54 if (loHead != null)

55 hiHead.treeify(tab);

56 }

57 }

58 }

- 节点为链表节点:

1 // case3:节点为链表节点,进行链表的赋值操作

2 else { // preserve order

3 // 低位Node链表头节点和尾节点

4 Node<K,V> loHead = null, loTail = null;

5 // 高位Node链表头节点和尾节点

6 Node<K,V> hiHead = null, hiTail = null;

7 Node<K,V> next;

8 // 遍历原链表,拆分成低位链表和高位链表

9 do {

10 next = e.next;

11 // 如果是在原位置,则加入低位链表

12 if ((e.hash & oldCap) == 0) {

13 if (loTail == null)

14 loHead = e;

15 else

16 loTail.next = e;

17 loTail = e;

18 }

19 else {

20 // 如果不在原位置,加入高位链表

21 if (hiTail == null)

22 hiHead = e;

23 else

24 hiTail.next = e;

25 hiTail = e;

26 }

27 } while ((e = next) != null);

28 // 如果低位链表不为空

29 if (loTail != null) {

30 // 尾部节点赋空并将头部节点放入数组指定位置

31 loTail.next = null;

32 newTab[j] = loHead;

33 }

34 // 如果高位链表不为空

35 if (hiTail != null) {

36 // 尾部节点赋空并将头部节点放入数组指定位置

37 hiTail.next = null;

38 newTab[j + oldCap] = hiHead;

39 }

40 }

在jdk1.8之前,hashmap在多线程环境中使用会出现死链问题。如果有多个线程同时进行扩容操作,一个线程拿到链表头节点和后继节点时挂起,另一个线程执行完扩容操作,会使得这两个节点互相依赖,出现死链,导致第一个线程不能退出循环,CPU使用率飙升。

jdk1.8将原来的头插法改为了尾插法,同时复制链表时不再是遍历一个节点就插入,而是使用高低位链表。待遍历完所有节点后,再将高低位链表放入新数组对应位置。

初始化与懒加载

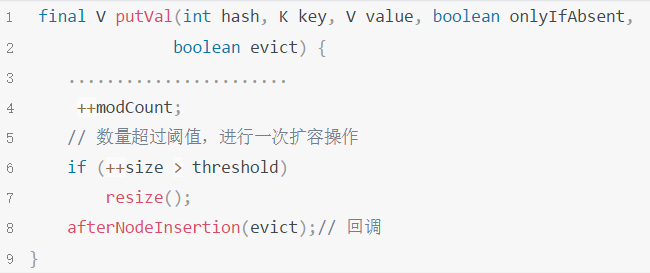

1 final V putVal(int hash, K key, V value, boolean onlyIfAbsent,

2 boolean evict) {

3 Node<K,V>[] tab; Node<K,V> p; int n, i;

4 // 如果节点数组未初始化或为空,则进行初始化操作

5 if ((tab = table) == null || (n = tab.length) == 0)

6 n = (tab = resize()).length;

1 final Node<K,V>[] resize() {

2 // 获取原有table

3 Node<K,V>[] oldTab = table;

4 int oldCap = (oldTab == null) ? 0 : oldTab.length;

5 int oldThr = threshold;

6 // 新容量、新阈值

7 int newCap, newThr = 0;

8 ......................

9 else { // zero initial threshold signifies using defaults

10 // 原容量和阈值都<=0,则用默认值初始化,默认容量16,负载因子0.75,对应的是hashmap没带参数初始化。

11 newCap = DEFAULT_INITIAL_CAPACITY;

12 newThr = (int)(DEFAULT_LOAD_FACTOR * DEFAULT_INITIAL_CAPACITY);

13 }

哈希计算

1 static final int hash(Object key) {

2 int h;

3 return (key == null) ? 0 : (h = key.hashCode()) ^ (h >>> 16);

4 }

1 static final int MOVED = -1; // hash for forwarding nodes

2 static final int TREEBIN = -2; // hash for roots of trees

3 static final int RESERVED = -3; // hash for transient reservations

4 static final int HASH_BITS = 0x7fffffff; // usable bits of normal node hash

5 static final int spread(int h) {

6 return (h ^ (h >>> 16)) & HASH_BITS;

7 }

哈希冲突

1 // 如果链表的数量超过了8,且数组cap大小>=64则转为红黑树

2 // 如果链表数量超过了8,但数组cap大小<64则resize()扩容

3 if (binCount >= TREEIFY_THRESHOLD - 1) // -1 for 1st

4 treeifyBin(tab, hash);

5

6 final void treeifyBin(Node<K,V>[] tab, int hash) {

7 int n, index; Node<K,V> e;

8 // 如果数组长度没达到64就扩容

9 if (tab == null || (n = tab.length) < MIN_TREEIFY_CAPACITY)

10 resize();

位运算

1 static final int tableSizeFor(int cap) {

2 int n = cap - 1;

3 n |= n >>> 1;

4 n |= n >>> 2;

5 n |= n >>> 4;

6 n |= n >>> 8;

7 n |= n >>> 16;

8 return (n < 0) ? 1 : (n >= MAXIMUM_CAPACITY) ? MAXIMUM_CAPACITY : n + 1;

9 }

HashMap底层原理分析的更多相关文章

- HashMap底层原理分析(put、get方法)

1.HashMap底层原理分析(put.get方法) HashMap底层是通过数组加链表的结构来实现的.HashMap通过计算key的hashCode来计算hash值,只要hashCode一样,那ha ...

- 基础进阶(一)之HashMap实现原理分析

HashMap实现原理分析 1. HashMap的数据结构 数据结构中有数组和链表来实现对数据的存储,但这两者基本上是两个极端. 数组 数组存储区间是连续的,占用内存严重,故空间复杂的很大.但数组的二 ...

- 最简单的HashMap底层原理介绍

HashMap 底层原理 1.HashMap底层概述 2.JDK1.7实现方式 3.JDK1.8实现方式 4.关键名词 5.相关问题 1.HashMap底层概述 在JDK1.7中HashMap采用的 ...

- java基础进阶二:HashMap实现原理分析

HashMap实现原理分析 1. HashMap的数据结构 数据结构中有数组和链表来实现对数据的存储,但这两者基本上是两个极端. 数组 数组存储区间是连续的,占用内存严重,故空间复杂的很大.但数组的二 ...

- 面试官再问你 HashMap 底层原理,就把这篇文章甩给他看

前言 HashMap 源码和底层原理在现在面试中是必问的.因此,我们非常有必要搞清楚它的底层实现和思想,才能在面试中对答如流,跟面试官大战三百回合.文章较长,介绍了很多原理性的问题,希望对你有所帮助~ ...

- 总结HashMap实现原理分析

一.底层数据结构在JDK1.6,JDK1.7中,HashMap采用位桶+链表实现,即使用链表处理冲突,同一hash值的键值对会被放在同一个位桶里,当桶中元素较多时,通过key值查找的效率较低. 而JD ...

- HashMap底层原理及jdk1.8源码解读

一.前言 写在前面:小编码字收集资料花了一天的时间整理出来,对你有帮助一键三连走一波哈,谢谢啦!! HashMap在我们日常开发中可谓经常遇到,HashMap 源码和底层原理在现在面试中是必问的.所以 ...

- JMM和Volatile底层原理分析

JMM和volatile分析 1.JMM:Java Memory Model,java线程内存模型 JMM:它是一个抽象的概念,描述的是线程和内存间的通信,java线程内存模型和CPU缓存模型类似,它 ...

- hashMap 底层原理+LinkedHashMap 底层原理+常见面试题

1.源码 java1.7 hashMap 底层实现是数组+链表 java1.8 对上面进行优化 数组+链表+红黑树 2.hashmap 是怎么保存数据的. 在hashmap 中有这样一个结构 ...

随机推荐

- Hive相关的命令

hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供完整的sql查询功能,可以将sql语句转换为MapReduce任务进行运行. 其优点是学习成本低,可以通过 ...

- MongoDB4.2 分片扫盲说明

说明: 在扫盲MongoDB相关的一些知识的时候,顺手做下笔记.本文将说明分片相关的内容.在比较早之前已经对这些有过说明,可以看MongoDB 分片的原理.搭建.应用.分片(sharding)是指将数 ...

- Java并发编程之并发关键字

volatile 保证可见性 一个线程修改volatile变量的值时,该变量的新值会立即刷新到主内存中,这个新值对其他线程来说是立即可见的 一个线程读取volatile变量的值时,该变量在本地内存中缓 ...

- 生成元(JAVA语言)

package 第三章; import java.util.Scanner; public class 生成元 { public static void main(String[] args) { / ...

- c++ 反汇编 数组和指针

字符串初始化字符数组 58: char as[] = "hello word"; 00AC7308 A1 70 2E B6 00 mov eax,dword ptr [string ...

- IgniteMe -高校网络信息安全运维挑战赛

1 int __cdecl main(int argc, const char **argv, const char **envp) 2 { 3 void *v3; // eax 4 int v4; ...

- 5、Spring教程之依赖注入

概念 依赖注入(Dependency Injection,DI). 依赖 : 指Bean对象的创建依赖于容器 . Bean对象的依赖资源 . 注入 : 指Bean对象所依赖的资源 , 由容器来设置和装 ...

- CyclicBarrier:人齐了,老司机就可以发车了!

上一篇咱讲了 CountDownLatch 可以解决多个线程同步的问题,相比于 join 来说它的应用范围更广,不仅可以应用在线程上,还可以应用在线程池上.然而 CountDownLatch 却是一次 ...

- BUAA_OO_2020_第三单元总结

BUAA_OO_2020_第三单元总结 JML理论基础 简介 JML(Java Modeling Language)是一种用于对JAVA程序进行规格化设计的语言,其通过定义接口所包含方法的行为,来约束 ...

- Spring Security OAuth 格式化 token 输出

个性化token 背景 上一篇文章<Spring Security OAuth 个性化token(一)>有提到,oauth2.0 接口默认返回的报文格式如下: { "ac ...