Python实现结巴分词统计高频中文词汇

代码

1 # 读取文件

2 fn = open('youxi.txt', 'rt', encoding='utf-8') # 打开文件

3 string_data = fn.read() # 读出整个文件

4 fn.close() # 关闭文件

5

6 # 文本预处理

7 pattern = re.compile(u'\t|\n|\.|-|:|;|\)|\(|\?|"') # 定义正则表达式匹配模式

8 string_data = re.sub(pattern, '', string_data) # 将符合模式的字符去除

9

10 # 文本分词

11 seg_list_exact = jieba.cut(string_data, cut_all=False) # 精确模式分词

12 object_list = []

13

14 # 分词并去除停用词

15 remove_words = set()

16 fr = open('stopword.txt', encoding = 'UTF-8')

17 for word in fr:

18 remove_words.add(str(word).strip())

19 fr.close()

20

21 for word in seg_list_exact: # 循环读出每个分词

22 if word not in remove_words: # 如果不在去除词库中

23 object_list.append(word) # 分词追加到列表

24

25 # 词频统计

26 word_counts = collections.Counter(object_list) # 对分词做词频统计

27 word_counts_top10 = word_counts.most_common(100) # 获取前100最高频的词

28 print(word_counts_top10) # 输出检查

需要引入的库

1 import re # 正则表达式库

2 import collections # 词频统计库

3 import numpy as np # numpy数据处理库

4 import jieba # 结巴分词

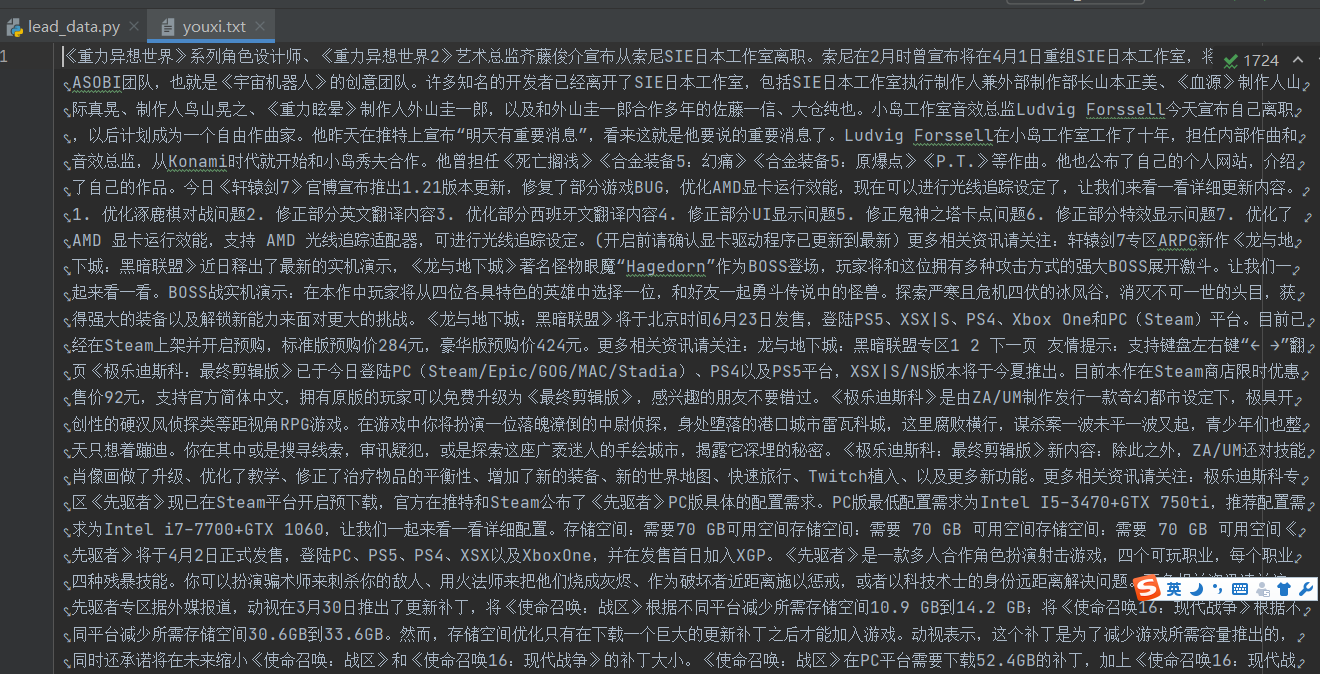

文件内容示例

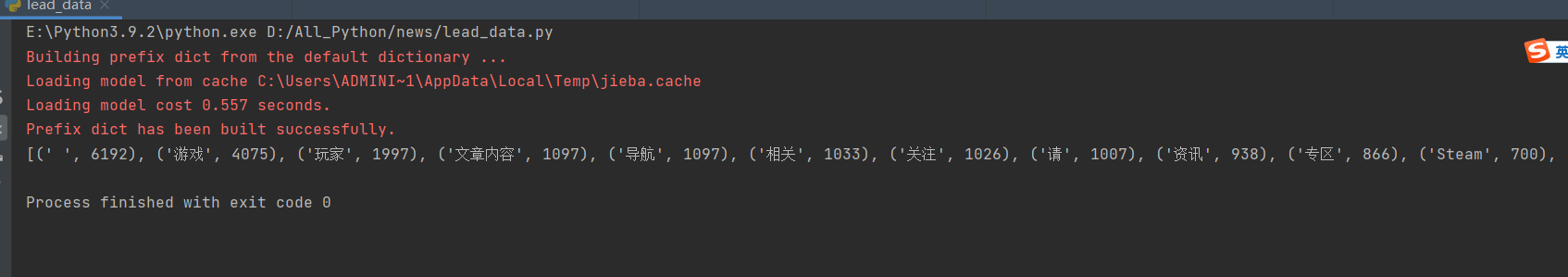

处理结果示例(前100)

Python实现结巴分词统计高频中文词汇的更多相关文章

- Python中结巴分词使用手记

手记实用系列文章: 1 结巴分词和自然语言处理HanLP处理手记 2 Python中文语料批量预处理手记 3 自然语言处理手记 4 Python中调用自然语言处理工具HanLP手记 5 Python中 ...

- 中文分词接口api,采用结巴分词PHP版中文分词接口

中文分词,分词就是将连续的字序列按照一定的规范重新组合成词序列的过程.我们知道,在英文的行文中,单词之间是以空格作为自然分界符的,而中文只是字.句和段能通过明显的分界符来简单划界,唯独词没有一个形式上 ...

- python中文分词:结巴分词

中文分词是中文文本处理的一个基础性工作,结巴分词利用进行中文分词.其基本实现原理有三点: 基于Trie树结构实现高效的词图扫描,生成句子中汉字所有可能成词情况所构成的有向无环图(DAG) 采用了动态规 ...

- python 中文分词:结巴分词

中文分词是中文文本处理的一个基础性工作,结巴分词利用进行中文分词.其基本实现原理有三点: 基于Trie树结构实现高效的词图扫描,生成句子中汉字所有可能成词情况所构成的有向无环图(DAG) 采用了动态规 ...

- Simple: SQLite3 中文结巴分词插件

一年前开发 simple 分词器,实现了微信在两篇文章中描述的,基于 SQLite 支持中文和拼音的搜索方案.具体背景参见这篇文章.项目发布后受到了一些朋友的关注,后续也发布了一些改进,提升了项目易用 ...

- 结巴分词和自然语言处理HanLP处理手记

手记实用系列文章: 1 结巴分词和自然语言处理HanLP处理手记 2 Python中文语料批量预处理手记 3 自然语言处理手记 4 Python中调用自然语言处理工具HanLP手记 5 Python中 ...

- python jieba分词(结巴分词)、提取词,加载词,修改词频,定义词库 -转载

转载请注明出处 “结巴”中文分词:做最好的 Python 中文分词组件,分词模块jieba,它是python比较好用的分词模块, 支持中文简体,繁体分词,还支持自定义词库. jieba的分词,提取关 ...

- 中文分词之结巴分词~~~附使用场景+demo(net)

常用技能(更新ing):http://www.cnblogs.com/dunitian/p/4822808.html#skill 技能总纲(更新ing):http://www.cnblogs.com/ ...

- Python 结巴分词(1)分词

利用结巴分词来进行词频的统计,并输出到文件中. 结巴分词github地址:结巴分词 结巴分词的特点: 支持三种分词模式: 精确模式,试图将句子最精确地切开,适合文本分析: 全模式,把句子中所有的可以成 ...

- 结巴(jieba)中文分词及其应用实践

中文文本分类不像英文文本分类一样只需要将单词一个个分开就可以了,中文文本分类需要将文字组成的词语分出来构成一个个向量.所以,需要分词. 这里使用网上流行的开源分词工具结巴分词(jieba),它可以有效 ...

随机推荐

- 问题处理:java.sql.SQLException: Value '0000-00-00 00:00:00' can not be represented as java.sql.Timestamp

问题说明 今天跑spring boot项目,在查看列表数据时后台抛异常了,一看是这玩意: 问题原因 "0000-00-00 00:00:00"在mysql中是作为一个特殊值存在的但 ...

- win32 - 创建带有标准阴影的无边框窗口

这个框框好像删不掉,就先放这边吧... #define WIN32_LEAN_AND_MEAN #include <unknwn.h> #include <windows.h&g ...

- 最简最快了解RPC核心流程

本文主要以最简易最快速的方式介绍RPC调用核心流程,文中以Dubbo为例.同时,会写一个简易的RPC调用代码,方便理解和记忆核心组件和核心流程. 1.核心思想 RPC调用过程中,最粗矿的核心组件3个: ...

- [BUUCTF][WEB][极客大挑战 2019]PHP 1

打开靶机URL 看到字面提示 因为每次猫猫都在我键盘上乱跳,所以我有一个良好的备份网站的习惯不愧是我!!! 说明该网站有备份,说不定放在了Http服务器的某个目录下 那么这里我们可以用dirsearc ...

- js结合canvas画任意多边形

实现六边形 // html <canvas></canvas> // js const canvas = document.querySelector("canvas ...

- 【LeetCode二叉树#15】二叉搜索树中的众数(递归中序遍历)

二叉搜索树中的众数 力扣题目链接(opens new window) 给定一个有相同值的二叉搜索树(BST),找出 BST 中的所有众数(出现频率最高的元素). 假定 BST 有如下定义: 结点左子树 ...

- 第136篇:动画API:setInterval 与 requestAnimationFrame的区别

好家伙,书接上文 function animate() { //请求-动画-框架 requestAnimationFrame( animate ); //改变正方体在场景中的位置,让正方体动起来 ...

- 使用ConfuserEx代码混淆工具保护你的.NET应用程序

前言 .NET应用如何防止被反编译?这个对于我们.NET开发而言是一个值得关注和重视的问题,防止应用程序被反编译的手段有很多本文我们主要讲讲如何使用ConfuserEx .NET开源免费的代码混淆工具 ...

- Unity3D常用方法

1.StartCoroutine(Thread1()) 启动协程运行Thread1()方法. 注意是协程,不是线程,详情见:https://www.jianshu.com/p/6d923cb0c900 ...

- Centos系统下,各种服务重启

1.sudo systemctl start firewalld 2../redis-server /usr/local/bin/redis.conf 3.mongod -f /etc/mongod ...