Python实现结巴分词统计高频中文词汇

代码

1 # 读取文件

2 fn = open('youxi.txt', 'rt', encoding='utf-8') # 打开文件

3 string_data = fn.read() # 读出整个文件

4 fn.close() # 关闭文件

5

6 # 文本预处理

7 pattern = re.compile(u'\t|\n|\.|-|:|;|\)|\(|\?|"') # 定义正则表达式匹配模式

8 string_data = re.sub(pattern, '', string_data) # 将符合模式的字符去除

9

10 # 文本分词

11 seg_list_exact = jieba.cut(string_data, cut_all=False) # 精确模式分词

12 object_list = []

13

14 # 分词并去除停用词

15 remove_words = set()

16 fr = open('stopword.txt', encoding = 'UTF-8')

17 for word in fr:

18 remove_words.add(str(word).strip())

19 fr.close()

20

21 for word in seg_list_exact: # 循环读出每个分词

22 if word not in remove_words: # 如果不在去除词库中

23 object_list.append(word) # 分词追加到列表

24

25 # 词频统计

26 word_counts = collections.Counter(object_list) # 对分词做词频统计

27 word_counts_top10 = word_counts.most_common(100) # 获取前100最高频的词

28 print(word_counts_top10) # 输出检查

需要引入的库

1 import re # 正则表达式库

2 import collections # 词频统计库

3 import numpy as np # numpy数据处理库

4 import jieba # 结巴分词

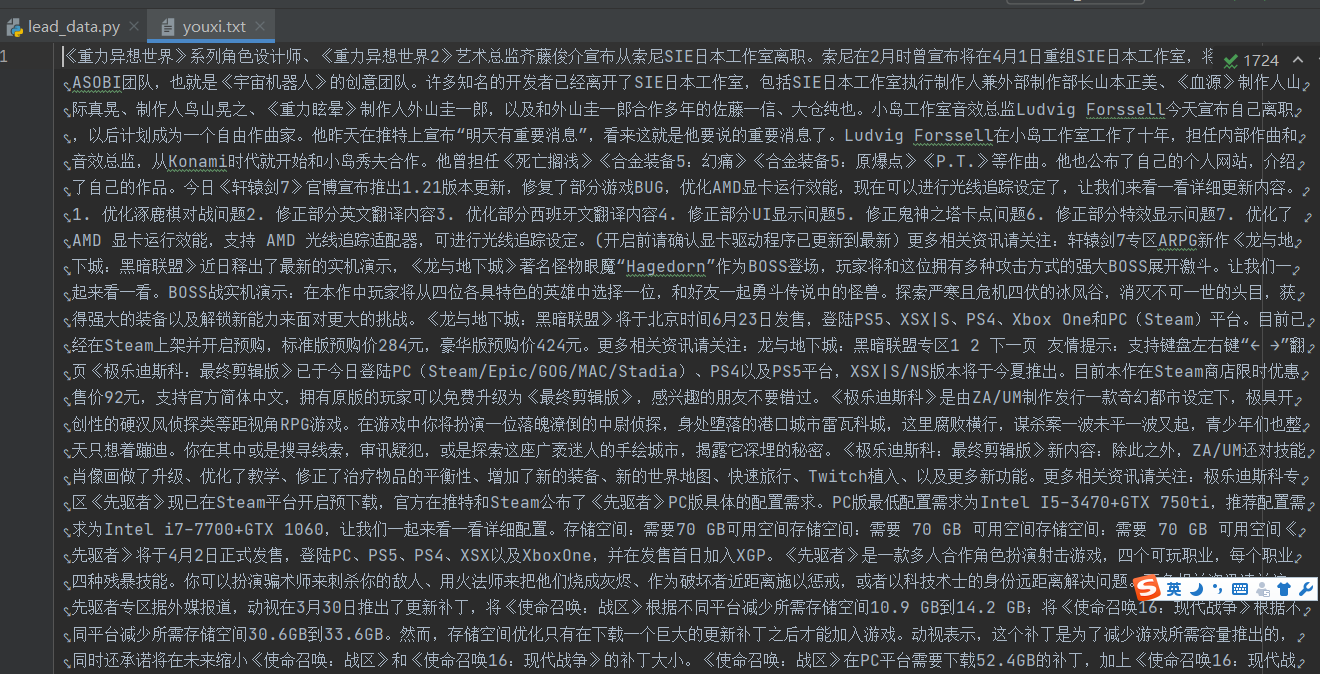

文件内容示例

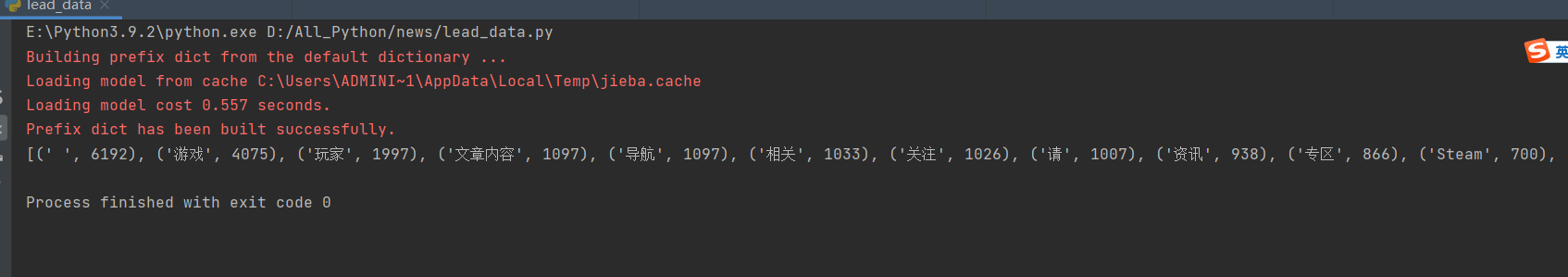

处理结果示例(前100)

Python实现结巴分词统计高频中文词汇的更多相关文章

- Python中结巴分词使用手记

手记实用系列文章: 1 结巴分词和自然语言处理HanLP处理手记 2 Python中文语料批量预处理手记 3 自然语言处理手记 4 Python中调用自然语言处理工具HanLP手记 5 Python中 ...

- 中文分词接口api,采用结巴分词PHP版中文分词接口

中文分词,分词就是将连续的字序列按照一定的规范重新组合成词序列的过程.我们知道,在英文的行文中,单词之间是以空格作为自然分界符的,而中文只是字.句和段能通过明显的分界符来简单划界,唯独词没有一个形式上 ...

- python中文分词:结巴分词

中文分词是中文文本处理的一个基础性工作,结巴分词利用进行中文分词.其基本实现原理有三点: 基于Trie树结构实现高效的词图扫描,生成句子中汉字所有可能成词情况所构成的有向无环图(DAG) 采用了动态规 ...

- python 中文分词:结巴分词

中文分词是中文文本处理的一个基础性工作,结巴分词利用进行中文分词.其基本实现原理有三点: 基于Trie树结构实现高效的词图扫描,生成句子中汉字所有可能成词情况所构成的有向无环图(DAG) 采用了动态规 ...

- Simple: SQLite3 中文结巴分词插件

一年前开发 simple 分词器,实现了微信在两篇文章中描述的,基于 SQLite 支持中文和拼音的搜索方案.具体背景参见这篇文章.项目发布后受到了一些朋友的关注,后续也发布了一些改进,提升了项目易用 ...

- 结巴分词和自然语言处理HanLP处理手记

手记实用系列文章: 1 结巴分词和自然语言处理HanLP处理手记 2 Python中文语料批量预处理手记 3 自然语言处理手记 4 Python中调用自然语言处理工具HanLP手记 5 Python中 ...

- python jieba分词(结巴分词)、提取词,加载词,修改词频,定义词库 -转载

转载请注明出处 “结巴”中文分词:做最好的 Python 中文分词组件,分词模块jieba,它是python比较好用的分词模块, 支持中文简体,繁体分词,还支持自定义词库. jieba的分词,提取关 ...

- 中文分词之结巴分词~~~附使用场景+demo(net)

常用技能(更新ing):http://www.cnblogs.com/dunitian/p/4822808.html#skill 技能总纲(更新ing):http://www.cnblogs.com/ ...

- Python 结巴分词(1)分词

利用结巴分词来进行词频的统计,并输出到文件中. 结巴分词github地址:结巴分词 结巴分词的特点: 支持三种分词模式: 精确模式,试图将句子最精确地切开,适合文本分析: 全模式,把句子中所有的可以成 ...

- 结巴(jieba)中文分词及其应用实践

中文文本分类不像英文文本分类一样只需要将单词一个个分开就可以了,中文文本分类需要将文字组成的词语分出来构成一个个向量.所以,需要分词. 这里使用网上流行的开源分词工具结巴分词(jieba),它可以有效 ...

随机推荐

- virtualbox安装oracle linux后找不到eth0

用VirtualBox装oracle linux, ifconfig发现没有eth0: 按照以下步骤操作: 1 用ifconfig eth0 up启动网卡(默认未开启),执行ifconfig下看到et ...

- .NET Core 集成微信支付签名错误

.NET Core 集成微信支付签名错误 The provided data is tagged with 'Universal' class value '16', but it should ha ...

- 运行Study.Trade模块的Web.Unified.Host

1.把Web.Host的项目设置为启动项目 上一篇文章报错,因为npm功能没有安装,导致Web.Unified.Host的wwwroot下没有libs目录. 2.默认是在IIS Express中承载 ...

- 【Azure 环境】向Azure Key Vault中导入证书有输入密码,那么导出pfx证书的时候,为什么没有密码呢?

问题描述 将pfx证书导入Key Vault的证书时,这个PFX需要输入正确的密码导入成功.但是当需要导出时,生成的pfx证书则不需要密码.这是正常的情况吗? 问题解答 是的,这是Azure Key ...

- 【Azure 应用服务】添加自定义域时,Domain ownership 验证无法通过

问题描述 在Azure App Service添加自定义域名时,遇见了Domain ownership 验证无法通过的问题? 问题解决 因为DNS中配置App Service默认域名和自定义域名的CN ...

- 图数据库 NebulaGraph 的 Java 数据解析实践与指导

如何快速.即时.符合直觉地去处理 Nebula Java Client 中的数据解析?读这一篇就够了. 图数据库 NebulaGrpah 的论坛和微信群里,有不少用户问及了 Java 客户端数据解析的 ...

- C++ 模板的笔记1

C++模板的笔记1 C++ 函数模板 函数模板的定义 函数模板是一种可以生成不同类型函数的函数声明.函数模板的参数类型不是固定的,而是在调用时由实参类型推导出来. 语法: template <t ...

- FolkMQ 作个简单的消息中间件(最简单的那种), v1.3.1 发布

功能简介 角色 功能 生产端(或发起端) 发布消息.定时消息(或叫延时).顺序消息.可过期消息.事务消息.发送消息(rpc)支持 Qos0.Qos1 消费端(或接收端) 订阅.取消订阅.消费-ACK( ...

- Java 多线程------多线程的创建,方式一:继承于Thread类

1 package com.bytezero.thread; 2 3 /** 4 * 多线程的创建,方式一:继承于Thread类 5 * 1.创建一个继承于Thread类的子类 6 * 2.重写Thr ...

- KEIL5新建工程0810

在保存各种项目的文件夹内创建一个项目文件夹1新建工程到文件夹1 选择芯片添加工程的必要文件(固件库) STM32程序是从启动文件开始,复制这些文件到文件夹A的新建Start文件夹下 stm32f10x ...