Docker 搭建Spark 依赖singularities/spark:2.2镜像

singularities/spark:2.2版本中

Hadoop版本:2.8.2

Spark版本: 2.2.1

Scala版本:2.11.8

Java版本:1.8.0_151

拉取镜像:

[root@localhost docker-spark-2.1.]# docker pull singularities/spark

查看:

[root@localhost docker-spark-2.1.]# docker image ls

REPOSITORY TAG IMAGE ID CREATED SIZE

docker.io/singularities/spark latest 84222b254621 months ago 1.39 GB

创建docker-compose.yml文件

[root@localhost home]# mkdir singularitiesCR

[root@localhost home]# cd singularitiesCR

[root@localhost singularitiesCR]# touch docker-compose.yml

内容:

version: "" services:

master:

image: singularities/spark

command: start-spark master

hostname: master

ports:

- "6066:6066"

- "7070:7070"

- "8080:8080"

- "50070:50070"

worker:

image: singularities/spark

command: start-spark worker master

environment:

SPARK_WORKER_CORES:

SPARK_WORKER_MEMORY: 2g

links:

- master

执行docker-compose up即可启动一个单工作节点的standlone模式下运行的spark集群

[root@localhost singularitiesCR]# docker-compose up -d

Creating singularitiescr_master_1 ... done

Creating singularitiescr_worker_1 ... done

查看容器:

[root@localhost singularitiesCR]# docker-compose ps

Name Command State Ports

--------------------------------------------------------------------------------------------------------------------------------------------------------

singularitiescr_master_1 start-spark master Up /tcp, /tcp, /tcp, /tcp, /tcp, /tcp,

0.0.0.0:->/tcp, /tcp, /tcp, /tcp, /tcp,

0.0.0.0:->/tcp, 0.0.0.0:->/tcp, /tcp, /tcp,

0.0.0.0:->/tcp, /tcp, /tcp

singularitiescr_worker_1 start-spark worker master Up /tcp, /tcp, /tcp, /tcp, /tcp, /tcp, /tcp, /tcp,

/tcp, /tcp, /tcp, /tcp, /tcp, /tcp, /tcp, /tcp,

/tcp

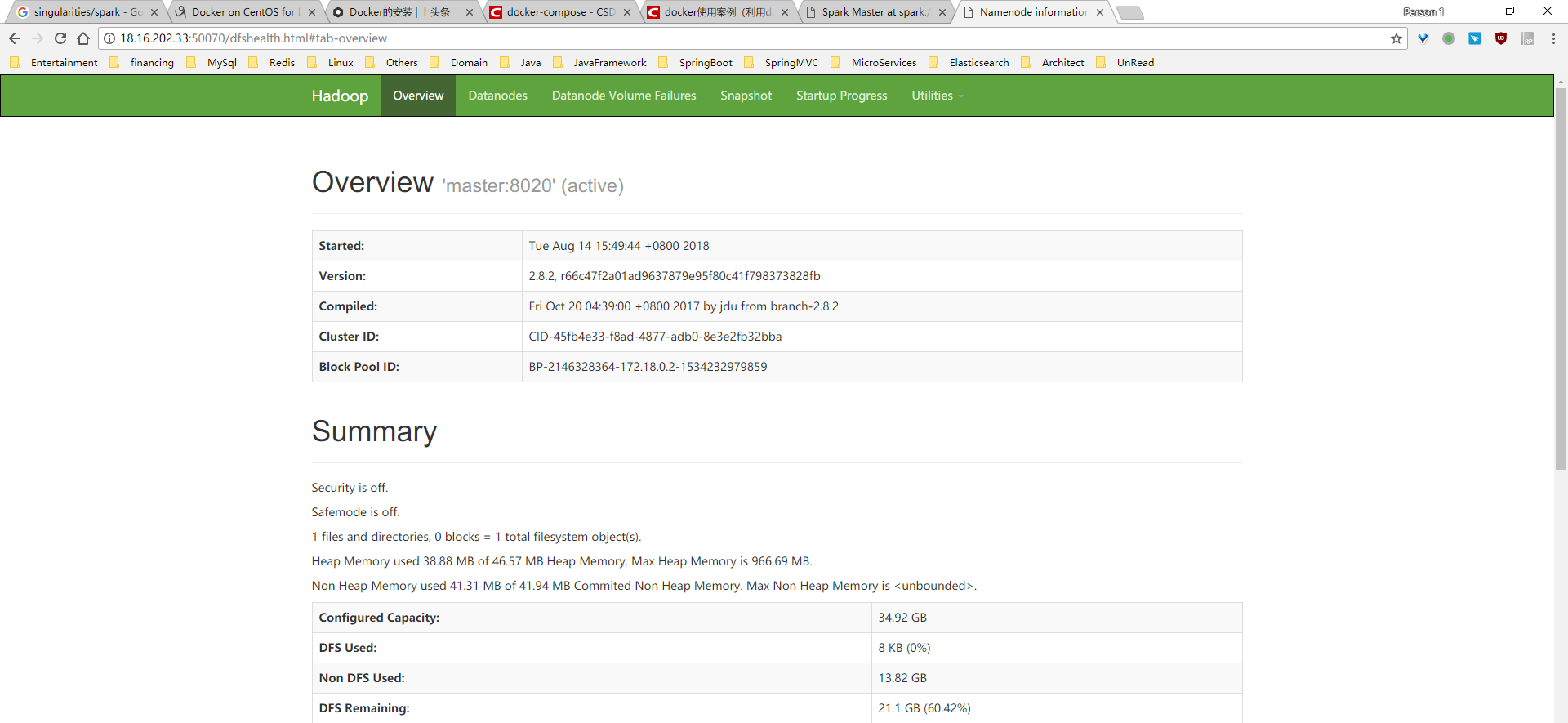

查看结果:

停止容器:

[root@localhost singularitiesCR]# docker-compose stop

Stopping singularitiescr_worker_1 ... done

Stopping singularitiescr_master_1 ... done

[root@localhost singularitiesCR]# docker-compose ps

Name Command State Ports

-----------------------------------------------------------------------

singularitiescr_master_1 start-spark master Exit

singularitiescr_worker_1 start-spark worker master Exit

删除容器:

[root@localhost singularitiesCR]# docker-compose rm

Going to remove singularitiescr_worker_1, singularitiescr_master_1

Are you sure? [yN] y

Removing singularitiescr_worker_1 ... done

Removing singularitiescr_master_1 ... done

[root@localhost singularitiesCR]# docker-compose ps

Name Command State Ports

------------------------------

进入master容器查看版本:

[root@localhost singularitiesCR]# docker exec -it /bin/bash

root@master:/# hadoop version

Hadoop 2.8.

Subversion https://git-wip-us.apache.org/repos/asf/hadoop.git -r 66c47f2a01ad9637879e95f80c41f798373828fb

Compiled by jdu on --19T20:39Z

Compiled with protoc 2.5.

From source with checksum dce55e5afe30c210816b39b631a53b1d

This command was run using /usr/local/hadoop-2.8./share/hadoop/common/hadoop-common-2.8..jar

root@master:/# which is hadoop

/usr/local/hadoop-2.8./bin/hadoop

root@master:/# spark-shell

Setting default log level to "WARN".

To adjust logging level use sc.setLogLevel(newLevel). For SparkR, use setLogLevel(newLevel).

// :: WARN util.NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable

Spark context Web UI available at http://172.18.0.2:4040

Spark context available as 'sc' (master = local[*], app id = local-).

Spark session available as 'spark'.

Welcome to

____ __

/ __/__ ___ _____/ /__

_\ \/ _ \/ _ `/ __/ '_/

/___/ .__/\_,_/_/ /_/\_\ version 2.2.

/_/ Using Scala version 2.11. (OpenJDK -Bit Server VM, Java 1.8.0_151)

Type in expressions to have them evaluated.

Type :help for more information.

参考:

https://github.com/SingularitiesCR/spark-docker

https://blog.csdn.net/u013705066/article/details/80030732

Docker 搭建Spark 依赖singularities/spark:2.2镜像的更多相关文章

- Docker 搭建Spark 依赖sequenceiq/spark:1.6镜像

使用Docker-Hub中Spark排行最高的sequenceiq/spark:1.6.0. 操作: 拉取镜像: [root@localhost home]# docker pull sequence ...

- docker搭建本地仓库并制作自己的镜像

原文地址https://blog.csdn.net/junmoxi/article/details/80004796 1. 搭建本地仓库1.1 下载仓库镜像1.2 启动仓库容器2. 在CentOS容器 ...

- 用Docker搭建RabbitMq的普通集群和镜像集群

普通集群:多个节点组成的普通集群,消息随机发送到其中一个节点的队列上,其他节点仅保留元数据,各个节点仅有相同的元数据,即队列结构.消费者消费消息时,会从各个节点拉取消息,如果保存消息的节点故障,则无法 ...

- 使用 docker 搭建 nginx+php-fpm 环境 (两个独立镜像)

:first-child{margin-top:0!important}.markdown-body>:last-child{margin-bottom:0!important}.markdow ...

- Mac下docker搭建lnmp环境 + redis + elasticsearch

之前在windows下一直使用vagrant做开发, 团队里面也是各种开发环境,几个人也没有统一环境,各种上线都是人肉,偶尔还会有因为开发.测试.生产环境由于软件版本或者配置不一致产生的问题, 今年准 ...

- docker搭建elasticsearch、kibana,并集成至spring boot

步骤如下: 一.基于docker搭建elasticsearch环境 1.拉取镜像 docker pull elasticsearch5.6.8 2.制作elasticsearch的配置文件 maste ...

- 使用Docker搭建Spark集群(用于实现网站流量实时分析模块)

上一篇使用Docker搭建了Hadoop的完全分布式:使用Docker搭建Hadoop集群(伪分布式与完全分布式),本次记录搭建spark集群,使用两者同时来实现之前一直未完成的项目:网站日志流量分析 ...

- Docker搭建大数据集群 Hadoop Spark HBase Hive Zookeeper Scala

Docker搭建大数据集群 给出一个完全分布式hadoop+spark集群搭建完整文档,从环境准备(包括机器名,ip映射步骤,ssh免密,Java等)开始,包括zookeeper,hadoop,hiv ...

- Spark认识&环境搭建&运行第一个Spark程序

摘要:Spark作为新一代大数据计算引擎,因为内存计算的特性,具有比hadoop更快的计算速度.这里总结下对Spark的认识.虚拟机Spark安装.Spark开发环境搭建及编写第一个scala程序.运 ...

随机推荐

- js单双引号

JavaScript单双引号的使用没有严格的要求,单独出现的时候,用单用双都可以的,但是如果一起出现的话就要严格区分了

- python socket编程笔记

用python实现一个简单的socket网络聊天通讯 (Linux --py2.7平台与windows--py3.6平台) 人生苦短之我用Python篇(socket编程) python之路 sock ...

- 数据分析之Numpy库入门

1.列表与数组 在python的基础语言部分,我们并没有介绍数组类型,但是像C.Java等语言都是有数组类型的,那python中的列表和数组有何区别呢? 一维数据:都表示一组数据的有序结构 区别: 列 ...

- jdk自动安装java_home 无法修改解决方法

使用命令行修改 cmd下set java_home=D:\soft\java\jdk1.7.0_72 搞定

- STL算法中函数对象和谓词

函数对象和谓词定义 函数对象: 重载函数调用操作符的类,其对象常称为函数对象(function object),即它们是行为类似函数的对象.一个类对象,表现出一个函数的特征,就是通过“对象名+(参数列 ...

- Java基础语法(一 )

一.关键字 关键字概述 被Java语言赋予特定含义的单词 关键字特点 组成关键字的字母全部小写 关键字注意事项 goto和const作为保留字存在,目前并不使用 关键字单词 用于定义数据类型的关键字 ...

- mac下编译cpu only caffe并用xCode建caffe工程

mac编译caffe 好像又变容易了,直接git clone下载blvc源码,make.config里去掉了CPU_ONLY前面的注释,并没有安装任何依赖,也可能是自己mac上本来有, xCode里调 ...

- requests 学习笔记

除了get 方式外 还有post 等等 注意字典里值为 None 的键都不会被添加到 URL 的查询字符串里 import requests getpara = {"key1":& ...

- Struts2输入校验(编码方式)

struts2对用户输入数据的校验方法有两种方式,一种是通过编码的方式,另一种则是通过使用XML配置方式. 本章主要介绍struts2编码方式的输入校验.以下将结合一个实例程序进行说明. 代码结构: ...

- nginx实现MySQL负载均衡

默认Nginx只支持http的反向代理,要想nginx支持tcp的反向代理,还需要在编译时增加tcp代理模块支持,即nginx_tcp_proxy_module 下面操作步骤只让nginx支持tcp_ ...