hdfs文件导入到hive(带资源)

前言

hive是基于Hadoop的一个数据仓库工具,用来进行数据提取、转化、加载,这是一种可以存储、查询和分析存储在Hadoop中的大规模数据的机制。hive数据仓库工具能将结构化的数据文件映射为一张数据库表,并提供SQL查询功能,能将SQL语句转变成MapReduce任务来执行,下面来介绍如何将结构化文档数据导入hive。

一、安装Hive

1.1 官网下载或到本章最后地址下载hive 安装包

/opt/software 下新建hive 目录 并将安装包解压至此

tar -xzvf /opt/software/apache-hive-3.1.2-bin.tar.gz -C /opt/software/hive

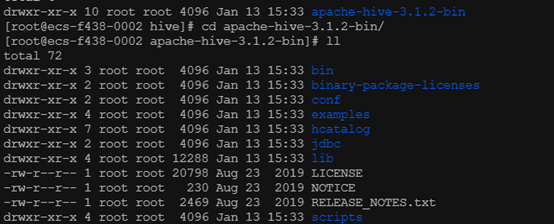

解压后的 hive 目录结构如下

1.2 添加环境变量

vim /etc/profile

文件末尾加上下面两行 分别为hive安装路径和引用

export HIVE_HOME=/usr/local/hive/apache-hive-3.1.2-bin

export PATH=$PATH:$HIVE_HOME/bin

使文件立即生效

source /etc/profile

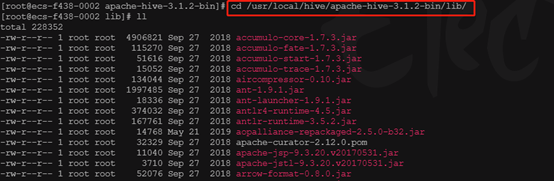

1.3 进入hive 的jar包目录lib文件夹下

cd /usr/local/hive/apache-hive-3.1.2-bin/lib/

1.3.1 解决 log4j jar 包冲突

mv log4j-slf4j-impl-2.10.0.jar log4j-slf4j-impl-2.10.0.jar.bak

1.3.2 hive de guava-xx.jar 的guava-xx.jar 和hadoop的guava-xx.jar 包冲突,需要同步高版本jar,并删除低版本jar(两个jar包分别在/opt/hive/lib/ 以及 /opt/hadoop/share/hadoop/common/lib/)

1.3.3 添加mysql 驱动到hive 的 lib下(略)

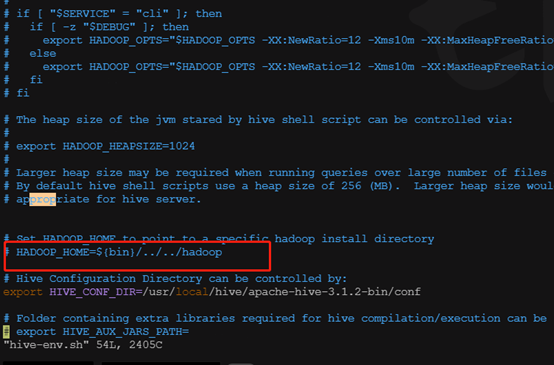

1.4 修改配置文件

进入到hive安装目录conf下执行

mv hive-env.sh.template hive-env.sh

1.4.1 编辑hive-env.sh 配置hive_home

这里注意,如果hadoop和hive 不是安装在同一台机器上,会报错找不到hadoop_home,网上暂时没有找到好方案,暂时只能装在一起,所以这里不用配置

1.4.2 conf文件夹下配置hive-site.xml (如果无该文件,请自行创建 touch hive-site.xml)

<configuration>

<property>

<name>hive.server2.active.passive.ha.enable</name>

<value>true</value>

</property>

<!-- hive的相关HDFS存储路径配置 -->

<property>

<name>hive.exec.scratchdir</name>

<value>/tmp/hive</value>

</property>

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/user/hive/warehouse</value>

</property> <property>

<name>hive.metastore.schema.verification</name>

<value>false</value>

</property>

<property>

<name>hive.querylog.location</name>

<value>/user/hive/log</value>

</property>

<!-- 以下是mysql相关配置 地址端口自行更改 -->

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://ip:port/testhive?createDatabaseIfNotExist=true&characterEncoding=UTF-8&useSSL=false</value>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>userName</value>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>PASSWORD</value>

</property>

<!-- hive UI地址,不配置的话,默认只会在本机可以访问 -->

<property>

<name>hive.server2.thrift.bind.host</name>

<value>0.0.0.0</value>

</property>

</configuration>

1.5 后台启动hiveserver

nohup $HIVE_HOME/bin/hiveserver2 &

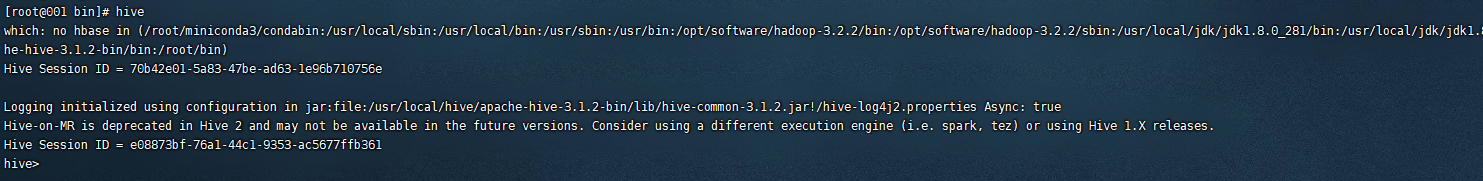

1.6 启动hive 自带client

bin/hive

进入hive 客户端

1.7 执行sql测试

hive> create table emp(

> id int,

> name string);

hive> insert into emp values(1,"lisi"); hive> select * from emp;

OK

1 lisi

Time taken: 0.395 seconds, Fetched: 1 row(s)

正常!

二 、 将hdfs中的文件导入hive

2.1 新建emp表,指定以空格切分字段,以换行切分数据条数

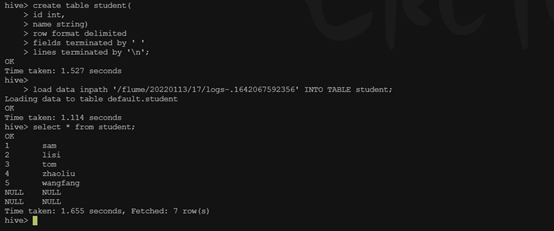

hive> create table student(

> id int,

> name string)

> row format delimited

> fields terminated by ' '

> lines terminated by '\n';

2.2 准备要导入的文件

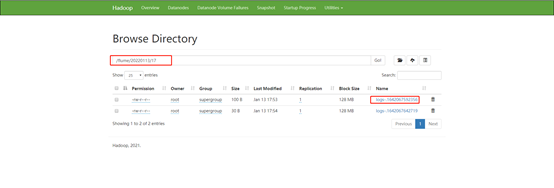

先找到hdfs文件路径

可以在Hadoop(Utilities-Browse the file system)上看到本次要导入的文件路径为 /flume/20220113/13/logs-.1642052912087

2.3 执行导入命令

hive> load data inpath '/flume/20220113/13/logs-.1642052912087' INTO TABLE emp;

Loading data to table default.emp

OK

执行查询emp语句,可以看到数据以成功导入

下面为hdfs 源文件(test.log)

1 sam

2 lisi

3 tom

4 zhaoliu

5 wangfang

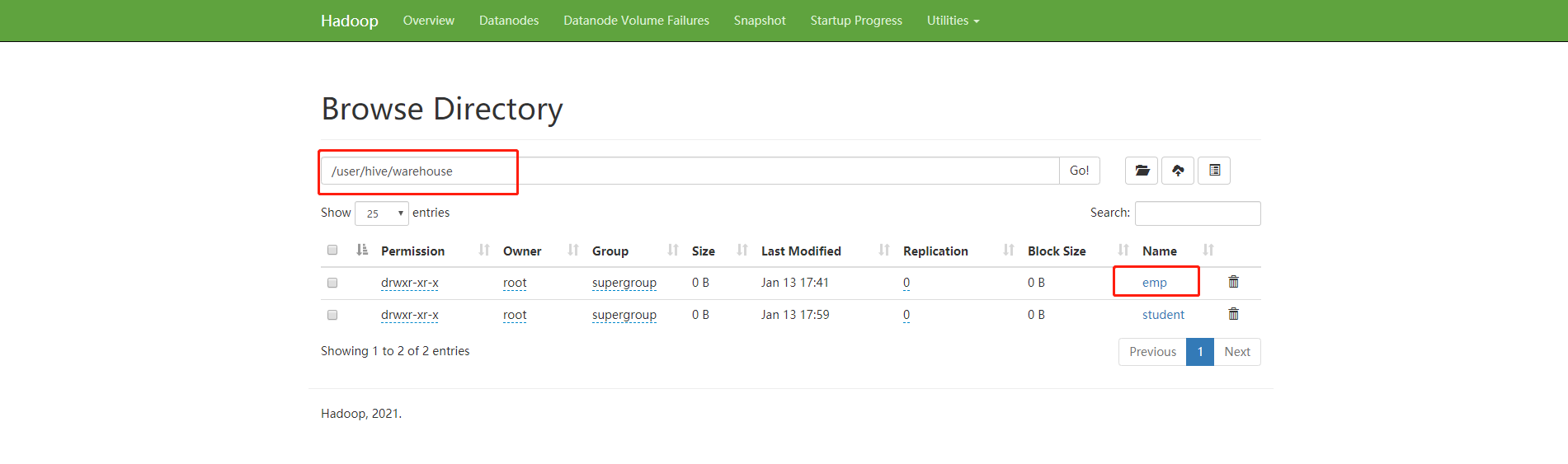

到hadoop 控制台可以看到hive 的表文件

结束!

hive 安装包下载地址

链接:https://pan.baidu.com/s/1CIBq7V6m4yH7TYmI0tacRQ

提取码:6666

hdfs文件导入到hive(带资源)的更多相关文章

- [Spark][Hive]外部文件导入到Hive的例子

外部文件导入到Hive的例子: [training@localhost ~]$ cd ~[training@localhost ~]$ pwd/home/training[training@local ...

- 将CSV格式或者EXCEL格式的文件导入到HIVE数据仓库中

学习内容:数据导入,要求将CSV格式或者EXCEL格式的文件导入到HIVE数据仓库中: ①hive建表:test1 create table test1 (InvoiceNo String, Stoc ...

- 将CSV文件导入到hive数据库

将csv文件导入hive后出现了所有的字段只显示在新建的表的第一个字段中,后面的字段全是null. 出现这种的原因是hive以行分隔数据,需要修改为按逗号' , ‘ 进行分隔读取, 具体操作如下, ...

- Talend 将Oracle中数据导入到hive中,根据系统时间设置hive分区字段

首先,概览下任务图: 流程是,先用tHDFSDelete将hdfs上的文件删除掉,然后将oracle中的机构表中的数据导入到HDFS中:建立hive连接->hive建表->tJava获取系 ...

- 11.把文本文件的数据导入到Hive表中

先在hive里面创建一个表 create table mydb2.t3(id int,name string,age int) row format delimited fields terminat ...

- sqoop命令,mysql导入到hdfs、hbase、hive

1.测试MySQL连接 bin/sqoop list-databases --connect jdbc:mysql://192.168.1.187:3306/trade_dev --username ...

- 第3节 sqoop:4、sqoop的数据导入之导入数据到hdfs和导入数据到hive表

注意: (1)\001 是hive当中默认使用的分隔符,这个玩意儿是一个asc 码值,键盘上面打不出来 (2)linux中一行写不下,可以末尾加上 一些空格和 “ \ ”,换行继续写余下的命令: bi ...

- 如何快速把hdfs数据动态导入到hive表

1. hdfs 文件 {"retCode":1,"retMsg":"Success","data":[{" ...

- HDFS文件和HIVE表的一些操作

1. hadoop fs -ls 可以查看HDFS文件 后面不加目录参数的话,默认当前用户的目录./user/当前用户 $ hadoop fs -ls 16/05/19 10:40:10 WARN ...

随机推荐

- 【Azure Redis 缓存】Azure Cache for Redis 中如何快速查看慢指令情况(Slowlogs)

问题描述 当 Azure Redis 服务器负载过高的情况下,使用时就会遇见连接超时,命令超时,IO Socket超时等异常.为了能定位是那些因素引起的,可以参考微软官方文档( 管理 Azure Ca ...

- CF424A Squats 题解

Content 给定一个长度为 \(n\) 的仅由 x 和 X 组成的字符串,求使得字符串中 x 和 X 的数量相等需要修改的次数,并输出修改后的字符串. 数据范围:\(2\leqslant n\le ...

- CF1059A Cashier 题解

Content 定义一天长度为 \(L\),每次休息的时间为 \(a\).一天会有 \(n\) 个客人到访,第 \(i\) 个客人会在 \(t_i\) 的时刻到访,会停留 \(l_i\) 的时间.只有 ...

- Windows 11实现录屏直播,搭建Nginx的rtmp服务

先!下载几个工具呗 官方下载FFmpeg:http://www.ffmpeg.org 官方下载nginx-rtmp-module:https://github.com/arut/nginx-rtmp- ...

- go实现pdf电子签名-自动识别签名位置

一. 技术选型 由于要识别签名位置,所以得要能解析pdf的文本布局,要能得到每个布局元素的文本位置坐标.而最终的签名需要合成到pdf上,所以还需要有编辑pdf的需求. pdf布局分析:pdfminer ...

- JAVA简单整合protoc文件

引入maven <dependency> <groupId>com.google.protobuf</groupId> <artifactId>prot ...

- JAVA使用反射获取对象的所有属性名

public static void main(String[] args) { Field[] fields=BaseSalary.class.getDeclaredFields(); for (i ...

- Guava Retryer实现接口重试

前言 小黑在开发中遇到个问题,我负责的模块需要调用某个三方服务接口查询信息,查询结果直接影响后续业务逻辑的处理: 这个接口偶尔会因网络问题出现超时,导致我的业务逻辑无法继续处理: 这个问题该如何解决呢 ...

- Go语言核心36讲(新年彩蛋)--学习笔记

新年彩蛋 | 完整版思考题答案 基础概念篇 Go 语言在多个工作区中查找依赖包的时候是以怎样的顺序进行的? 答:你设置的环境变量GOPATH的值决定了这个顺序.如果你在GOPATH中设置了多个工作区, ...

- 项目启动报错怎么办?看看你Spring自动注入用对了嘛?@Autowired XxxService注入问题解决

问题 在Controller层使用 @Autowired注入Service时,提示Bean中没有Service 在Service接口中使用 @Component注入后,启动项目问题提示: The we ...