CNN(卷积神经网络)原理讲解及简单代码

一、原理讲解

1. 卷积神经网络的应用

- 分类(分类预测)

- 检索(检索出该物体的类别)

- 检测(检测出图像中的物体,并标注)

- 分割(将图像分割出来)

- 人脸识别

- 图像生成(生成不同状态的图像)

- 自动驾驶

- 等等。。。

2. 传统神经网络与卷积神经网络比较

传统神经网络采用的是全连接神经网络,权重矩阵的参数太多,导致速度减慢,也会产生过拟合。

卷积神经网络通过卷积核,大大降低了参数个数。实现局部关联,参数共享的效果。

3. 卷积神经网络基本结构

- 卷积层

- 激活层(ReLu)

- 池化层

- 全连接层

3.1 卷积层(Convolutional Layer)

卷积是对两个实变函数的一种数学操作,也就是求内积。

在图像处理中,图像是以二维矩阵的形式输入到神经网络的,因此我们需要二维卷积。

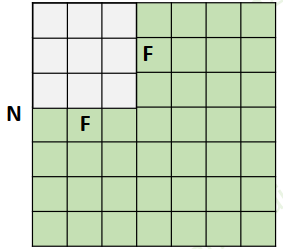

图3-1

图3-2

图3-3

图3-1、图3-2、图3-3很好地展示了卷积过程,名称注释如下:

input:输入层,即图像的矩阵向量

kernel:卷积核或称滤波器,可以定义卷积核的大小,图3-1中卷积核的大小为2*2

output:输出,即特征图feature map,通过卷积计算出来的结果。计算公式为input(图3-1中为4*3)•kernel(图3-1中为2*2),两个向量求内积。

stride:步长,即卷积核向右滑动的长度。图3-1中步长为1。

padding:填充,当卷积时,卷积核滑动到最右侧发现无法形成与自己单元一致的向量时,需要在四周用0填充,确保卷积核能完成计算过程。如图3-4所示。

depth/channel:深度,即当前卷积层中卷积核的个数。如图3-4为2层。

图3-4

卷积是从输入图像中提取特征的第一层,Conv层的目标是提取输入数据的特征。 卷积通过使用小方块输入数据学习图像特征来保持像素之间的关系。

输出的特征图(feature map)大小:

图3-5

未加padding时:

(N-F)/stride + 1

加padding时:

(N-F+padding*2)/stride + 1

例子:

input:32*32

filter:10, 5*5

stride:1

padding:2

输出:? (32-5+2*2)/1+1=32 ,即 32*32*10

参数:? (5*5+1)*10

代码实现:

# 定义卷积核,10个卷积核,卷积核大小是5,用Relu激活

conv0 = tf.layers.conv2d(datas, 10, 5, activation=tf.nn.relu)

3.2 池化层(Pooling Layer)

特征:

保留了主要特征的同事减少参数和计算量,防止过拟合,提高模型泛化能力。

它一般处在卷积层和卷积层之间,全连接层和全连接层之间。

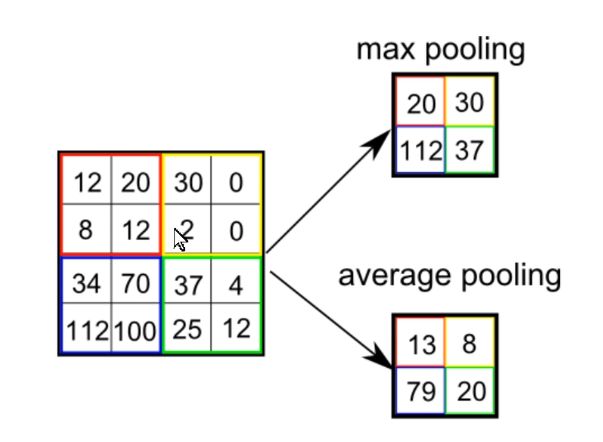

类型划分:

max pooling:最大化池化,如图3-6和图3-7所示

average pooling:平均池化,如图3-7所示

图3-6

图3-7

3.3 全连接层(Fully Connected Layer)

- 两层之间所有神经元都有权重连接

- 通常全连接才呢过在卷积神经网络尾部

- 全连接层参数量通常最大

二、代码实战

# 定义卷积层, 20个卷积核,卷积核大小为5, 用Relu激活

conv0 = tf.layers.conv2d(datas, 20, 5, activation=tf.nn.relu)

# 定义max-pooling层,pooling窗口为2*2,步长为2*2

pool0 = tf.layers.max_pooling2d(conv0, [2, 2], [2, 2]) # 定义卷积层,40个卷积核,卷积核大小为4, 用Relu激活

conv1 = tf.layers.conv2d(pool0, 40, 4, activation=tf.nn.relu)

# 定义max-pooling层,pooling窗口为2*2,步长为2*2

pool1 = rf.layers.max_pooling2d(conv1, [2, 2], [2, 2]) # 将3维特征装换为1维向量

flatten = tf.layers.flatten(pool1) # 全连接层,转换为长度为400的特征向量

fc = tf.layers.dense(flatten, 400, activation=tf.nn.relu) # 加上DropOut,防止过拟合

dropput_fc = tf.layers.dropout(fc, dropout_placeholdr) # 未激活的输出层

# num_classes:分类数

logits = tf.layers.dense(dropout_fc, num_classes) predicted_labels = tf.arg_max(ligits, 1)

CNN(卷积神经网络)原理讲解及简单代码的更多相关文章

- cnn(卷积神经网络)比较系统的讲解

本文整理了网上几位大牛的博客,详细地讲解了CNN的基础结构与核心思想,欢迎交流. [1]Deep learning简介 [2]Deep Learning训练过程 [3]Deep Learning模型之 ...

- Keras(四)CNN 卷积神经网络 RNN 循环神经网络 原理及实例

CNN 卷积神经网络 卷积 池化 https://www.cnblogs.com/peng8098/p/nlp_16.html 中有介绍 以数据集MNIST构建一个卷积神经网路 from keras. ...

- tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图

tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图 因为很多 demo 都比较复杂,专门抽出这两个函数,写的 demo. 更多教程:http://www.tensorflown ...

- Deep Learning模型之:CNN卷积神经网络(一)深度解析CNN

http://m.blog.csdn.net/blog/wu010555688/24487301 本文整理了网上几位大牛的博客,详细地讲解了CNN的基础结构与核心思想,欢迎交流. [1]Deep le ...

- [转]Theano下用CNN(卷积神经网络)做车牌中文字符OCR

Theano下用CNN(卷积神经网络)做车牌中文字符OCR 原文地址:http://m.blog.csdn.net/article/details?id=50989742 之前时间一直在看 Micha ...

- Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现(转)

Deep Learning论文笔记之(四)CNN卷积神经网络推导和实现 zouxy09@qq.com http://blog.csdn.net/zouxy09 自己平时看了一些论文, ...

- TensorFlow——CNN卷积神经网络处理Mnist数据集

CNN卷积神经网络处理Mnist数据集 CNN模型结构: 输入层:Mnist数据集(28*28) 第一层卷积:感受视野5*5,步长为1,卷积核:32个 第一层池化:池化视野2*2,步长为2 第二层卷积 ...

- 3层-CNN卷积神经网络预测MNIST数字

3层-CNN卷积神经网络预测MNIST数字 本文创建一个简单的三层卷积网络来预测 MNIST 数字.这个深层网络由两个带有 ReLU 和 maxpool 的卷积层以及两个全连接层组成. MNIST 由 ...

- CNN(卷积神经网络)、RNN(循环神经网络)、DNN(深度神经网络)的内部网络结构有什么区别?

https://www.zhihu.com/question/34681168 CNN(卷积神经网络).RNN(循环神经网络).DNN(深度神经网络)的内部网络结构有什么区别?修改 CNN(卷积神经网 ...

随机推荐

- 线段树优化建图 || CF786B Legacy

题面:786B - Legacy 代码: #include<cstdio> #include<cstring> #include<iostream> #includ ...

- Java内部类的整理。

Java 内部类 分四种:成员内部类.局部内部类.静态内部类和匿名内部类. 成员内部类: (1)即作为外部类的一个成员存在,与外部类的属性.方法并列. 注意:成员内部类中不能定义静态变量,但可以访问外 ...

- 如何在通过脚手架create-react-app 创建的react项目中配置 less

首先感慨下 自己竟然有半年没登账户 ,干嘛去啦? 从刚接触vue 接手做两次版本之后 又让我这个小菜鸡 开始开发react项目,连react生命周期还没搞明白的时候 就开始进行第一版本的开发了,第一个 ...

- C#文件压缩成.Zip

使用的三方类库ICSharpCode.SharpZipLib.dll 方法如下: /// <summary> /// 压缩文件为zip格式 /// </summary> /// ...

- Java基本的程序结构设计 控制流程

控制流程 java的控制流程和C和C++基本一致,只是不能使用goto语句,不过break语句可以带标签,实现从内层循环跳出的目的.标签可以放在for或者while前面.如下: package com ...

- 基于注解的IOC配置

1 明确 注解配置和XML配置要实现的功能都是一样的,都是要降低程序间的耦合.只是配置的形式不一样. 关于实际的开发中到底是使用XML还是注解,每家公司有着不同的习惯.具体问题具体分析. 2 环境搭建 ...

- ZROI 19.08.12模拟赛

传送门 写在前面:为了保护正睿题目版权,这里不放题面,只写题解. "我发现问题的根源是大家都不会前缀和."--敦爷 A 敦爷spj写错了,差点把蒟蒻swk送走 \(50pts:\) ...

- 机器学习降维--PCA

1.原理和概念 PCA(Principal Component Analysis),即主成分分析方法,是一种使用最广泛的数据降维算法. PCA的主要思想是将n维特征映射到k维上,这k维是全新的正交特征 ...

- java——>> 和>>>

试一下 public static void main(String[] args) { System.out.println(Integer.toBinaryString(-16)); System ...

- 什么是工作流java Activity

见:http://www.it165.net/pro/html/201504/37443.html 一. 什么是工作流 以请假为例,现在大多数公司的请假流程是这样的 员工打电话(或网聊)向上级提出请假 ...