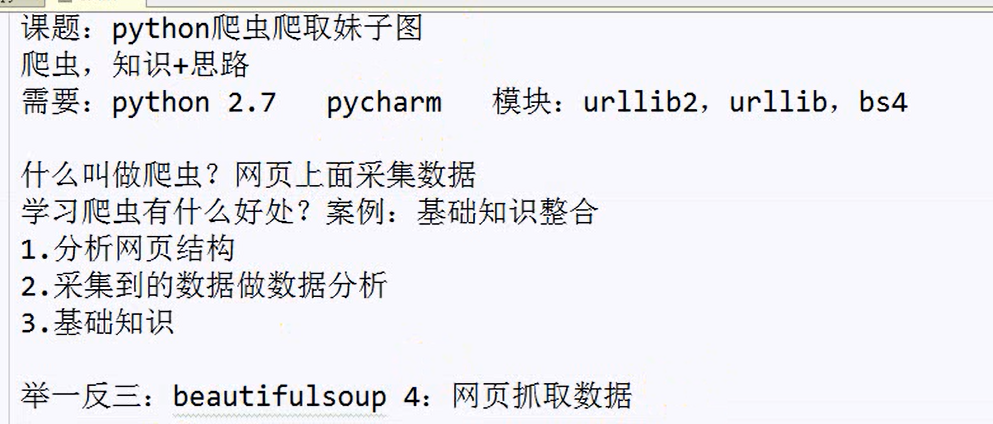

【Python项目篇】【爬妹子图】

#-*- coding:utf-8 -*-

import urllib

import urllib2

from bs4 import beautifulsoup4 #获取标签下的内容

#打开网页,获取源码

x=0

url='http://www.dbmeinv.com/?pager_offset=1'

def crawl(url): #取名字,最好见名思义

headers={'User-Agent':'Mozilla/5.0 (Windows NT 6.1; Win64; x64; rv:57.0) Gecko/20100101 Firefox/57.0'}

req=urllib2.Request(url,headers=headers) #浏览器帽子

page=urllib2.urlopen(req,timeout=20) #打开网页

contents=page.read()#获取源码

#print contents

#html.parser是自带的解析方式,lxml功能大

soup=BeautifulSoup(contents,'html.parser')#创建一个soup对象

my_girl=soup.find_all('img')#找到所有的标签

print(my_girl)

for girl in my_girl:#遍历list,选取属性

link=girl.get('src')#获取src图片路径

print(link)

#下载的文件,取名字

global x

urllib.urlretrieve(link,'image\%s.jpg'%x)

x+=1

print crawl(url)

以上代码在3.5环境下运行一下代码可以成功爬到各图片链接

#-*- coding:utf-8 -*-

import urllib.request

from bs4 import BeautifulSoup #获取标签下的内容

#打开网页,获取源码 x = 0

url = 'http://www.dbmeinv.com/?pager_offset=1'

def crawl(url):

print('')

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64; rv:57.0) Gecko/20100101 Firefox/57.0'}

print('')

req = urllib.request.Request(url, headers=headers)

page = urllib.request.urlopen(req)

#req = urllib3.request(url, headers=headers) #浏览器帽子

print('')

#page = urllib3.urlopen(req, timeout=20) #打开网页

contents = page.read()#获取源码

soup = BeautifulSoup(contents,'html.parser')#创建一个soup对象

my_girl = soup.find_all('img')#找到所有的标签

print(my_girl)

for girl in my_girl:

link = girl.get('src')

print(link)

print('')

print('')

crawl(url)

【Python项目篇】【爬妹子图】的更多相关文章

- python3 爬 妹子图

Beautiful Soup 是一个可以从HTML或XML文件中提取数据的Python库.它能够通过你喜欢的转换器实现惯用的文档导航,查找,修改文档的方式 Beautiful Soup 4 通过PyP ...

- 【Python项目】爬取新浪微博个人用户信息页

微博用户信息爬虫 项目链接:https://github.com/RealIvyWong/WeiboCrawler/tree/master/WeiboUserInfoCrawler 1 实现功能 这个 ...

- 【Python项目】爬取新浪微博签到页

基于微博签到页的微博爬虫 项目链接:https://github.com/RealIvyWong/WeiboCrawler/tree/master/WeiboLocationCrawler 1 实现功 ...

- python爬虫之一---------豆瓣妹子图

#-*- coding:utf-8 -*- __author__ = "carry" import urllib import urllib2 from bs4 import Be ...

- 老王Python培训视频教程(价值500元)【基础进阶项目篇 – 完整版】

老王Python培训视频教程(价值500元)[基础进阶项目篇 – 完整版] 教学大纲python基础篇1-25课时1.虚拟机安装ubuntu开发环境,第一个程序:hello python! (配置开发 ...

- 「玩转Python」突破封锁继续爬取百万妹子图

前言 从零学 Python 案例,自从提交第一个妹子图版本引来了不少小伙伴的兴趣.最近,很多小伙伴发来私信说,妹子图不能爬了!? 趁着周末试了一把,果然爬不动了,爬下来的都是些 0kb 的假图片,然后 ...

- Python使用Scrapy爬虫框架全站爬取图片并保存本地(妹子图)

大家可以在Github上clone全部源码. Github:https://github.com/williamzxl/Scrapy_CrawlMeiziTu Scrapy官方文档:http://sc ...

- Python 爬虫入门(二)——爬取妹子图

Python 爬虫入门 听说你写代码没动力?本文就给你动力,爬取妹子图.如果这也没动力那就没救了. GitHub 地址: https://github.com/injetlee/Python/blob ...

- Python 爬虫入门之爬取妹子图

Python 爬虫入门之爬取妹子图 来源:李英杰 链接: https://segmentfault.com/a/1190000015798452 听说你写代码没动力?本文就给你动力,爬取妹子图.如果 ...

随机推荐

- vc 找到一个或多个多重定义的符号

vc 找到一个或多个多重定义的符号, 这个问题还是不能很好的解决. 最根本的是: 把所有有关定义的部分都放在.cpp文件中,对应的.h文件中只放声明.这样在#include ""的 ...

- hbase集群部分节点HRegionServer启动后自动关闭的问题

参考链接 http://f.dataguru.cn/thread-209058-1-1.html 我有4HRegionServer节点,1个master,其中3个是unbuntu 系统,2个节点是ce ...

- 怎样批量修改MathType公式格式

MathType是一款数学公式编辑器,我们在写论文的时候常常会遇到,但是有时由于公式的样式.大小和间隔等不符合论文要求,这个时候我们如果一个个修改是很麻烦的,还容易出错.所以批量修改就非常的有必要了, ...

- spring+ehcache实战--性能优化之道

在做系统集成平台项目的时候遇到了一个比較麻烦的问题.原因是使用考试系统的时候所依赖的是基础系统公布的webservice来获取基础数据,webservice的跨网络传输本身或多或少会对系统性能产生一定 ...

- Java精选笔记_面向对象(包、访问控制、内存机制、垃圾回收机制)

包 包的定义与使用 专门用来存放类的,通常功能相同的类存放在相同的包中. 包的声明只能位于Java源文件的第一行 Java语言中的常用包 java.lang:包含Java语言的核心类,如String. ...

- POJ 1691 Painting a Board(状态压缩DP)

Description The CE digital company has built an Automatic Painting Machine (APM) to paint a flat boa ...

- shell基础(八)-循环语句

国庆过后:感觉有点慵懒些了:接着上篇:我们继续来学习循环语句. 一. for循环 与其他编程语言类似,Shell支持for循环. for循环一般格式为: for 变量 in 列表 do command ...

- docker学习-docker安装

win10之外的系统:https://www.docker.com/products/docker-toolbox win10系统: https://www.docker.com/pro ...

- Nginx 0.8.x + PHP 5.2.13(FastCGI)搭建胜过Apache十倍的Web服务器[摘抄]

[文章作者:张宴 本文版本:v6.3 最后修改:2010.07.26 转载请注明原文链接:http://blog.s135.com/nginx_php_v6/] 前言:本文是我撰写的关于搭建“Ngin ...

- 理解Scroller

任何一个控件都是可以滚动的,因为在View类当中有scrollTo()和scrollBy()这两个方法,但使用这两个方法完成的滚动效果是跳跃式的,没有任何平滑滚动的效果.而Scroller正是实现平滑 ...