MapReduce实现倒排索引(类似协同过滤)

一、问题背景

倒排索引其实就是出现次数越多,那么权重越大,不过我国有凤巢....zf为啥不管,总局回应推广是不是广告有争议...

eclipse里ctrl+t找接口或者抽象类的实现类,看看都有啥方法,有时候hadoop的抽象类返回的接口没有需要的方法,那么我们返回他的实现类。

吧需要的文件放入hdfs下的目录下,只要不是以下划线开头的均算。

二、理论准备

搜索引擎查询的时候就是查询这个单词文档矩阵,旺旺采用倒排索引存储,后缀树也可以。

不管理论直接看例子,这是原始的文档

下面是简单的索引,只是表征是否在文档中出现过。

下面就是文档及出现次数。

擦,咋有点想协同过滤。

三、思路分析

其实是一个全文检索的数据结构。理论上关键字出现次数越多,那么文章就越靠前。

就是wc的加强版本。wc是统计单词在文章里出现的次数,倒排是统计关键字在各个文章出现的次数。

有时候不能一下子写出来,可能需要多次mr,那么我们首先确定最终的结果形式,然后向上反推。

如果多个mr,考虑使用combiner,不过要考虑combiner是不是可插拔的,也就是combiner和业务逻辑是否和reducer一样。

怎么知道单词出现在那个文章里?从context对象里获取。既然能忘context写东西,那么也能从其中获取信息。

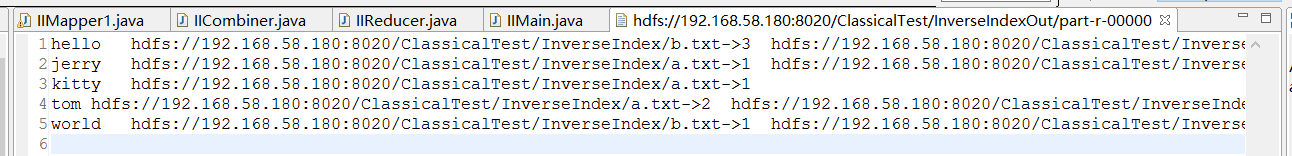

最终结果是

hello "a.txt->5 b.txt->3"

tom "a.txt->2 b.txt->1"

kitty "a.txt->1"

那么reduce的输出

context.write("hello","a.txt->5 b.txt->3");

那么combiner阶段是

<"hello",{"a.txt->5","b.txt->3"}>

那么map的输出

context.write("hello","a.txt->5");

context.write("hello","b.txt->3");

不过考虑到wc,map的输出应该是,路径放在value不好处理,还要廉价呢。

context.write("hello->a.txt",1);

context.write("hello->a.txt",1);

context.write("hello->a.txt",1);

context.write("hello->a.txt",1);

context.write("hello->a.txt",1);

context.write("hello->b.txt",1);

context.write("hello->b.txt",1);

context.write("hello->b.txt",1);

那么combiner阶段根据就输出

<"hello->a.txt",1>

<"hello->a.txt",1>

<"hello->a.txt",1>

<"hello->a.txt",1>

<"hello->a.txt",1> <"hello->b.txt",1>

<"hello->b.txt",1>

<"hello->b.txt",1> context.write("hello","a.txt->5");

context.write("hello","b.txt->3");

次是不同文件的相同key并没有合并,reducer合并输出皆可。

四、代码实现

4.1 Mapper

public class IIMapper1 extends Mapper<LongWritable, Text, Text, Text> {

private Text k = new Text();

//下面其实是int,不过也可以在接收端Integer.parseInt转了就好

private Text v = new Text();

public void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

String line = value.toString();

String[] words = line.split(" ");

//从context对象里找到单词属于那个文章

//context.getInputSplit();找到切片 按ctrl找 发现返回时InputSplit

//不过是个抽象类 ctrl + t找他的实现类

//能把数据写入context,繁殖也能从context拿到很多信息

//从下面inputSplit调用get的时候发现没有合适的方法,那么我们找他的实现类,调用实现类的方法

//InputSplit inputSplit = context.getInputSplit();

//inputSplit.get

//他的子类很多 我们处理文件就用File开头的 然后有个getPath

FileSplit inputSplit = (FileSplit)context.getInputSplit();

//文件名是hdfs://hostname:port/a/1.txt

//我们戒掉hdfs://hostname:port 不能戒掉a 应为这是文件夹否则不知道1.txt来自哪 其他文件家下可能也有同名文件

//也可以不接去

String path = inputSplit.getPath().toString();

for(String w:words) {

k.set(w+"->"+path);

v.set("1");

context.write(k, v);

}

}

}

4.2 Combiner

String[] wordAndPath = key.toString().split("->");

String word = wordAndPath[0];

String path = wordAndPath[1];

// process values

int sum = 0;

for (Text val : value) {

sum += Integer.parseInt(val.toString());

}

k.set(word);

v.set(path+"->"+sum);

context.write(k, v);

4.3 Reducer

//不涉及多线程 用StringBuilde即可

StringBuilder sb = new StringBuilder();

// process values

for (Text val : value) {

sb.append(val.toString()).append("\t");

}

context.write(key, new Text(sb.toString()));

四、实验分析

MapReduce实现倒排索引(类似协同过滤)的更多相关文章

- 基于物品的协同过滤ItemCF的mapreduce实现

文章的UML图比较好看..... 原文链接:www.cnblogs.com/anny-1980/articles/3519555.html 基于物品的协同过滤ItemCF 数据集字段: 1. Use ...

- 基于MapReduce的(用户、物品、内容)的协同过滤推荐算法

1.基于用户的协同过滤推荐算法 利用相似度矩阵*评分矩阵得到推荐列表 已经推荐过的置零 2.基于物品的协同过滤推荐算法 3.基于内容的推荐 算法思想:给用户推荐和他们之前喜欢的物品在内容上相似的物品 ...

- 基于协同过滤的个性化Web推荐

下面这是论文笔记,其实主要是摘抄,这片博士论文很有逻辑性,层层深入,所以笔者保留的比较多. 看到第二章,我发现其实这片文章对我来说更多是科普,科普吧…… 一.论文来源 Personalized Web ...

- SimRank协同过滤推荐算法

在协同过滤推荐算法总结中,我们讲到了用图模型做协同过滤的方法,包括SimRank系列算法和马尔科夫链系列算法.现在我们就对SimRank算法在推荐系统的应用做一个总结. 1. SimRank推荐算法的 ...

- MapRedcue的demo(协同过滤)

MapRedcue的演示(协同过滤) 做一个关于电影推荐.你于你好友之间的浏览电影以及电影评分的推荐的协同过滤. 百度百科: 协同过滤简单来说是利用某兴趣相投.拥有共同经验之群体的喜好来推荐用户感兴趣 ...

- 吴裕雄--天生自然HADOOP操作实验学习笔记:协同过滤算法

实验目的 初步认识推荐系统 学会用mapreduce实现复杂的算法 学会系统过滤算法的基本步骤 实验原理 前面我们说过了qq的好友推荐,其实推荐算法是所有机器学习算法中最重要.最基础.最复杂的算法,一 ...

- [Recommendation System] 推荐系统之协同过滤(CF)算法详解和实现

1 集体智慧和协同过滤 1.1 什么是集体智慧(社会计算)? 集体智慧 (Collective Intelligence) 并不是 Web2.0 时代特有的,只是在 Web2.0 时代,大家在 Web ...

- 【转载】协同过滤 & Spark机器学习实战

因为协同过滤内容比较多,就新开一篇文章啦~~ 聚类和线性回归的实战,可以看:http://www.cnblogs.com/charlesblc/p/6159187.html 协同过滤实战,仍然参考:h ...

- Spark MLlib之协同过滤

原文:http://blog.selfup.cn/1001.html 什么是协同过滤 协同过滤(Collaborative Filtering, 简称CF),wiki上的定义是:简单来说是利用某兴趣相 ...

随机推荐

- 【android 开 发 】 - Android studio 下 NDK Jni 开发 简单例子

Android 开发了一段时间,一方面 ,感觉不留下点什么.有点对不起自己, 另一方面,好记性不如烂笔头,为了往后可以回头来看看,就当做是笔记,便决定开始写博客.废话不多说 ! 今天想搞一搞 ndk ...

- IOS开发之Bug--使用xib的自动布局和代码中修改遇到的bug

首先,在xib中约束了宽高22,但是需要代码动态重设,所以一开始如下设置,但是实际显示的仍然是22,而不是重设的值: 然后直接拿xib的将布局约束对象拖线重新通过代码重设约束值,虽然打印的结果宽高值是 ...

- (六)Maven之pom.xml文件简单说明

通过前面几部分知识,我们对maven已经有了初步的印象,就像Make的Makefile.Ant的build.xml一样,Maven项目的核心是pom.xml.POM(Project Object Mo ...

- Android layout_weight理解

layout_weight属性只能用于LinearLayout布局,不能用于RelativeLayout等其他布局: layout_weight属性如果不设定,默认值为0: layout_weight ...

- MVP ComCamp & GCR MVP Openday 2014

今年的MVP Openday与往年不一样,加入了Community Camp环节,即社区大课堂.其主要形式是由MVP作为讲师提供包括Developer和IT Pro方向的课程,地点是在北京国际会议中心 ...

- Linux命令学习总结:cd命令

命令简介: 该命令用来切换当前目录.cd 是change directory 的缩写 命令语法: cd [-L|-P] [dir] 使用示例 1:切换到当前目录的上一级目录 1: [root@DB-S ...

- postfix与sendmail冲突

在Linux服务器(CentOS release 6.6)上配置好了sendmail后,测试发送邮件时发现有问题,检查sendmail服务的状态,发现其处于"sendmail dead bu ...

- truncate 、delete与drop区别

原博文地址:http://www.cnblogs.com/8765h/archive/2011/11/25/2374167.html 相同点: 1.truncate和不带where子句的delete. ...

- 多点触摸(MT)协议(翻译)

参考: http://www.kernel.org/doc/Documentation/input/multi-touch-protocol.txt 转自:http://www.arm9home.ne ...

- 搞ACM的你伤不起[转自RoBa]------(看一次,笑一次)

RoBa原创,转载请注明出处 劳资六年前开始搞ACM啊!!!!!!!!!! 从此踏上了尼玛不归路啊!!!!!!!!!!!! 谁特么跟劳资讲算法是程序设计的核心啊!!!!!! 尼玛除了面试题就没见过用 ...