增补博客 第八篇 python 中国大学排名数据分析与可视化

【题目描述】以软科中国最好大学排名为分析对象,基于requests库和bs4库编写爬虫程序,对2015年至2019年间的中国大学排名数据进行爬取:

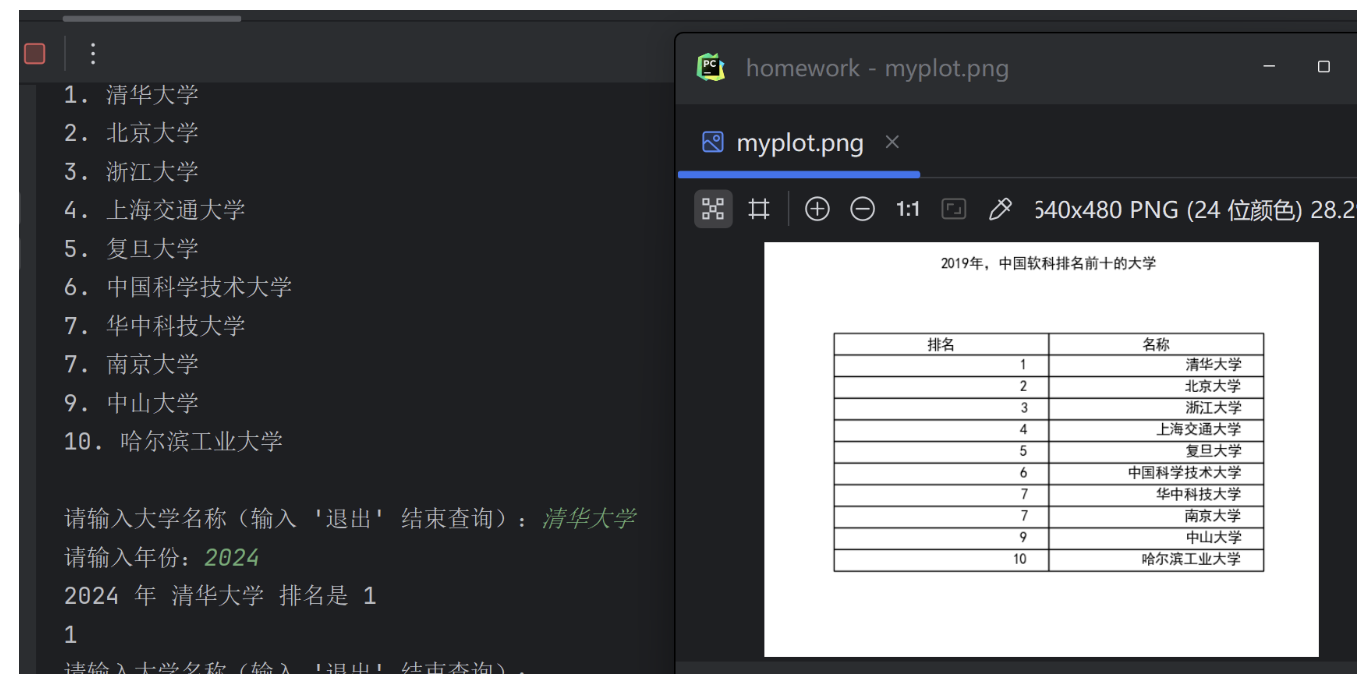

(1)按照排名先后顺序输出不同年份的前10位大学信息,并要求对输出结果的排版进行优化;

(2)结合matplotlib库,对2015-2019年间前10位大学的排名信息进行可视化展示。

(3附加)编写一个查询程序,根据从键盘输入的大学名称和年份,输出该大学相应的排名信息。如果所爬取的数据中不包含该大学或该年份信息,则输出相应的提示信息,并让用户选择重新输入还是结束查询;

【练习要求】请给出源代码程序和运行测试结果,源代码程序要求添加必要的注释。

import requests

from bs4 import BeautifulSoup

import matplotlib.pyplot as plt

from sympy.physics.control.control_plots import matplotlib plt.rcParams['font.sans-serif']=['SimHei'] # 用来设置字体样式以正常显示中文标签

plt.rcParams['axes.unicode_minus']=False # 默认是使用Unicode负号,设置正常显示字符,如正常显示负号 # 设置请求头部信息

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3"

} def get_ranking(year):

url = f'https://www.shanghairanking.cn/rankings/bcur/{year}.html'

# 发送HTTP请求以获取网页内容

response = requests.get(url, headers=headers)

# 检查请求是否成功

if response.status_code == 200:

# 使用BeautifulSoup解析HTML内容

soup = BeautifulSoup(response.content, 'html.parser')

# 找到包含大学信息的表格

table = soup.find('table', class_='rk-table')

# 提取前10所大学的信息

universities = table.find_all('tr', {'data-v-90b0d2ac': True})[1:11] # 排除表头行

# 存储排名数据的列表

ranking_data = []

for university in universities:

rank_element = university.find('td', {'data-v-90b0d2ac': True})

# 检查排名元素是否存在

if rank_element:

rank = rank_element.text.strip()

name = university.find('a').text.strip()

# 将排名数据存储到列表中

ranking_data.append({"排名": rank, "名称": name})

return ranking_data

else:

print("请求失败。状态码:", response.status_code) def main():

# 1. 获取并输出前10位大学信息

for year in range(2015, 2020):

ranking_data = get_ranking(year)

if ranking_data:

print(f"{year}年前10所大学:")

for data in ranking_data:

print(f"{data['排名']}. {data['名称']}")

print()

# 创建一个表格的figure

fig, ax = plt.subplots()

# 隐藏坐标轴

ax.axis('off')

# 创建表格

table = ax.table(cellText=[list(data.values()) for data in ranking_data], colLabels=list(ranking_data[0].keys()), loc='center')

# 调整表格字体大小

table.auto_set_font_size(False)

table.set_fontsize(12)

# 调整单元格高度

table.scale(1, 1.5)

# 显示表格

plt.title(f"{year}年,中国软科排名前十的大学", pad=20)

plt.show()

else:

print(f"未能获取{year}年的大学排名数据。") def get_specific_ranking(university, year): # Renamed the function

# 构建URL

url = f'https://www.shanghairanking.cn/rankings/bcur/{year}.html' # 发送HTTP请求

response = requests.get(url) # 检查响应状态码

if response.status_code == 200:

# 使用BeautifulSoup解析HTML内容

soup = BeautifulSoup(response.content, 'html.parser')

# 找到包含大学信息的表格

table = soup.find('table', class_='rk-table')

# 提取前30所大学的信息

universities = table.find_all('tr', {'data-v-90b0d2ac': True})[1:31] # 排除表头行

# 存储排名数据的列表

ranking_data = []

for university_row in universities:

name_element = university_row.find('a')

# 检查大学名称元素是否存在

if name_element:

name = name_element.text.strip()

# 检查大学名称是否与输入的大学名称匹配

if name == university:

rank_element = university_row.find('td', {'data-v-90b0d2ac': True})

if rank_element:

rank = rank_element.text.strip()

print(f"{year} 年 {university} 排名是 {rank}")

return rank

# 如果未找到匹配的大学名称,打印消息

print(f"找不到 {university} 在 {year} 年的排名信息。")

else:

print("请求失败。状态码:", response.status_code) if __name__ == "__main__":

main()

while True:

university = input("请输入大学名称(输入 '退出' 结束查询):")

if university.lower() == '退出':

break

year = input("请输入年份:")

print(get_specific_ranking(university, year))

增补博客 第八篇 python 中国大学排名数据分析与可视化的更多相关文章

- Python 中国大学排名定向爬虫

代码来自于中国大学Mooc北京理工大学Pythont教学团队:https://www.icourse163.org/learn/BIT-1001870001#/learn/content?type=d ...

- 一鼓作气 博客--第八篇 note8

0.,222] list[33] except IndexError as e : print('index error ') except ValueError as e : print('valu ...

- Scrum 冲刺博客第八篇

一.当天站立式会议照片一张 二.每个人的工作 (有work item 的ID),并将其记录在码云项目管理中 昨天已完成的工作 对界面进行美化 今天计划完成的工作 连接数据库实现排行榜的基本功能 工作中 ...

- [转]有哪些值得关注的技术博客(Java篇)

有哪些值得关注的技术博客(Java篇) 大部分程序员在自学的道路上不知道走了多少坑,这个视频那个网站搞得自己晕头转向.对我个人来说我平常在学习的过程中喜欢看一些教程式的博客.这些博客的特点: 1. ...

- Django 系列博客(八)

Django 系列博客(八) 前言 本篇博客介绍 Django 中的模板层,模板都是Django 使用相关函数渲染后传输给前端在显式的,为了想要渲染出我们想要的数据,需要学习模板语法,相关过滤器.标签 ...

- 基于 abp vNext 和 .NET Core 开发博客项目 - 终结篇之发布项目

系列文章 基于 abp vNext 和 .NET Core 开发博客项目 - 使用 abp cli 搭建项目 基于 abp vNext 和 .NET Core 开发博客项目 - 给项目瘦身,让它跑起来 ...

- 年度十佳 DevOps 博客文章(前篇)

如果说 15 年你还没有将 DevOps 真正应用起来,16 年再不实践也未免太落伍了.国内 ITOM 领军企业 OneAPM 工程师为您翻译整理了,2015 年十佳 DevOps 文章,究竟是不是深 ...

- # Do—Now——团队冲刺博客_总结篇

Do-Now--团队冲刺博客_总结篇 目录 博客链接 作者 1. 第一篇(领航篇) @仇夏 2. 第二篇 @侯泽洋 3. 第三篇 @仇夏 4. 第四篇 @周亚杰 5. 第五篇 @唐才铭 6. 第六篇 ...

- 为了确认是您本人在申请搬家,请在原博客发表一 篇标题为《将博客搬至CSDN》的文章,并将文章地址填写在上方的"搬家通知地址"中

为了确认是您本人在申请搬家,请在原博客发表一 篇标题为<将博客搬至CSDN>的文章,并将文章地址填写在上方的"搬家通知地址"中

- thinkphp5项目--个人博客(八)

thinkphp5项目--个人博客(八) 项目地址 fry404006308/personalBlog: personalBloghttps://github.com/fry404006308/per ...

随机推荐

- 阿里云AHAS Chaos:应用及业务高可用提升工具平台之故障演练

简介: 阿里云AHAS Chaos:应用及业务高可用提升工具平台之故障演练 应用高可用服务AHAS及故障演练AHAS Chaos 应用高可用服务(Application High Availabili ...

- 源码解读:KubeVela 是如何将 appfile 转换为 K8s 特定资源对象的

简介: KubeVela 是一个简单易用又高度可扩展的云原生应用管理引擎,是基于 Kubernetes 及阿里云与微软云共同发布的云原生应用开发模型 OAM 构建.本文主要目的是探索 KubeVela ...

- 如何利用 AHAS 保障 Web 服务稳如磐石?

简介:应用高可用服务 AHAS (Application High Availability Service) 是经阿里巴巴内部多年高可用体系沉淀下来的云产品,基于阿里开源流控降级组件 Sentin ...

- 阿里面试Redis最常问的三个问题:缓存雪崩、击穿、穿透(带答案)

那提到Redis我相信各位在面试,或者实际开发过程中对缓存雪崩,穿透,击穿也不陌生吧,就算没遇到过但是你肯定听过,那三者到底有什么区别,我们又应该怎么去防止这样的情况发生呢,我们有请下一位受害者. 面 ...

- XAMPP安装与部署使用

#注:本文章资料借鉴自于Sunny王维,地址:https://blog.csdn.net/qq_36595013/article/details/80373597 [一]XAMPP介绍 XAMPP. ...

- JAVA下唯一一款搞定OLTP+OLAP的强类型查询这就是最好用的ORM相见恨晚

JAVA下唯一一款搞定OLTP+OLAP的强类型查询这就是最好用的ORM相见恨晚 介绍 首先非常感谢 FreeSQL 提供的部分源码,让我借鉴了不少功能点,整体设计并没有参考FreeSQL(因为jav ...

- 2021~2022Apache大数据相关项目盘点

一.晋升为Apache TLP(Top-Level Project)的大数据相关项目 1.1.Apache DataSketches (20210203) 1.2.Apache Gobblin (20 ...

- 基于改进MFCC特征和卷积递归神经网络的心音分类

具体的软硬件实现点击http://mcu-ai.com/MCU-AI技术网页_MCU-AI人工智能 心音分类在心血管疾病的早期发现中起着至关重要的作用,特别是对于小型初级卫生保健诊所.尽管近年来心音分 ...

- 03 Xpath lxml库的安装和使用

Python lxml库的安装和使用 lxml 是 Python 的第三方解析库,完全使用 Python 语言编写,它对 Xpath 表达式提供了良好的支持,因此能够了高效地解析 HTML/XML 文 ...

- 🔥🔥v1.9.2-httpsok快速申请免费谷歌SSL证书

v1.9.2-httpsok快速申请免费谷歌SSL证书 介绍 httpsok 是一个便捷的 HTTPS 证书自动续签工具,专为 Nginx .OpenResty 服务器设计.已服务众多中小企业,稳定. ...