神经网络与机器学习 笔记—Rosenblatt感知器收敛算法C++实现

Rosenblatt感知器收敛算法C++实现

算法概述

自己用C++实现了下,测试的例子和模式用的都是双月分类模型,关于双月分类相关看之前的那个笔记:

https://blog.csdn.net/u013761036/article/details/90548819

直接上实现代码:

#pragma once

#include "stdafx.h"

#include <string>

#include <iostream>

using namespace std;

int gnM = 0; //训练集空间维度

int gnN = 0; //突触权值个数

double gdU = 0.01; //学习率参数

void RosenBlattInit(double *dX, int nM, double *dW, int nN ,double dB ,double dU) {

//dX 本次训练数据集

//nM 训练集空间维度

//dW 权值矩阵

//nN 突触权值个数 RosenBlatt只有一个神经元,所以nM==nM

//dB 偏置,正常这个是应该 走退火动态调整的,以后再说,现在固定得了。

//dU 学习率参数

if (nM > 0) {

dX[0] = 1;//把偏置永远当成一个固定的突触

}

for (int i = 0; i <= nN; i++) {

if (i == 0) {

dW[i] = dB;//固定偏置

}

else {

dW[i] = 0.0;

}

}

gnM = nM ,gnN = nN ,gdU = dU;

}

double Sgn(double dNumber) {

return dNumber > 0 ? +1.0 : -1.0;

}

//感知器收敛算法-学习

void RosenBlattStudy(const double *dX, const double dD, double *dW) {

//dX 本次训练数据集

//dD 本次训练数据集的期望值

//dW 动态参数,突触权值

double dY = 0;

for (int i = 0; i <= gnM && i <= gnN; i++) {

dY = dY + dX[i] * dW[i];

}

dY = Sgn(dY);

if (dD == dY) {

return;//不需要进行学习调整突触权值

}

for (int i = 1; i <= gnM && i <= gnN; i++) {

dW[i] = dW[i] + gdU * (dD - dY) * dX[i];

}

}

//感知器收敛算法-泛化

double RosenBlattGeneralization(const double *dX , const double *dW) {

//dX 本次需要泛化的数据集

//dW 已经学习好的突触权值

//返回的是当前需要泛化的数据集的泛化结果(属于那个域的)

double dY = 0;

for (int i = 0; i <= gnM && i <= gnN; i++) {

dY = dY + dX[i] * dW[i];

}

return Sgn(dY);

}

//双月分类模型,随机获取一组值

/* 自己稍微改了下

域1:上半个圆,假设圆心位坐标原点(0,0)

(x - 0) * (x - 0) + (y - 0) * (y - 0) = 10 * 10

x >= -10 && x <= 10

y >= 0 && y <= 10

域2:下半个圆,圆心坐标(10 ,-1)

(x - 10) * (x - 10) + (y + 1) * (y + 1) = 10 * 10;

x >= 0 && x <= 20

y >= -11 && y <= -1

*/

const double gRegionA = 1.0; //双月上

const double gRegionB = -1.0;//双月下

void Bimonthly(double *dX ,double *dY ,double *dResult) {

//dX 坐标x

//dY 坐标y

//dResult 属于哪个分类

*dResult = rand () % 2 == 0 ? gRegionA : gRegionB;

if (*dResult == gRegionA) {

*dX = rand() % 20 - 10;//在区间内随机一个X

*dY = sqrt(10 * 10 - (*dX) * (*dX));//求出Y

}

else {

*dX = rand() % 20;

*dY = sqrt(10 * 10 - (*dX - 10) * (*dX - 10)) - 1;

*dY = *dY * -1;

}

}

int main()

{

//system("color 0b");

double dX[2 + 1], dD, dW[2 + 1]; //输入空间维度为3 平面坐标系+一个偏置

double dU = 0.1;

double dB = 0;

RosenBlattInit(dX, 2, dW, 2, dB, dU);//初始化 感知器

double dBimonthlyX, dBimonthlyY, dBimonthlyResult;

int nLearningTimes = 1024 * 10;//进行10K次学习

for (int nLearning = 0; nLearning <= nLearningTimes; nLearning++) {

Bimonthly(&dBimonthlyX, &dBimonthlyY, &dBimonthlyResult);//随机生成双月数据

dX[1] = dBimonthlyX;

dX[2] = dBimonthlyY;

dD = dBimonthlyResult;

RosenBlattStudy(dX, dD, dW);

//cout <<"Study:" << nLearning << " :X= " << dBimonthlyX << "Y= " << dBimonthlyY << " D=" << dBimonthlyResult<< "----W1= " << dW[1] << " W2= " << dW[2] << endl;

}

//进行感知器泛化能力测试 测试数据量1K

int nGeneralizationTimes = 1 * 1024;

int nGeneralizationYes = 0, nGeneralizationNo = 0;

double dBlattGeneralizationSuccessRate = 0;

for (int nLearning = 1; nLearning <= nGeneralizationTimes; nLearning++) {

Bimonthly(&dBimonthlyX, &dBimonthlyY, &dBimonthlyResult);//随机生成双月数据

dX[1] = dBimonthlyX;

dX[2] = dBimonthlyY;

//cout << "Generalization: " << dBimonthlyX << "," << dBimonthlyY;

if (dBimonthlyResult == RosenBlattGeneralization(dX, dW)) {

nGeneralizationYes++;

//cout << " Yes" << endl;

}

else {

nGeneralizationNo++;

//cout << " No" << endl;

}

}

dBlattGeneralizationSuccessRate = nGeneralizationYes * 1.0 / (nGeneralizationNo + nGeneralizationYes) * 100;

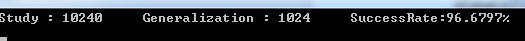

cout << "Study : " << nLearningTimes << " Generalization : " << nGeneralizationTimes << " SuccessRate:" << dBlattGeneralizationSuccessRate << "%" << endl;

getchar();

return 0;

}

结果:

学习了10K次,泛化测试1K次,成功率96%

神经网络与机器学习 笔记—Rosenblatt感知器收敛算法C++实现的更多相关文章

- 神经网络与机器学习 笔记—多层感知器(MLP)

多层感知器(MLP) Rosenblatt感知器和LMS算法,都是单层的并且是单个神经元构造的神经网络,他们的局限性是只能解决线性可分问题,例如Rosenblatt感知器一直没办法处理简单异或问题.然 ...

- 神经网络与机器学习 笔记—LMS(最小均方算法)和学习率退火

神经网络与机器学习 笔记-LMS(最小均方算法)和学习率退火 LMS算法和Rosenblatt感知器算法非常想,唯独就是去掉了神经元的压制函数,Rosenblatt用的Sgn压制函数,LMS不需要压制 ...

- 神经网络与机器学习 笔记—Rosenblatt感知机

Rosenblatt感知机器 感知器在神经网络发展的历史上占据着特殊位置:它是第一个从算法上完整描述的神经网络.它的发明者Rosenblatt是一位心里学家,在20世纪60年代和70年代,感知器的启发 ...

- 神经网络与机器学习第3版学习笔记-第1章 Rosenblatt感知器

神经网络与机器学习第3版学习笔记 -初学者的笔记,记录花时间思考的各种疑惑 本文主要阐述该书在数学推导上一笔带过的地方.参考学习,在流畅理解书本内容的同时,还能温顾学过的数学知识,达到事半功倍的效果. ...

- 机器学习:Python实现单层Rosenblatt感知器

如果对Rosenblatt感知器不了解,可以先查看下相关定义,然后对照下面的代码来理解. 代码中详细解释了各步骤的含义,有些涉及到了数学公式的解释. 这篇文章是以理解Rosenblatt感知器的原理为 ...

- Rosenblatt感知器

一.定义 Rosenblatt感知器建立在一个线性神经元之上,神经元模型的求和节点计算作用于突触输入的线性组合,同时结合外部作用的偏置,对若干个突触的输入项求和后进行调节. 二.基本计算过程 Rose ...

- 神经网络与机器学习 笔记—单神经元解决XOR问题

单神经元解决XOR问题 有两个输入的单个神经元的使用得到的决策边界是输入空间的一条直线.在这条直线的一边的所有的点,神经元输出1:而在这条直线的另一边的点,神经元输出0.在输入空间中,这条直线的位置和 ...

- 神经网络与机器学习 笔记—卷积神经网络(CNN)

卷积神经网络 之前的一些都是考虑多层感知器算法设计相关的问题,这次是说一个多层感知器结构布局相关的问题.来总结卷积神经网络.对于模式分类非常合适.网络的提出所隐含的思想收到了神经生物学的启发. 第一个 ...

- 【机器学习笔记一】协同过滤算法 - ALS

参考资料 [1]<Spark MLlib 机器学习实践> [2]http://blog.csdn.net/u011239443/article/details/51752904 [3]线性 ...

随机推荐

- 设计模式之工厂方法模式(Factory Method Pattern)

一.工厂方法模式的诞生 在读这篇文章之前,我先推荐大家读<设计模式之简单工厂模式(Simple Factory Pattern)>这篇文档.工厂方法模式是针对简单工厂模式中违反开闭原则的不 ...

- 使用C# (.NET Core) 实现命令设计模式 (Command Pattern)

本文的概念内容来自深入浅出设计模式一书. 项目需求 有这样一个可编程的新型遥控器, 它有7个可编程插槽, 每个插槽可连接不同的家用电器设备. 每个插槽对应两个按钮: 开, 关(ON, OFF). 此外 ...

- 使用 Velero 跨云平台迁移集群资源到 TKE

概述 Velero 是一个非常强大的开源工具,可以安全地备份和还原,执行灾难恢复以及迁移Kubernetes群集资源和持久卷,可以在 TKE 平台上使用 Velero 备份.还原和迁移集群资源,关于如 ...

- 国产mcu理论数据评估工作记录

目录 前言 简要工作记录 前言 时间:20210315 主要记录这两天对国内各IC厂商的 MCU 了解记录. 大环境,ST 厂商 MCU 疯狂涨价,国内 MCU 也越来越完善,还便宜.同时,全球缺晶圆 ...

- java例题_49 计算子串出现的次数

1 /*49 [程序 49 子串出现的个数] 2 题目:计算字符串中子串出现的次数 3 */ 4 5 /*分析 6 * 1.子串的出现是有标志的,如" ",*,#或者其他 7 * ...

- windows平台rust安装

1.安装目录环境变量 RUSTUP_HOME D:\WorkSoftware\Rust\cargo CARGO_HOME D:\WorkSoftware\Rust\rustup 2.安装下载加速环境变 ...

- dll远线程注入

原理 核心函数 CreateRemoteThread:让在其他进程中创建一个线程变成可能 核心思想 HANDLE WINAPI CreateRemoteThread( __in HANDLE hPro ...

- filesort排序原理

在执行计划中,可能经常看到有Extra列有filesort,这就是使用了文件排序,这当然是不好的,应该优化,但是,了解一下他排序的原理也许很有帮助,下面看一下filesort的过程: 1.根据表的索引 ...

- Dubbo 编解码那些事

一.背景 笔者在一次维护基础公共组件的过程中,不小心修改了类的包路径.糟糕的是,这个类被各业务在facade中进行了引用.传递.幸运的是,同一个类,在提供者和消费者的包路径不一致,没有引起各业务报错. ...

- sql 如何删除(代替)字段内某一部分内容

方法一(此方法既可用于删除某一列字段中的某部分字符,也可用于替换某一列字段中的某部分字符) update Table_Name set Column_Name=replace(Column_Name, ...