[特征工程] encoding

参考:An Overview of Encoding Techniques | Kaggle

Method 1: Label encoding

给每个类别以一个数字label,作为分类。将类别映射到自然数数值空间上

from sklearn.preprocessing import LabelEncoder

train=pd.DataFrame()

label=LabelEncoder()

for c in X.columns:

if(X[c].dtype=='object'):

train[c]=label.fit_transform(X[c])

else:

train[c]=X[c]

Method 2 : One hot encoding

即独热码,每一个category对应特征向量中的一位,对应位置是否为1判定是否为该类。

可以使用pd.get_dummies()或sklearn.preprocessing中OneHotEncoder

from sklearn.preprocessing import OneHotEncoder

one=OneHotEncoder(

one.fit(X)

train=one.transform(X)

Method 3 : Feature Hashing/Hashing Trick

一个“one hot encoding style” 的编码方式,将数据编入特定维数的散度矩阵中,降维中使用了hash方法。

from sklearn.feature_extraction import FeatureHasher

X_train_hash=X.copy()

for c in X.columns:

X_train_hash[c]=X[c].astype('str')

hashing=FeatureHasher(input_type='string')

train=hashing.transform(X_train_hash.values)

Method 4 :Encoding categories with dataset statistics

尝试为模型提供较低维的每个类别的表示,且其中类似的类别的表示相近。 最简单的方法是将每个类别替换为我们在数据集中看到它的次数,即用出现频率作为他们的embedding。

X_train_stat=X.copy()

for c in X_train_stat.columns:

if(X_train_stat[c].dtype=='object'):

X_train_stat[c]=X_train_stat[c].astype('category')

counts=X_train_stat[c].value_counts()

counts=counts.sort_index()

counts=counts.fillna(0)

counts += np.random.rand(len(counts))/1000

X_train_stat[c].cat.categories=counts

对于循环出现的特征,例如日期,星期等,常用sin\cos将其转为二维空间中的数据。这是基于“循环”的性质,类似于对圆进行分割。

X_train_cyclic=X.copy()

columns=['day','month']

for col in columns:

X_train_cyclic[col+'_sin']=np.sin((2*np.pi*X_train_cyclic[col])/max(X_train_cyclic[col]))

X_train_cyclic[col+'_cos']=np.cos((2*np.pi*X_train_cyclic[col])/max(X_train_cyclic[col]))

X_train_cyclic=X_train_cyclic.drop(columns,axis=1)

one=OneHotEncoder()

one.fit(X_train_cyclic)

train=one.transform(X_train_cyclic)

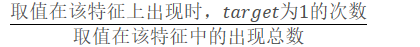

Method 5 : Target encoding

Target encoding 通过目标数据对类别变量进行编码,使用目标对应概率或平均概率替换该类别,即出现频次相近的被视为同一类(大城市,热门项等)。这个方法比较依赖训练集与测试集合的分布,要求他们数据分布一致。另外,这种方法可能会导致过拟合。

X_target=df_train.copy()

X_target['day']=X_target['day'].astype('object')

X_target['month']=X_target['month'].astype('object')

for col in X_target.columns:

if (X_target[col].dtype=='object'):

target= dict ( X_target.groupby(col)['target'].agg('sum')/X_target.groupby(col)['target'].agg('count'))

X_target[col]=X_target[col].replace(target).values

为了减轻过拟合可能带来的影响,可以使用K-Fold Validation ,每次对一份样本进行目标编码时,使用的都是其他K-1份数据之中的数据。

X['target']=y

cols=X.drop(['target','id'],axis=1).columns

%%time

X_fold=X.copy()

X_fold[['ord_0','day','month']]=X_fold[['ord_0','day','month']].astype('object')

X_fold[['bin_3','bin_4']]=X_fold[['bin_3','bin_4']].replace({'Y':1,'N':0,'T':1,"F":0})

kf = KFold(n_splits = 5, shuffle = False, random_state=2019)

for train_ind,val_ind in kf.split(X):

for col in cols:

if(X_fold[col].dtype=='object'):

replaced=dict(X.iloc[train_ind][[col,'target']].groupby(col)['target'].mean())

X_fold.loc[val_ind,col]=X_fold.iloc[val_ind][col].replace(replaced).values

此外,在对特征进行编码前也需要进行特征种类的区分。常分为:

- 0-1数值:只有两种取值,可映射到0,1

- 类别数值:多个类别,这也是最常见的数据。

- 时序数据:时间戳等,隐含了顺序信息,可以反应趋势。

[特征工程] encoding的更多相关文章

- 机器学习-特征工程-Missing value和Category encoding

好了,大家现在进入到机器学习中的一块核心部分了,那就是特征工程,洋文叫做Feature Engineering.实际在机器学习的应用中,真正用于算法的结构分析和部署的工作只占很少的一部分,相反,用于特 ...

- 特征工程(Feature Engineering)

一.什么是特征工程? "Feature engineering is the process of transforming raw data into features that bett ...

- 机器学习-特征工程-Feature generation 和 Feature selection

概述:上节咱们说了特征工程是机器学习的一个核心内容.然后咱们已经学习了特征工程中的基础内容,分别是missing value handling和categorical data encoding的一些 ...

- 【Python数据挖掘】第六篇--特征工程

一.Standardization 方法一:StandardScaler from sklearn.preprocessing import StandardScaler sds = Standard ...

- AI学习笔记:特征工程

一.概述 Andrew Ng:Coming up with features is difficult, time-consuming, requires expert knowledge. &quo ...

- Alink漫谈(十) :特征工程 之 特征哈希/标准化缩放

Alink漫谈(十) :特征工程之特征哈希/标准化缩放 目录 Alink漫谈(十) :特征工程之特征哈希/标准化缩放 0x00 摘要 0x01 相关概念 1.1 特征工程 1.2 特征缩放(Scali ...

- 使用sklearn做单机特征工程

目录 1 特征工程是什么?2 数据预处理 2.1 无量纲化 2.1.1 标准化 2.1.2 区间缩放法 2.1.3 标准化与归一化的区别 2.2 对定量特征二值化 2.3 对定性特征哑编码 2.4 缺 ...

- 特征工程(Feature Enginnering)学习记要

最近学习特征工程(Feature Enginnering)的相关技术,主要包含两块:特征选取(Feature Selection)和特征抓取(Feature Extraction).这里记录一些要点 ...

- 【转】使用sklearn做单机特征工程

这里是原文 说明:这是我用Markdown编辑的第一篇随笔 目录 1 特征工程是什么? 2 数据预处理 2.1 无量纲化 2.1.1 标准化 2.1.2 区间缩放法 2.1.3 无量纲化与正则化的区别 ...

随机推荐

- Java学习(二十二)

学了一个在css中叫font的样式: 感觉还是挺好用的 不过要注意如果把font放在最后,其他会使用默认值,可能会覆盖掉前面的 例如新学的行高 在font中语法是 font:30px/40px &qu ...

- [hdu6989]Didn't I Say to Make My Abilities Average in the Next Life?!

显然问题即求$\frac{\sum_{x\le l\le r\le y}(\max_{l\le i\le r}a_{i}+\min_{l\le i\le r}a_{i})}{(y-x+2)(y-x+1 ...

- [bzoj1863]皇帝的烦恼

二分枚举答案,假设是ans,考虑判定答案从前往后计算,算出每一个将军与第一个将军最少和最多有多少个相同的奖牌,贪心转移即可 1 #include<bits/stdc++.h> 2 usin ...

- NOIP2020 自爆记

Day -4 - 2459184 本学期第 14 周终于到来了,NOIP 只剩 5 周了. djq 进国集了,先以膜为敬. 晚上上 hb,hb 让我们记了几点要求: 认真读题,要一字一句读题,包括输入 ...

- 洛谷 P3239 [HNOI2015]亚瑟王(期望+dp)

题面传送门 感觉是道挺好的题,可惜当时没写题解来着的? 根据期望的线性公式,我们求出每个卡牌被发动的概率 \(q_i\),然后 \[ans=\sum\limits_{i=1}^np_id_i \] 于 ...

- 【豆科基因组】小豆(红豆)adzuki bean, Vigna angularis基因组2015

目录 一.来源 研究一:Draft genome sequence of adzuki bean, Vigna angularis 研究二:Genome sequencing of adzuki be ...

- Linux服务器查看个人硬盘配额

quota -uvs

- Redis高并发处理常见问题及解决方案

1. 大型电商系统高流量系统设计 场景: 大量电商系统每天要处理上亿请求,其中大量请求来自商品访问.下单.商品的详情是时刻变化,由于请求量过大,不会频繁去服务端获取商品信息,导致服务器压力极大.需要用 ...

- 【机器学习与R语言】8- 神经网络

目录 1.理解神经网络 1)基本概念 2)激活函数 3)网络拓扑 4)训练算法 2.神经网络应用示例 1)收集数据 2)探索和准备数据 3)训练数据 4)评估模型 5)提高性能 1.理解神经网络 1) ...

- 【机器学习与R语言】5-规则学习算法

目录 1.分类规则原理 1.1 1R单规则算法 1.2 RIPPER算法 2. 规则学习应用示例 1)收集数据 2)探索和准备数据 3)训练数据 4)评估性能 5)提高性能 6)选择决策树中的分类规则 ...