Python爬虫之提取Bing搜索的背景图片并设置为Windows的电脑桌面

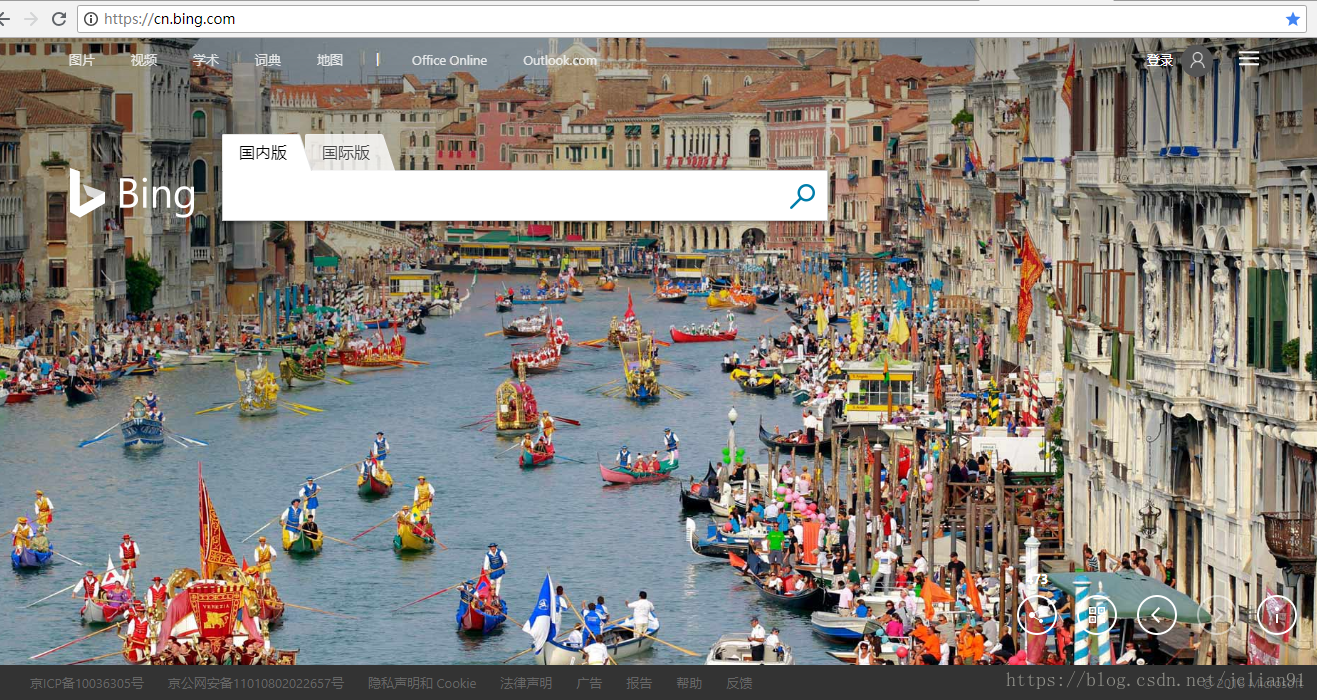

鉴于现阶段国内的搜索引擎还用不上Google, 笔者会寻求Bing搜索来代替。在使用Bing的过程中,笔者发现Bing的背景图片真乃良心之作,十分赏心悦目,因此,笔者的脑海中萌生了一个念头:能否自己做个爬虫,可以提取Bing搜索的背景图片并设置为Windows的电脑桌面呢?Bing搜索的页面如下:

于是在一个风雨交加的下午,笔者开始了自己的探索之旅。当然,过程是曲折的,但笔者尝试着能把它讲得简单点。

首先,我们需要借助一些Python模块的帮助,它们是:

- urllib

- selenium

- pywin32

当然,你的电脑上也需要安装PhantomJS, 因为,我们需要动态地爬取网页。

好了,准备工作就绪。接下来就是Python代码时间了,完整的代码如下:

# -*- coding: utf-8 -*-

"""

此程序用于提取Bing搜索的背景图片并设置为Windows的电脑桌面

"""

from urllib.request import urlretrieve

from selenium import webdriver

from selenium.common.exceptions import TimeoutException

import win32api,win32con,win32gui

#利用PhantomJS加载网页

browser = webdriver.PhantomJS()

# 设置最大等待时间为30s

browser.set_page_load_timeout(30)

url = 'https://cn.bing.com/'

try:

browser.get(url)

except TimeoutException:

# 当加载时间超过30秒后,自动停止加载该页面

browser.execute_script('window.stop()')

# 从id为bgDiv的标签中获取背景图片的信息

t = browser.find_element_by_id('bgDiv')

bg = t.get_attribute('style')

# 从字符串中提取背景图片的下载网址

start_index = bg.index('(')

end_index = bg.index(')')

img_url = bg[start_index+1: end_index]

# 下载该图片到本地

img_path = 'E://Bing.jpg'

urlretrieve(img_url, img_path)

# 将下载后的图片设置为Windows系统的桌面

# 打开指定注册表路径

reg_key = win32api.RegOpenKeyEx(win32con.HKEY_CURRENT_USER, "Control Panel\\Desktop", 0, win32con.KEY_SET_VALUE)

# 最后的参数:2拉伸,0居中,6适应,10填充,0平铺

win32api.RegSetValueEx(reg_key, "WallpaperStyle", 0, win32con.REG_SZ, "2")

# 最后的参数:1表示平铺,拉伸居中等都是0

win32api.RegSetValueEx(reg_key, "TileWallpaper", 0, win32con.REG_SZ, "0")

# 刷新桌面

win32gui.SystemParametersInfo(win32con.SPI_SETDESKWALLPAPER, img_path, win32con.SPIF_SENDWININICHANGE)

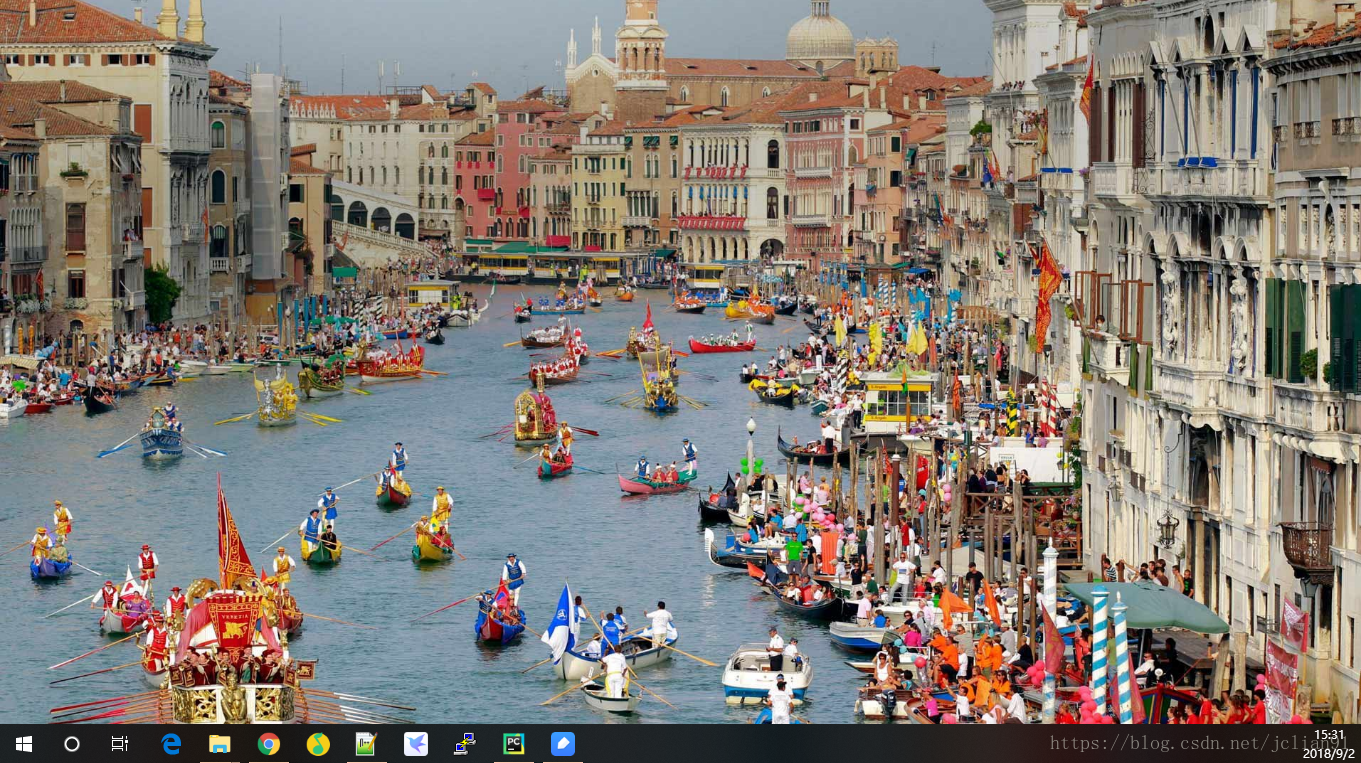

运行这个程序,稍等片刻,我们就会发现自己的电脑壁纸已经换成了今天Bing搜索页面的背景图片,真的是very amzing.

本次分享到此结束,欢迎大家交流~~

Python爬虫之提取Bing搜索的背景图片并设置为Windows的电脑桌面的更多相关文章

- Bootstrap css背景图片的设置

一. 网页中添加图片的方式有两种 一种是:通过<img>标签直接插入到html中 另一种是:通过css背景属性添加 居中方法:水平居中的text-align:center 和 margin ...

- background-image 背景图片的设置

background-image 背景图片的设置 属性:background-image: url(img/banner.jpg); 1.设置背景图的宽度 background-size: 400px ...

- Android添加背景图片和设置app图标

Android添加背景图片和设置app图标 Android 添加背景图片 第一步:找到你要当做背景的图片,并下载下来 第二步:将图片复制到app->res->mipmap文件夹下 第三步: ...

- python 爬虫入门----案例爬取上海租房图片

前言 对于一个net开发这爬虫真真的以前没有写过.这段时间学习python爬虫,今天周末无聊写了一段代码爬取上海租房图片,其实很简短就是利用爬虫的第三方库Requests与BeautifulSoup. ...

- [python爬虫] Selenium定向爬取海量精美图片及搜索引擎杂谈

我自认为这是自己写过博客中一篇比较优秀的文章,同时也是在深夜凌晨2点满怀着激情和愉悦之心完成的.首先通过这篇文章,你能学到以下几点: 1.可以了解Python简单爬取图片的一些思路和方法 ...

- python爬虫3——获取审查元素(板野友美吧图片下载)

测试环境:python2.7 + beautifulsoup4.4.1 + selenium2.48.0 测试网址:http://tieba.baidu.com/p/2827883128 目的是下载该 ...

- Python爬虫实战 批量下载高清美女图片

彼岸图网站里有大量的高清图片素材和壁纸,并且可以免费下载,读者也可以根据自己需要爬取其他类型图片,方法是类似的,本文通过python爬虫批量下载网站里的高清美女图片,熟悉python写爬虫的基本方法: ...

- Python爬虫之多线程下载豆瓣Top250电影图片

爬虫项目介绍 本次爬虫项目将爬取豆瓣Top250电影的图片,其网址为:https://movie.douban.com/top250, 具体页面如下图所示: 本次爬虫项目将分别不使用多线程和使 ...

- Python爬虫笔记【一】模拟用户访问之设置请求头 (1)

学习的课本为<python网络数据采集>,大部分代码来此此书. 网络爬虫爬取数据首先就是要有爬取的权限,没有爬取的权限再好的代码也不能运行.所以首先要伪装自己的爬虫,让爬虫不像爬虫而是像人 ...

随机推荐

- alome配环境

1. gitLab: 将工程git到alome版的exlipse中. 2. 打开右上角Aclome视图: 3. 打开Aclome资源管理器窗口: 4. 打开git窗口,在Working Tree上右键 ...

- C#中数组、ArrayList和List三者的区别 转

在C#中数组,ArrayList,List都能够存储一组对象,那么这三者到底有什么样的区别呢. 数组 数组在C#中最早出现的.在内存中是连续存储的,所以它的索引速度非常快,而且赋值与修改元素也很简单. ...

- python 二分查找法

@source_data:数据集 @binary_num:要查找的数 @mid:中间数的键值 def binary_search(source_data,search_num): #传入数据集计算中间 ...

- Android MonkeyRunner

MonkeyRunner 也是一款安卓sdk自有的测试工具 可以用来做功能测试 阅读目录 MonkeyRunner环境搭建 1. 安装JDK的安装与配置 2. 安装Python编译器 http ...

- ES6之命令妙用

很多人都听说过ES6(也就是ECMAScript的新一代标准)并且对她充满了向往,下面通过一个ES6中小知识点——let命令,来解开她的神秘面纱,让大家初步认识一下ES6的语法规范. ...

- Javascript高级编程学习笔记(39)—— DOM(5)Comment

Comment类型 顾名思义,comment类型指的就是注释节点在HTML文档中的类型 也就是说平时我们在代码中的注释,在HTML解析的时候也会被解析为一类节点 让我们可以根据这些节点进行一系列的操作 ...

- JMagic 操作 ImageMagick 处理图片

项目描述 imagemagick是功能强大的图片处理库,以稳定及高效率著称,众多语言对该库进行封装处理.比如php.java.由于我们是java项目,直接使用java通过JNI技术调用ImageMag ...

- feign包名路径添加问题

1. feign包名路径添加问题 1.1. 问题 在SpringCloud中使用feign调用路径中,不能在类上直接添加@RequestMapping(value = "/hospital- ...

- python爬取猫眼电影top100

最近想研究下python爬虫,于是就找了些练习项目试试手,熟悉一下,猫眼电影可能就是那种最简单的了. 1 看下猫眼电影的top100页面 分了10页,url为:https://maoyan.com/b ...

- 数字(Number)类型(一)

多行语句 Python 通常是一行写完一条语句,但如果语句很长,我们可以使用反斜杠(\)来实现多行语句,例如: total = item_one + \ item_two + \ item_three ...