Hadoop日志文件分析系统

Hadoop日志分析系统

项目需求:

需要统计一下线上日志中某些信息每天出现的频率,举个简单的例子,统计线上每天的请求总数和异常请求数。线上大概几十台

服务器,每台服务器大概每天产生4到5G左右的日志,假设有30台,每台5G的,一天产生的日志总量为150G。

处理方案:

方案1:传统的处理方式,写个JAVA日志分析代码,部署到每台服务器进行处理,这种方式部署起来耗时费力,又不好维护。

方案2:采用Hadoop分布式处理,日志分析是Hadoop集群系统的拿手好戏。150G每天的日志也算是比较大的数据量了,搭个简

单的Hadoop集群来处理这些日志是再好不过的了。

Hadoop集群的搭建:

参见这两篇文章:http://www.cnblogs.com/cstar/archive/2012/12/16/2820209.html

http://www.cnblogs.com/cstar/archive/2012/12/16/2820220.html

我们这里的集群就采用了两台机器,配置每台8核,32G内存,500G磁盘空间。

日志准备工作:

由于日志分散在各个服务器,所以我们先需要将所有的日志拷贝到我们的集群系统当中,这个可以通过linux服务器下rsync或者scp

服务来执行。这里我们通过scp服务来拷贝,由于都是内网的机器,所以拷贝几个G的日志可以很快就完成。下面是拷贝日志的脚本,脚本

还是有一些需要注意的地方,我们只需要拷贝前一天的数据,实际保存的数据可能是好几天的,所以我们只要把我们需要的这一天的数据

SCP过去就可以了。

#!/bin/sh

workdir=/home/myproj/bin/log/

files=`ls $workdir`

pre1date=`date +"%Y%m%d" -d "-1 days"`

pre1date1=`date +"%Y-%m-%d" -d "-1 days"`

curdate=`date +"%Y%m%d"`

hostname=`uname -n`

echo $pre1date $curdate

uploadpath="/home/hadoop/hadoop/mytest/log/"$pre1date1"/"$hostname

echo $uploadpath

cd $workdir

mintime=240000

secondmintime=0

for file in $files;do

filedate=`stat $file | grep Modify| awk '{print $2}' |sed -e 's/-//g'`

filetime=`stat $file | grep Modify| awk '{print $3}' |cut -d"." -f1 | sed -e 's/://g'| sed 's/^0\+//'`

if [ $filedate -eq $curdate ]; then

if [ $filetime -lt $mintime ]; then

secondmintime=$mintime

mintime=$filetime

fi

fi

done

echo "mintime:"$mintime

step=1000

mintime=`expr $mintime + $step`

echo "mintime+1000:"$mintime

for file in $files;do

filedate=`stat $file | grep Modify| awk '{print $2}' |sed -e 's/-//g'`

filetime=`stat $file | grep Modify| awk '{print $3}' |cut -d"." -f1 | sed -e 's/://g'| sed 's/^0\+//'`

filename=`echo $file | cut -c 1-8`

startchars="info.log"

#echo $filename

if [ $filename == $startchars ]; then

if [ $filedate -eq $pre1date ]; then

scp -rp $file dir@antix2:$uploadpath

#echo $file

elif [ $filedate -eq $curdate ]; then

if [ $filetime -lt $mintime ]; then

scp -rp $file dir@antix2:$uploadpath

#echo $file

fi

fi

fi

#echo $filedate $filetime

done

MapReduce代码

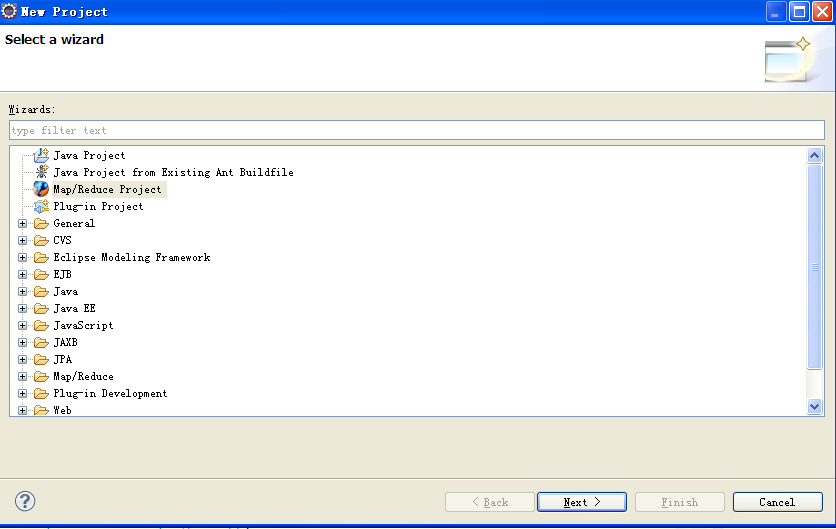

接下来就是编写MapReduce的代码了。使用Eclipse环境来编写,需要安装hadoop插件,我们hadoop机器采用的是1.1.1版本,所以插

件使用hadoop-eclipse-plugin-1.1.1.jar,将插件拷贝到eclipse的plugins目录下就可以了。然后新建一个MapReduce项目:

工程新建好了然后我们就可以编写我们的MapReduce代码了。

import java.io.IOException;

import java.text.SimpleDateFormat;

import java.util.Date; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser; public class LogAnalysis { public static class LogMapper

extends Mapper<LongWritable, Text, Text, IntWritable>{ private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

private Text hourWord = new Text();

public void map(LongWritable key, Text value, Context context

) throws IOException, InterruptedException {

String line = value.toString();

SimpleDateFormat formatter2 = new SimpleDateFormat("yy-MM-dd");

java.util.Date d1 =new Date();

d1.setTime(System.currentTimeMillis()-1*24*3600*1000);

String strDate =formatter2.format(d1);

if(line.contains(strDate)){

String[] strArr = line.split(",");

int len = strArr[0].length();

String time = strArr[0].substring(1,len-1); String[] timeArr = time.split(":");

String strHour = timeArr[0];

String hour = strHour.substring(strHour.length()-2,strHour.length());

String hourKey = "";

if(line.contains("StartASocket")){

word.set("SocketCount");

context.write(word, one);

hourKey = "SocketCount:" + hour;

hourWord.set(hourKey);

context.write(hourWord, one);

word.clear();

hourWord.clear();

}

if(line.contains("SocketException")){

word.set("SocketExceptionCount");

context.write(word, one);

hourKey = "SocketExceptionCount:" + hour;

hourWord.set(hourKey);

context.write(hourWord, one);

word.clear();

hourWord.clear();

}

}

} public static class LogReducer

extends Reducer<Text,IntWritable,Text,IntWritable> {

private IntWritable result = new IntWritable(); public void reduce(Text key, Iterable<IntWritable> values,

Context context

) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

public static int run(String[] args) throws Exception{ Configuration conf = new Configuration();

String[] otherArgs = new GenericOptionsParser(conf, args).getRemainingArgs();

if (otherArgs.length != 2) {

System.err.println("Usage: loganalysis <in> <out>");

System.exit(2);

}

FileSystem fileSys = FileSystem.get(conf);

String inputPath = "input/" + args[0];

fileSys.copyFromLocalFile(new Path(args[0]), new Path(inputPath));//将本地文件系统的文件拷贝到HDFS中

Job job = new Job(conf, "loganalysis");

job.setJarByClass(LogAnalysis.class);

job.setMapperClass(LogMapper.class);

job.setCombinerClass(LogReducer.class);

job.setReducerClass(LogReducer.class);

// 设置输出类型

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(inputPath));

FileOutputFormat.setOutputPath(job, new Path(otherArgs[1])); Date startTime = new Date();

System.out.println("Job started: " + startTime);

int ret = job.waitForCompletion(true)? 0 : 1;

fileSys.copyToLocalFile(new Path(otherArgs[1]), new Path(otherArgs[1]));

fileSys.delete(new Path(inputPath), true);

fileSys.delete(new Path(otherArgs[1]), true); Date end_time = new Date();

System.out.println("Job ended: " + end_time);

System.out.println("The job took " + (end_time.getTime() - startTime.getTime()) /1000 + " seconds.");

return ret;

} public static void main(String[] args)

{

try

{

int ret = run(args);

System.exit(ret);

} catch (Exception e)

{

e.printStackTrace();

System.out.println(e.getMessage());

}

}

}

部署到Hadoop集群:

代码完成后测试没有问题后,部署到集群当中去执行,我们有几十台服务器,所以每台的服务器的日志当成一个任务来执行。

workdir="/home/hadoop/hadoop/mytest"

cd $workdir

pre1date=`date +"%Y-%m-%d" -d "-1 days"`

servers=(mach1 mach2 mach3 )

for i in ${servers[@]};do

inputPath="log/"$pre1date"/"$i

outputPath="output/log/"$pre1date"/"$i

echo $inputPath $outputPath

echo "start job "$i" date:"`date`

hadoop jar LogAnalysis.jar loganalysis $inputPath $outputPath

echo "end job "$i" date:"`date`

done

Hadoop日志文件分析系统的更多相关文章

- [转载]mysql慢日志文件分析处理

原文地址:mysql慢日志文件分析处理作者:maxyicha mysql有一个功能就是可以log下来运行的比较慢的sql语句,默认是没有这个log的,为了开启这个功能,要修改my.cnf或者在mysq ...

- /VAR/LOG/各个日志文件分析

/VAR/LOG/各个日志文件分析 author:headsen chen 2017-10-24 18:00:24 部分内容取自网上搜索,部分内容为自己整理的,特此声明. 1. /v ...

- 用ELK搭建简单的日志收集分析系统【转】

缘起 在微服务开发过程中,一般都会利用多台服务器做分布式部署,如何能够把分散在各个服务器中的日志归集起来做分析处理,是一个微服务服务需要考虑的一个因素. 搭建一个日志系统 搭建一个日志系统需要考虑一下 ...

- Linux下日志文件监控系统Logwatch的使用记录

Linux下日志文件监控系统Logwatch的使用记录 原文:http://www.cnblogs.com/kevingrace/p/6519504.html 在维护Linux服务器时,经常需要查看系 ...

- Kubernetes-20:日志聚合分析系统—Loki的搭建与使用

日志聚合分析系统--Loki 什么是Loki? Loki 是 Grafana Labs 团队最新的开源项目,是一个水平可扩展,高可用性,多租户的日志聚合系统.它的设计非常经济高效且易于操作,因为它不会 ...

- Hadoop日志文件

初学者运行MapReduce作业时,经常会遇到各种错误,往往不知所云,一般直接将终端打印的错误贴到搜索引擎上查找,以借鉴前人的经验. 对于hadoop而言,当遇到错误时,第一时间应是查看日志,日志里通 ...

- Linux日志文件分析

---恢复内容开始--- 日志保存位置 默认 var/log目录下 主要日志文件 内核及公共消息日志:message 计划任务日志:cron 系统殷桃日志:demsg 邮件系统日志:maillog 用 ...

- 2018年ElasticSearch6.2.2教程ELK搭建日志采集分析系统(教程详情)

章节一 2018年 ELK课程计划和效果演示1.课程安排和效果演示 简介:课程介绍和主要知识点说明,ES搜索接口演示,部署的ELK项目演示 es: localhost:9200 k ...

- zipkin+elk微服务日志收集分析系统

docker安装elk日志分析系统 在win10上安装docker环境 tip:win7/8 win7.win8 系统 win7.win8 等需要利用 docker toolbox 来安装,国内可以使 ...

随机推荐

- 类库,委托,is和as运算符,泛型集合

类库:其实就是一堆类文件,只不过用户看不到这些类的源代码,保密性好. 优点:保密性好缺点:如果这个方法不好用,使用者无法自己去更改它. 类文件是.cs 类库是.dll 新建项目为类库,在debu ...

- android-GridView控件的使用

GridView 按行列方式显示多个组件(二维布局界面) 数据源(集合)-适配器(SimpleAdapter)-视图界面(GridView),加载适配器-配置监听器(OnItemClickListen ...

- 32位的Win7系统下安装64位的Sql Sever?

来自:http://zhidao.baidu.com/link?url=nQBoaLgoOyYCUdI7V4WZCMlTW3tKscdkOnLTIvlYtPpwoVhQkSahq44HeofBfzFT ...

- HDU1892二维树状数组

See you~ Time Limit: 5000/3000 MS (Java/Others) Memory Limit: 65535/32768 K (Java/Others)Total Su ...

- 条件查询,有input和select框,当查询条件获取焦点时支持摁下enter键查询

<%@ page language="java" contentType="text/html; charset=UTF-8" pageEncoding= ...

- 2_STL容器

STL算法的精髓在于 算法的 返回值!!! String: string是STL的字符串类型,通常用来表示字符串:C语言中一般用char* char*字符指针;string是类封装了char*,管 ...

- 四则运算之C++实现篇

对四则运算的一些要求如下: 1.题目避免重复:2.可定制(数量/打印方式):3.可以控制下列参数: 是否有乘除法.数值范围.加减有无负数.除法有无余数.否支持分数 (真分数, 假分数, …): 一 ...

- PG, Pool之间的一些数量关系

先说一下我的环境: Ceph cluster中包含6台OSD节点 (osd.0 - 5), 一共有10个Pool (0 - 9), 这些Pool共享了144个PG (这个数字是所有Pool的PG_SI ...

- mysql5.5手册读书日记(3)

<?php /* MySQL_5.5中文参考手册 587开始 与GROUP BY子句同时使用的函数和修改程序 12.10.1. GROUP BY(聚合)函数 12.10.2. GROUP BY修 ...

- fio

h3.western { font-family: "Liberation Sans", sans-serif; font-size: 14pt } h3.cjk { font-f ...