tensorFlow(四)浅层神经网络

tensorFlow见基础

实验

MNIST数据集介绍

60000个已经标注了的训练集,还有10000个用于测试的测试集。

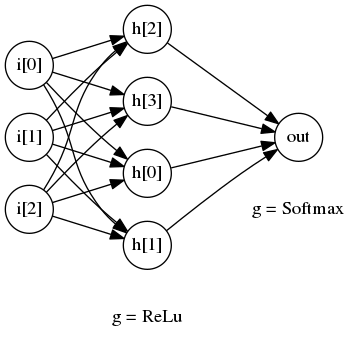

- 上图所示的是一个只有一层隐藏层的浅层神经网络

- 我们有3个输入层节点,分别对应

i[1]i[2]i[3] - 隐藏层有4个节点,分别对应

h[0]h[1]h[2]h[3],对应的激活函数为ReLu函数 - 对于典型的

二分类任务,我们只需要1个输出节点,就是out节点,对应的激活函数是softmax函数

激活函数定义(activation function):

模型设计

MNIST数据一共有784个输入,所以我们需要一个有784个节点的输入层。- 对于中间层,我们设置为

784个节点,使用的激活函数为ReLu MNIST数据使用One-Hot格式输出,有0-910个label,分别对应是否为数字0-9,所以我们在输出层有10个节点,由于0-9的概率是互斥的,我们使用 Softmax 函数作为该层的激活函数

数据准备

MNIST的数据集。使用以下的命令进行下载:wget https://devlab-1251520893.cos.ap-guangzhou.myqcloud.com/t10k-images-idx3-ubyte.gz

wget https://devlab-1251520893.cos.ap-guangzhou.myqcloud.com/t10k-labels-idx1-ubyte.gz

wget https://devlab-1251520893.cos.ap-guangzhou.myqcloud.com/train-images-idx3-ubyte.gz

wget https://devlab-1251520893.cos.ap-guangzhou.myqcloud.com/train-labels-idx1-ubyte.gz

实例代码

import numpy as np

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data def add_layer(inputs, in_size, out_size, activation_function=None):

W = tf.Variable(tf.random_normal([in_size, out_size]))

b = tf.Variable(tf.zeros([1, out_size]) + 0.01) Z = tf.matmul(inputs, W) + b

if activation_function is None:

outputs = Z

else:

outputs = activation_function(Z) return outputs if __name__ == "__main__": MNIST = input_data.read_data_sets("./", one_hot=True) learning_rate = 0.05

batch_size = 128

n_epochs = 10 X = tf.placeholder(tf.float32, [batch_size, 784])

Y = tf.placeholder(tf.float32, [batch_size, 10]) l1 = add_layer(X, 784, 1000, activation_function=tf.nn.relu)

prediction = add_layer(l1, 1000, 10, activation_function=None) entropy = tf.nn.softmax_cross_entropy_with_logits(labels=Y, logits=prediction)

loss = tf.reduce_mean(entropy) optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss) init = tf.initialize_all_variables() with tf.Session() as sess:

sess.run(init) n_batches = int(MNIST.train.num_examples/batch_size)

for i in range(n_epochs):

for j in range(n_batches):

X_batch, Y_batch = MNIST.train.next_batch(batch_size)

_, loss_ = sess.run([optimizer, loss], feed_dict={X: X_batch, Y: Y_batch})

if j == 0:

print "Loss of epochs[{0}] batch[{1}]: {2}".format(i, j, loss_) # test the model

n_batches = int(MNIST.test.num_examples/batch_size)

total_correct_preds = 0

for i in range(n_batches):

X_batch, Y_batch = MNIST.test.next_batch(batch_size)

preds = sess.run(prediction, feed_dict={X: X_batch, Y: Y_batch})

correct_preds = tf.equal(tf.argmax(preds, 1), tf.argmax(Y_batch, 1))

accuracy = tf.reduce_sum(tf.cast(correct_preds, tf.float32)) total_correct_preds += sess.run(accuracy) print "Accuracy {0}".format(total_correct_preds/MNIST.test.num_examples)

代码讲解

add_layer 函数

input_size, 本层的节点个数作为output_size, 并指定激活函数activation_function 可以看到我们调用的时候位神经网络添加了隐藏层1和输出层Loss of epochs[0] batch[0]: 219.555664062

Loss of epochs[1] batch[0]: 4.43757390976

Loss of epochs[2] batch[0]: 6.34549808502

Loss of epochs[3] batch[0]: 4.51894617081

Loss of epochs[4] batch[0]: 1.93666791916

Loss of epochs[5] batch[0]: 1.16164898872

Loss of epochs[6] batch[0]: 2.4195971489

Loss of epochs[7] batch[0]: 0.164100989699

Loss of epochs[8] batch[0]: 2.35461592674

Loss of epochs[9] batch[0]: 1.77732157707

Accuracy 0.9434

可以看到经过10轮的训练,准确度大约在94%左右

tensorFlow(四)浅层神经网络的更多相关文章

- Tensorflow MNIST浅层神经网络的解释和答复

本系列文章由 @yhl_leo 出品,转载请注明出处. 文章链接: http://blog.csdn.net/yhl_leo/article/details/51416540 看到之前的一篇博文:深入 ...

- deeplearning.ai 神经网络和深度学习 week3 浅层神经网络 听课笔记

1. 第i层网络 Z[i] = W[i]A[i-1] + B[i],A[i] = f[i](Z[i]). 其中, W[i]形状是n[i]*n[i-1],n[i]是第i层神经元的数量: A[i-1]是第 ...

- deeplearning.ai 神经网络和深度学习 week3 浅层神经网络

1. 第i层网络 Z[i] = W[i]A[i-1] + B[i],A[i] = f[i](Z[i]). 其中, W[i]形状是n[i]*n[i-1],n[i]是第i层神经元的数量: A[i-1]是第 ...

- Andrew Ng - 深度学习工程师 - Part 1. 神经网络和深度学习(Week 3. 浅层神经网络)

=================第3周 浅层神经网络=============== ===3..1 神经网络概览=== ===3.2 神经网络表示=== ===3.3 计算神经网络的输出== ...

- 吴恩达《深度学习》-第一门课 (Neural Networks and Deep Learning)-第三周:浅层神经网络(Shallow neural networks) -课程笔记

第三周:浅层神经网络(Shallow neural networks) 3.1 神经网络概述(Neural Network Overview) 使用符号$ ^{[

- 矩池云 | 搭建浅层神经网络"Hello world"

作为图像识别与机器视觉界的 "hello world!" ,MNIST ("Modified National Institute of Standards and Te ...

- ng-深度学习-课程笔记-4: 浅层神经网络(Week3)

1 神经网络概览( Neural Networks Overview ) 先来快速过一遍如何实现神经网络. 首先需要输入特征x,参数w和b,计算出z,然后用激活函数计算出a,在神经网络中我们要做多次这 ...

- [DeeplearningAI笔记]神经网络与深度学习3.2_3.11(激活函数)浅层神经网络

觉得有用的话,欢迎一起讨论相互学习~Follow Me 3.2 神经网络表示 对于一个由输入层,隐藏层,输出层三层所组成的神经网络来说,输入层,即输入数据被称为第0层,中间层被称为第1层,输出层被称为 ...

- 基于MNIST数据集使用TensorFlow训练一个没有隐含层的浅层神经网络

基础 在参考①中我们详细介绍了没有隐含层的神经网络结构,该神经网络只有输入层和输出层,并且输入层和输出层是通过全连接方式进行连接的.具体结构如下: 我们用此网络结构基于MNIST数据集(参考②)进行训 ...

随机推荐

- CDN和智能DNS原理和应用 (原)

CDN是什么? CDN的全称是Content Delivery Network,即内容分发网络. CDN是构建在网络之上的内容分发网络,依靠部署在各地的边缘服务器,通过中心平台的负载均衡.内容分发.调 ...

- windows程序设计 创建一个新的窗口

#include <windows.h> LRESULT CALLBACK myProc(HWND, UINT, WPARAM, LPARAM); int WINAPI WinMain(H ...

- linux关闭终端响铃

title: linux关闭终端响铃 date: 2018-01-25 15:10:14 tags: linux categories: linux 在终端输入或是直接在.bashrc里添加一行 xs ...

- 基于Groovy+HttpRestful的超轻量级的接口测试用例配置的设计方案及DEMO实现

目标 设计一个轻量级测试用例框架,接口测试编写者只需要编写测试用例相关的内容(入参及结果校验),不需要理会系统的实现,不需要写跟测试校验无关的内容. 思路 测试用例分析 一个用例由以下部分组成: (1 ...

- 『Numpy』np.meshgrid

生成网格坐标,一个很好的说明图如下: 虽然xy双坐标比较常用,但实际上其输入可以是任意多的数组,输出数组数目等于输出数组数目,且彼此间shape一致. 如果输入数组不是一维的,会拉伸为1维进行计算. ...

- mysql 存储session

https://www.cnblogs.com/cndavidwang/p/3930619.html

- STATS 326 Applied Time Series

STATS 326Applied Time SeriesASSIGNMENT THREEDue: 2 May 2019, 11.00 am(Worth 6% of your final grade)H ...

- opencv学习之路(30)、分水岭算法及图像修补

一.简介 二.分水岭算法 #include "opencv2/opencv.hpp" using namespace cv; void main() { Mat srcImg = ...

- i.MX6UL -- PWM用户空间使用方法【转】

本文转载自:https://blog.csdn.net/u014486599/article/details/53010114 i.MX6UL -- PWM用户空间使用方法 开发平台: 珠海鼎芯D51 ...

- MyBatis进阶(三)

MyBatis批量新增数据 1. 传统的JDBC批量插入数据 使用for循环 创建连接 获取连接 创建sql语句,交给连接 使用for循环新增数据 提交连接 使用批处理 两者都存在严重的效率问题,代码 ...