自己如何在本地电脑从零搭建DeepSeek!手把手教学,快来看看! (建议收藏)

在人工智能飞速发展的今天,大语言模型的应用越来越广泛。DeepSeek 作为近期爆火的一款大语言模型,受到了众多开发者的青睐。

今天这篇内容,就来聊聊,如何在本地自己的电脑上部署DeepSeek。

1、哪些场景适合将大模型部署在自己电脑上?

先说结论: 虽说将大模型部署在自己的电脑上,有很多好处,但万不得已,并不推荐个人搞本地部署(钱多或企业除外)。对于普通用户来讲,只是日常简单的使用AI,直接使用市面上主流的云AI工具就足够了。

那在哪些情况下,需要或者适合将大模型(如DeepSeek)部署在自己的电脑上呢?

1、追求极致数据隐私与安全性

- 当处理高度敏感的数据,如医疗记录、商业机密或个人隐私信息时,将大模型部署在本地电脑,可确保数据不会传输到外部服务器,从根本上保障数据的安全性和隐私性。例如,医疗研究人员在分析患者的基因数据时,本地部署能避免数据泄露风险。

- 保护敏感数据: 本地部署可以确保所有数据的处理和存储都在本地完成,不会上传到云端,从而有效避免数据在传输和云端存储过程中可能带来的隐私泄露风险。

- 完全掌控数据: 用户可以完全控制数据的使用和存储,确保数据不被未经授权的访问或用于其他目的。

2、个性化定制需求强烈(高度定制、灵活性)

- 对于一些专业领域,如特定行业的知识问答、代码生成等,开发者可以基于本地部署的大模型进行微调,使其更好地满足特定场景需求。例如,软件开发团队可以针对自身的代码规范和业务逻辑,对大模型进行优化,提升代码生成的准确性和实用性。

- 自定义知识库训练: 用户可以根据自己的需求对模型进行自定义知识库训练,进一步提升模型在特定领域的性能。

- 灵活调整模型参数: 本地部署允许用户根据业务需求灵活调整模型参数和功能,满足不同场景下的个性化需求。

- 开源灵活性: 开源模型(如DeepSeek)允许用户无限制地进行微调或将其集成到自己的项目中

3、成本与资源优化(适合企业内)

- 成本可控: 长期使用本地部署比持续使用云服务更具成本效益,尤其适合高频调用场景。

- 硬件友好: DeepSeek等大模型对硬件资源要求较低,可在较少GPU或高级CPU集群上运行,资源效率显著。

4、个人兴趣与学习、研究目的

学生、研究人员想要深入了解大模型的运行机制、进行算法实验或者开展模型优化研究,本地部署提供了一个可以自由探索和调试的环境。通过在自己电脑上部署模型,能够更直观地观察模型的运行过程,为学术研究提供便利。

技术探索: 对于技术爱好者和研究人员来说,本地部署可以提供一个更自由的实验环境,方便进行模型的测试和优化。

教育用途: 教育机构可以利用本地部署的大模型进行教学和研究,无需依赖外部服务。

总之,本地部署大模型适合那些对数据隐私、定制化、成本控制有较高要求的用户和企业。

2、准备工作

1、电脑配置:确保你的电脑具备一定的硬件性能,至少拥有 8GB 及以上的运行内存和足够的硬盘空间。如果有英伟达显卡,部署和运行会更加流畅。

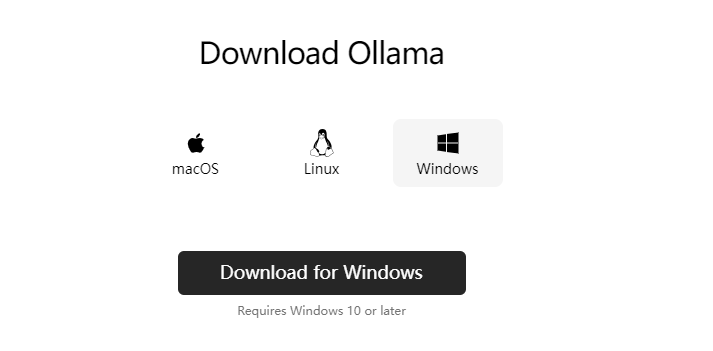

2、下载 ollama:你可以在 ollama 的官方网站(https://ollama.ai/)上找到对应你操作系统(Windows、MacOS 或 Linux)的安装包,下载并安装。

简单来说,如果你的电脑配置满足最低要求(如8GB内存以上),就可以通过工具(如Ollama)轻松实现本地部署DeepSeek。

实践是检验真理的唯一标准,话不多说,开干。

3、本地电脑部署DeepSeek大模型具体步骤

1、安装ollama

1、本地部署首先要安装ollama,ollama 是一个用于在本地运行大语言模型的工具,它能让你在自己的电脑上轻松部署和使用各类模型。你可以把它理解为,一个装AI的盒子,把AI装在盒子里,方便管理。

访问ollama下载地址:https://ollama.com/download

根据自己的电脑类型,选择不同版本。

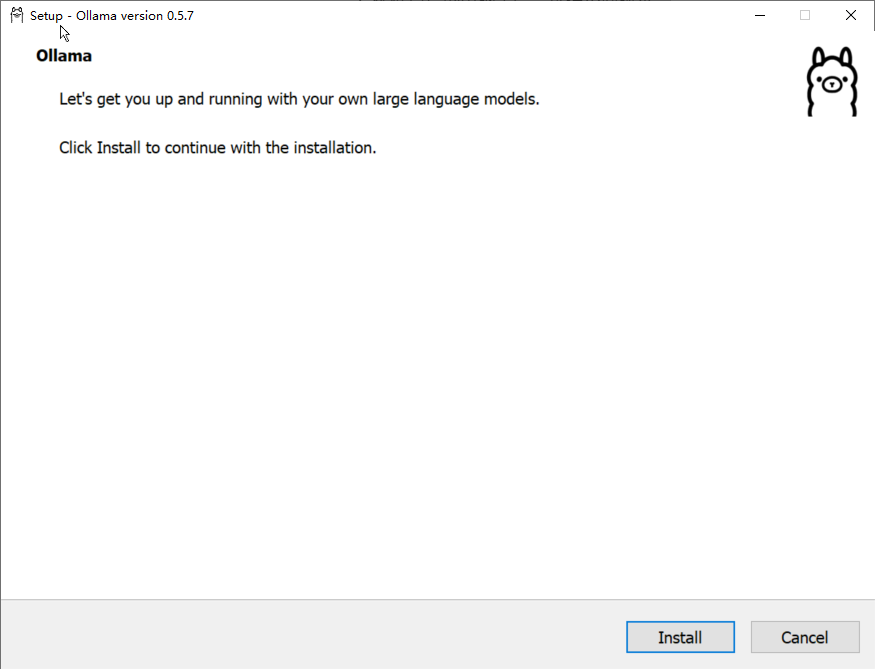

2、接下来以Windows为例,下载好安装后,双击安装。(傻瓜式安装即可)

安装完成后,ollama会在后台运行,任务栏会出现一个类似羊驼的图标。

2、选择要安装的模型

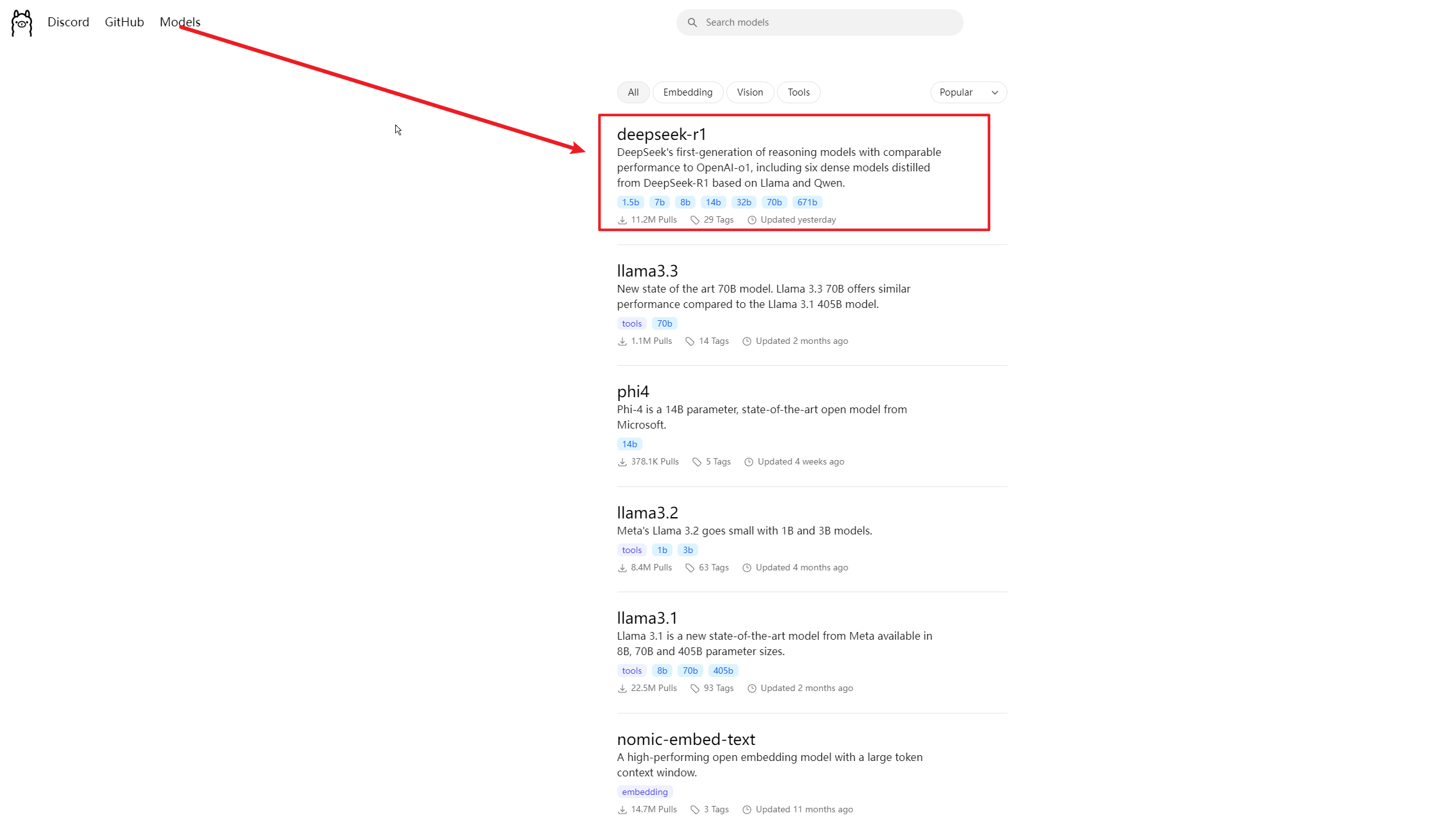

1、访问https://ollama.com/search,选择要安装的模型

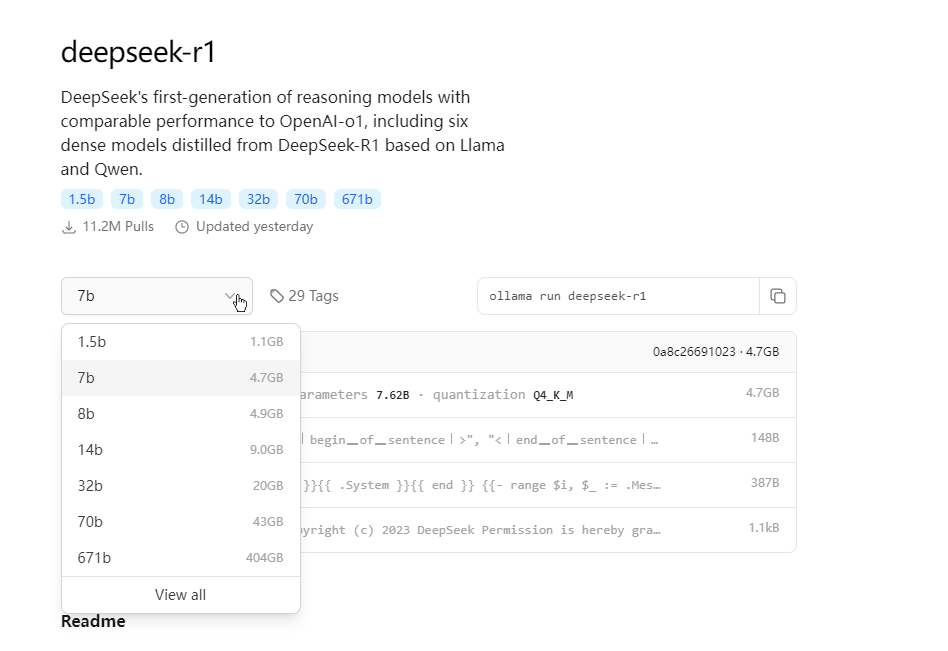

2、点击选择deepseek-r1,进入模型参数界面

这里的数字越大,参数越多,性能越强,所需要的配置也就越高,1.5b代表模型具备15亿参数。

例如,若要运行14b参数模型,需要大约11.5G显存。也就是你的电脑显卡最好要达到16G。

若个人学习用途,一般建议安装最小的1.5b版本即可。大多数的个人电脑配置都能跑的起来。具体大家可以根据自己的电脑性能选择。

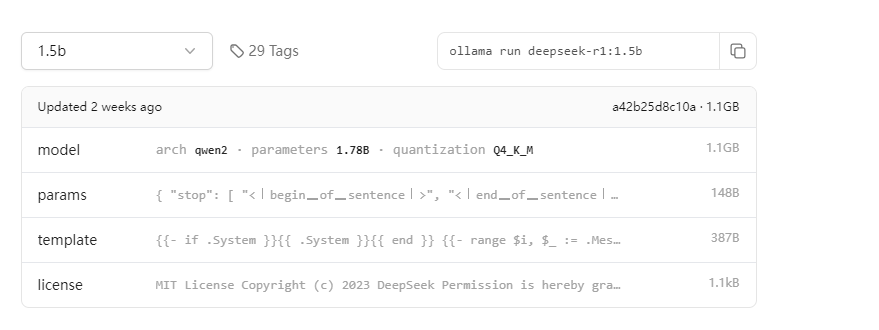

3、以1.5b参数为例,选择1.5b参数后,复制红框中的命令ollama run deepseek-r1:1.5b。

详细地址: https://ollama.com/library/deepseek-r1:1.5b

3、安装模型

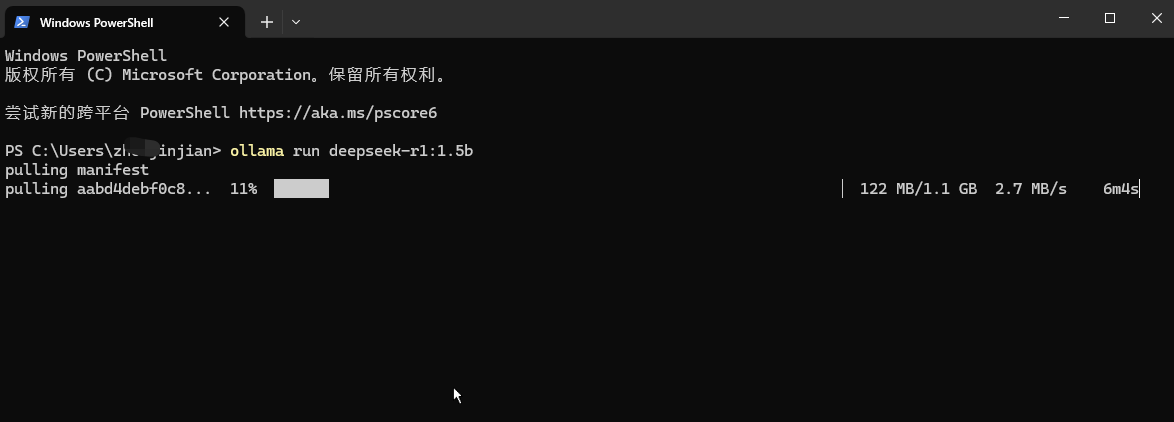

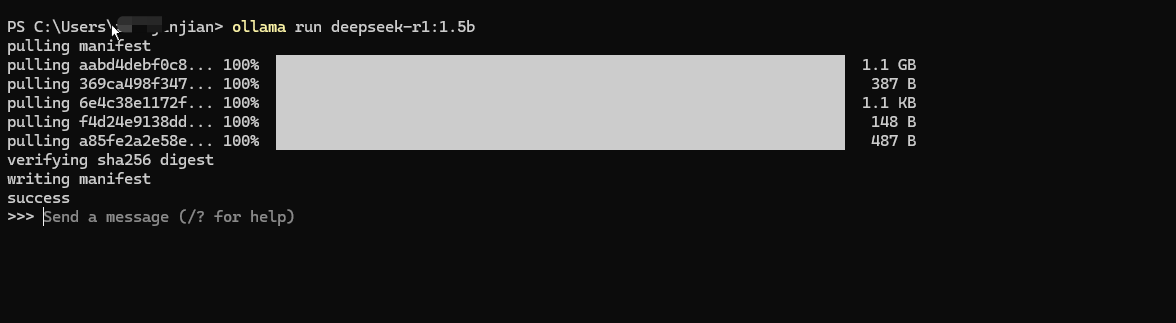

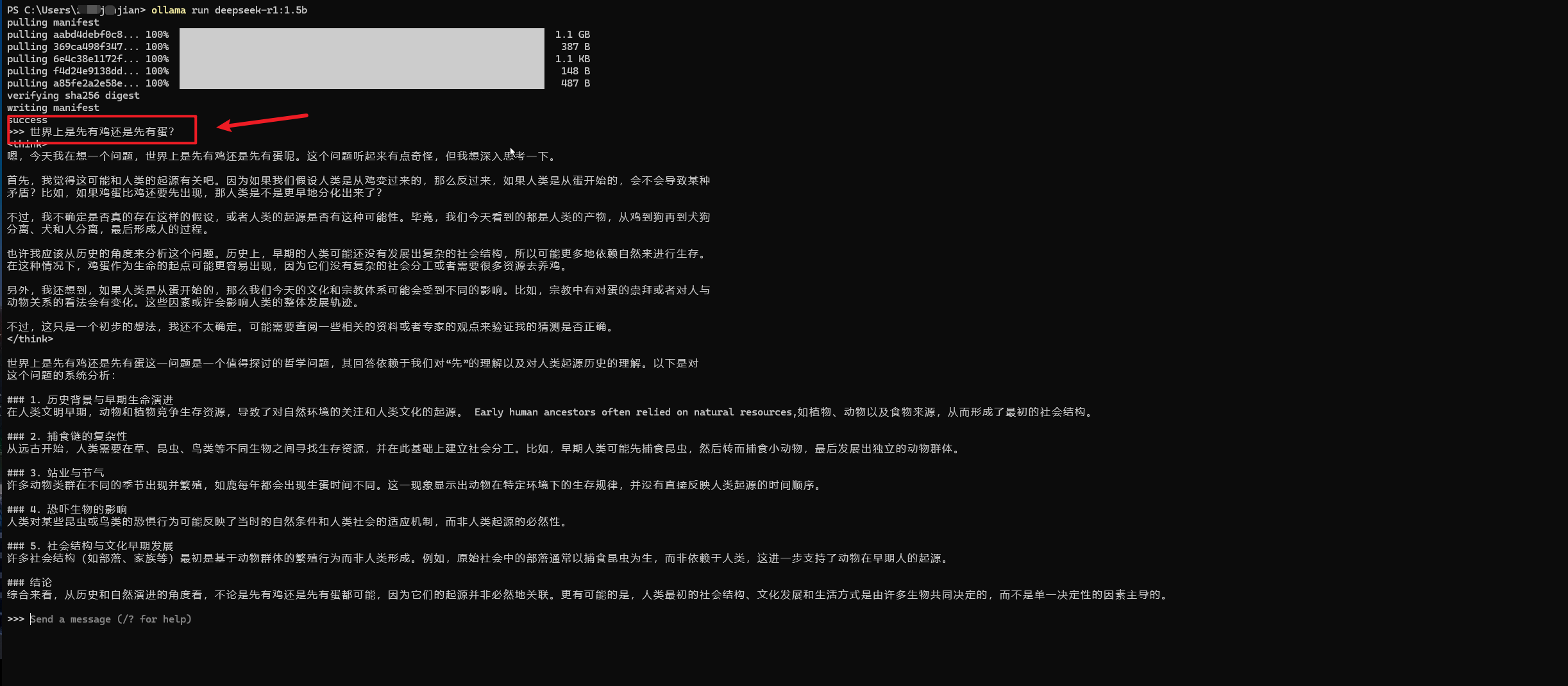

1、打开命令行,在命令行中输入:ollama run deepseek-r1:1.5b

2、下载成功后,就可以与模型对话啦。

此时大模型安装在你的电脑上,就算断网也可以继续用,再也不用担心数据泄露了。

4、使用模型

安装好模型后,此时我们可以通过命令行的方式,在命令行中发送消息来与DeepSeek 大模型对话。

1、例如我的第一个问题是:"世界上是先有鸡还是先有蛋?"

对于这个问题,回答的还可以,果然是推理型模型,思考的过程也给我们列出来了。

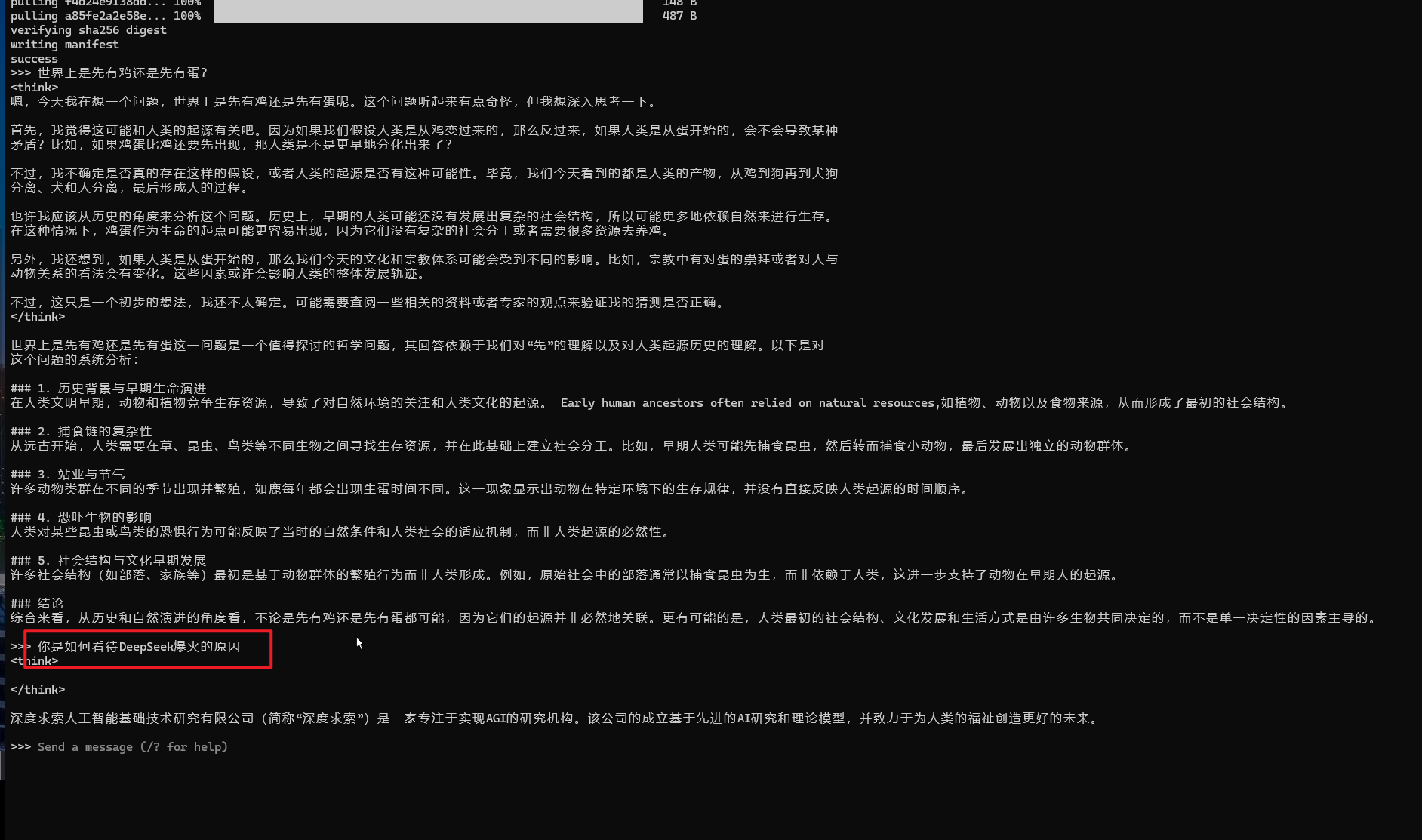

2、我的第二个问题是:”你是如何看待DeepSeek爆火的原因“?

这个问题,回答的就太过于敷衍了,直接将DeepSeek的公司背书给出来了,当然也可以理解,毕竟DeepSeek的投喂数据都是几个月前的,那时,它还并没有爆火出圈,而且我们下载的还是最小阉割版模型。

3、这里还有一个问题,当你关闭电脑后,下次若再想使用本地模型时,只需要启动了ollama,

同时打开命令行界面,输入ollama run deepseek-r1:1.5b 即可。因为你之前已经下载过,这次无需下载,可以直接和模型聊天。

5、为本地模型搭建UI界面

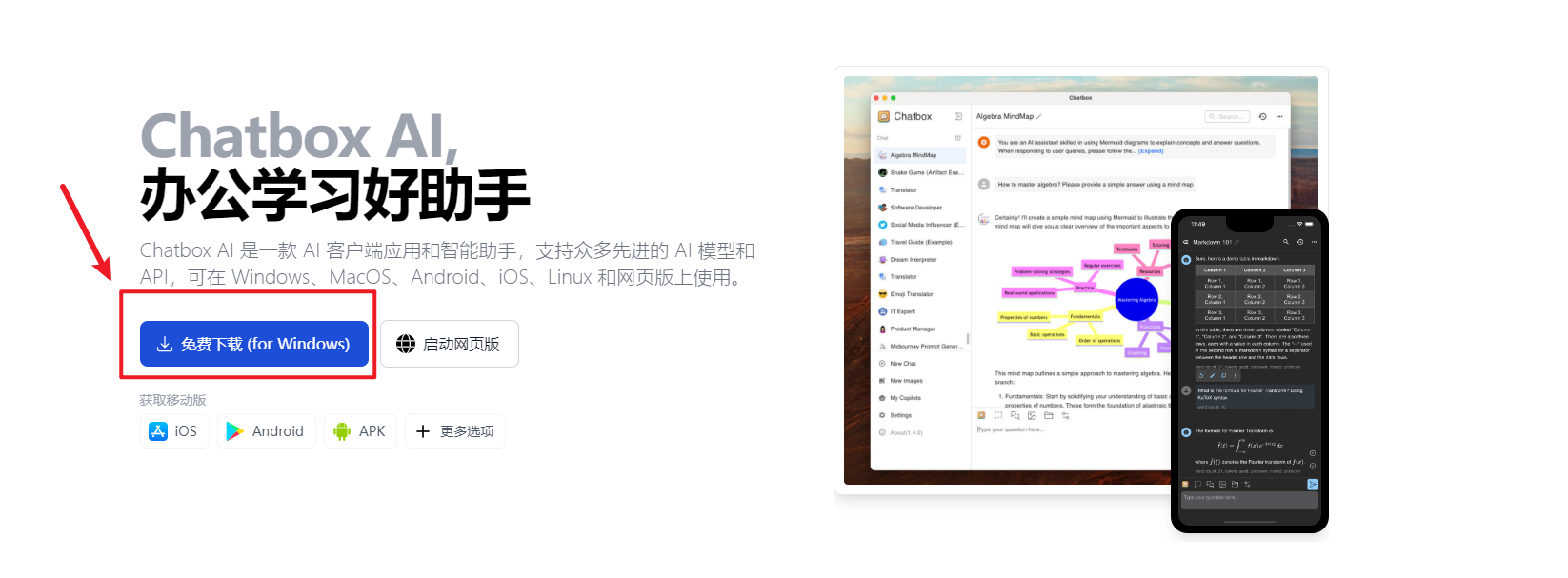

1、使用命令行方式来和模型对话,对于不会编程的小伙伴来说,太难受了。不过没关系,我们有很多方案可以为你的本地模型搭建UI界面,比如Open-WebUI、Chatbox AI等。

2、这里我们以ChatBox AI为例,访问:https://chatboxai.app/zh

选择对应的版本,下载安装。

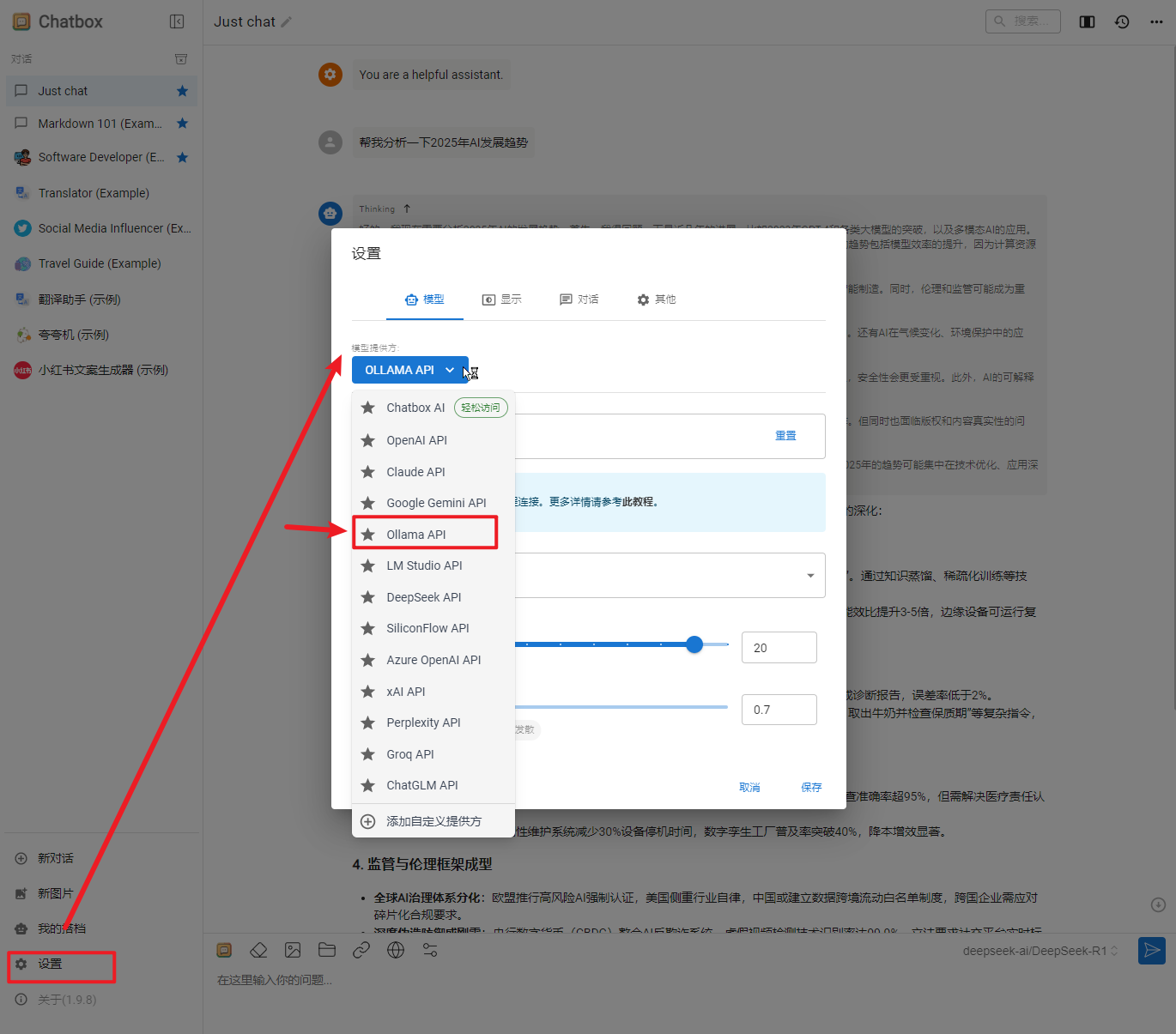

3、选择使用自己的 API Key 或者本地模型:

4、选择本地跑的 deepseek-r1:1.5b模型:

Ollama 默认使用 端口11434 提供本地服务。当你在本地运行 Ollama 时,可以通过以下地址访问其 API 服务:

http://localhost:11434

如果你需要更改默认端口,可以通过设置环境变量 OLLAMA_HOST 来指定新的端口。

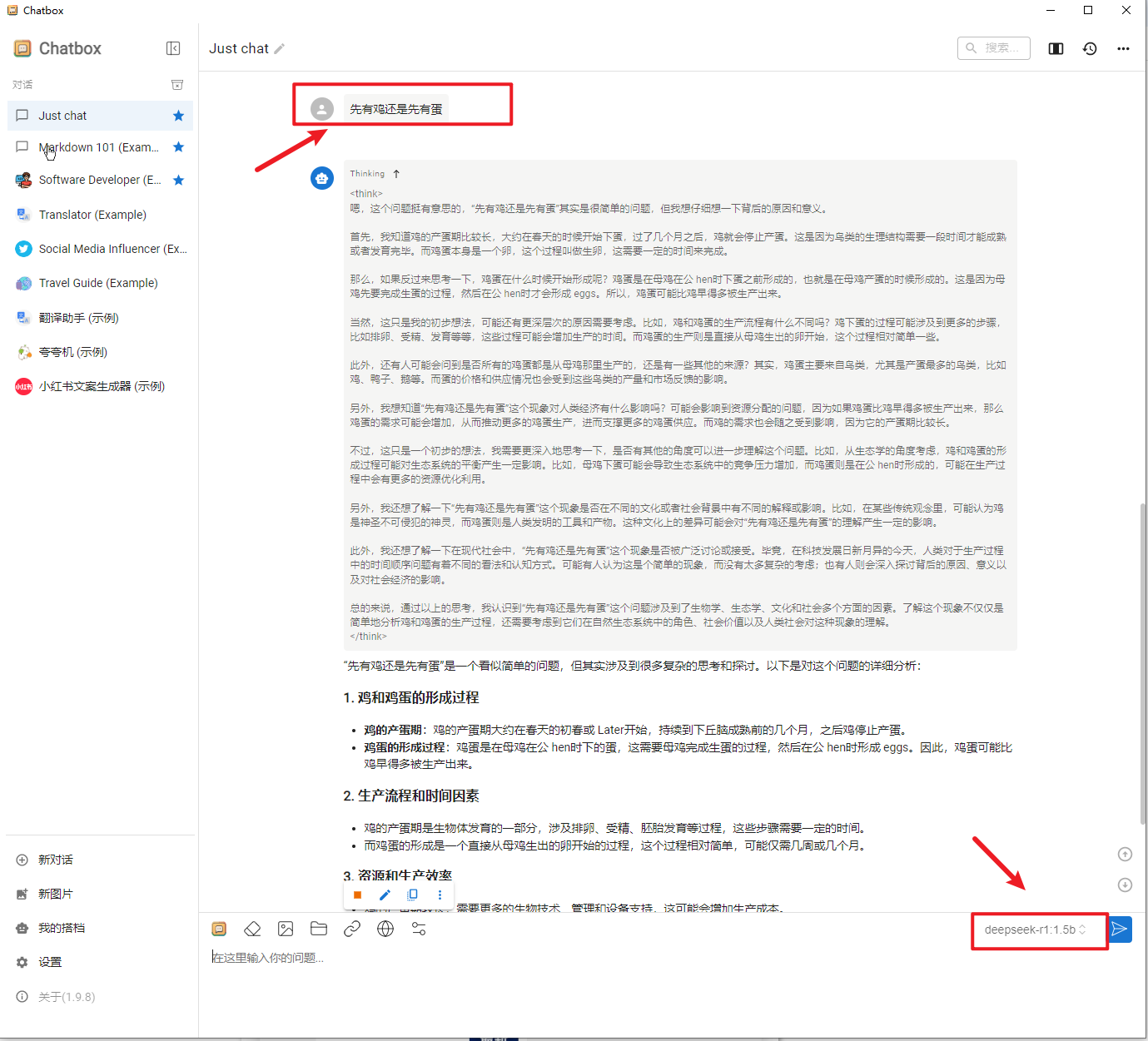

5、在ChatBox对话框中,输入:”先有鸡还是先有蛋“,即可调用本地模型,生成答案

至此,简单几步,在你的本地电脑上就安装运行起来了 DeepSeek R1。

好了,今天先就分享到这里,下一篇我们来好好聊一聊关于ollama是个啥。

另,组建了两个知识星球:「DeepSeek创智研习社」、「AI副业俱乐部」,专注于AI领域,一个是永久免费开放,分享AI 领域的前沿资讯、工具、资料与DeepSeek使用技巧,一个需要门票(一杯春天的奶茶),专注AI+创作×提效×商业变现闭环,欢迎在研究或在实践的你,一起交流共创,添加作者微信762357658,备注【加入知识星球】或公众号后台回复「AI」邀请加入。

自己如何在本地电脑从零搭建DeepSeek!手把手教学,快来看看! (建议收藏)的更多相关文章

- 如何在阿里云服务器搭建FTP服务器,在本地电脑连接并操作

首先你需要有一个阿里云的ECS服务器 并且开通了公网宽带(话说也不贵,开来玩玩还是可以的,第一次买会比较便宜,第二次买1M的宽带两天是九毛多吧~) 开通了宽带之后,ECS服务器就可以上网了 如果嫌弃阿 ...

- 从零搭建java后台管理系统(二)mysql和redis安装

接上篇开始安装mysql和redis 注意了,如果用阿里云服务器,外网访问的端口必须在安全组开启,否则外网访问不通 三.服务器安装redis和mysql 本次环境搭建将所有第三方服务会安装在阿里云服务 ...

- 从零搭建docker+jenkins 自动化部署环境

从零搭建docker+jenkins+node.js自动化部署环境 本次案例基于CentOS 7系统 适合有一定docker使用经验的人阅读 适合有一定linux命令使用经验的人阅读 1.docker ...

- 从零搭建一个SpringCloud项目之Feign搭建

从零搭建一个SpringCloud项目之Feign搭建 工程简述 目的:实现trade服务通过feign调用user服务的功能.因为trade服务会用到user里的一些类和接口,所以抽出了其他服务需要 ...

- 从零搭建一个IdentityServer——项目搭建

本篇文章是基于ASP.NET CORE 5.0以及IdentityServer4的IdentityServer搭建,为什么要从零搭建呢?IdentityServer4本身就有很多模板可以直接生成一个可 ...

- 以Aliyun体验机为例,从零搭建LNMPR环境(下)

使用云服务器搭建 Web 运行环境,尤其是搭建常见的 LNMPR(Linux+Nginx+MySQL+PHP+Redis) 环境,对于开发人员是必备的职场基本技能之一.在这里,借着搭建我的" ...

- 从零搭建react hooks项目(github有源代码)

前言 首先这是一个react17的项目,包含项目中常用的路由.状态管理.less及全局变量配置.UI等等一系列的功能,开箱即用,是为了以后启动项目方便,特地做的基础框架,在这里分享出来. 这里写一下背 ...

- 如何在本地电脑安装phpmyadmin及访问地址

因为要安装wordpress,上网查了下安装wordpress前要安装phpmyadmin,前提是要在自己本地电脑上安装APMSeverx虚拟主机才可以,在本地访问phpmyadmin页面.下面的步骤 ...

- 本地Git服务器的搭建及使用

本地Git服务器的搭建及使用 Git本地服务器环境搭建 搭建好的本地git服务器的局域网ip是192.168.1.188,用户名是RSCSVN 教程链接:http://blog.csdn.net/cc ...

- unset是不能清除保存在本地电脑上的cookie的,用于session就可以(弄了半天原来是这样)

unset($_COOKIE["historyWord[$wordId]"]); 这样是不行的,unset只是将变量在脚本运行时注销,但是cookie是写在客户端的,下一次还是可以 ...

随机推荐

- 基于golang的swagger

Swagger 相关的工具集会根据 OpenAPI 规范去生成各式各类的与接口相关联的内容,常见的流程是编写注解 =>调用生成库->生成标准描述文件 =>生成/导入到对应的 Swag ...

- Springboot优雅读配置文件

转载自Springboot优雅读配置文件 很多时候我们需要将一些常用的配置信息比如阿里云oss配置.发送短信的相关信息配置等等放到配置文件中. 下面我们来看一下 Spring 为我们提供了哪些方式帮助 ...

- springgateway 路由转发

有些情况下,我们希望不直接访问后端地址,这个时候可以通过springgateway网关进行处理.下面只是一个简单的例子. 至于URL,变化,我们可以通过编写程序逻辑来实现. 实现步骤: 1.新建项目 ...

- 前端每日一知之让Chrome支持小于12px的文字

脑图在线链接 本文内容依据[js每日一题]公众号精彩文章总结而来

- 从FTP到Feem:文件传输技术的革新

Feem是一个开源的文件传输协议,旨在提供高效.安全.快速的文件传输服务.与传统的FTP和HTTP协议相比,Feem具有许多优势,如支持任意大小的文件传输.支持实时传输和断点续传等. Feem_v4. ...

- linux web终端wetty食用方法

学校有些机房电脑性能贼垃但又不得不去那些机房上课 我也不想带电脑,于是弄台廉价的服务器 本来想拿个公网ip配frp连我电脑完事 想到vim是在终端中运行的编辑器 于是想弄个web终端然后就找到了wet ...

- ABS函数:C语言与Excel中的绝对值计算

ABS函数:C语言与Excel中的绝对值计算 ABS函数在不同的编程和计算环境中有着相似但又有所区别的用途.在本文中,我们将重点探讨ABS函数在C语言中的应用,同时也会结合Excel中的ABS函数进行 ...

- 加密Python项目代码之把Django或Flask项目打包成exe

目录 python代码仿泄露方案 -方案一:启动起来,把源代码删除 -方案二:pipinstaller 打包成可执行文件 -方案三:做到docker镜像中--->运行容器--->-e pa ...

- 【Java】【Maven】002 修改maven仓库的路径与配置阿里云镜像仓库

[Java][Maven]001 下载与配置环境 - 萌狼蓝天 - 博客园 (cnblogs.com/mllt) 修改maven仓库的路径 maven指定的本地仓库的默认位置是在c盘,默认在:C:\U ...

- 【YashanDB知识库】Oracle pipelined函数在YashanDB中的改写

本文内容来自YashanDB官网,原文内容请见 https://www.yashandb.com/newsinfo/7802940.html?templateId=1718516 [问题分类]功能使用 ...