Spark 2.x Troubleshooting Guide

IBM在spark summit上分享的内容,包括编译spark源码,运行spark时候常见问题(缺包、OOM、GC问题、hdfs数据分布不均匀等),spark任务堆/thread dump

目录

编译spark的问题

1.正确配置相关环境,如Maven,JRE

2.显示指定你要集成的功能

3.编译速度比较慢的话,可以根据自己的环境设置多core提高速度

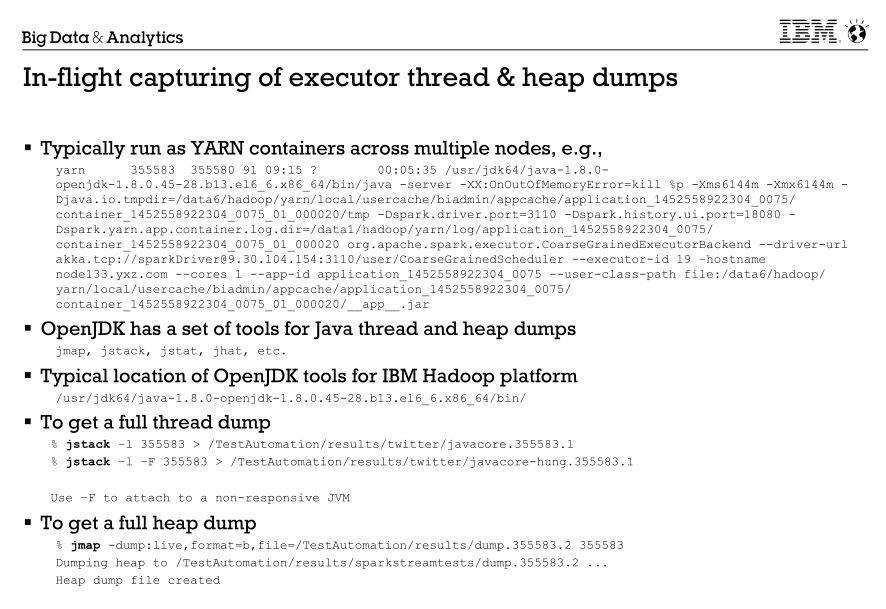

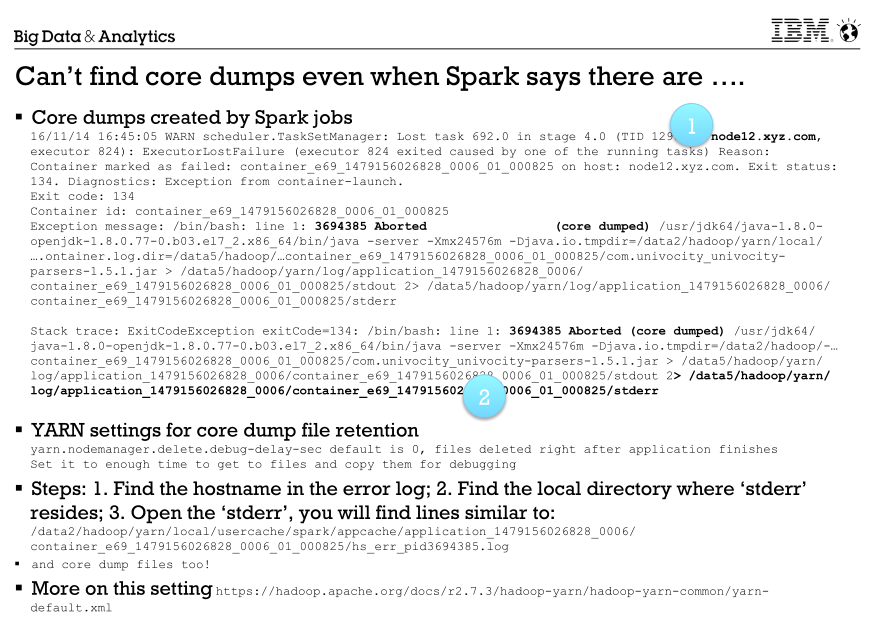

spark运行时遇到的问题

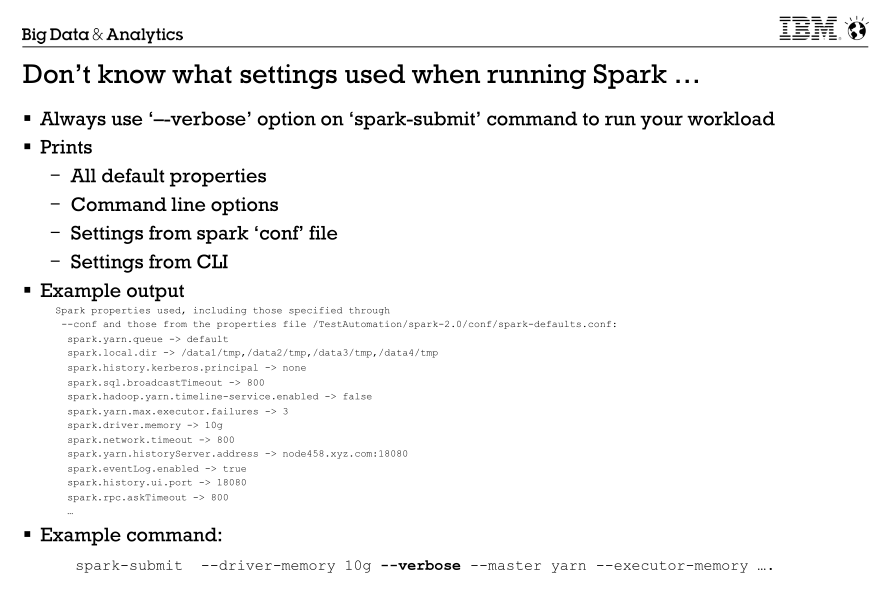

1.在不清楚spark某些配置时候,可以在spark-submit时候使用--verbose打印出当前环境具体信息

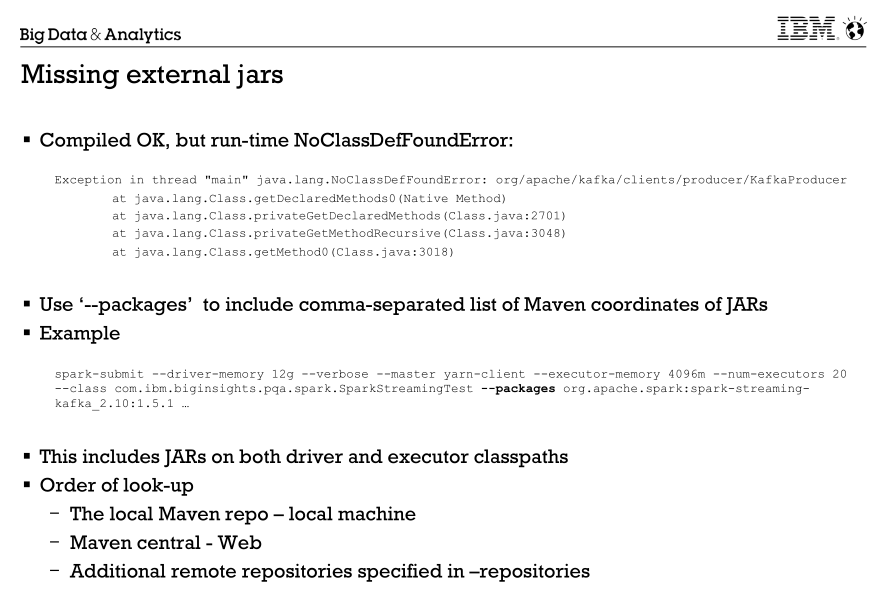

2.缺少外部jar包问题,可以使用--packages参数指定缺失的jar包,--packages会先到本地maven仓库中找指定的jar包,如果本地仓库没有,就需要外部maven仓库下载。

所以一般在生成环境,--packages不一定合适。在jar包比较少的情况下,可以通过--jars指定,比较多的话,也可以通过指定class path。这两种方式都是比较合适的

2.Spark Driver OOM,默认driver内存一般都比较小(512M),建议自己指定。这个要根据实际情况设置

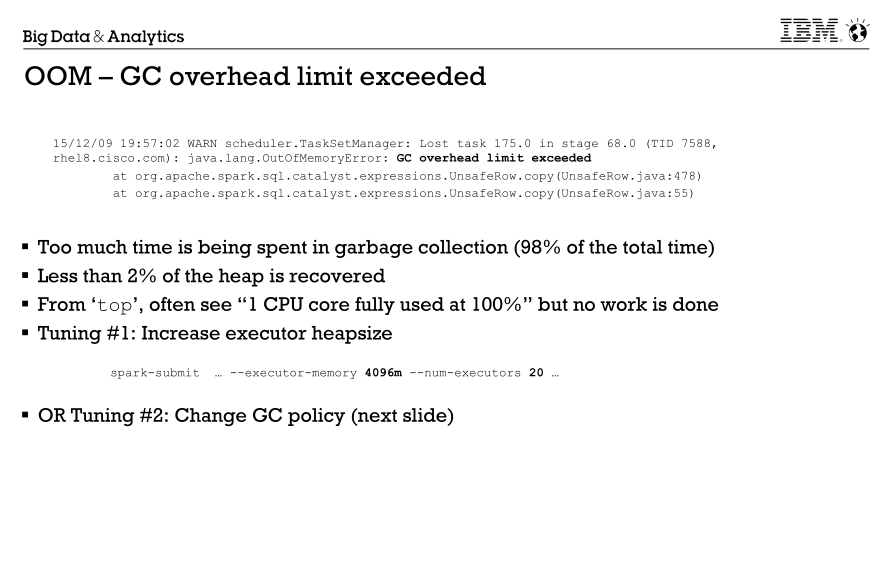

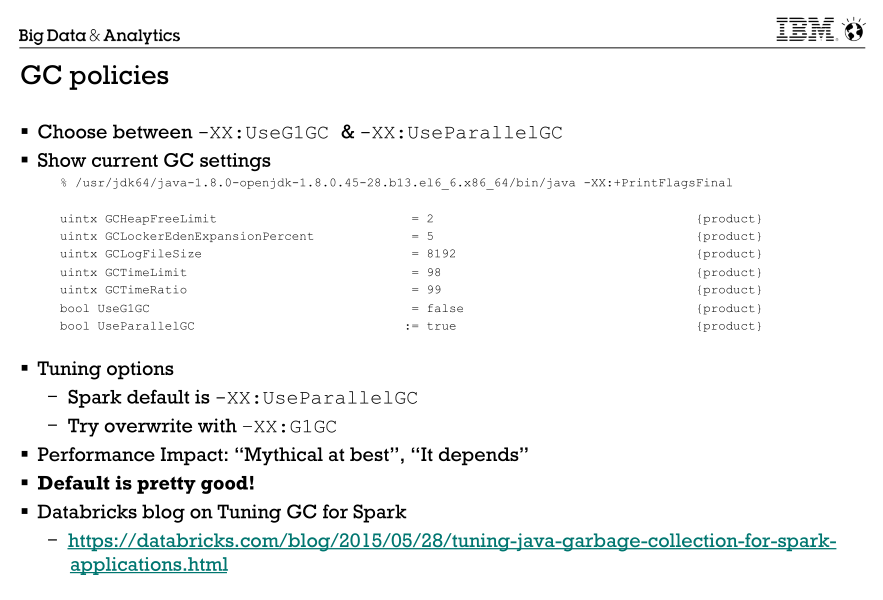

3.GC时间过长,首先应该从代码逻辑判断是否有问题,然后考虑内存是否太小,最后考虑GC算法,目前来说G1 GC是针对大堆(4G以上)首选的GC算法,databricks有一遍关于spark任务优化G1 GC的文章写的很不错,链接在下面。

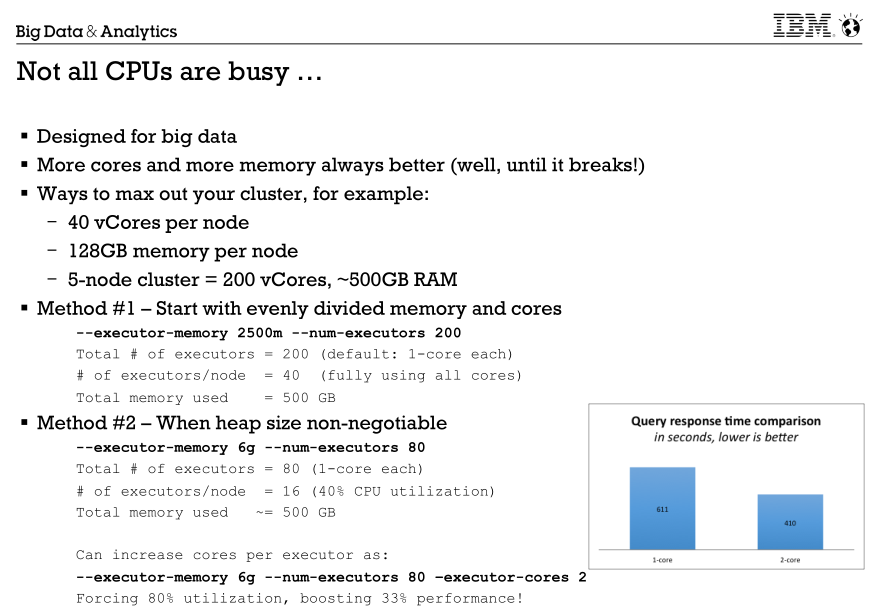

4.关于spark任务资源的问题,如何最大化利用资源

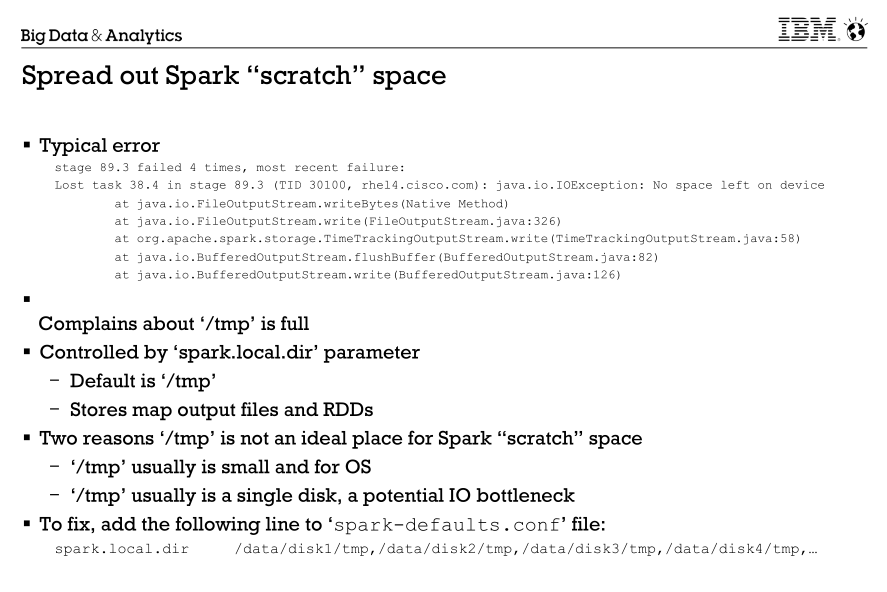

5.关于spark的"scratch" ,尽量不要使用默认的/tmp,图中描述的比较详细了。

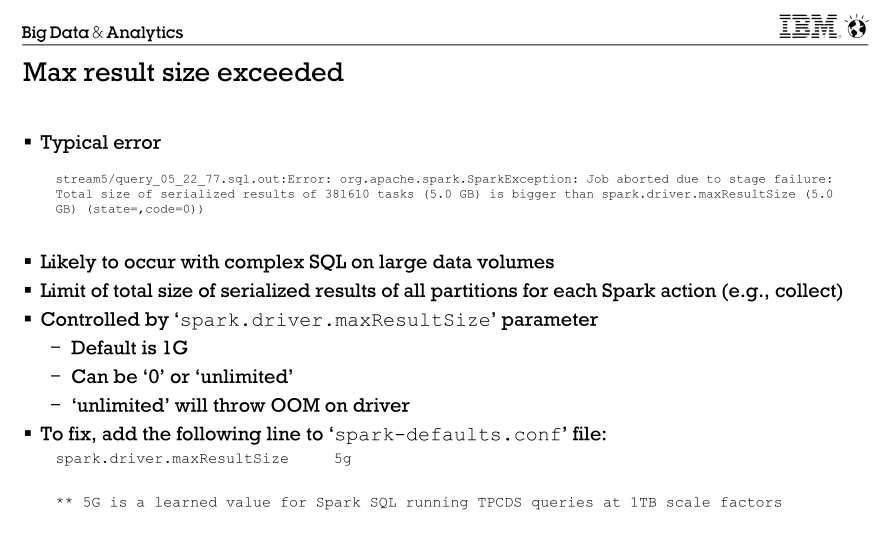

6.这种问题一般是用户在spark-sql中直接查询返回的数据量过大造成。也可能是用户应用中使用了拉取数据到driver端的API(例如:collect、show)。

解决方法:用户应该考虑拉取数据到driver端是否合理?如果不合理,增加过滤条件或者采用insert overwrite directory命令解决;如果合理,则适当增加spark.driver.maxResultSize的大小。

Spark 2.x Troubleshooting Guide的更多相关文章

- Spark SQL 之 Migration Guide

Spark SQL 之 Migration Guide 支持的Hive功能 转载请注明出处:http://www.cnblogs.com/BYRans/ Migration Guide 与Hive的兼 ...

- FNDCPASS Troubleshooting Guide For Login and Changing Applications Passwords

In this Document Goal Solution 1. Error Starting Application Services After Changing APPS Pass ...

- What To Do When MySQL Runs Out of Memory: Troubleshooting Guide

In this article, I will show you how to use the new version of MySQL (5.7+) and how to troubleshoot ...

- Spark SQL and DataFrame Guide(1.4.1)——之DataFrames

Spark SQL是处理结构化数据的Spark模块.它提供了DataFrames这样的编程抽象.同一时候也能够作为分布式SQL查询引擎使用. DataFrames DataFrame是一个带有列名的分 ...

- Spark Streaming + Kafka Integration Guide原文翻译及解析

前面写了关于kafka和spark streaming的结合使用(https://www.cnblogs.com/qfxydtk/p/11662591.html),其具体使用用法其实来自于原文:htt ...

- Java troubleshooting guide

http://www.oracle.com/technetwork/java/javase/toc-135973.html --不同的 OutOfMemoryError/内存溢出,以及相关的解决

- Troubleshooting Guide for ORA-12541 TNS: No Listener

Server side checks (not platform specific): 1) Check the result on the server using tnsping to the ...

- spark第六篇:Spark Streaming Programming Guide

预览 Spark Streaming是Spark核心API的扩展,支持高扩展,高吞吐量,实时数据流的容错流处理.数据可以从Kafka,Flume或TCP socket等许多来源获取,并且可以使用复杂的 ...

- Spark踩坑记——Spark Streaming+Kafka

[TOC] 前言 在WeTest舆情项目中,需要对每天千万级的游戏评论信息进行词频统计,在生产者一端,我们将数据按照每天的拉取时间存入了Kafka当中,而在消费者一端,我们利用了spark strea ...

随机推荐

- 「NOWCODER」CSP-S模拟赛第3场

「NOWCODER」CSP模拟赛第3场 T1 货物收集 题目 考场思路即正解 T2 货物分组 题目 考场思路 题解 60pts 算法:一维 DP 100pts 算法:一维 DP ?线段树 + 单调栈 ...

- D. Number Of Permutations 符合条件的排列种类

D. Number Of Permutations time limit per test 2 seconds memory limit per test 256 megabytes input st ...

- 布局文件中fill_parent和match_parent有什么区别?

1)fill_parent设置一个构件的布局为fill_parent将强制性地使构件扩展,以填充布局单元内尽可能多的空间.这跟Windows控件的dockstyle属性大体一致.设置一个顶部布局或控件 ...

- element ui表格表头顺序错乱的问题

因为在项目中两个表格共用了同一个组件, 但由于表头不完全相同, 就通过v-if来控制表头的显示隐藏,没想到造成了表头顺序的错乱, 经过多方查找资料,最后找到了解决方法: 即为每一列el-table-c ...

- tomcat项目已存在错误

Could not publish server configuration for Apache Tomcat v8.0-1 at localhost.Multiple Contexts have ...

- 9.2.1 hadoop mapreduce任务输出的默认排序

任务的默认排序 MapTask和ReduceTask都会默认对数据按照key进行排序,不管逻辑上是否需要.默认是按照字典顺序排序,且实现该排序的方法是快速排序.但是map和reduce任务只能保证单个 ...

- Day3-K-Can you solve this equation? HDU2199

Now,given the equation 8*x^4 + 7*x^3 + 2*x^2 + 3*x + 6 == Y,can you find its solution between 0 and ...

- 深度解析标点符号在Report写作中的应用

准确的标点符号和大写字母可以帮助Tutor准确理解report的意思.标点符号的某些方面,例如使用逗号,可以是一种个人风格,在引号中正确的标点符号是至关重要的.在前面的一些文章当中我们也给大家说了re ...

- redis集群JedisCluster连接关闭问题

JedisCluster连接关闭问题 set方法为例 //伪代码 JedisCluster jedisCluster = new JedisCluster(); jedisCluster.set(&q ...

- activity带参跳转和界面登录

首先 首先是MainActivity的xml文件 <?xml version="1.0" encoding="utf-8"?> <Linear ...