DataWorks搬站方案:Azkaban作业迁移至DataWorks

DataWorks迁移助手提供任务搬站功能,支持将开源调度引擎Oozie、Azkaban、Airflow的任务快速迁移至DataWorks。本文主要介绍如何将开源Azkaban工作流调度引擎中的作业迁移至DataWorks上。

支持迁移的Azkaban版本

支持全部版本的Azkaban迁移。

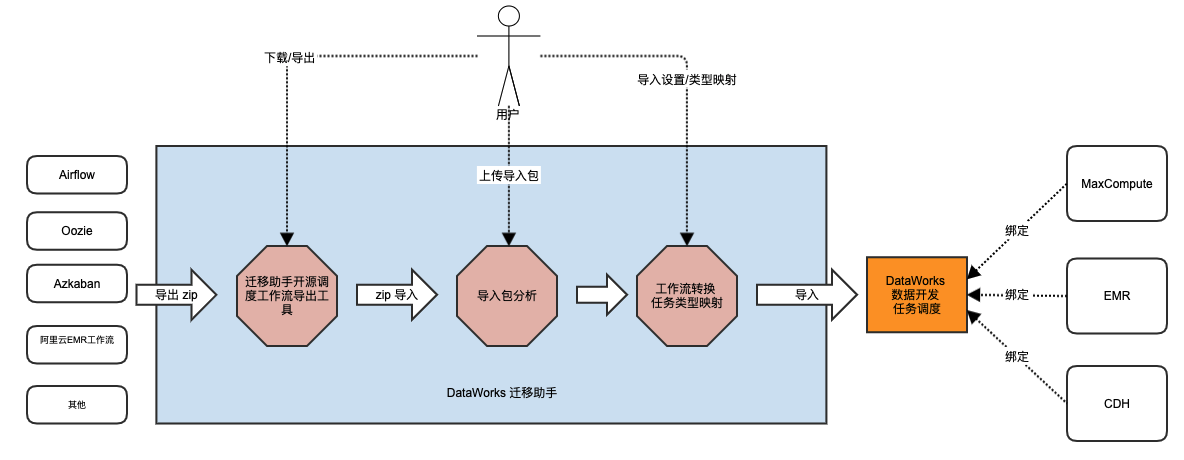

整体迁移流程

迁移助手支持开源工作流调度引擎到DataWorks体系的大数据开发任务迁移的基本流程如下图所示。

针对不同的开源调度引擎,DataWorks迁移助手会出一个相关的任务导出方案。

整体迁移流程为:通过迁移助手调度引擎作业导出能力,将开源调度引擎中的作业导出;再将作业导出包上传至迁移助手中,通过任务类型映射,将映射后的作业导入至DataWorks中。作业导入时可设置将任务转换为MaxCompute类型作业、EMR类型作业、CDH类型作业等。

Azkaban作业导出

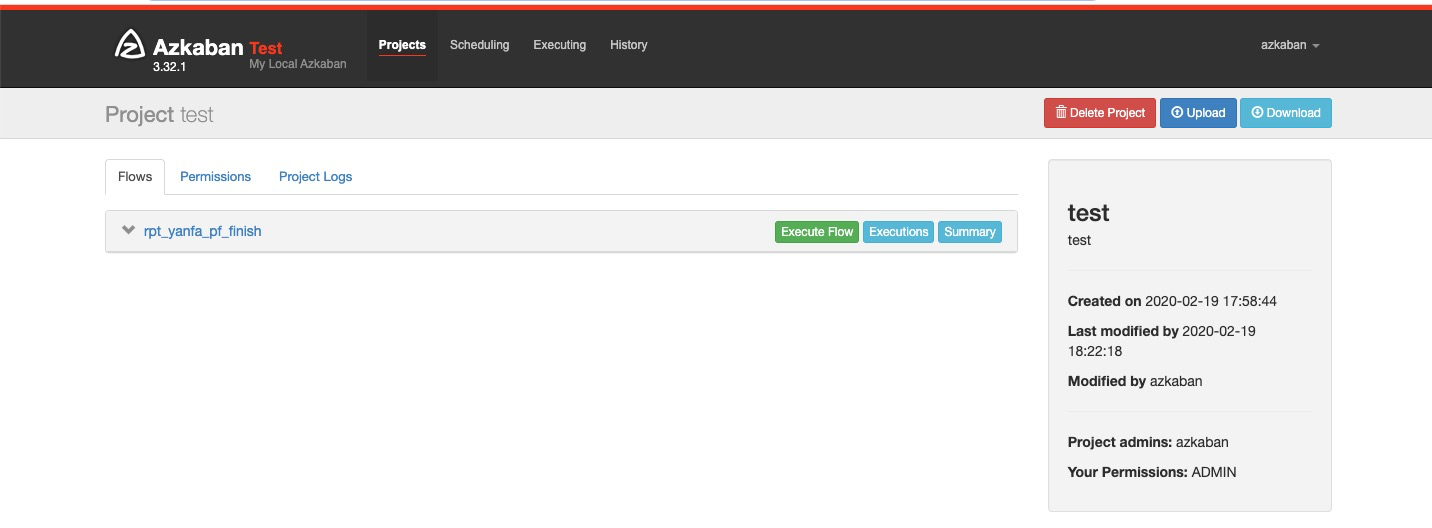

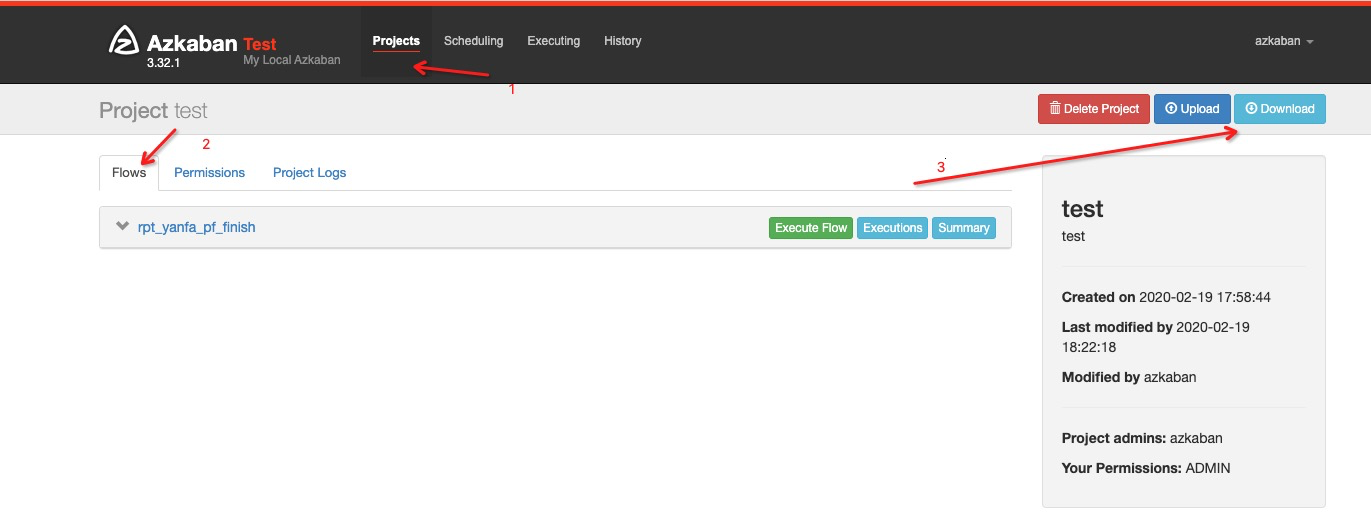

Azkaban工具本身具备导出工作流的能力,有自己的Web控制台,如下图所示:

Azkaban界面支持直接Download某个Flow。Flow的导出流程:

操作步骤:

1.进入Project页面

2.点击Flows,会列出Project下面所有的工作流(Flow)

3.点击Download即可下载Project的导出文件

Azkaban导出包格式原生Azkaban即可,导出包Zip文件内部为Azakaban的某个Project的所有任务(Job)和关系信息。

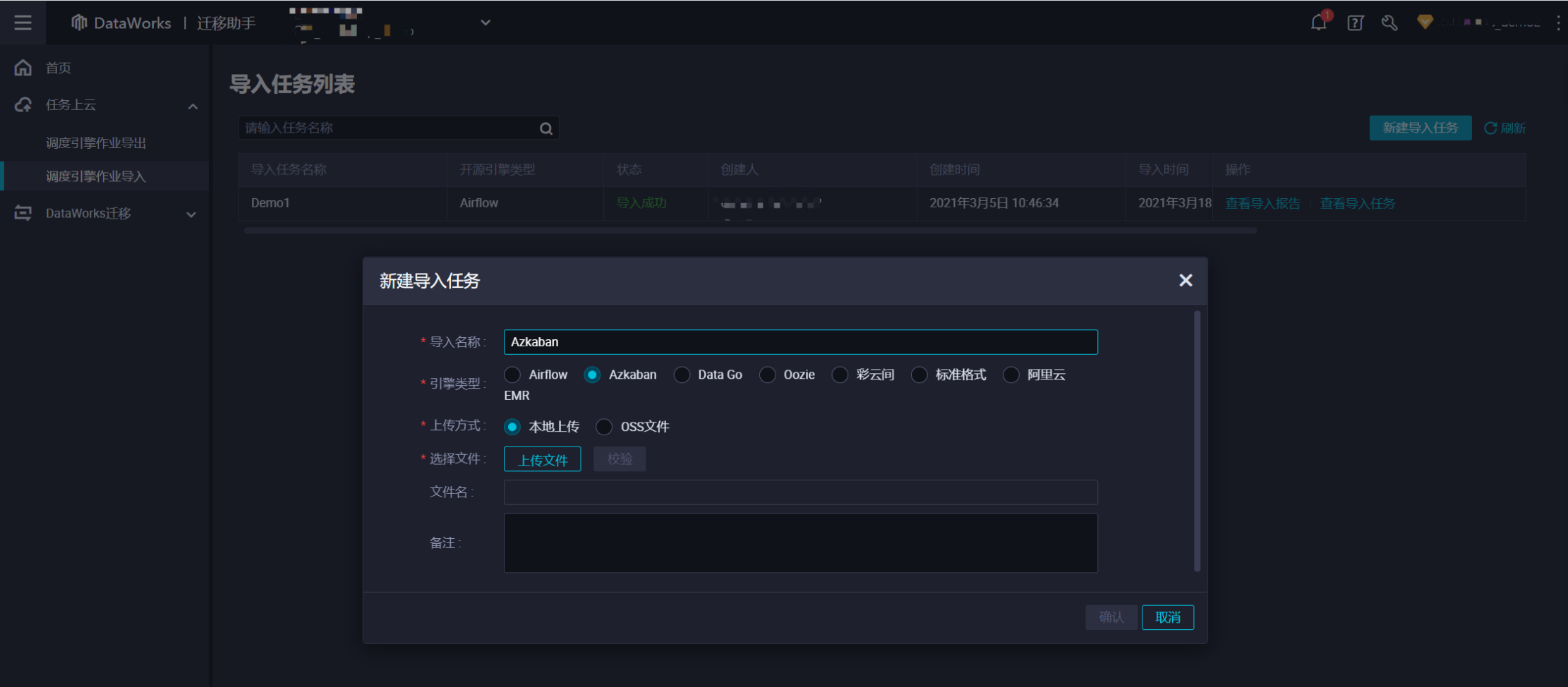

Azkaban作业导入

拿到了开源调度引擎的导出任务包后,用户可以拿这个zip包到迁移助手的迁移助手->任务上云->调度引擎作业导入页面上传导入包进行包分析。

导入包分析成功后点击确认,进入导入任务设置页面,页面中会展示分析出来的调度任务信息。

开源调度导入设置

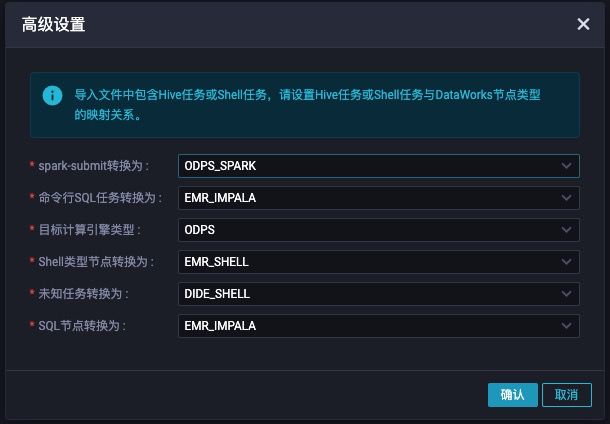

用户可以点击高级设置,设置Azkaban任务与DataWorks任务的转换关系。不同的开源调度引擎,在高级设置里面的设置界面基本一致,如下图:

高级设置项介绍:

- sparkt-submit转换为:导入过程会去分析用户的任务是不是sparkt-submit任务,如果是的话,会将spark-submit任务转换为对应的DataWorks任务类型,比如说:ODPS_SPARK/EMR_SPARK/CDH_SPARK等

- 命令行 SQL任务转换为:开源引擎很多任务类型是命令行运行SQL,比如说hive -e, beeline -e, impala-shell等等,迁移助手会根据用户选择的目标类型做对应的转换。比如可以转换成ODPS_SQL, EMR_HIVE, EMR_IMPALA, EMR_PRESTO, CDH_HIVE, CDH_PRESTO, CDH_IMPALA等等

- 目标计算引擎类型:这个主要是影响的是Sqoop同步的目的端的数据写入配置。我们会默认将sqoop命令转换为数据集成任务。计算引擎类型决定了数据集成任务的目的端数据源使用哪个计算引擎的project。

- Shell类型转换为:SHELL类型的节点在Dataworks根据不同计算引擎会有很多种,比如EMR_SHELL,CDH_SHELL,DataWorks自己的Shell节点等等。

- 未知任务转换为:对目前迁移助手无法处理的任务,我们默认用一个任务类型去对应,用户可以选择SHELL或者虚节点VIRTUAL

- SQL节点转换为:DataWorks上的SQL节点类型也因为绑定的计算引擎的不同也有很多种。比如 EMR_HIVE,EMR_IMPALA、EMR_PRESTO,CDH_HIVE,CDH_IMPALA,CDH_PRESTO,ODPS_SQL,EMR_SPARK_SQL,CDH_SPARK_SQL等,用户可以选择转换为哪种任务类型。

注意:这些导入映射的转换值是动态变化的,和当前项目空间绑定的计算引擎有关,转换关系如下。

导入至DataWorks + MaxCompute

|

设置项 |

可选值 |

|

sparkt-submit转换为 |

ODPS_SPARK |

|

命令行 SQL任务转换为 |

ODPS_SQL、ODPS_SPARK_SQL |

|

目标计算引擎类型 |

ODPS |

|

Shell类型转换为 |

DIDE_SHELL |

|

未知任务转换为 |

DIDE_SHELL、VIRTUAL |

|

SQL节点转换为 |

ODPS_SQL、ODPS_SPARK_SQL |

导入至DataWorks + EMR

|

设置项 |

可选值 |

|

sparkt-submit转换为 |

EMR_SPARK |

|

命令行 SQL任务转换为 |

EMR_HIVE, EMR_IMPALA, EMR_PRESTO, EMR_SPARK_SQL |

|

目标计算引擎类型 |

EMR |

|

Shell类型转换为 |

DIDE_SHELL, EMR_SHELL |

|

未知任务转换为 |

DIDE_SHELL、VIRTUAL |

|

SQL节点转换为 |

EMR_HIVE, EMR_IMPALA, EMR_PRESTO, EMR_SPARK_SQL |

导入至DataWorks + CDH

|

设置项 |

可选值 |

|

sparkt-submit转换为 |

CDH_SPARK |

|

命令行 SQL任务转换为 |

CDH_HIVE, CDH_IMPALA, CDH_PRESTO, CDH_SPARK_SQL |

|

目标计算引擎类型 |

CDH |

|

Shell类型转换为 |

DIDE_SHELL |

|

未知任务转换为 |

DIDE_SHELL、VIRTUAL |

|

SQL节点转换为 |

CDH_HIVE, CDH_IMPALA, CDH_PRESTO, CDH_SPARK_SQL |

执行导入

设置完映射关系后,点击开始导入即可。导入完成后,请进入数据开发中查看导入结果。

数据迁移

大数据集群上的数据迁移,可参考:DataWorks数据集成或MMA。

本文为阿里云原创内容,未经允许不得转载。

DataWorks搬站方案:Azkaban作业迁移至DataWorks的更多相关文章

- azkaban作业参数使用介绍

azkaban作业参数使用介绍 参数传递是调度系统工作流运行时非常重要的一部分,工作流的执行,单个作业的执行,多个工作流之间的依赖执行,历史任务重算,都涉及参数传递和同步. azkaban的工作流中的 ...

- 《Scrum实战》第3次课【富有成效的每日站会】作业汇总

1组 崔儒: http://kecyru.blog.163.com/blog/static/2741661732017626101944123/ 2017-07-26 孟帅: http://www.c ...

- BlueHost主机建站方案怎样选择?

BlueHost是知名美国主机商,近年来BlueHost不断加强中国市场客户的用户体验,提供多种主机租用方案,基本能够满足各类网站建设需求.下面就和大家介绍一下建站应该怎样选择主机. 1.中小型网站 ...

- 软件工程-东北师大站-第十次作业(PSP)

1.本周PSP 2.本周进度条 3.本周累计进度图 代码累计折线图 博文字数累计折线图 4.本周PSP饼状图

- 软件工程-东北师大站-第九次作业(PSP)

1.本周PSP 2.本周进度条 3.本周累计进度图 代码累计折线图 博文字数累计折线图 4.本周PSP饼状图

- 软件工程-东北师大站-第二次作业psp

1.本周PSP 2.本周进度条 3.本周累计进度图 代码累计折线图 博文字数累计折线图 本周PSP饼状图

- PHPCMS快速建站系列之网站迁移(本地到服务器,服务器迁移,更换域名等)

可能出现的问题: 1.后台登录验证码显示不正常(修改/caches/configs/system.php文件) //网站路径'web_path' => '/', 2.phpsso修改 如果不修改 ...

- 不同场景下 MySQL 的迁移方案

一 目录 一 目录 二 为什么要迁移 三 MySQL 迁移方案概览 四 MySQL 迁移实战 4.1 场景一 一主一从结构迁移从库 4.2 场景二 一主一从结构迁移指定库 4.3 场景三 一主一从结构 ...

- 开源WebGIS实施方案(六):空间数据(PostGIS)与GeoServer服务迁移

研发环境的变更,或者研发完成进行项目现场实施.运维的时候,经常就会面临数据及服务的迁移,这其中就包含空间数据以及GeoServer服务的迁移工作. 这里需要提醒的是:如果采用的是类似的开源WebGIS ...

- Linux下快速迁移海量文件的操作记录

有这么一种迁移海量文件的运维场景:由于现有网站服务器配置不够,需要做网站迁移(就是迁移到另一台高配置服务器上跑着),站点目录下有海量的小文件,大概100G左右,图片文件居多.目测直接拷贝过去的话,要好 ...

随机推荐

- 像使用stl一样使用线段树 ——AtCoder Library(转载https://zhuanlan.zhihu.com/p/459579152)

地址:https://zhuanlan.zhihu.com/p/459579152 我这里翻译一下官方的文档. 首先需要满足几个性质. (注意 ∗ 是个操作,不是单纯的一个乘号) 1)操作满足结合律 ...

- JS(函数、作用域、预解析)

一 函数的概念 在 JS 里面,可能会定义非常多的相同代码或者功能相似的代码,这些代码可能需要大量重复使用.虽然 for循环语句也能实现一些简单的重复操作,但是比较具有局限性,此时我们就可以使用 JS ...

- MySQL系列:索引失效场景总结

相关文章 数据库系列:MySQL慢查询分析和性能优化 数据库系列:MySQL索引优化总结(综合版) 数据库系列:高并发下的数据字段变更 数据库系列:覆盖索引和规避回表 数据库系列:数据库高可用及无损扩 ...

- 三维模型OBJ格式轻量化的纹理压缩和质量关系分析

三维模型OBJ格式轻量化的纹理压缩和质量关系分析 三维模型的OBJ格式通常包含纹理信息,而对纹理进行轻量化压缩可以减小文件大小和提高加载性能.然而,在进行纹理压缩时需要权衡压缩比率和保持质量之间的关系 ...

- Locust如何实现负载测试?

一.场景要求 我们在使用locust时,有时候默认的场景无法满足我们的要求时,这时后我们需要自定义场景 比如我们要设置每一段时间启动10个用户运行,执行60s后再一次启动10个用户,总共运行10分钟, ...

- Redis无法向磁盘写入RBD数据

2020-12-09 11:52:25|21965|ERROR|storage/DRedisAsyncCallback.cpp:394[cbIncrby]Cmd 'INCRBY' failed, ke ...

- 阿里二面:谈谈ThreadLocal的内存泄漏问题?问麻了。。。。

引言 ThreadLocal在Java多线程编程中扮演着重要的角色,它提供了一种线程局部存储机制,允许每个线程拥有独立的变量副本,从而有效地避免了线程间的数据共享冲突.ThreadLocal的主要用途 ...

- 《.NET内存管理宝典 》(Pro .NET Memory Management) 阅读指南 - 第3章

本章勘误: 暂无,等待细心的你告诉我哦. 本章注解: 暂无 本章释疑: 暂无,等待你的提问 致谢: MVP 林德熙 MVP 吕毅 sPhinX 相关链接 试读记录

- verilog之时钟信号的编写2

verilog之时钟信号的编写2 1.时钟信号的特点 时钟信号除了可以根据时序一个个变化列举出来,还可以利用其循环的变化的特点,使用循环执行语句always来实现.这种方法实现的时钟信号可以一直执行且 ...

- 英语文档阅读之Zynq-7000 All Programmable SoC

Read "Zynq-7000 All programmable Soc" 1.Table of Contents 首先是目录,可以看到是标准的总分结构.开头介绍了Zynq的各种功 ...