python爬取网站页面时,部分标签无指定属性而报错

在写爬取页面a标签下href属性的时候,有这样一个问题,如果a标签下没有href这个属性则会报错,如下:

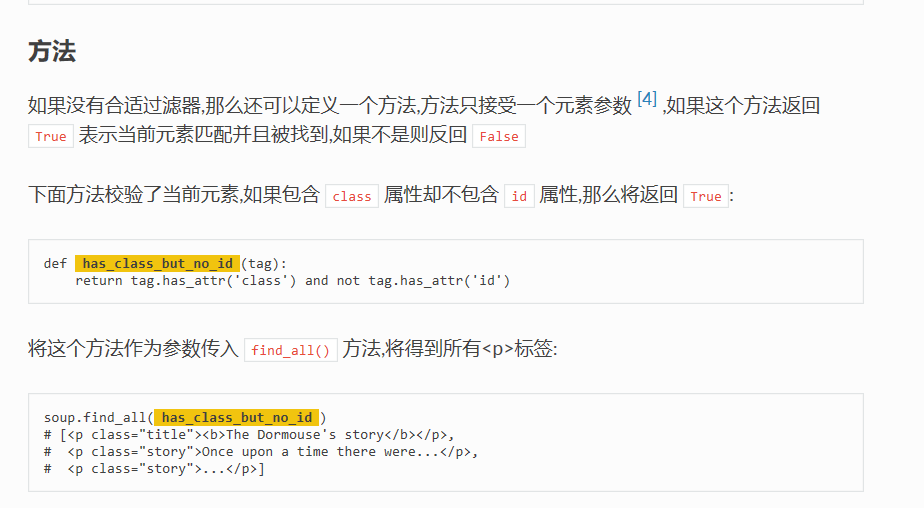

百度了有师傅用正则匹配的,方法感觉都不怎么好,查了BeautifulSoup的官方文档,发现一个不错的方法,如下图:

官方文档链接:https://beautifulsoup.readthedocs.io/zh_CN/v4.4.0/

has_attr() 这个方法可以判断某标签是否存在某属性,如果存在则返回 True

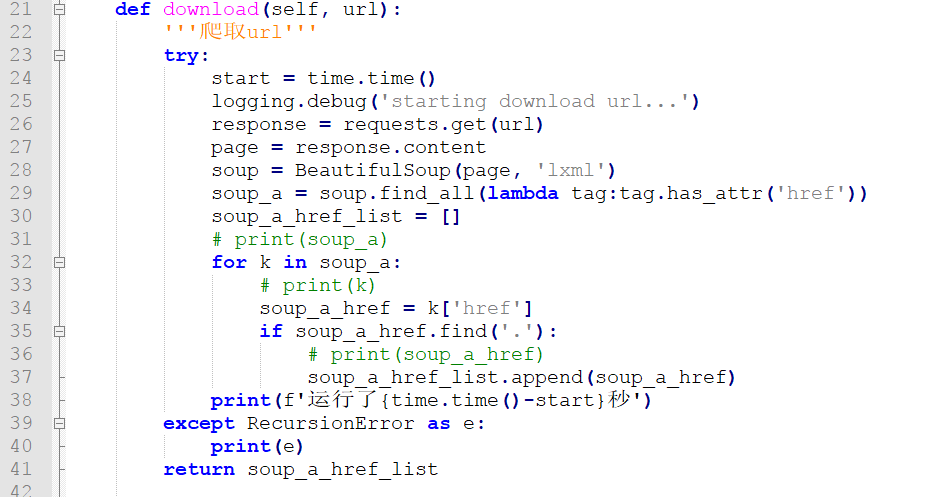

解决办法:

为美观使用了匿名函数

soup_a = soup.find_all(lambda tag:tag.has_attr('href'))

最终实现爬取页面 url 脚本如下:

#!/usr/bin/env python

# -*- coding:utf-8 -*-

# Author:Riy import time

import requests

import sys

import logging

from bs4 import BeautifulSoup

from requests.exceptions import RequestException

from multiprocessing import Process, Pool logging.basicConfig(

level=logging.DEBUG,

format='%(levelname)-10s: %(message)s',

) class down_url:

def download(self, url):

'''爬取url'''

try:

start = time.time()

logging.debug('starting download url...')

response = requests.get(url)

page = response.content

soup = BeautifulSoup(page, 'lxml')

soup_a = soup.select('a')

soup_a = soup.find_all(lambda tag:tag.has_attr('href'))

soup_a_href_list = []

# print(soup_a)

for k in soup_a:

# print(k)

soup_a_href = k['href']

if soup_a_href.find('.'):

# print(soup_a_href)

soup_a_href_list.append(soup_a_href)

print(f'运行了{time.time()-start}秒')

except RecursionError as e:

print(e)

return soup_a_href_list def write(soup_a_href_list, txt):

'''下载到txt文件'''

logging.debug('starting write txt...')

with open(txt, 'a', encoding='utf-8') as f:

for i in soup_a_href_list:

f.writelines(f'{i}\n')

print(f'已生成文件{txt}') def help_memo(self):

'''查看帮助'''

print('''

-h or --help 查看帮助

-u or --url 添加url

-t or --txt 写入txt文件

''') def welcome(self):

'''欢迎页面'''

desc = ('欢迎使用url爬取脚本'.center(30, '*'))

print(desc) def main():

'''主函数'''

p = Pool(3)

p_list = []

temp = down_url()

logging.debug('starting run python...')

try:

if len(sys.argv) == 1:

temp.welcome()

temp.help_memo()

elif sys.argv[1] in {'-h', '--help'}:

temp.help_memo()

elif sys.argv[1] in {'-u ', '--url'} and sys.argv[3] in {'-t', '--txt'}:

a = temp.download(sys.argv[2])

temp.write(a, sys.argv[4])

elif sys.argv[1] in {'-t', '--txt'}:

print('请先输入url!')

elif sys.argv[1] in {'-u', '--url'}:

url_list = sys.argv[2:]

print(url_list)

for i in url_list:

a = p.apply_async(temp.download, args=(i,))

p_list.append(a)

for p in p_list:

print(p.get())

else:

temp.help_memo() print('输入的参数有误!')

except Exception as e:

print(e)

temp.help_memo() if __name__ == '__main__':

main()

python爬取网站页面时,部分标签无指定属性而报错的更多相关文章

- python爬取网站数据

开学前接了一个任务,内容是从网上爬取特定属性的数据.正好之前学了python,练练手. 编码问题 因为涉及到中文,所以必然地涉及到了编码的问题,这一次借这个机会算是彻底搞清楚了. 问题要从文字的编码讲 ...

- python爬取网站数据保存使用的方法

这篇文章主要介绍了使用Python从网上爬取特定属性数据保存的方法,其中解决了编码问题和如何使用正则匹配数据的方法,详情看下文 编码问题因为涉及到中文,所以必然地涉及到了编码的问题,这一次借这 ...

- Python 爬取网站资源文件

爬虫原理: 以下来自知乎解释 首先你要明白爬虫怎样工作.想象你是一只蜘蛛,现在你被放到了互联“网”上.那么,你需要把所有的网页都看一遍.怎么办呢?没问题呀,你就随便从某个地方开始,比如说人民日报的首页 ...

- python 爬取html页面

#coding=utf-8 import urllib.request def gethtml(url): page=urllib.request.urlopen(url) html=page.rea ...

- Python爬取中文页面的时候出现的乱码问题(续)

我在上一篇博客中说明了在爬取数据的时候,把数据写入到文件的乱码问题 在这一篇里面我做一个总结: 1.首先应该看一个案例 我把数据写在.py文件中: #coding:utf-8 s = 'hehe测试中 ...

- Python爬取中文页面的时候出现的乱码问题

一.读取返回的页面数据 在浏览器打开的时候查看源代码,如果在头部信息中指定了UTF-8 那么再python代码中读取页面信息的时候,就需要指定读取的编码方式: response.read().deco ...

- Python爬取网站上面的数据很简单,但是如何爬取APP上面的数据呢

- 3.15学习总结(Python爬取网站数据并存入数据库)

在官网上下载了Python和PyCharm,并在网上简单的学习了爬虫的相关知识. 结对开发的第一阶段要求: 网上爬取最新疫情数据,并存入到MySql数据库中 在可视化显示数据详细信息 项目代码: im ...

- 解决:Python爬取https站点时SNIMissingWarning和InsecurePlatformWarning

今天想利用Requests库爬取糗事百科站点,写了一个请求,却报错了: 后来参考kinsomy的博客,在cmd中pip install pyopenssl ndg-httpsclient pyasn1 ...

随机推荐

- MySQL5.7彻底取消主从复制

由于手误在master节点执行了stop slave;->change master to XXX;->start slave;的动作,后面虽然使用stop slave停止了主从复制,但是 ...

- Centos7上查看ext4文件系统的实际创建时间

前提:今日查看nginx日志时发现有报错,说是一些js,css文件找不到,于是想到去实际路径下查看文件是否确实不存在.结果出现下图中报错: 经过别人提醒查看文件的时间,于是看了一下登上服务器是9:52 ...

- Ubuntu环境下的iptables的端口转发配置实例

打开转发开关要让iptables的端口转发生效,首先需要打开转发开关方法一:临时打开,重启后失效$sudo su#echo 1 >/proc/sys/net/ipv4/ip_forward 方法 ...

- CS229 Lesson 13 高斯混合模型

课程视频地址:http://open.163.com/special/opencourse/machinelearning.html 课程主页:http://cs229.stanford.edu/ 更 ...

- CSS中怎么设置元素水平垂直居中?

记录怎么使用text-align与vertical-align属性设置元素在容器中垂直居中对齐.text-align与vertical-align虽然都是设置元素内部对齐方式的,但两者的用法还是有略微 ...

- 一道二叉树题的n步优化——LeetCode98validate binary search tree(草稿)

树的题目,往往可以用到三种遍历.以及递归,因为其结构上天然地可以往深处递归,且判断条件也往往不复杂(左右子树都是空的). LeetCode 98题讲的是,判断一棵树是不是二叉搜索树. 题目中给的是标准 ...

- redis BLPOP

一.需求 redis中保存了需要download的image url,存储格式为列表. 我需要从列表中获取数据,将图片下载保存到本地. 列表中的数据是一直增加的. 二.实现 使用redis BLPOP ...

- Reids(4)——神奇的HyperLoglog解决统计问题

一.HyperLogLog 简介 HyperLogLog 是最早由 Flajolet 及其同事在 2007 年提出的一种 估算基数的近似最优算法.但跟原版论文不同的是,好像很多书包括 Redis 作者 ...

- Docker实战之Kafka集群

1. 概述 Apache Kafka 是一个快速.可扩展的.高吞吐.可容错的分布式发布订阅消息系统.其具有高吞吐量.内置分区.支持数据副本和容错的特性,适合在大规模消息处理场景中使用. 笔者之前在物联 ...

- 7-40 jmu-python-统计成绩 (15 分)

输入一批学生成绩,计算平均成绩,并统计不及格学生人数. 输入格式: 每行输入一个数据,输入数据为负数结束输入 输出格式: 平均分=XX,不及格人数=XX,其中XX表示对应数据.如果没有学生数据,输出没 ...