PHP curl之爬虫初步

php的curl可以实现模拟http的各种请求,这也是php做网络爬虫的基础,也多用于接口api的调用。

这个时候有人就要发问了:为什么你特么不用file_get_contents?

curl的性能比它好,而且可以完成更多复杂的操作,不仅仅只是获取页面数据。

下面先分别介绍一些常用的函数。

curl_init 初始化一个curl对话

curl_exec 执行请求

curl_close 关闭一个curl对话

curl_setopt 设置curl参数,即传输选项

curl_errno 返回最后一次错误码,php已经定义了诸多错误枚举编码

curl_errror 返回一个保护当前会话最近一次错误的字符串

....

下面我先举一个例子,简单的get获取我博客首页的数据:

<?php

/**

* test get request

* User: freephp

* Date: 2015/10/8

* Time: 15:08

*/ $ch = curl_init(); // 2. 设置选项,包括URL

curl_setopt($ch, CURLOPT_URL, "http://www.cnblogs.com/freephp");

curl_setopt($ch, CURLOPT_RETURNTRANSFER, 1);

curl_setopt($ch, CURLOPT_HEADER, 0);

// 3. 执行并获取HTML文档内容

$output = curl_exec($ch);

// 4. 释放curl句柄

curl_close($ch); print_r($output);

就可以打印出首页的html代码。

也可把内容写入某个文件存储,这不就是爬虫的第一步么? 然后我们正则匹配过滤出文章的url,我封装了一个方法:

/**

* 从html内容中筛选链接

*

* @param string $web_content

* @return array

*/

function filterUrl($web_content){

$reg_tag_a = '/<[a|A].*?class="postTitle2".*?href=[\'\"]{0,1}([^>\'\"\ ]*).*?>/';

$result = preg_match_all($reg_tag_a,$web_content,$match_result);

if($result){

return $match_result[1];

}

} print_r(filterUrl($output));

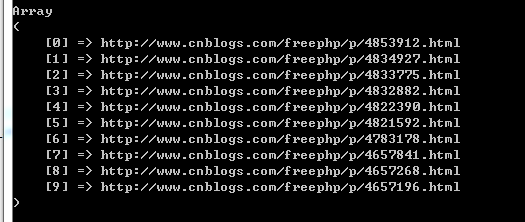

打印出来如图:

然后再遍历去请求这些url,然后拿到所有的文章内容。

(待续.....)

为了复用,我把curl请求发起,内容写入文件,过滤得到文章内容等操作封装成方法。最终的完整代码如下:

<?php

/**

* test get request

* User: freephp

* Date: 2015/10/8

* Time: 15:08

*/ /**

* 获取网页源码

*

* @param $url get方式请求的url

* @return mixed

*/

function getRquest($url)

{

$ch = curl_init();

curl_setopt($ch, CURLOPT_URL, $url);

curl_setopt($ch, CURLOPT_RETURNTRANSFER, 1);

curl_setopt($ch, CURLOPT_HEADER, 0);

// 3. 执行并获取HTML文档内容

$output = curl_exec($ch);

// 4. 释放curl句柄

curl_close($ch);

return $output;

} /**

* 从html内容中筛选链接

*

* @param string $web_content

* @return array

*/

function filterUrl($web_content)

{

$reg_tag_a = '/<[a|A].*?class="postTitle2".*?href=[\'\"]{0,1}([^>\'\"\ ]*).*?>/';

$result = preg_match_all($reg_tag_a, $web_content, $match_result);

if ($result) {

return $match_result[1];

}

} /**

* 从html内容中筛选文章内容

*

* @param string $content

* @return array

*/

function filterContent($content)

{ $reg = '/<.*\"cnblogs_post_body\">(.*?)<\/div>/ism';

$result = preg_match_all($reg, $content, $match_result);

if ($result) {

return $match_result[1];

}

} /**

* 抓取文章内容写入文件。

*

* @param string $fileName 存储文件名

* @param string $contents 文章内容

*/

function writeToFile($fileName, $contents)

{

$fp = fopen($fileName, 'w'); fwrite($fp, $contents);

fclose($fp);

} $output = getRquest("http://www.cnblogs.com/freephp"); $articleUrls = filterUrl($output);

if (empty($articleUrls)) {

echo '获取文章url失败';

die();

}

$articleNum = count($articleUrls);

echo '总共文章为:', $articleNum, "\r\n";

foreach ($articleUrls as $url) {

echo '开始爬取url:', $url, "\r\n";

$out = getRquest($url);

$cont = filterContent($out);

$filename = str_replace('.html', '', str_replace('http://www.cnblogs.com/freephp/p/', '', $url));

writeToFile($filename . '.txt', $cont[0]);

echo '完成爬取url:', $url, "\r\n";

}

后面还会用使用post方式等用途的curl,等到那个时候再封装成工具类吧。

PHP curl之爬虫初步的更多相关文章

- python预课04 列表,元祖,统计值计算示例,py文件转为EXE文件,爬虫初步学习

列表,元组 #list l1 = [1, 2, 3, '高弟弟'] #定义一个列表 #增 l1.append("DSB") #最后增加"DSB"的元素 #删 l ...

- python爬虫-初步认识

特此声明: 以下内容来源于博主:http://blog.csdn.net/pleasecallmewhy http://cuiq ...

- PHP之cURL(爬虫)

public static function SendDataByCurl($url,$data=array()){ //对空格进行转义 $url = str_replace(' ','+',$url ...

- curl 做爬虫 用服务器代理ip

有时候会ip会封锁,所以会用一些模拟代理ip进行抓取测试 从网上找了一下代码 function curl_string ($url,$user_agent,$proxy){ $ch = ...

- python预课05 爬虫初步学习+jieba分词+词云库+哔哩哔哩弹幕爬取示例(数据分析pandas)

结巴分词 import jieba """ pip install jieba 1.精确模式 2.全模式 3.搜索引擎模式 """ txt ...

- 爬虫抓取页面数据原理(php爬虫框架有很多 )

爬虫抓取页面数据原理(php爬虫框架有很多 ) 一.总结 1.php爬虫框架有很多,包括很多傻瓜式的软件 2.照以前写过java爬虫的例子来看,真的非常简单,就是一个获取网页数据的类或者方法(这里的话 ...

- python3爬虫初探(一)之urllib.request

---恢复内容开始--- #小白一个,在此写下自己的python爬虫初步的知识.如有错误,希望谅解并指出. #欢迎和大家交流python爬虫相关的问题 #2016/6/18 #----第一把武器--- ...

- 基于php编写的新闻类爬虫,插入WordPress数据库

这个爬虫写的比较久远,很久没有更新博客了. 1.首先思路是:通过php的curl_setopt()函数可以方便快捷的抓取网页. 2.什么样的新闻吸引人呢,当然的热点新闻了.这里选百度的搜索风云榜,获取 ...

- 转:CURL库在程序中的运用浅析

CURL库在程序中的运用浅析-nk_ysg-ChinaUnix博客 http://blog.chinaunix.net/uid-22476414-id-3286638.html 这个目录的文章转载fr ...

随机推荐

- 组件接口(API)设计指南[5]-最后的思考

*阅读其它章节: http://blog.csdn.net/cuibo1123/article/details/39894477 最后的思考 我通过困难的学习以及多年的失误.写了这片篇关于创建组件和a ...

- Fedora20-Xfce音频视频解码器及解决无声音问题[已解决]

安装rpmfusion源 http://download1.rpmfusion.org/free/fedora/rpmfusion-free-release-20.noarch.rpm http:// ...

- OCP-1Z0-051-题目解析-第1题

1. View the Exhibit and examine the structure of the SALES, CUSTOMERS, PRODUCTS, and TIMES tables. T ...

- Oracle中的Union、Union All、Intersect、Minus

Oracle中的Union.Union All.Intersect.Minus 众所周知的几个结果集集合操作命令,今天详细地测试了一下,发现一些问题,记录备考. 假设我们有一个表Student,包括 ...

- 【AngularJS】 2.0 版本发布

[AngularJS] 2.0 版本发布 w5cValidator[AngularJS] 2.0 版本发布 w5cValidator 插件基于angular原有的表单验证,在原有的基础上扩展了一些 ...

- JavaScript实例技巧精选(11)—计算器实例3

>>点击这里下载完整html源码<< 界面如下 将以下代码插入<body></body>中 <FORM NAME="Calc" ...

- leetcode Binary Tree Postorder Traversal 二叉树后续遍历

先给出递归版本的实现方法,有时间再弄个循环版的.代码如下: /** * Definition for binary tree * struct TreeNode { * int val; * Tree ...

- Design Thinking BrainWalk

Design Thinking Design Thinking Workshop @ Agile Tour 2013 Shanghai 摘要: 设计思维工作坊上周日在2013年敏捷之旅上海站,引导 ...

- 网络地址到物理地址的映射(ARP)

网络的互连首先要解决的问题就是网络地址到物理地址的映射,以太网接口分配的是一个48位的物理地址,而IP地址却只有32位,因此无法将它编码到IP地址中.有人建议可以构建一个中央数据库存储所有网络中的网络 ...

- C#开发ActiveX控件

昨天写了篇博客<Winform 程序嵌入WPF程序 并发送消息>,没有说明为什么要嵌入WPF程序,那么今天就来唠叨唠叨其中的一个使用场景,开发ActiveX控件 首先,新建一个类库工程Hu ...