tensorFlow(五)深层神经网络

TensorFlow基础见前博客

上实例:

MNIST 数据集介绍

60000 个已经标注了的训练集,还有 10000 个用于测试的测试集。

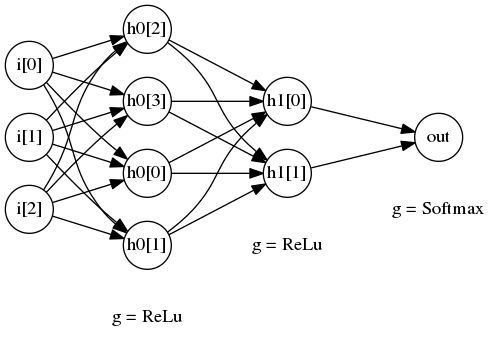

- 上图所示的是一个具有两层隐藏层的深层神经网络

- 第一个隐藏层有

4个节点,对应的激活函数为ReLu函数 - 第一个隐藏层有

2个节点,对应的激活函数也是Relu函数 - 最后,输出层使用 softmax 函数作为激活函数

激活函数定义(activation function):

模型设计

MNIST数据一共有784个输入,所以我们需要一个有784个节点的输入层。MNIST数据使用One-Hot格式输出,有 0-910个 label,分别对应是否为数字 0-9,所以我们在输出层有10个节点,由于 0-9 的概率是互斥的,我们使用 Softmax 函数作为该层的激活函数。

训练模型

- 数据准备首先我们需要先下载

MNIST的数据集。使用以下的命令进行下载:

wget https://devlab-1251520893.cos.ap-guangzhou.myqcloud.com/t10k-images-idx3-ubyte.gz

wget https://devlab-1251520893.cos.ap-guangzhou.myqcloud.com/t10k-labels-idx1-ubyte.gz

wget https://devlab-1251520893.cos.ap-guangzhou.myqcloud.com/train-images-idx3-ubyte.gz

wget https://devlab-1251520893.cos.ap-guangzhou.myqcloud.com/train-labels-idx1-ubyte.gz

实例代码:

#-*- encoding:utf-8 -*-

#!/usr/local/env python import numpy as np

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data def add_layer(inputs, in_size, out_size, activation_function=None):

W = tf.Variable(tf.random_normal([in_size, out_size]))

b = tf.Variable(tf.zeros([1, out_size]) + 0.01) Z = tf.matmul(inputs, W) + b

if activation_function is None:

outputs = Z

else:

outputs = activation_function(Z) return outputs if __name__ == "__main__": MNIST = input_data.read_data_sets("mnist", one_hot=True) learning_rate = 0.01

batch_size = 128

n_epochs = 70 X = tf.placeholder(tf.float32, [batch_size, 784])

Y = tf.placeholder(tf.float32, [batch_size, 10]) layer_dims = [784, 500, 500, 10]

layer_count = len(layer_dims)-1 # 不算输入层

layer_iter = X for l in range(1, layer_count): # layer [1,layer_count-1] is hidden layer

layer_iter = add_layer(layer_iter, layer_dims[l-1], layer_dims[l], activation_function=tf.nn.relu)

prediction = add_layer(layer_iter, layer_dims[layer_count-1], layer_dims[layer_count], activation_function=None) entropy = tf.nn.softmax_cross_entropy_with_logits(labels=Y, logits=prediction)

loss = tf.reduce_mean(entropy) optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss) init = tf.initialize_all_variables() with tf.Session() as sess:

sess.run(init) n_batches = int(MNIST.test.num_examples/batch_size)

for i in range(n_epochs):

for j in range(n_batches):

X_batch, Y_batch = MNIST.train.next_batch(batch_size)

_, loss_ = sess.run([optimizer, loss], feed_dict={X: X_batch, Y: Y_batch})

if i % 10 == 5 and j == 0:

print "Loss of epochs[{0}]: {1}".format(i, loss_) # test the model

n_batches = int(MNIST.test.num_examples/batch_size)

total_correct_preds = 0

for i in range(n_batches):

X_batch, Y_batch = MNIST.test.next_batch(batch_size)

preds = sess.run(prediction, feed_dict={X: X_batch, Y: Y_batch})

correct_preds = tf.equal(tf.argmax(preds, 1), tf.argmax(Y_batch, 1))

accuracy = tf.reduce_sum(tf.cast(correct_preds, tf.float32)) total_correct_preds += sess.run(accuracy) print "Accuracy {0}".format(total_correct_preds/MNIST.test.num_examples)

代码讲解

add_layer 函数

input_size,本层的节点个数作为 output_size,并指定激活函数 activation_function可以看到我们调用的时候位神经网络添加了两个隐藏层和输出层for l in range(1, layer_count): # layer [1,layer_count-1] is hidden layer

layer_iter = add_layer(layer_iter, layer_dims[l-1], layer_dims[l], activation_function=tf.nn.relu)

prediction = add_layer(layer_iter, layer_dims[layer_count-1], layer_dims[layer_count], activation_function=None) entropy = tf.nn.softmax_cross_entropy_with_logits(labels=Y, logits=prediction)

loss = tf.reduce_mean(entropy)

神经网络配置

两个隐藏层,一个输入层和一个输出层 隐藏层的节点数为 500layer_dims = [784, 500, 500, 10]

执行结果:

Loss of epochs[5]: 19.5915279388

Loss of epochs[15]: 7.20698690414

...

Loss of epochs[65]: 0.24952724576

Accuracy 0.939

可以看到经过 70 轮的训练,准确度大约在 94% 左右

探索(play around)

你可以通过修改下面的这个代码片段来修改整个神经网络。layer_dims = [784, 500, 500, 10]

比如你可以去掉一层隐藏层,并将隐藏层的节点数改为 600

layer_dims = [784, 600, 10]

训练完的结果大概是这样:

Loss of epochs[5]: 13.1280488968

Loss of epochs[15]: 9.14239501953

Loss of epochs[25]: 3.60039186478

...

Loss of epochs[65]: 3.32054066658

Accuracy 0.9161

准确度大概 92% 的样子。have fun!

tensorFlow(五)深层神经网络的更多相关文章

- TensorFlow学习笔记——深层神经网络的整理

维基百科对深度学习的精确定义为“一类通过多层非线性变换对高复杂性数据建模算法的合集”.因为深层神经网络是实现“多层非线性变换”最常用的一种方法,所以在实际中可以认为深度学习就是深度神经网络的代名词.从 ...

- [3] TensorFlow 深层神经网络

深层神经网络简称为深度学习有两个非常重要的特性1. 多层2. 非线性 线性模型的局限性 :例如前面的神经网络有两层(不算输入层),但是它和单层的神经网络井没有区别,任意线性模型的组合仍然还是线性模型, ...

- TensorFlow(实战深度学习框架)----深层神经网络(第四章)

深层神经网络可以解决部分浅层神经网络解决不了的问题. 神经网络的优化目标-----损失函数 深度学习:一类通过多层非线性变化对高复杂性数据建模算法的合集.(两个重要的特性:多层和非线性) 线性模型的最 ...

- TensorFlow学习笔记(二)深层神经网络

一.深度学习与深层神经网络 深层神经网络是实现“多层非线性变换”的一种方法. 深层神经网络有两个非常重要的特性:深层和非线性. 1.1线性模型的局限性 线性模型:y =wx+b 线性模型的最大特点就是 ...

- TensorFlow深层神经网络常用方法

深度学习所示深层神经网络的代名词,重要特性:多层.非线性. 若只通过线性变换,任意层的神经网络模型与单层神经网络模型的表达能力没有任何区别,这是线性模型的局限性.对于线性可分的问题中,线性模型可解决, ...

- 【tensorflow:Google】四、深层神经网络

一.深度学习与深层神经网络 1.线性模型局限性 线性模型无论多少层,表达能力是一致的.可以通过激活函数实现非线性. 2.多层网络可以解决异或运算 二.损失函数定义 1.经典损失函数: 分类问题: 二分 ...

- DeepLearning.ai学习笔记(一)神经网络和深度学习--Week4深层神经网络

一.深层神经网络 深层神经网络的符号与浅层的不同,记录如下: 用\(L\)表示层数,该神经网络\(L=4\) \(n^{[l]}\)表示第\(l\)层的神经元的数量,例如\(n^{[1]}=n^{[2 ...

- 改善深层神经网络_优化算法_mini-batch梯度下降、指数加权平均、动量梯度下降、RMSprop、Adam优化、学习率衰减

1.mini-batch梯度下降 在前面学习向量化时,知道了可以将训练样本横向堆叠,形成一个输入矩阵和对应的输出矩阵: 当数据量不是太大时,这样做当然会充分利用向量化的优点,一次训练中就可以将所有训练 ...

- [DeeplearningAI笔记]改善深层神经网络_深度学习的实用层面1.10_1.12/梯度消失/梯度爆炸/权重初始化

觉得有用的话,欢迎一起讨论相互学习~Follow Me 1.10 梯度消失和梯度爆炸 当训练神经网络,尤其是深度神经网络时,经常会出现的问题是梯度消失或者梯度爆炸,也就是说当你训练深度网络时,导数或坡 ...

随机推荐

- git bash支持中文

打开Git Bash窗口-->右键-->Options-->text Locale:设置为zh_CN Charachter set:设置为UTF-8 保存,重新打开Git Bash, ...

- safari无法调试iphone提示“无可检查的应用程序”的解决方法

iphone上打开safari,随便访问一个网站,mac上通过Safari的开发,我的iphone是可以看到的.如果打开APP,就提示“无可检查的应用程序”. 解决方法 使用XCode运行我们的App ...

- CSS几个要点补充

css的font-size属性一定要带px单位,font-weight:700[千万不要带单位哦]就等于font-weight:bold加粗 1.如何像淘宝页面一样,随着浏览器的减小而保持内容区大小不 ...

- js 简单的进度条

html部分 <div id='div1'> <div id="div2"></div> </div> css部分 div{ hei ...

- opencv学习之路(31)、GrabCut & FloodFill图像分割

一.GrabCut 1.利用Rect做分割 #include "opencv2/opencv.hpp" using namespace cv; void main() { Mat ...

- opencv学习之路(23)、轮廓查找与绘制(二)——访问轮廓每个点

一.简介 二.画出每个轮廓的每个点 #include "opencv2/opencv.hpp" using namespace cv; void main() { Mat src= ...

- 剑指offer(18)二叉树的镜像

题目描述 操作给定的二叉树,将其变换为源二叉树的镜像. 输入描述: 二叉树的镜像定义:源二叉树 8 / \ 6 10 / \ / \ 5 7 9 11 镜像二叉树 8 / \ 10 6 / \ / \ ...

- 最短路径之Bellman-Ford算法的队列优化及邻接表

参考链接:https://blog.csdn.net/qq_40626497/article/details/81139344

- Python3 tkinter基础 Menu add_cascade 多级菜单 add_separator 分割线

Python : 3.7.0 OS : Ubuntu 18.04.1 LTS IDE : PyCharm 2018.2.4 Conda ...

- UVA1400 "Ray, Pass me the dishes!"

思路 线段树维护最大子段和,只不过这题还要维护左右端点 还是维护pre,suf,sum,ans,只不过每个再多出一个维护端点的变量即可 注意多解讨论的大于号和大于等于号 代码 #include < ...