一、PyTorch 入门实战—Tensor(转)

一、Tensor的创建和使用

1.概念和TensorFlow的是基本一致的,只是代码编写格式的不同。我们声明一个Tensor,并打印它,例如:

import torch

#定义一个Tensor矩阵

a = torch.Tensor([1, 2], [3, 4],[5, 6], [7, 8])

print(a)

print('{}'.format(a))

然后会发现报以下错误:

new() received an invalid combination of arguments - got (list, list, list, list), but expected one of: * (torch.device device) * (torch.Storage storage) * (Tensor other) * (tuple of ints size, torch.device device) * (object data, torch.device device)

意思是接收到无效的参数组合。其实是少写了一对中括号,这是初学者的常用错误。

2.改成如下形式:

import torch

#定义一个Tensor矩阵

a = torch.Tensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(a)

print('{}'.format(a))

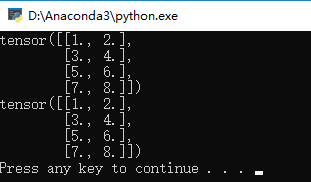

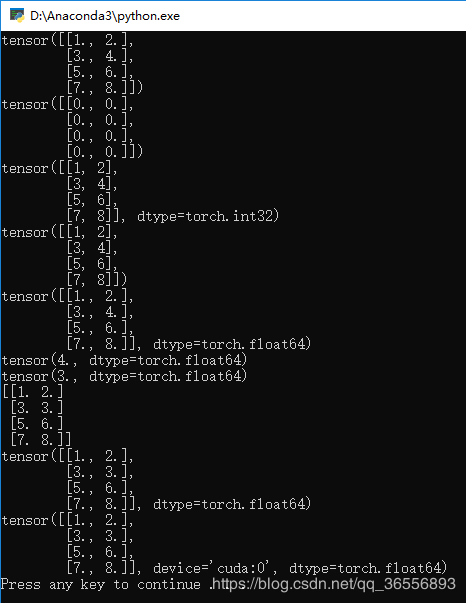

结果为:

3.如果想查看的它的大小可以加一句话:

import torch

#定义一个Tensor矩阵

a = torch.Tensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print('{}'.format(a.size()))

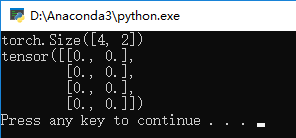

结果为:

即4行2列的矩阵

4.如果想生成一个全为0的矩阵,可以输入如下代码:

import torch

#定义一个Tensor矩阵

a = torch.Tensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print('{}'.format(a.size()))

b = torch.zeros((4, 2))

print(b)

结果为:

即4行2列数组元素全为0的矩阵

5.如果想生成不同类型的数据,可以改变torch.后面函数名称,例如下面这样:

import torch

#定义一个Tensor矩阵

a = torch.Tensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print('{}'.format(a))

b = torch.zeros((4, 2))

print(b)

c = torch.IntTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(c)

d = torch.LongTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(d)

e = torch.DoubleTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(e)

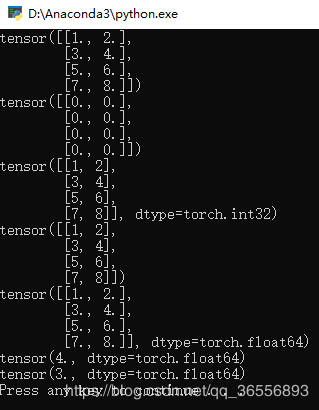

结果为:

6.如果想访问Tensor里的一个元素或者改变它,可以输入如下代码:

print(e[1, 1])

#改变元素值

e[1, 1] = 3

print(e[1, 1])

代码变为:

import torch

#定义一个Tensor矩阵

a = torch.Tensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print('{}'.format(a))

b = torch.zeros((4, 2))

print(b)

c = torch.IntTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(c)

d = torch.LongTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(d)

e = torch.DoubleTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(e)

print(e[1, 1])

#改变元素值

e[1, 1] = 3

print(e[1, 1])

结果为:

说明原来4的位置数值变为了3

7.最重要的是Tensor和Numpy之间的转换,例如我们把e变为numpy类型,添加以下代码:

f = e.numpy()

print(f)

变为:

import torch

#定义一个Tensor矩阵

a = torch.Tensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print('{}'.format(a))

b = torch.zeros((4, 2))

print(b)

c = torch.IntTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(c)

d = torch.LongTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(d)

e = torch.DoubleTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(e)

print(e[1, 1])

#改变元素值

e[1, 1] = 3

print(e[1, 1])

#转换为Numpy

f = e.numpy()

print(f)

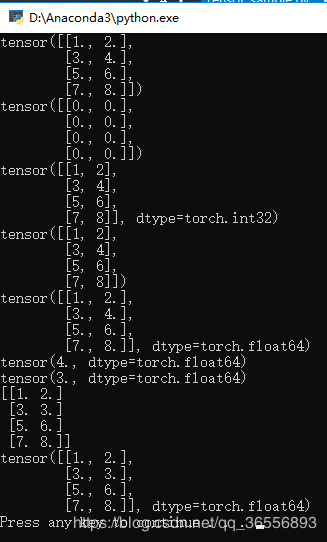

结果为:

可以看到没有tensor()了~

我们再把f变为tensor类型,输入以下代码:

g = torch.from_numpy(f)

print(g)

变为:

import torch

#定义一个Tensor矩阵

a = torch.Tensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print('{}'.format(a))

b = torch.zeros((4, 2))

print(b)

c = torch.IntTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(c)

d = torch.LongTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(d)

e = torch.DoubleTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(e)

print(e[1, 1])

#改变元素值

e[1, 1] = 3

print(e[1, 1])

#转换为Numpy

f = e.numpy()

print(f)

#转换为Tensor

g = torch.from_numpy(f)

print(g)

结果为:

可以看到又变成了Tensor类型

二、Tensor放到GPU上执行

1.通过如下代码判断是否支持GPU:

if torch.cuda.is_available():

h = g.cuda()

print(h)

变为

import torch

#定义一个Tensor矩阵

a = torch.Tensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print('{}'.format(a))

b = torch.zeros((4, 2))

print(b)

c = torch.IntTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(c)

d = torch.LongTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(d)

e = torch.DoubleTensor([[1, 2], [3, 4],[5, 6], [7, 8]])

print(e)

print(e[1, 1])

#改变元素值

e[1, 1] = 3

print(e[1, 1])

#转换为Numpy

f = e.numpy()

print(f)

#转换为Tensor

g = torch.from_numpy(f)

print(g)

#将Tensor放在GPU上

if torch.cuda.is_available():

h = g.cuda()

print(h)

2.生成结果会慢一下,然后可以看到多了一个device=‘cuda:0’:

三、Tensor总结

1.Tensor和Numpy都是矩阵,区别是前者可以在GPU上运行,后者只能在CPU上

2.Tensor和Numpy互相转化很方便,类型也比较兼容

3.Tensor可以直接通过print显示数据类型,而Numpy不可以,例如:dtype = torch.float64

一、PyTorch 入门实战—Tensor(转)的更多相关文章

- 二、PyTorch 入门实战—Variable(转)

目录 一.概念 二.Variable的创建和使用 三.标量求导计算图 四.矩阵求导计算图 五.Variable放到GPU上执行 六.Variable转Numpy与Numpy转Variable 七.Va ...

- 超简单!pytorch入门教程(一):Tensor

http://www.jianshu.com/p/5ae644748f21 二.pytorch的基石--Tensor张量 其实标量,向量,矩阵它们三个也是张量,标量是零维的张量,向量是一维的张量,矩阵 ...

- 深度学习入门实战(二)-用TensorFlow训练线性回归

欢迎大家关注腾讯云技术社区-博客园官方主页,我们将持续在博客园为大家推荐技术精品文章哦~ 作者 :董超 上一篇文章我们介绍了 MxNet 的安装,但 MxNet 有个缺点,那就是文档不太全,用起来可能 ...

- [pytorch] Pytorch入门

Pytorch入门 简单容易上手,感觉比keras好理解多了,和mxnet很像(似乎mxnet有点借鉴pytorch),记一记. 直接从例子开始学,基础知识咱已经看了很多论文了... import t ...

- Pytorch入门随手记

Pytorch入门随手记 什么是Pytorch? Pytorch是Torch到Python上的移植(Torch原本是用Lua语言编写的) 是一个动态的过程,数据和图是一起建立的. tensor.dot ...

- pytorch 入门指南

两类深度学习框架的优缺点 动态图(PyTorch) 计算图的进行与代码的运行时同时进行的. 静态图(Tensorflow <2.0) 自建命名体系 自建时序控制 难以介入 使用深度学习框架的优点 ...

- pytorch入门2.0构建回归模型初体验(数据生成)

pytorch入门2.x构建回归模型系列: pytorch入门2.0构建回归模型初体验(数据生成) pytorch入门2.1构建回归模型初体验(模型构建) pytorch入门2.2构建回归模型初体验( ...

- Pytorch入门——手把手教你MNIST手写数字识别

MNIST手写数字识别教程 要开始带组内的小朋友了,特意出一个Pytorch教程来指导一下 [!] 这里是实战教程,默认读者已经学会了部分深度学习原理,若有不懂的地方可以先停下来查查资料 目录 MNI ...

- Pytorch入门上 —— Dataset、Tensorboard、Transforms、Dataloader

本节内容参照小土堆的pytorch入门视频教程.学习时建议多读源码,通过源码中的注释可以快速弄清楚类或函数的作用以及输入输出类型. Dataset 借用Dataset可以快速访问深度学习需要的数据,例 ...

随机推荐

- 生产环境MySQL优化

a:硬件的优化: 1. 采用64位cpu,cpu至少4颗,L2缓存越大越好2. 内存要大,32-64G运行1-2个实例,96-128G运行3-4个实例3. 机械盘选用sas盘,转速15000以上,有可 ...

- .NET平台简介

前言: 看到一个名词:搜商(SQ),还挺有趣.讲的是在互联网时代,怎么能够快速找到自己所需信息或资源,成为一种能力,并将其提升到类似智商.情商的概念.在以后工作过程中,尽量提高自己获取.辨别.处理信息 ...

- Java:synchronized关键字引出的多种锁

前言 Java 中的 synchronized关键字可以在多线程环境下用来作为线程安全的同步锁.本文不讨论 synchronized 的具体使用,而是研究下synchronized底层的锁机制,以及这 ...

- Python编程菜鸟成长记--A1--02--Python介绍

目录 1.重点知识 2.Python 语言介绍 2.1.Python 在主要领域的应用前景 2.2.Python 在机构.行业巨头公司的应用 3.Python 的发展史 4.Python 的发展前景如 ...

- hihoCoder 1308:搜索二·骑士问题(BFS预处理)

题目链接 题意 中文题意. 思路 对于每一个骑士,可以先预处理出到达地图上某个点的需要走的步数,然后最后暴力枚举地图上每一个点,让三个骑士走过的距离之和最小即可. #include <bits/ ...

- TCP中的粘包问题,以及用TCP和UDP实现多次聊天

TCP协议 在连接内多和客户端说几句 #server端 import socket sk = socket.socket() sk.bind(('127.0.0.1',9001)) sk.listen ...

- scrapy基础知识之 RedisCrawlSpider:

这个RedisCrawlSpider类爬虫继承了RedisCrawlSpider,能够支持分布式的抓取.因为采用的是crawlSpider,所以需要遵守Rule规则,以及callback不能写pars ...

- PYTHONIOENCODING = UTF-8 引发的血案

血案: 我就是想在Jenkins上运行一段自动化python代码,就是最简单的本地控制台输出, 我就不懂了它为什么一直是去找 cp1252.py 编码???目前, 确定 pycharm 运行脚本很OK ...

- CDQZ集训DAY7 日记

并没有考试然而心情比考试还糟糕…… 上午讲的基本就听不懂,讲课人迷之停顿.根本让人跟不上趟,声音好奇怪的说……好不容易讲到反演,Hzoi集体上线,等待装逼时刻的到来.然而,讲课人再次迷之停顿,讲一个p ...

- java学习笔记(基础篇)—抽象与接口的区别

抽象与接口的区别 一.抽象(abstract) 1. 抽象方法 1) 作用:定义规范 2) 抽象方法用来描述具有什么功能,但不提供实现. 3) 如果类中一个方法没有实现就要定义一个抽象方法. 2. 抽 ...