Requests+BeautifulSoup+正则表达式爬取猫眼电影Top100(名称,演员,评分,封面,上映时间,简介)

# encoding:utf-8

from requests.exceptions import RequestException

import requests

import re

import json

from multiprocessing import Pool def get_one_page(url):

try:

response = requests.get(url)

if response.status_code == 200:

return response.text

return None

except RequestException:

return None def parse_one_page(html):

pattern = re.compile('<dd>.*?board-index.*?>(\d+)</i>.*?data-src="(.*?)".*?name"><a'

+'.*?>(.*?)</a>.*?star">(.*?)</p>.*?releasetime">(.*?)</p>'

+'.*?integer">(.*?)</i>.*?fraction">(.*?)</i>.*?</dd>',re.S)

items = re.findall(pattern, html)

# print(items)

for item in items:

yield {

'index': item[0],

'image': item[1],

'title': item[2],

'actor': item[3].strip()[3:],

'time': item[4].strip()[5:],

'score': item[5]+item[6]

} def write_to_file(content):

with open('MaoyanTop100.txt', 'a', encoding='utf-8') as f:

f.write(json.dumps(content, ensure_ascii=False)+'\n')

f.close() def main(offset):

url = "http://maoyan.com/board/4?offset="+str(offset)

html = get_one_page(url)

# print(html)

# parse_one_page(html)

for item in parse_one_page(html):

print(item)

write_to_file(item) if __name__ == '__main__':

pool = Pool()

# for i in range(10):

# main(i*10)

# 加快效率

pool.map(main, [i*10 for i in range(10)])

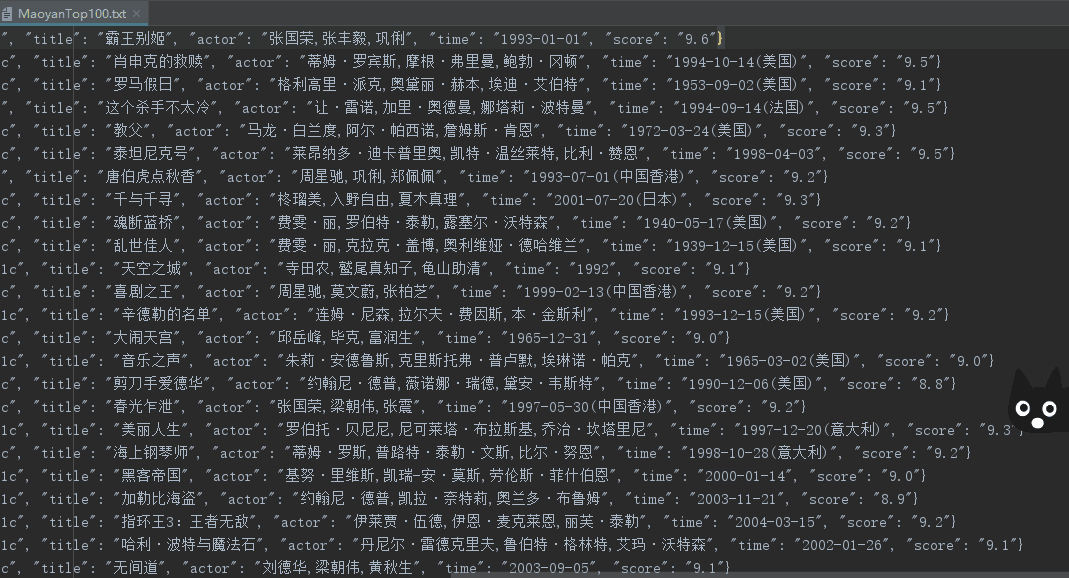

效果图:

更新(获取封面以及影片简介):

# encoding:utf-8

from requests.exceptions import RequestException

import requests

import json

import re

from urllib import request

from bs4 import BeautifulSoup def get_one_page(url):

try:

response = requests.get(url)

if response.status_code == 200:

return response.text

return None

except RequestException:

return None def parse_one_page(html):

pattern = re.compile('<dd>.*?board-index.*?>(\d+)</i>.*?href="(.*?)".*?data-src="(.*?)".*?name"><a'

+'.*?>(.*?)</a>.*?star">(.*?)</p>.*?releasetime">(.*?)</p>'

+'.*?integer">(.*?)</i>.*?fraction">(.*?)</i>.*?</dd>',re.S)

items = re.findall(pattern, html)

# print(items)

for item in items:

yield {

'index': item[0],

'jump': item[1],

'image': item[2],

'title': item[3],

'actor': item[4].strip()[3:],

'time': item[5].strip()[5:],

'score': item[6]+item[7]

} def parse_summary_page(url):

# url = 'https://maoyan.com/films/1203'

head = {}

# 使用代理

head['User - Agent'] = 'User-Agent:Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/63.0.3239.26 Safari/537.36 Core/1.63.6788.400 QQBrowser/10.3.2843.400'

req = request.Request(url, headers=head)

response = request.urlopen(req)

html = response.read()

# 创建request对象

soup = BeautifulSoup(html, 'lxml')

# 找出div中的内容

soup_text = soup.find('span', class_='dra')

# 输出其中的文本

# print(soup_text.text)

return soup_text def write_to_file(content):

with open('newMaoyanTop100.txt', 'a', encoding='utf-8') as f:

f.write(json.dumps(content, ensure_ascii=False)+'\n')

f.close() def main(offset):

url = "http://maoyan.com/board/4?offset="+str(offset*10)

html = get_one_page(url) for item in parse_one_page(html):

# print(item['number'])

# print(item['jump'])

jump_url = "https://maoyan.com"+str(item['jump'])

item['summary'] = str(parse_summary_page(jump_url)).replace("<span class=\"dra\">","").replace("</span>","")

print(item)

write_to_file(item) # 写txt

# for item in parse_one_page(html):

# write_to_file(item['title']) # 爬取100张图片

# path = 'E:\\myCode\\py_test\\MaoyanTop100\\images\\'

# for item in parse_one_page(html):

# urllib.request.urlretrieve(item['image'], '{}{}.jpg'.format(path, item['index'])) if __name__ == '__main__':

for i in range(10):

main(i)

Requests+BeautifulSoup+正则表达式爬取猫眼电影Top100(名称,演员,评分,封面,上映时间,简介)的更多相关文章

- requests和正则表达式爬取猫眼电影Top100练习

1 import requests 2 import re 3 from multiprocessing import Pool 4 from requests.exceptions import R ...

- python3.6 利用requests和正则表达式爬取猫眼电影TOP100

import requests from requests.exceptions import RequestException from multiprocessing import Pool im ...

- PYTHON 爬虫笔记八:利用Requests+正则表达式爬取猫眼电影top100(实战项目一)

利用Requests+正则表达式爬取猫眼电影top100 目标站点分析 流程框架 爬虫实战 使用requests库获取top100首页: import requests def get_one_pag ...

- 爬虫练习之正则表达式爬取猫眼电影Top100

#猫眼电影Top100import requests,re,timedef get_one_page(url): headers={ 'User-Agent':'Mozilla/5.0 (Window ...

- Requests+正则表达式爬取猫眼电影(TOP100榜)

猫眼电影网址:www.maoyan.com 前言:网上一些大神已经对猫眼电影进行过爬取,所用的方法也是各有其优,最终目的是把影片排名.图片.名称.主要演员.上映时间与评分提取出来并保存到文件或者数据库 ...

- Python爬虫实战之Requests+正则表达式爬取猫眼电影Top100

import requests from requests.exceptions import RequestException import re import json # from multip ...

- python爬虫从入门到放弃(九)之 Requests+正则表达式爬取猫眼电影TOP100

import requests from requests.exceptions import RequestException import re import json from multipro ...

- 整理requests和正则表达式爬取猫眼Top100中遇到的问题及解决方案

最近看崔庆才老师的爬虫课程,第一个实战课程是requests和正则表达式爬取猫眼电影Top100榜单.虽然理解崔老师每一步代码的实现过程,但自己敲代码的时候还是遇到了不少问题: 问题1:获取respo ...

- 14-Requests+正则表达式爬取猫眼电影

'''Requests+正则表达式爬取猫眼电影TOP100''''''流程框架:抓去单页内容:利用requests请求目标站点,得到单个网页HTML代码,返回结果.正则表达式分析:根据HTML代码分析 ...

随机推荐

- SQL Anywhere .NET

SQL Anywhere .NET 支持 1.ADO.NET 是 Microsoft 的 ODBC.OLE DB 和 ADO 系列中最新的数据访问 API.它是 Microsoft .NET Fram ...

- Oracle查看用户密码过期,修改永不过期

01.查看当前open用户 select username,account_status,expiry_date,profile from dba_users; 02.查看目前的密码过期策略 sele ...

- js获取微信code

function callback(result) { alert('cucess'); alert(result); //输出openid } function getQueryString(nam ...

- win10升级后,无法ping通vmware的centos解决方法

win10是lenovo thinkpad460上面的,是正版的.无法做设置,不让其自动升级.10月8日节后第一天上班,电脑要求更新,我就点更新. 结果就发现无法ping通vmware中的centos ...

- .Net拾忆:Asp.net请求管道

w3wp.exe应该很熟悉,调试应用时候附加到进程就是这个服务:w3wp.exe和应用池相关联,每个应用池会有一个w3wp; 一.Http请求到iis应用池 IIS 5.x iis运行在inetinf ...

- 为Flex Builder设置测试服务器

当用Flex Builder测试一个Flex应用时,它默认情况下会调用系统自带浏览器直接从bin-debug文件夹打开相应的html文件.浏览器中URL地址形式如file:///C:/AllESRI/ ...

- UVA 11168 Airport(凸包)

Airport [题目链接]Airport [题目类型]凸包 &题解: 蓝书274页,要想到解析几何来降低复杂度,还用到点到直线的距离公式,之后向想到预处理x,y坐标之和,就可以O(1)查到距 ...

- CSU 1838 Water Pump(单调栈)

Water Pump [题目链接]Water Pump [题目类型]单调栈 &题解: 这题可以枚举缺口,共n-1个,之后把前缀面积和后缀面积用O(n)打一下表,最后总面积减去前缀的i个和后缀的 ...

- composer----------composer基本命令和遇到一些问题解决方案

1.composer跟xdebug有冲突,每次用composer命令的时候都要报xdebug的错误,去php的配置文件里面将xdebug注释掉就可以了,但是我注释掉了以后还是不行.找了半天才看到,我用 ...

- hbase-java-api002(flush)

package api; import java.io.IOException; import org.apache.hadoop.conf.Configuration; import org.apa ...