Keras实现卷积神经网络

# -*- coding: utf-8 -*-

"""

Created on Sun Jan 20 11:25:29 2019 @author: zhen

""" import numpy as np

from keras.datasets import mnist

from keras.models import Sequential

from keras.layers import Dense

from keras.layers import Dropout

from keras.layers import Flatten

from keras.layers.convolutional import Conv2D

from keras.layers.convolutional import MaxPooling2D # 加载数据

(x_train, y_train), (x_test, y_test) = mnist.load_data("../test_data_home")

# 转化训练数据为四维张量形式

x_train = x_train.reshape(x_train.shape[0], 28, 28, 1).astype("float32")

x_test = x_test.reshape(x_test.shape[0], 28, 28, 1).astype("float32")

# 归一化

x_train /= 255

x_test /= 255 #转化为one hot 编码

def to_one_hot(y):

y_one_hot = np.zeros(10) # 生成全零向量

y_one_hot[y] = 1

return y_one_hot # 重置标签

y_train_one_hot = np.array([to_one_hot(y_train[i]) for i in range(len(y_train))])

y_test_one_hot = np.array([to_one_hot(y_test[i]) for i in range(len(y_test))])

# 搭建卷积神经网络

model = Sequential()

model.add(Conv2D(filters=32, kernel_size=(3, 3), strides=(1, 1), padding='same', input_shape=(28, 28, 1),

activation='relu'))

# 添加最大池化层

model.add(MaxPooling2D(pool_size=(2, 2)))

# 添加Dropout层

model.add(Dropout(0.2))

# 构建深度网络

model.add(Conv2D(64, kernel_size=(3, 3), strides=(1, 1), padding='same', activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.2))

model.add(Conv2D(128, kernel_size=(3, 3), strides=(1, 1), padding='same', activation='relu'))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Dropout(0.2))

# 展开

model.add(Flatten())

# 构造全连接层

model.add(Dense(128, activation='relu'))

model.add(Dense(64, activation='relu'))

model.add(Dense(32, activation='relu'))

model.add(Dense(10, activation='softmax'))

# 定义损失函数

model.compile(loss='categorical_crossentropy', optimizer='adagrad',

metrics=['accuracy'])

# 训练

model.fit(x_train, y_train_one_hot, validation_data=(x_test, y_test_one_hot),

epochs=2, batch_size=128)

# 评估

# verbose : 0表示不显示数据,1表示显示进度

scores = model.evaluate(x_test, y_test_one_hot, verbose=0)

print(scores)

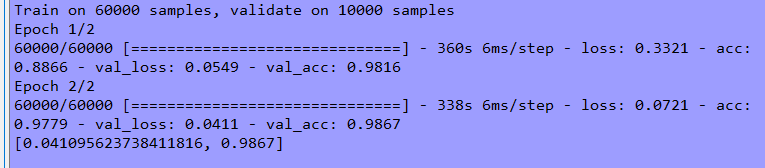

结果:

Keras实现卷积神经网络的更多相关文章

- visualization of filters keras 基于Keras的卷积神经网络(CNN)可视化

https://adeshpande3.github.io/adeshpande3.github.io/ https://blog.csdn.net/weiwei9363/article/detail ...

- keras与卷积神经网络(CNN)实现识别minist手写数字

在本篇博文当中,笔者采用了卷积神经网络来对手写数字进行识别,采用的神经网络的结构是:输入图片——卷积层——池化层——卷积层——池化层——卷积层——池化层——Flatten层——全连接层(64个神经元) ...

- 深度学习:Keras入门(二)之卷积神经网络(CNN)

说明:这篇文章需要有一些相关的基础知识,否则看起来可能比较吃力. 1.卷积与神经元 1.1 什么是卷积? 简单来说,卷积(或内积)就是一种先把对应位置相乘然后再把结果相加的运算.(具体含义或者数学公式 ...

- 【Python】keras卷积神经网络识别mnist

卷积神经网络的结构我随意设了一个. 结构大概是下面这个样子: 代码如下: import numpy as np from keras.preprocessing import image from k ...

- 1.keras实现-->使用预训练的卷积神经网络(VGG16)

VGG16内置于Keras,可以通过keras.applications模块中导入. --------------------------------------------------------将 ...

- 深度学习:Keras入门(二)之卷积神经网络(CNN)【转】

本文转载自:https://www.cnblogs.com/lc1217/p/7324935.html 说明:这篇文章需要有一些相关的基础知识,否则看起来可能比较吃力. 1.卷积与神经元 1.1 什么 ...

- 深度学习:Keras入门(二)之卷积神经网络(CNN)(转)

转自http://www.cnblogs.com/lc1217/p/7324935.html 1.卷积与神经元 1.1 什么是卷积? 简单来说,卷积(或内积)就是一种先把对应位置相乘然后再把结果相加的 ...

- Keras(四)CNN 卷积神经网络 RNN 循环神经网络 原理及实例

CNN 卷积神经网络 卷积 池化 https://www.cnblogs.com/peng8098/p/nlp_16.html 中有介绍 以数据集MNIST构建一个卷积神经网路 from keras. ...

- 了解1D和3D卷积神经网络 | Keras

当我们说卷积神经网络(CNN)时,通常是指用于图像分类的2维CNN.但是,现实世界中还使用了其他两种类型的卷积神经网络,即1维CNN和3维CNN.在本指南中,我们将介绍1D和3D CNN及其在现实世界 ...

随机推荐

- Eclipse java文件、包、工程左下角有感叹号原因及处理方法

先想如图所示: 原因:多是import引用了无用的类,或集合没指定元素的类型 解决方案如下: 1.可逐一到出现感叹号的java文件中去处理 2.在java文件中使用unchecked,如@Suppre ...

- 《JavaScript总结》js的运行机制

首先大家都知道javascript是单线程语言. 什么是单线程呢?比如我们去车站买票,只有一个售票窗口,大家排队买票,需要前面的人买完票,后面的人才能买票. 那为什么javascript不能是多线程呢 ...

- 小程序开发--移动端分辨率与rpx

首先说一个很有意思的问题:一块720p的屏幕和1080p的屏幕那个大? 这个问题很有代表性,如果手机竖着放,720p=720px*1280px,而1080p=1080px*1920px;那么在宽度上, ...

- [java]类初始化挺有意思的题目

public class Base { private String baseName = "base"; public Base() { callName(); } public ...

- 【web开发】docker中的数据库

注:自从开始使用docker,部署方面的事情就简单多了.使用docker构建的数据库容器不用直接安装,开启后就可以使用,也比以前方便很多.下面将一些要点记录下来. 下面的例子使用以下环境: - 系统( ...

- RocketMQ源码 — 四、 Consumer 接收消息过程

Consumer consumer pull message 订阅 在Consumer启动之前先将自己放到一个本地的集合中,再以后获取消费者的时候会用到,同时会将自己订阅的信息告诉broker 接收消 ...

- 依赖倒置原则(DIP)

什么是依赖倒置呢?简单地讲就是将依赖关系倒置为依赖接口,具体概念如下: 1.上层模块不应该依赖于下层模块,它们共同依赖于一个抽象(父类不能依赖子类,它们都要依赖于抽象类) 2.抽象不能依赖于具体,具体 ...

- MAC 地址(单播、组播、广播地址分类)

简介 一个制造商在生产制造网卡之前,必须先向 IEEE 注册,以获取到一个长度为 24bit 的厂商代码,也称为 OUI(Organizationally-Unique Identifier).制造商 ...

- [转]VirtualBox centos7扩容

本文转自:https://www.cnblogs.com/xd502djj/p/7367704.html 有时候扩容还真不如重新建立一个大硬盘的系统,但是如果你安装了好多东西的话,那还是来扩容一下吧. ...

- 重构——一个小例子

菜鸟区域,老鸟绕路! 原代码,这是一个可以借阅影片的小程序,你可以想象成某个大型系统,我想代码应该都能很容易看懂: using System; using System.Collections.Gen ...