seg:NLP之正向最大匹配分词

已迁移到我新博客,阅读体验更佳seg:NLP之正向最大匹配分词

完整代码实现放在我的github上:click me

一、任务要求

- 实现一个基于词典与规则的汉语自动分词系统。

二、技术路线

采用正向最大匹配(FMM)方法对输入的中文语句进行分词,具体的实现可以分为下面几个步骤:

- 对输入的一个中文语句,首先在程序中判断并确保语句中不包含数字或者字母

- 在句子中的当前位置开始取与词典dic_ce.txt中最大匹配长度的词作为一个分词段,如果没有在词典中成功匹配到就将句子在当前匹配位置的这个字作为一个分词段并将匹配位置向前挪一个位置

- 重复第2步直到匹配位置移到句末

下面是用FMM方法分词的具体实现:

//param@seg:保存分词段结果的vector

//param@st:带分词的中文语句

void segment(vector<string> &seg, string st) {

int pos = 0;

int sz = st.length();

string t;

int cnt = 0, spos;

while (pos < sz) {

cnt = pos;

spos = pos;

t = "";

while (st[cnt]) {

t += st.substr(cnt, 2);

if (wordmap.find(t) != wordmap.end())

pos = cnt + 2;

cnt += 2;

}

if (pos == spos) {

seg.push_back(st.substr(spos, 2));

pos += 2;

}else {

seg.push_back(st.substr(spos, pos - spos));

}

}

return;

}

三、数据说明

- 汉英词典dic_ce.txt,读取其中的汉词用于与句中词进行匹配,词典采用GBK编码,下面是给出文件内容示例:

//gbk编码,每行第一个词是汉词,后面是它对应的英译单词,以','分隔

阿弥陀佛,Amitabha

阿米巴,amoeba,amoebae

阿姆斯特丹,Amsterdam

阿斯匹林,aspirin

四、性能分析

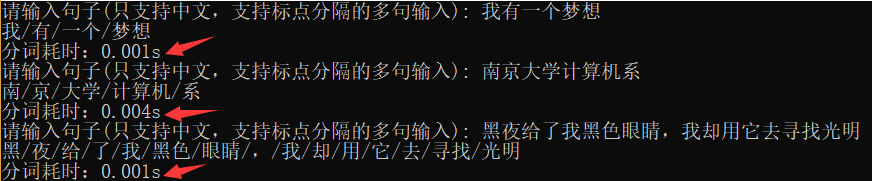

- 假设输入中文语句长度为n,程序时间复杂度最坏情况下是O(n^2),最好情况是O(n),下面是程序分析结果及分词耗时评测的截图:

五、运行环境

- 将执行文件seg.exe与数据字典dic_ce.txt放在同一个目录下,然后点击seg.exe即可正常运行,进入运行窗口后根据提示进行输入即可得到分词结果。

seg:NLP之正向最大匹配分词的更多相关文章

- Python学习实践------正向最大匹配中文分词

正向最大匹配分词: 1.加载词典文件到集合中,取词典文件中最大长度词的length 2.每次先在句子中按最大长度分割,然后判断分割的词是否存在字典中,存在则记录此词,调整起始点. 3.不存在则按最大长 ...

- 【nlp】中文分词基础原则及正向最大匹配法、逆向最大匹配法、双向最大匹配法的分析

分词算法设计中的几个基本原则: 1.颗粒度越大越好:用于进行语义分析的文本分词,要求分词结果的颗粒度越大,即单词的字数越多,所能表示的含义越确切,如:“公安局长”可以分为“公安 局长”.“公安局 长” ...

- NLP舞动之中文分词浅析(一)

一.简介 针对现有中文分词在垂直领域应用时,存在准确率不高的问题,本文对其进行了简要分析,对中文分词面临的分词歧义及未登录词等难点进行了介绍,最后对当前中文分词实现的算法原理(基于词表. ...

- NLP自然语言处理中英文分词工具集锦与基本使用介绍

一.中文分词工具 (1)Jieba (2)snowNLP分词工具 (3)thulac分词工具 (4)pynlpir 分词工具 (5)StanfordCoreNLP分词工具 1.from stanfor ...

- 哈工大 NLP 实验一 汉语分词系统

NLP实验代码可见github:NLP实验代码整理 本实验会查重,而且写起来难度比较大,建议早一些开始.实验报告要用顶会论文形式呈现,建议使用overleaf里的ACL论文latex模板比较方便一点.

- 逆向最大匹配分词算法C#

逆向顺序 句子:大家好我叫XX我是一名程序员 程序员 -> 序员 -> 员 名程序 -> 程序 -> 序 一名程 -> 名程 -> 程 是一名 -> 一名 - ...

- 分词,复旦nlp,NLPIR汉语分词系统

http://www.nlpir.org/ http://blog.csdn.net/zhyh1986/article/details/9167593

- 深度学习将会变革NLP中的中文分词——TODO 待好好细看

见:https://www.leiphone.com/news/201608/IWvc75oJglAIsDvJ.html TODO 待好好细看

- 11大Java开源中文分词器的使用方法和分词效果对比,当前几个主要的Lucene中文分词器的比较

本文的目标有两个: 1.学会使用11大Java开源中文分词器 2.对比分析11大Java开源中文分词器的分词效果 本文给出了11大Java开源中文分词的使用方法以及分词结果对比代码,至于效果哪个好,那 ...

随机推荐

- fasthttp 的 goroutine pool 实现探究

引言 fasthttp是一个非常优秀的web server框架,号称比官方的net/http快10倍以上.fasthttp用了很多黑魔法.俗话说,源码面前,了无秘密,我们今天通过源码来看一看她的gor ...

- 【爆料】-《堪培拉大学毕业证书》Canberra一模一样原件

☞堪培拉大学毕业证书[微/Q:2544033233◆WeChat:CC6669834]UC毕业证书/联系人Alice[查看点击百度快照查看][留信网学历认证&博士&硕士&海归& ...

- java EE 、java SE 、java ME的区别

- appium---【已解决】【Mac】如何查看java的安装路径及JAVA_HOME环境变量的配置

报错截图:根据提示可以看出,JAVA_HOME的环境变量配置错误,需要重新配置. 1.查看Java版本 打开mac电脑,查看java版本,打开终端Terminal,通过命令查看java的版本 Luck ...

- 大白话5分钟带你走进人工智能-第三节最大似然推导mse损失函数(深度解析最小二乘来源)(1)

第三节最大似然推导mse损失函数(深度解析最小二乘来源) 在第二节中,我们介绍了高斯分布的 ...

- Spire高效稳定的.NET组件

年末将至,又到了一年一度的收集发票时间,平时零零碎碎的花钱都是不在意开发票,现在好了,到处找发票来报销,简直头大, 东拼西凑,终于搞定了全部发票,大伙多余的发票,麻烦艾特我一下啊,不限日期,能开发票的 ...

- 依赖注入容器-- Autofac

目录: 一.简介 二.如何使用 2.1.基本使用 2.2.接口使用 2.3. 其他注入 2.4. 注入的生命周期 一.简介 在上一篇文章中讲到替换默认服务容器,我们选择了Autofac Autofac ...

- SpringCloud学习系列之一 ----- 搭建一个高可用的注册中心(Eureka)

前言 本篇主要介绍的是SpringCloud相关知识.微服务架构以及搭建一个高可用的服务注册与发现的服务模块(Eureka). SpringCloud介绍 Spring Cloud是在Spring B ...

- 轻量级原生 ajax 函数,支持 get/array post/array post/json

原生js封装 function ajaxRequest(type, url, data, callback, failCallBack, header, dataType) { var url_enc ...

- Unity 捏脸整理及基于骨骼的捏脸功能实现

目前实现捏脸功能的方式主要有两种.一个是Blendshape(融合变形),一个是基于骨骼驱动的方式,通过修改骨骼矩阵(bindpose)来影响SkinMesh.这两种方式的最终原理都是在shader ...