TensorFlow简易学习[1]:基本概念和操作示例

简介

TensorFlow是一个实现机器学习算法的接口,也是执行机器学习算法的框架。使用数据流式图规划计算流程,可以将计算映射到不同的硬件和操作系统平台。

主要概念

TensorFlow的计算可以表示为有向图(directed graph),或者计算图(computation graph),计算图描述了数据的就算流程,其中每个运算操作(operation)作为一个节点(node),节点与节点之间连接称为边(edge)。在计算图变中流动(flow)的数据被称为张量(tensor),故称TensorFlow。

计算图实例[ref1]

具体说,在一次运算中[ref2]:

1. 使用图 (graph) 来表示计算任务:基本操作示例 ;

2. 在被称之为 会话 (Session) 的上下文 (context) 中执行图:基本操作示例;

3. 通过 变量 (Variable) 维护状态:基本操作示例。

代码实例

完整示例:

#!/usr/bin/pyton '''

A simple example(linear regression) to show the complete struct that how to run a tensorflow create_data -> create_tensorflow_struct->start session

create date: 2017/10/20 ''' import tensorflow as tf

import numpy as np #create data x_data = np.random.rand(100).astype(np.float32)

y_data = x_data*0.1 + 0.3 ###create tensorflow structure begin##

Weights = tf.Variable(tf.random_uniform([1], -1.0, 1.0))

biases = tf.Variable(tf.zeros([1])) y = Weights*x_data + biases loss = tf.reduce_mean(tf.square(y-y_data))

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(loss) #when define variables, initialize must be called

#init = tf.initialize_all_variables()

### create tensorflow structure end ### sess = tf.Session()

#note: initialize_local_variables no more support in new version

if int((tf.__version__).split('.')[1]) < 12 and int((tf.__version__).split('.')[0]) < 1:

init = tf.initialize_all_variables()

else:

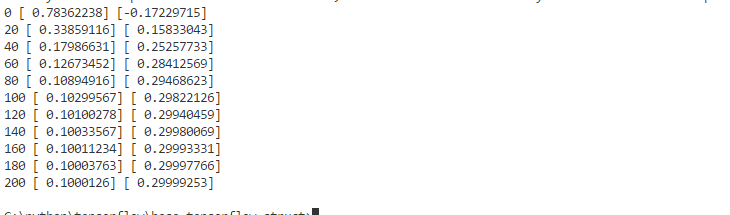

init = tf.global_variables_initializer() sess.run(init) for step in range(201):

sess.run(train)

if step % 20 == 0:

#session controls all opertions and varilables

print(step, sess.run(Weights), sess.run(biases)) sess.close()

计算结果:

基本操作示例

Session操作:

#!/usr/bin/python '''

A example to show how to call session create date: 2017/10/20

''' import tensorflow as tf #1. 定义一个操作

m1 = tf.constant([[2, 2]])

m2 = tf.constant([[3],

[3]])

dot_opeartion = tf.matmul(m1, m2) #2. 调用session实现

# 图画好以后,需要通过session来控制执行,让图来运行

# 另外每一个图中的操作都需要通过session来控制

# print result

#method1 use session

sess = tf.Session()

result = sess.run(dot_opeartion)

print(result)

sess.close() #method2 use session

with tf.Session() as sess:

result_ = sess.run(dot_opeartion)

print(result_) ##output

[[12]]

[[12]]

Placeholder操作

#!/usr/bin/python '''

A example to show how to call placehoder(类似于占位符) create date: 2017/10/20

''' import tensorflow as tf #1. 声明placehoder:待传入值

x1 = tf.placeholder(dtype=tf.float32, shape=None)

y1 = tf.placeholder(dtype=tf.float32, shape=None)

z1 = x1 + y1 x2 = tf.placeholder(dtype=tf.float32, shape=None)

y2 = tf.placeholder(dtype=tf.float32, shape=None)

z2 = tf.matmul(x2, y2) #2. 调用session,传入值

with tf.Session() as sess:

#when only one operation to run

#feed_dict: input the values into placeholder

z1_value = sess.run(z1, feed_dict={x1: 1, y1:2}) # when run multiple operaions

#run the two opeartions together

z1_value, z2_value = sess.run(

[z1, z2],

feed_dict={

x1:1, y1:2,

x2:[[2],[2]], y2:[[3,3]]

}

)

print(z1_value)

print(z2_value)

Variable操作

#!/usr/bin/python '''

A example to show how to call variables create date: 2017/10/20

''' import tensorflow as tf # 1.stuct

#our first variable in the "global_variable" set

var = tf.Variable(0) add_operation = tf.add(var,1) #把add_operation值给var

update_operation = tf.assign(var, add_operation) # once define variables, you have to initialize them by doing this

init = tf.global_variables_initializer() # 2. call session

with tf.Session() as sess:

sess.run(init)

for count in range(3):

sess.run(update_operation)

print(sess.run(var))

--------------------------------------

说明:本列为前期学习时记录,为基本概念和操作,不涉及深入部分。文字部分参考在文中注明,代码参考莫凡

TensorFlow简易学习[1]:基本概念和操作示例的更多相关文章

- TensorFlow简易学习[3]:实现神经网络

TensorFlow本身是分布式机器学习框架,所以是基于深度学习的,前一篇TensorFlow简易学习[2]:实现线性回归对只一般算法的举例只是为说明TensorFlow的广泛性.本文将通过示例Ten ...

- TensorFlow简易学习[2]:实现线性回归

上篇介绍了TensorFlow基本概念和基本操作,本文将利用TensorFlow举例实现线性回归模型过程. 线性回归算法 线性回归算法是机器学习中典型监督学习算法,不同于分类算法,线性回归的输出是整个 ...

- Spring的入门学习笔记 (AOP概念及操作+AspectJ)

AOP概念 1.aop:面向切面(方面)编程,扩展功能不通过源代码实现 2.采用横向抽取机制,取代了传统的纵向继承重复代码 AOP原理 假设现有 public class User{ //添加用户方法 ...

- tensorflow学习笔记——常见概念的整理

TensorFlow的名字中已经说明了它最重要的两个概念——Tensor和Flow.Tensor就是张量,张量这个概念在数学或者物理学中可以有不同的解释,但是这里我们不强调它本身的含义.在Tensor ...

- 深度学习框架Tensor张量的操作使用

- 重点掌握基本张量使用及与numpy的区别 - 掌握张量维度操作(拼接.维度扩展.压缩.转置.重复……) numpy基本操作: numpy学习4:NumPy基本操作 NumPy 教程 1. Tens ...

- tensorflow笔记:流程,概念和简单代码注释

tensorflow是google在2015年开源的深度学习框架,可以很方便的检验算法效果.这两天看了看官方的tutorial,极客学院的文档,以及综合tensorflow的源码,把自己的心得整理了一 ...

- (转) TensorFlow深度学习,一篇文章就够了

TensorFlow深度学习,一篇文章就够了 2016/09/22 · IT技术 · TensorFlow, 深度学习 分享到:6 原文出处: 我爱计算机 (@tobe迪豪 ) 作者: 陈迪 ...

- Oracle RAC学习笔记:基本概念及入门

Oracle RAC学习笔记:基本概念及入门 2010年04月19日 10:39 来源:书童的博客 作者:书童 编辑:晓熊 [技术开发 技术文章] oracle 10g real applica ...

- Java IO学习笔记:概念与原理

Java IO学习笔记:概念与原理 一.概念 Java中对文件的操作是以流的方式进行的.流是Java内存中的一组有序数据序列.Java将数据从源(文件.内存.键盘.网络)读入到内存 中,形成了 ...

随机推荐

- C#命令行解析工具

我将告诉大家两个方法去获取C#输入的命令行参数. 第一个方法: 林选臣大神写的,他的方法很简单. 首先复制两个类到项目 public class CommandLineArgumentParser { ...

- 在centos6编译配置httpd2.4的N种方法

前言 我们使用linux的过程中,一定会用到httpd这个服务,在centos7上,默认安装的httpd就是2.4版本,大家都知道,2.4版本相对之前的版本已经做了改进,用起来更加方便,但是我们的ce ...

- Memory Analyzer Tool 使用手记

最近一段时间一直在研究热部署,热部署中涉及到一个比较头痛的问题就是查内存泄露(Memory Leak),于是乎在研究热部署的过程中,干的最多的一件事就是查内存泄露. 查内存泄露,最开始尝试 ...

- java如何调用接口方式一

java如何调用接口 其实对于java调用接口进行获取对方服务器的数据在开发中特别常见,然而一些常用的基础的知识总是掌握不牢,让人容易忘记,写下来闲的时候看看,比回想总会好一些. 总体而言,一些东西知 ...

- 在MVC中使用rdlc格式的报表

前言 近期,在公司做的项目中做到报表模块需要使用rdlc格式的报表,这个报表需要使用WebForm来加载,但是现在用ASP.NET做项目基本上都是MVC.由于以前没有使用过,因此记录下来,供以后查阅. ...

- JAVA基础知识总结:九

二.面向对象特性之继承 1.什么是继承? 如果两个或者两个以上的类具有相同的属性和方法,我们可以抽取一个类出来,在抽取出来的类中声明各个类中公共的部分 被抽取出来的类-------父类,基类,超类 两 ...

- mysql 安装配置

l 下载压缩包: 官网下载地址:https://dev.mysql.com/downloads/mysql/5.1.html#downloads 第一步: 将下载的压缩包解压到你要安装的目录下 第二 ...

- Golang访问Redis初体验

go语言的client在redis官网上有很多l客户端,个人感觉redigo使用起来更人性化,重要的是源代码结构很清晰,重要的是支持管道.发布和订阅.连接池等等,所以我选择redigo作为尝试. 1. ...

- php 不写闭合标签

参阅了一些文章,对PHP闭合标签的总结如下: 好处:如果这个是一个被别人包含的程序,没有这个结束符,可以减少很多很多问题,比如说:header, setcookie, session_st ...

- JAVA提高十一:LinkedList深入分析

上一节,我们学习了ArrayList 类,本节我们来学习一下LinkedList,LinkedList相对ArrayList而言其使用频率并不是很高,因为其访问元素的性能相对于ArrayList而言比 ...