通过爬虫爬取四川省公共资源交易平台上最近的招标信息 --- URLConnection

通过爬虫爬取公共资源交易平台(四川省)最近的招标信息

一:引入JSON的相关的依赖

<dependency>

<groupId>net.sf.json-lib</groupId>

<artifactId>json-lib</artifactId>

<version>2.4</version>

<classifier>jdk15</classifier>

</dependency>

二:通过请求的url获取URLConnection连接

package com.svse.pachong;

import java.io.InputStream;

import java.net.HttpURLConnection;

import java.net.URL;

import java.net.URLConnection;import org.apache.log4j.Logger;

/**

* 通过请求的url获取URLConnection连接

* @author lenovo

* @date 2019年1月22日

* description:

*/

public class open_url_test {public static Logger logger = Logger.getLogger(open_url_test.class);

public boolean openurl(String url_infor) throws Exception{

URL url = new URL(url_infor);

// 连接类的父类,抽象类

URLConnection urlConnection = url.openConnection();// http的连接类

HttpURLConnection httpURLConnection = (HttpURLConnection) urlConnection;/* 设定请求的方法,默认是GET(对于知识库的附件服务器必须是GET,如果是POST会返回405。

流程附件迁移功能里面必须是POST,有所区分。)*/

httpURLConnection.setRequestMethod("GET");

// 设置字符编码 httpURLConnection.setRequestProperty("Charset", "UTF-8");

// 打开到此 URL引用的资源的通信链接(如果尚未建立这样的连接)。

int code = httpURLConnection.getResponseCode();

System.out.println("code:"+code); //连接成功 200

try {

InputStream inputStream = httpURLConnection.getInputStream();

System.out.println("连接成功");

logger.info("打开"+url_infor+"成功!");

return true;

}catch (Exception exception){

logger.info("打开"+url_infor+"失败!");

return false;

}

}

}

三:通过爬取的url解析想要的数据,并以json的格式返回

package com.svse.pachong;

import java.io.BufferedReader;

import java.io.IOException;

import java.io.InputStream;

import java.io.InputStreamReader;

import java.net.URL;

import java.nio.charset.Charset;

import net.sf.json.JSONException;

import net.sf.json.JSONObject;/**

* 通过爬取的url解析想要的数据,并以json的格式返回

* @param urlString 需要爬取的网站url路径

* @return 返回json结果的数据

* @throws IOException

* @throws JSONException

*/

public class readData {public static JSONObject readData(String urlString) throws IOException, JSONException{

InputStream is = new URL(urlString).openStream();

try {

BufferedReader rd = new BufferedReader(new InputStreamReader(is, Charset.forName("UTF-8")));

StringBuilder sb = new StringBuilder();

int cp;

while ((cp = rd.read()) != -1) {

sb.append((char) cp);

}

String jsonText = sb.toString();

JSONObject json = JSONObject.fromObject(jsonText);

return json;

} finally {

is.close();

}

}

}

四:爬取入口

package com.svse.pachong;

import java.io.IOException;

import net.sf.json.JSONArray;

import net.sf.json.JSONException;

import net.sf.json.JSONObject;/**

* 爬取的入口

* @author lenovo

* @date 2019年1月22日

* description:

*/

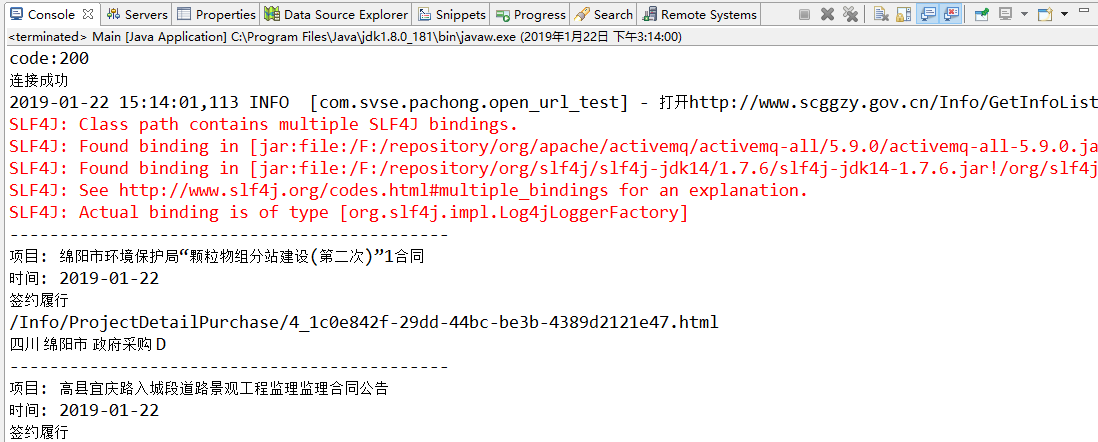

public class Main {static String urlString = "http://www.scggzy.gov.cn/Info/GetInfoListNew?keywords=×=4×Start=×End=&province=&area=&businessType=&informationType=&industryType=&page=1&parm=1534929604640";

@SuppressWarnings("static-access")

public static void main(String[] args) {open_url_test oUrl = new open_url_test();

try {

if (oUrl.openurl(urlString)) {

readData rData = new readData();

JSONObject json = rData.readData(urlString);

JSONObject ob=JSONObject.fromObject(json);String data=ob.get("data").toString(); //JSONObject 转 String

data="["+data.substring(1,data.length()-1)+"]";JSONArray json2=JSONArray.fromObject(data); //String 转 JSONArray

for (int i = 0; i < 10; i++) {

JSONObject jsonObject = (JSONObject) json2.get(i);

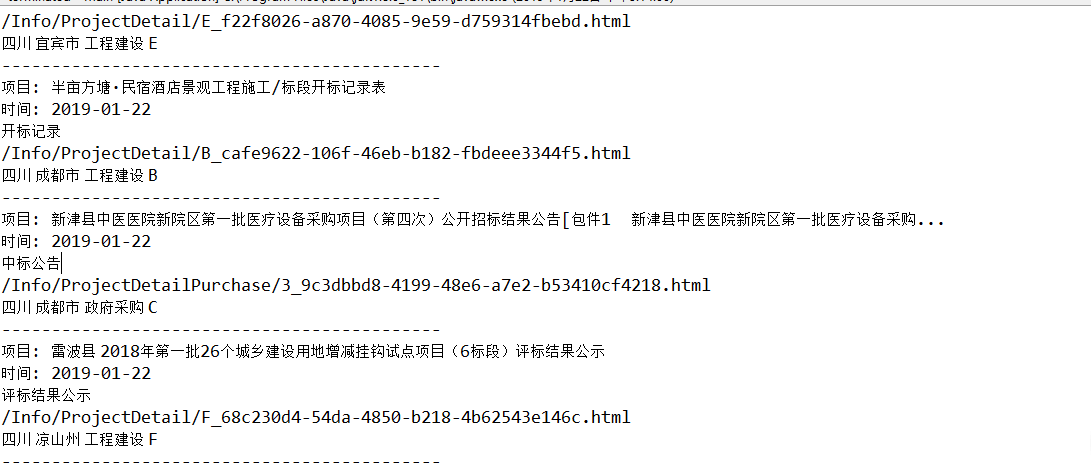

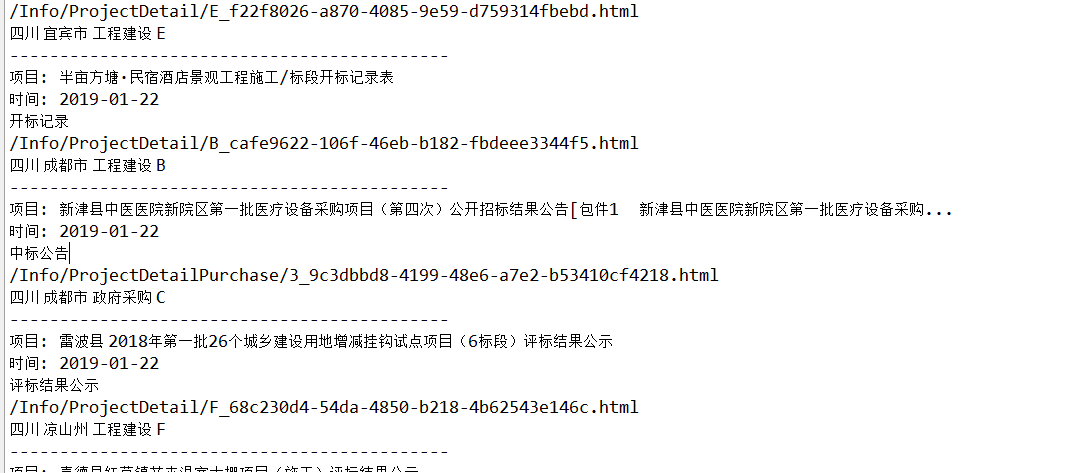

System.out.println("--------------------------------------------");

System.out.println("项目: "+jsonObject.get("Title"));

System.out.println("时间: "+jsonObject.get("CreateDateStr"));

System.out.println(jsonObject.get("TableName"));

System.out.println(jsonObject.get("Link"));

System.out.println( jsonObject.get("province") +" "+jsonObject.get("username")+" "+jsonObject.get("businessType")+" "+jsonObject.get("NoticeType"));

}

}else{

System.out.println("解析数据失败!");

}

} catch (JSONException e) {

e.printStackTrace();

} catch (IOException e) {

e.printStackTrace();

} catch (Exception e) {

e.printStackTrace();

}

}}

四:测试结果

至此,整个爬取的任务就结束了!

通过爬虫爬取四川省公共资源交易平台上最近的招标信息 --- URLConnection的更多相关文章

- python爬虫爬取京东、淘宝、苏宁上华为P20购买评论

爬虫爬取京东.淘宝.苏宁上华为P20购买评论 1.使用软件 Anaconda3 2.代码截图 三个网站代码大同小异,因此只展示一个 3.结果(部分) 京东 淘宝 苏宁 4.分析 这三个网站上的评论数据 ...

- Java爬虫爬取网站电影下载链接

之前有看过一段时间爬虫,了解了爬虫的原理,以及一些实现的方法,本项目完成于半年前,一直放在那里,现在和大家分享出来. 网络爬虫简单的原理就是把程序想象成为一个小虫子,一旦进去了一个大门,这个小虫子就像 ...

- 如何使用robots禁止各大搜索引擎爬虫爬取网站

ps:由于公司网站配置的测试环境被百度爬虫抓取,干扰了线上正常环境的使用,刚好看到每次搜索淘宝时,都会有一句由于robots.txt文件存在限制指令无法提供内容描述,于是便去学习了一波 1.原来一般来 ...

- node:爬虫爬取网页图片

代码地址如下:http://www.demodashi.com/demo/13845.html 前言 周末自己在家闲着没事,刷着微信,玩着手机,发现自己的微信头像该换了,就去网上找了一下头像,看着图片 ...

- 用Python爬虫爬取广州大学教务系统的成绩(内网访问)

用Python爬虫爬取广州大学教务系统的成绩(内网访问) 在进行爬取前,首先要了解: 1.什么是CSS选择器? 每一条css样式定义由两部分组成,形式如下: [code] 选择器{样式} [/code ...

- 简单的python爬虫--爬取Taobao淘女郎信息

最近在学Python的爬虫,顺便就练习了一下爬取淘宝上的淘女郎信息:手法简单,由于淘宝网站本上做了很多的防爬措施,应此效果不太好! 爬虫的入口:https://mm.taobao.com/json/r ...

- 使用Python爬虫爬取网络美女图片

代码地址如下:http://www.demodashi.com/demo/13500.html 准备工作 安装python3.6 略 安装requests库(用于请求静态页面) pip install ...

- python3爬虫爬取网页思路及常见问题(原创)

学习爬虫有一段时间了,对遇到的一些问题进行一下总结. 爬虫流程可大致分为:请求网页(request),获取响应(response),解析(parse),保存(save). 下面分别说下这几个过程中可以 ...

- python网络爬虫(10)分布式爬虫爬取静态数据

目的意义 爬虫应该能够快速高效的完成数据爬取和分析任务.使用多个进程协同完成一个任务,提高了数据爬取的效率. 以百度百科的一条为起点,抓取百度百科2000左右词条数据. 说明 参阅模仿了:https: ...

随机推荐

- [Poj1185][Noi2001]炮兵阵地(状压dp)

炮兵阵地 Time Limit: 2000MS Memory Limit: 65536K Total Submissions: 29476 Accepted: 11411 Descriptio ...

- java学习——关于java课件上动手动脑问题简单的分析

问题一:关于以下的代码为什么会产生错误的问题的简单分析. 第一个动手动脑提供了一下的代码,可以发现,在Foo的这个类中只定义了一个Foo(int)类型的构造函数,在之前的学习工程中,我们并没有接触到j ...

- zookeeper客户端

查看具体结点信息 bash zkServer.sh status 查看哪个结点被选作leader或者followerecho stat|nc 127.0.0.1 2181 测试是否启动了该Server ...

- 【APUE】线程与信号

每个线程都有自己的信号屏蔽字,但是信号的处理是进程中所有线程共享的.进程中的信号是递送到单个线程的. 线程中pthread_sigmask函数类似与进程的sigprocmask函数,可以用来阻塞信号. ...

- 《Spring设计思想》AOP设计基本原理

0.前言 Spring 提供了AOP(Aspect Oriented Programming) 的支持, 那么,什么是AOP呢?本文将通过一个另外一个角度来诠释AOP的概念,帮助你更好地理解和使用Sp ...

- web.xml文件中各个配置的说明

<?xml version="1.0" encoding="UTF-8"?><web-app xmlns:xsi="http://w ...

- 一个JS引发的跨域问题

忽然遇上跨域错误. 我们有张页面,使用了EXT.js,在本地运行正常,部署到服务器上,出不来数据.F12调试,提示有跨域错误? XMLHttpRequest cannot load http://19 ...

- cocos2dx笔记1:概述

1.核心的类和功能 CCDirector gameLoop,实现场景绘制.多个场景之间切换控制.控制游戏的停止,暂停,等生命周期. CCScene 场景类,每一个场景能够理解为一个游戏镜头.状态 CC ...

- Lightoj 1005 Rooks(DP)

A rook is a piece used in the game of chess which is played on a board of square grids. A rook can o ...

- 使用PXE安装CentOS7

1.环境 本文使用VMware 虚拟机进行实验. 点击VMware--编辑--虚拟网络编辑器,新建VMnet15,选择仅主机模式,取消勾选DHCP服务(因为这里使用自己的DHCP服务).我这里配好后是 ...