【机器学习基本理论】详解最大后验概率估计(MAP)的理解

【机器学习基本理论】详解最大后验概率估计(MAP)的理解

https://blog.csdn.net/weixin_42137700/article/details/81628065

最大似然估计(Maximum likelihood estimation, 简称MLE)和最大后验概率估计(Maximum a posteriori estimation, 简称MAP)是很常用的两种参数估计方法,如果不理解这两种方法的思路,很容易弄混它们。 下文将详细说明MLE和MAP的思路与区别。上篇讲解了MLE的相应知识。【机器学习基本理论】详解最大似然估计(MLE)、最大后验概率估计(MAP),以及贝叶斯公式的理解 下面讲解最大后验概率MAP的相关知识。 1最大后验概率估计 最大似然估计是求参数theta, 使似然函数p(x0|theta)最大。 最大后验概率估计则是想求theta使得p(x0|theta)p(theta)最大。

求得的theta不单单让似然函数大,theta自己出现的先验概率也得大。 (这有点像正则化里加惩罚项的思想,不过正则化里是利用加法,而MAP里是利用乘法)

MAP其实是在最大化p(theta|x0)=p(x0|theta)p(theta)/p(x0),不过因为x0是确定的(即投出的“反正正正正反正正正反”),p(x0)是一个已知值,所以去掉了分母p(x0) (假设“投10次硬币”是一次实验,实验做了1000次,“反正正正正反正正正反”出现了n次, 则p(x0)=n/1000总之,这是一个可以由数据集得到的值)。最大化p(theta|x0)的意义也很明确,x0已经出现了,要求theta取什么值使p(theta|x0)最大。顺带一提,p(theta|x0)即后验概率,这就是“最大后验概率估计”名字的由来。

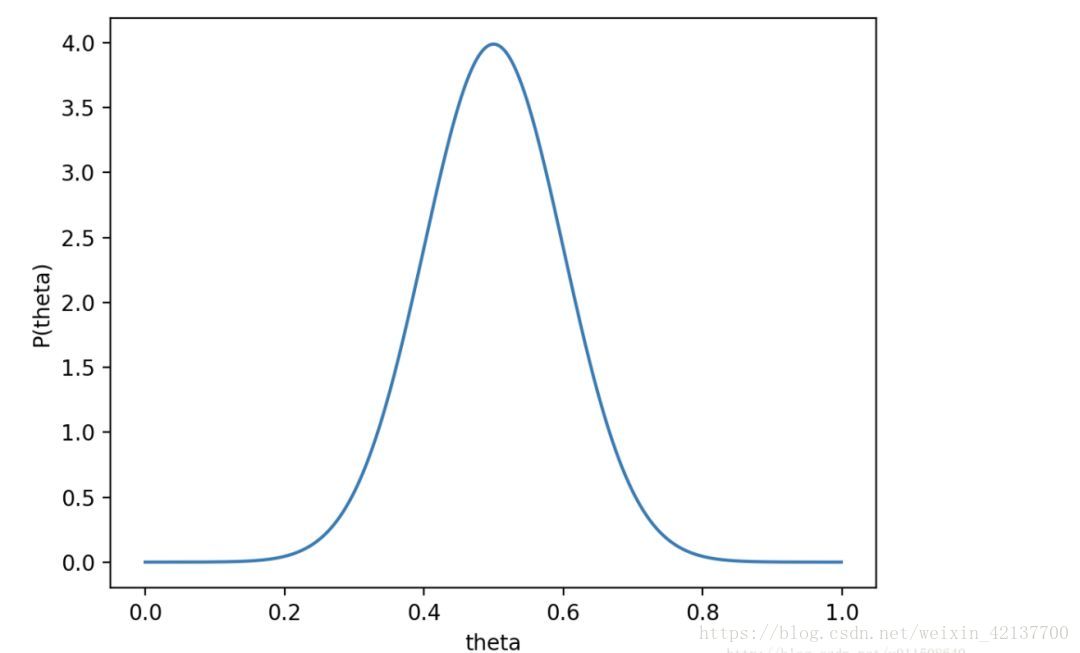

对于投硬币的例子来看,我们认为(”先验地知道“)theta取取0.5的概率很大,取其他值的概率小一些。我们用一个高斯分布来具体描述我们掌握的这个先验知识,例如假设p(theta)为均值0.5,方差0.1的高斯函数,如下图:

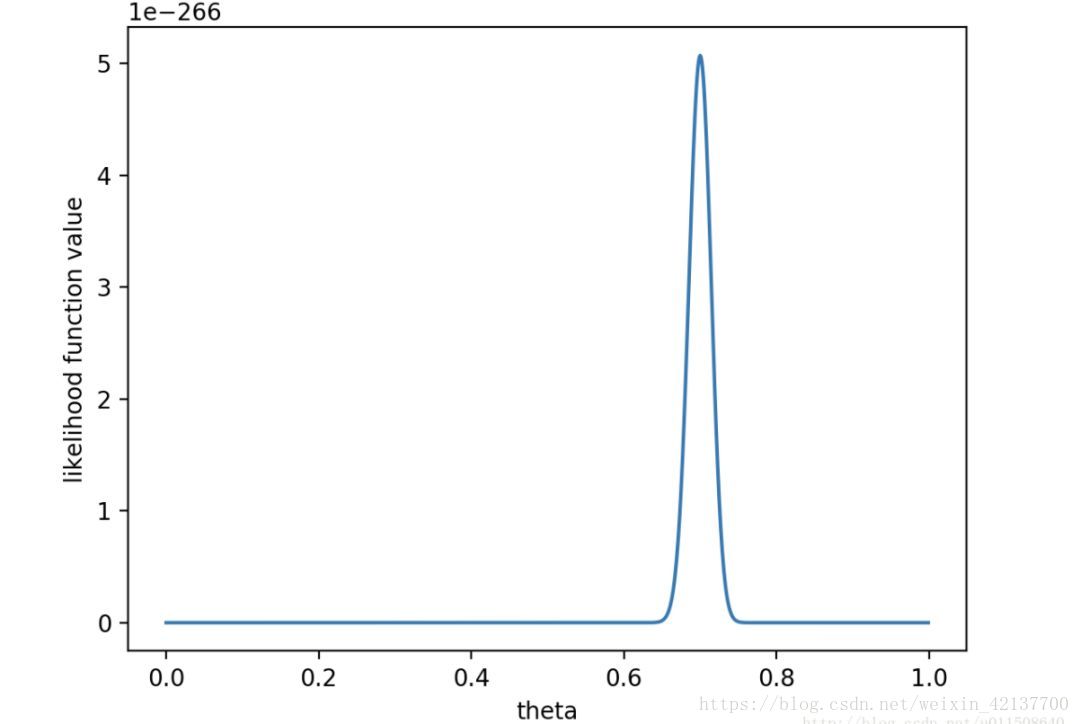

则p(x0|theta)p(theta)的函数图像为:

最后,那要怎样才能说服一个贝叶斯派相信theta=0.7呢? 你得多做点实验。。

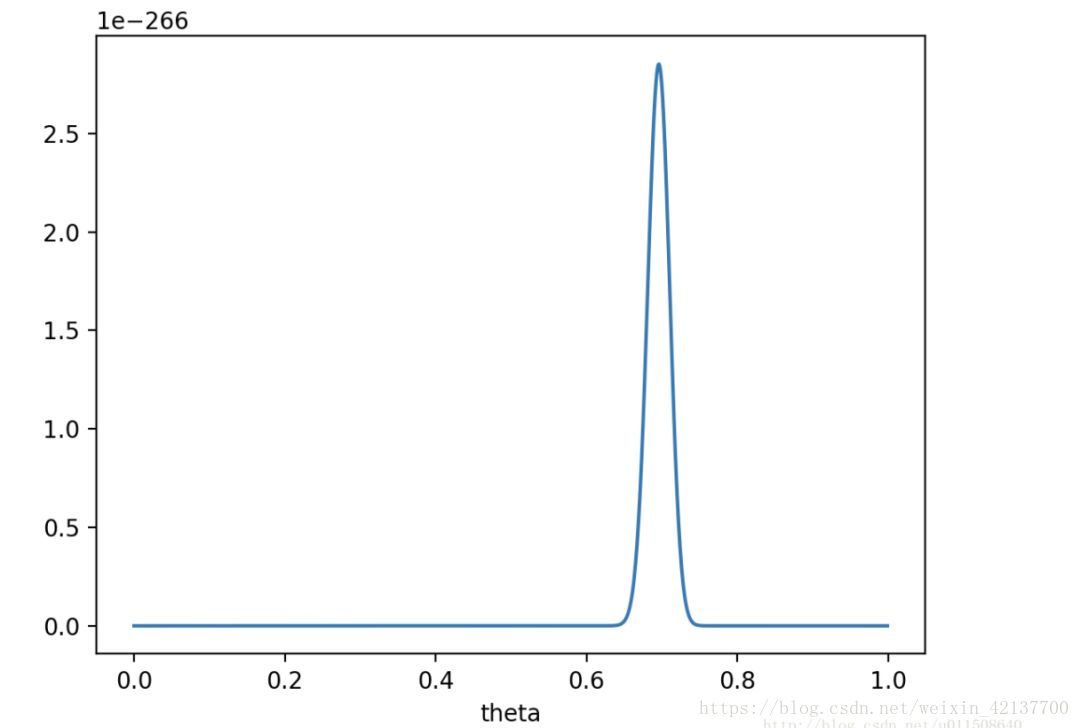

如果做了1000次实验,其中700次都是正面向上,这时似然函数为:

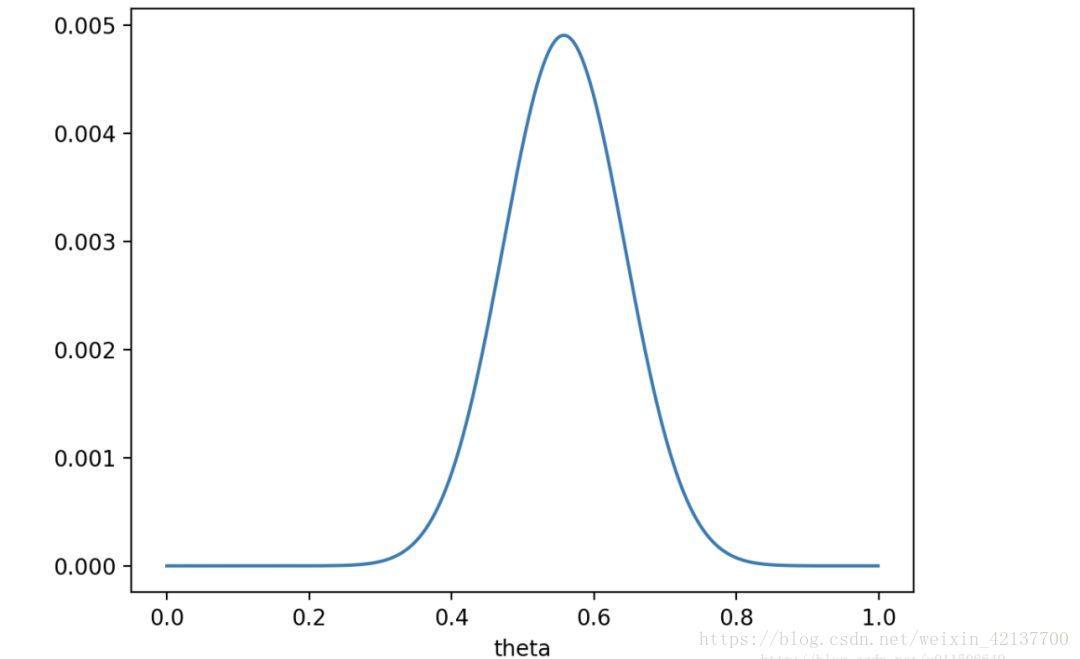

如果仍然假设p(theta)为均值0.5,方差0.1的高斯函数,则p(x0|theta)p(theta)的函数图像为:

在theta=0.696,p(x0|theta)p(theta)取得最大值。

这样,就算一个考虑了先验概率的贝叶斯派,也不得不承认得把theta估计在0.7附近了。

PS. 要是遇上了顽固的贝叶斯派,认为p(theta=0.5)=1,那就没得玩了。。 无论怎么做实验,使用MAP估计出来都是theta=0.5。这也说明,一个合理的先验概率假设是很重要的。(通常,先验概率能从数据中直接分析得到)

2最大似然估计和最大后验概率估计的区别 相信读完上文,MLE和MAP的区别应该是很清楚的了。 MAP就是多个作为因子的先验概率p(theta)。 或者,也可以反过来,认为MLE是把先验概率p(theta)认为等于1,即认为theta为均匀分布,无论theta为何值,p(theta)均为1 文章地址:http://blog.csdn.net/u011508640/article/details/72815981

【机器学习基本理论】详解最大后验概率估计(MAP)的理解的更多相关文章

- 机器学习经典算法详解及Python实现--基于SMO的SVM分类器

原文:http://blog.csdn.net/suipingsp/article/details/41645779 支持向量机基本上是最好的有监督学习算法,因其英文名为support vector ...

- [PXE] Linux(centos6)中PXE 服务器搭建,PXE安装、启动及PXE理论详解

[PXE] Linux(centos6)中PXE 服务器搭建,PXE安装.启动及PXE理论详解 本篇blog主要讲述了[PXE] linux(centos)PXE无盘服务器搭建,安装,启动及pxe协议 ...

- 机器学习03 /jieba详解

机器学习03 /jieba详解 目录 机器学习03 /jieba详解 1.引言 2.分词 2.1.jieba.cut && jieba.cut_for_search 2.2.jieba ...

- 图解机器学习 | LightGBM模型详解

作者:韩信子@ShowMeAI 教程地址:http://www.showmeai.tech/tutorials/34 本文地址:http://www.showmeai.tech/article-det ...

- JVM的GC理论详解

GC的概念 GC:Garbage Collection 垃圾收集.这里所谓的垃圾指的是在系统运行过程当中所产生的一些无用的对象,这些对象占据着一定的内存空间,如果长期不被释放,可能导致OOM(堆溢出) ...

- awk理论详解、实战

答疑解惑: 为什么用awk取IP的时候用$4? ifconfig eth0 | awk -F '[ :]+' 'NR==2{print $4}' IP第二行内容如下: inet addr:10.0.0 ...

- Java集合排序及java集合类详解--(Collection, List, Set, Map)

1 集合框架 1.1 集合框架概述 1.1.1 容器简介 到目前为止,我们已经学习了如何创建多个不同的对象,定义了这些对象以后,我们就可以利用它们来做一 ...

- Java基础学习总结(53)——HTTPS 理论详解与实践

前言 在进行 HTTP 通信时,信息可能会监听.服务器或客户端身份伪装等安全问题,HTTPS 则能有效解决这些问题.在使用原始的HTTP连接的时候,因为服务器与用户之间是直接进行的明文传输,导致了用户 ...

- 机器学习|线性回归算法详解 (Python 语言描述)

原文地址 ? 传送门 线性回归 线性回归是一种较为简单,但十分重要的机器学习方法.掌握线性的原理及求解方法,是深入了解线性回归的基本要求.除此之外,线性回归也是监督学习回归部分的基石. 线性回归介绍 ...

随机推荐

- mysql连接失败HikariPool错误

1. mysql连接失败HikariPool错误 1.1. 异常 com.zaxxer.hikari.pool.HikariPool : HikariPool-1 - Exception during ...

- RISC-V踩坑记----__builtin_clz((x)库函数的应用

RISC-V的确是个好东西,可是,免费的东西往往需要付出代价才能得到了,最近遇到了一个算法中的问题,追了好久,最终追到了这个库函数中,没想到,这个库函数居然还隐藏着一些猫腻.值得记下来啊. 首先上一个 ...

- 良好的JavaScript编码风格(语法规则)

编码风格 1.概述 "编程风格"(programming style)指的是编写代码的样式规则.不同的程序员,往往有不同的编程风格. 有人说,编译器的规范叫做"语法规则& ...

- ①泡茶看数据结构-表ADT

前言 小朽,晚上回到寝室.烧了开水,又泡了一杯下午喝了的小毛尖.耳机听着萨克斯,总结下今天学的数据结构和算法中的表ADT. 表ADT节点: #单链表 #双链表 #循环链表 ...

- mysql开启general_log查看执行sql

1.查看是否打开 SHOW variables like "%general_log%"; 2.打开 set global general_log=On 3.查看sql执行 tai ...

- SpringMVC学习(四)———— 数据回显与自定义异常处理器

一.数据回显技术 Springmvc默认支持对pojo类型的数据回显,默认不支持简单类型的数据回显 1.1.什么是数据回显? 在信息校验时,如果发生校验错误,那么把校验的数据信息,依然停留在当前页面, ...

- [CF960G] Bandit Blues

题意 给你三个正整数 \(n,a,b\),定义 \(A\) 为一个排列中是前缀最大值的数的个数,定义 \(B\) 为一个排列中是后缀最大值的数的个数,求长度为 \(n\) 的排列中满足 \(A = a ...

- shell脚本--echo和printf打印输出

bash&shell系列文章:http://www.cnblogs.com/f-ck-need-u/p/7048359.html 注:本文关于引号等特殊符号的处理仅仅只是几个例子,想要彻底搞明 ...

- yum安装php Requires: libzip5(x86-64) >= 1.3.2

*/ .hljs { display: block; overflow-x: auto; padding: 0.5em; color: #333; background: #f8f8f8; } .hl ...

- 翻译:TRUNCATE TABLE(已提交到MariaDB官方手册)

本文为mariadb官方手册:TRUNCATE TABLE的译文. 原文:https://mariadb.com/kb/en/truncate-table/我提交到MariaDB官方手册的译文:htt ...