使用java API操作hdfs--拷贝部分文件到hdfs

要求如下:

自行在本地文件系统生成一个大约一百多字节的文本文件,写一段程序(可以利用Java API或C API),读入这个文件,并将其第101-120字节的内容写入HDFS成为一个新文件。

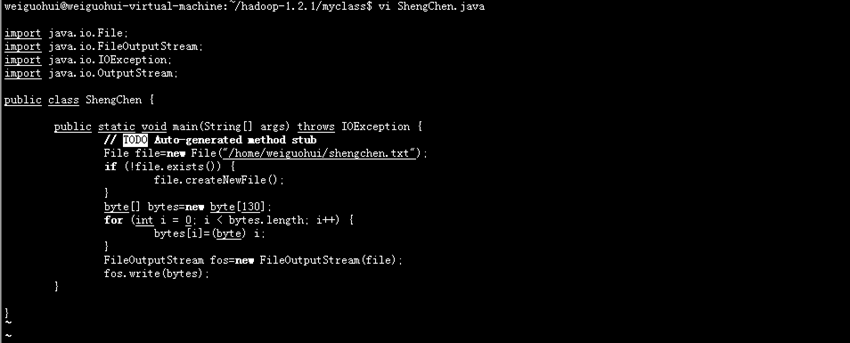

import java.io.File;

import java.io.FileOutputStream;

import java.io.IOException;

import java.io.OutputStream;

public class ShengChen {

public static void main(String[] args) throws IOException {

// TODO Auto-generated method stub

File file=new File("/home/weiguohui/shengchen.txt");

if (!file.exists()) {

file.createNewFile();

}

byte[] bytes=new byte[130];

for (int i = 0; i < bytes.length; i++) {

bytes[i]=(byte) i;

}

FileOutputStream fos=new FileOutputStream(file);

fos.write(bytes);

}

}

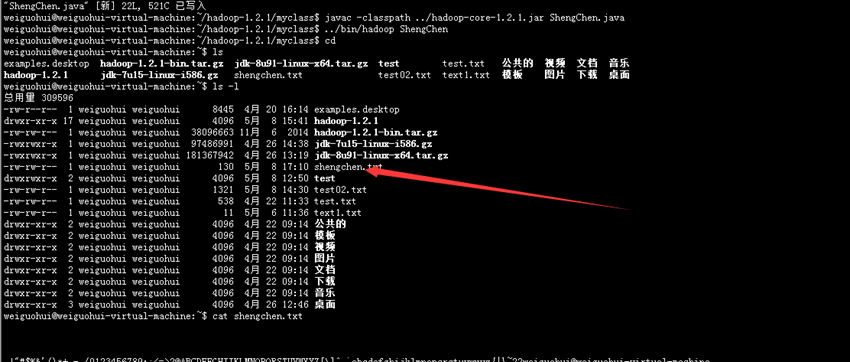

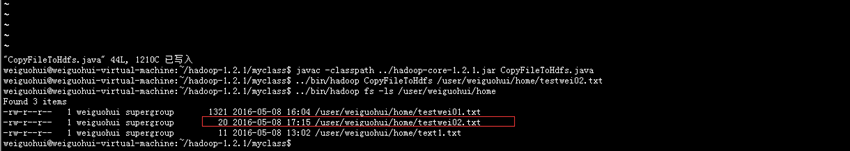

正好写入了20个字节

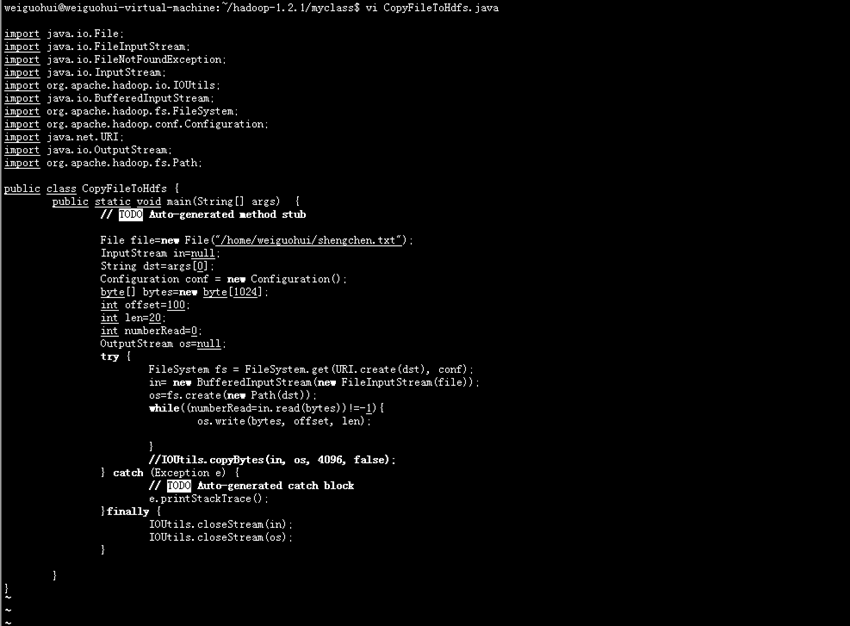

代码:

import java.io.File;

import java.io.FileInputStream;

import java.io.FileNotFoundException;

import java.io.InputStream;

import org.apache.hadoop.io.IOUtils;

import java.io.BufferedInputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.conf.Configuration;

import java.net.URI;

import java.io.OutputStream;

import org.apache.hadoop.fs.Path;

public class CopyFileToHdfs {

public static void main(String[] args) {

// TODO Auto-generated method stub

File file=new File("/home/weiguohui/shengchen.txt");

InputStream in=null;

String dst=args[0];

Configuration conf = new Configuration();

byte[] bytes=new byte[1024];

int offset=100;

int len=20;

int numberRead=0;

OutputStream os=null;

try {

FileSystem fs = FileSystem.get(URI.create(dst), conf);

in= new BufferedInputStream(new FileInputStream(file));

os=fs.create(new Path(dst));

while((numberRead=in.read(bytes))!=-1){

os.write(bytes, offset, len);

}

//IOUtils.copyBytes(in, os, 4096, false);

} catch (Exception e) {

// TODO Auto-generated catch block

e.printStackTrace();

}finally {

IOUtils.closeStream(in);

IOUtils.closeStream(os);

}

}

}

使用java API操作hdfs--拷贝部分文件到hdfs的更多相关文章

- 使用java API操作hdfs--拷贝部分文件到本地

要求:和前一篇的要求正好相反.. 在HDFS中生成一个130KB的文件: 代码如下: import java.io.IOException; import org.apache.hadoop.conf ...

- HDFS 05 - HDFS 常用的 Java API 操作

目录 0 - 配置 Hadoop 环境(Windows系统) 1 - 导入 Maven 依赖 2 - 常用类介绍 3 - 常见 API 操作 3.1 获取文件系统(重要) 3.2 创建目录.写入文件 ...

- 使用Java API操作HDFS文件系统

使用Junit封装HFDS import org.apache.hadoop.conf.Configuration; import org.apache.hadoop.fs.*; import org ...

- Hadoop之HDFS(三)HDFS的JAVA API操作

HDFS的JAVA API操作 HDFS 在生产应用中主要是客户端的开发,其核心步骤是从 HDFS 提供的 api中构造一个 HDFS 的访问客户端对象,然后通过该客户端对象操作(增删改查)HDFS ...

- hadoop2-HBase的Java API操作

Hbase提供了丰富的Java API,以及线程池操作,下面我用线程池来展示一下使用Java API操作Hbase. 项目结构如下: 我使用的Hbase的版本是 hbase-0.98.9-hadoop ...

- Kafka系列三 java API操作

使用java API操作kafka 1.pom.xml <project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xs ...

- MongoDB Java API操作很全的整理

MongoDB 是一个基于分布式文件存储的数据库.由 C++ 语言编写,一般生产上建议以共享分片的形式来部署. 但是MongoDB官方也提供了其它语言的客户端操作API.如下图所示: 提供了C.C++ ...

- hive-通过Java API操作

通过Java API操作hive,算是测试hive第三种对外接口 测试hive 服务启动 package org.admln.hive; import java.sql.SQLException; i ...

- zookeeper的java api操作

zookeeper的java api操作 创建会话: Zookeeper(String connectString,int sessionTimeout,Watcher watcher) Zookee ...

随机推荐

- Spring Boot 注解的使用

Spring Boot 优于Spring mvc ,SSM,SSH 的一个亮点就是他使用了好多的注解. 1. @Autowired 这个注解的作用是将其他的类,接口引入,类似于之前的类的初始化等,用这 ...

- JavaScript对象的深浅复制

前言 从层次上来看,对象的复制可以简单地分为浅复制和深复制,顾名思义,浅复制是指只复制一层对象的属性,不会复制对象中的对象的属性,对象的深复制会复制对象中层层嵌套的对象的属性. 在复制对象时,除了要复 ...

- LoadRunner性能测试专项班隆重开班

LoadRunner性能测试专项班隆重开班 POPTEST首届高级性能测试提升强化班开课. 也许你只是看到成功者的光鲜,却没看到他们的努力和汗水.不要否定现在,要看到未来.提高自己.怎么自己.成就自己 ...

- Android在listview添加checkbox实现单选多选操作问题

android根据View的不同状态更换不同的背景http://www.eoeandroid.com/thread-198029-1-1.html android 模仿朋友网推出的菜单效果[改进版]h ...

- Hexo + Github Pages 搭建个人博客

之前一直想搭建自己的博客,由于自己的懒惰拖到现在.好了,废话不多说!直接上干货! 安装Node.js 安装Git Github Pages配置 安装Hexo及主题设置 进阶篇-高级定制 其它实用功能 ...

- Python Selenium设计模式-POM

前言 本文就python selenium自动化测试实践中所需要的POM设计模式进行分享,以便大家在实践中对POM的特点.应用场景和核心思想有一定的理解和掌握. 为什么要用POM 基于python s ...

- 一个GOOD的Idea需要伯乐发觉-致敬错过的IDEA

类似一个微信电话本

- 不忘初心 --- 重读<<The C Programming Language>>

这篇文章应该发布在好几年前,2011年计算机界大师Dennis Ritchie仙逝,那时对大师的映象还停留在大一刚学编程时:Unix的合作开发者,C语言的发明人.通过网上的纪念文章<<Un ...

- 【Android】XML文件的解析

1.首先我们可以在res包路径下创建一个raw包,然后在raw下创建一个email.xml 文件,并修改其内容如下: <?xml version="1.0" encoding ...

- Mybatis基础学习(五)—缓存

一.概述 mybatis提供查询缓存,如果缓存中有数据就不用从数据库中获取,用于减轻数据压力,提高系统性能. 一级缓存是SqlSession级别的缓存.在操作数据库时需要 ...