kafka监控之topic的lag情况监控

需求描述:lag(滞后)是kafka消费队列性能监控的重要指标,lag的值越大,表示kafka的堆积越严重。本篇文章将使用python脚本+influxdb+grafana的方式对kafka的offset、logsiz和lag这三个参数进行监控,并以图形化的方式进行展现。

架构描述:使用python收集kafka的相关信息并存储到influxdb里;配置grafana,将influxdb里的数据以图形化的方式展现出来。

一,准备工作

1,kafka,influxdb,grafana的安装(在此不详细描述,默认为阅读文章的各位对这三样工具的使用是熟悉的)

2,查询kafka消费状态的命令/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181。本篇文章也将以此条命令输出的信息作为基础编写脚本。

#/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181

Group Topic Pid Offset logSize Lag Owner

group1 topicname1 0 978337806 978390228 52422 none

group1 topicname1 1 978337840 978390295 52455 none

group1 topicname1 2 978263557 978316052 52495 none

group1 topicname1 3 978307075 978359597 52522 none

group1 topicname1 4 978337803 978390358 52555 none

group1 topicname1 5 978337812 978390394 52582 none

说明:

group1 组名

topicname1 topic名

我们要用脚本取的,就是输出的这段内容的Offset logSize Lag这三个值,并将所有分片的这些值相加,从而获取单个topic的Offset logSize Lag的值,并将值输出到一个txt文件暂存。我这里使用一个shell脚本来取数据和一个python脚本来讲数据存储到influxdb中的方式来实现。

二,编写脚本提取Offset logSize Lag这三个值

1,给脚本创建一个独立的目录,里面会存放脚本和临时文件。

mkdir /usr/monitor

cd /usr/monitor

mkdir tmp

2,vim topic-collect.sh

#!/bin/bash

#txt文件命名规则:组-topic名字-检查项名字

source /etc/profile

/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181 | awk '{print $4}' | grep -v Offset | awk '{sum+=$1}END{print sum}' > /usr/monitor/tmp/topic-group1-topicname1-Offset.txt

/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181 | awk '{print $5}' | grep -v logSize | awk '{sum+=$1}END{print sum}' > /usr/monitor/tmp/topic-group1-topicname1-logSize.txt

/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181 | awk '{print $6}' | grep -v Lag | awk '{sum+=$1}END{print sum}' > /usr/monitor/tmp/topic-group1-topicname1-Lag.txt

其中txt是用来存储计算各分片之和的值的文件。对TXT文件名进行规范化管理会让后期增加监控十分方便清晰。

3,vim kafka-lag-collect.py #这是一个python写的脚本,用来将数据存储到influxdb中,在此之前在influxdb中建立对应的库,在这里用到的库的名称是elkDB

#!/usr/bin/python

# -*- coding: UTF-8 -*-

import time

import urllib2

import urllib

import json #Read the file

f = open('/usr/monitor/tmp/topic-group1-topicname1-Offset.txt')

Offset_sum = f.read()

f.close()

f = open('/usr/monitor/tmp/topic-group1-topicname1-logSize.txt')

logSize_sum = f.read()

f.close()

f = open('/usr/monitor/tmp/topic-group1-topicname1-Lag.txt')

Lag_sum = f.read()

f.close() dbreqdata = "group1,topic=topicname1,type=Offset value="+str(Offset_sum)+\

"\ngroup1,topic=topicname1,type=logSize value="+str(logSize_sum)+\

"\ngroup1,topic=topicname1,type=Lag value="+str(Lag_sum)

print dbreqdata

dbrequrl = "http://127.0.0.1:8086/write?db=elkDB"

dbreq= urllib2.Request(url = dbrequrl,data =dbreqdata)

print dbreq

urllib2.urlopen(dbreq)

4,脚本写完后给脚本增加一下可执行权限

chmod +x kafka-lag-collect.py

chmod +x topic-collect.sh

5,试着执行一下topic-collect.sh看能否执行成功

./topic-collect.sh

如果能执行成功的话,可以看到/usr/monitor/tmp/topic-group1-topicname1-Offset.txt里面已经有计算出来的offset总和了

6,试着执行一下kafka-lag-collect.py看能否执行成功

./kafka-lag-collect.py

如果能执行成功的话,就可以在influxdb里看到新建的表和相关数据了。

7,让topic-collect.sh脚本调用kafka-lag-collect.py脚本,这样可以避免添加两条crontab定时任务

echo "/usr/monitor/kafka-lag-collect.py" >> topic-collect.sh

8,添加定时任务,让脚本可以每分钟收集一次信息到influxdb

crontab -e

* * * * * /usr/monitor/topic-collect.sh

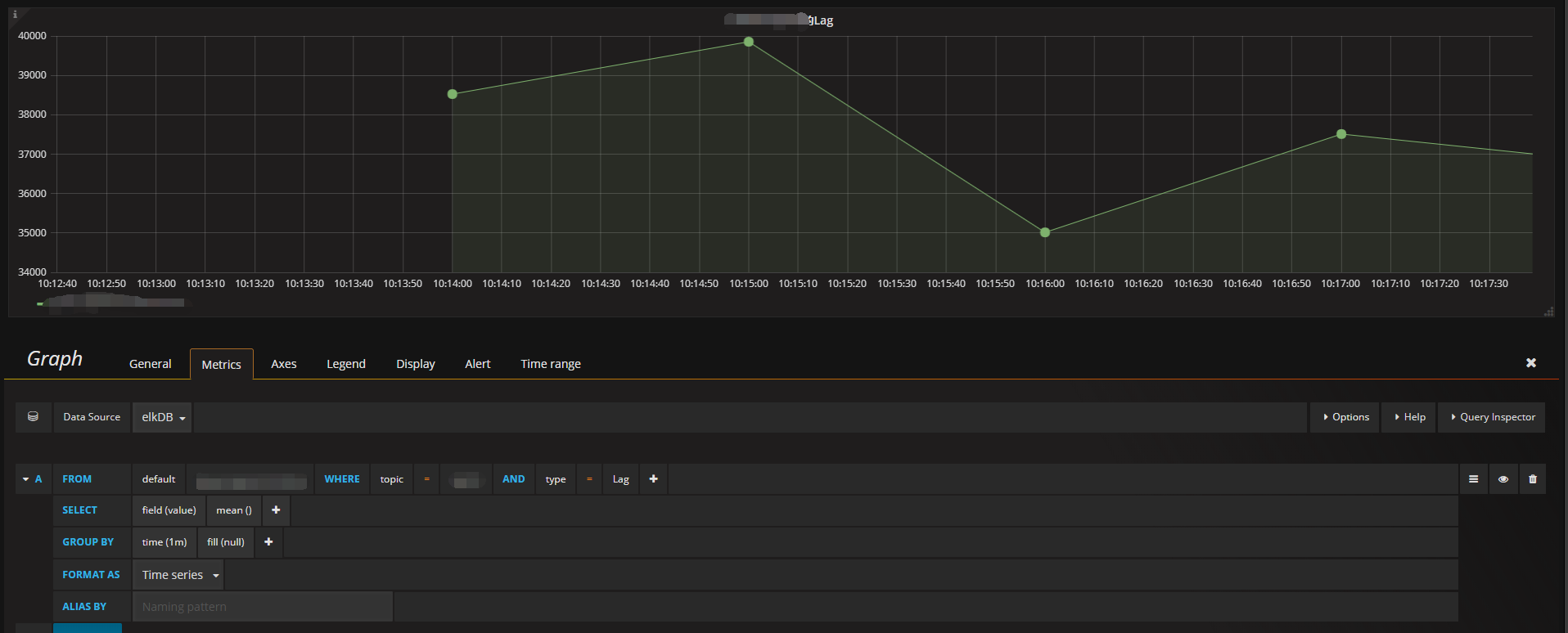

三,配置grafana展现数据

1,配置grafana数据源

2,新建图表

至此,就可以在grafana上看到监控的lag状态了。

kafka监控之topic的lag情况监控的更多相关文章

- 001使用smokeping监控idc机房网络质量情况

最近工作比较忙,也没有时间写博客,看到好友芮峰云最近一直在写博客,所以也手痒了,就先把之前的一些积累下来的文章分享给大家. 本文是介绍如何的使用smokeping来监控idc机房的网络质量情况,从监控 ...

- 限制UITextView的字数和字数监控,表情异常的情况和禁用表情

限制UITextView的字数和字数监控,表情异常的情况和禁用表情 3523FD80CC4350DE0AE7F89A8532B9A8.png 因为字数占一个字符,表情占两个字符.你要是限制15个字 ...

- Kafka vs RocketMQ—— Topic数量对单机性能的影响-转自阿里中间件

引言 上一期我们对比了三类消息产品(Kafka.RabbitMQ.RocketMQ)单纯发送小消息的性能,受到了程序猿们的广泛关注,其中大家对这种单纯的发送场景感到并不过瘾,因为没有任何一个网站的业务 ...

- (二)Kafka动态增加Topic的副本(Replication)

(二)Kafka动态增加Topic的副本(Replication) 1. 查看topic的原来的副本分布 [hadoop@sdf-nimbus-perf ~]$ le-kafka-topics.sh ...

- kubernetes之监控Prometheus实战--prometheus介绍--获取监控(一)

Prometheus介绍 Prometheus是一个最初在SoundCloud上构建的开源监控系统 .它现在是一个独立的开源项目,为了强调这一点,并说明项目的治理结构,Prometheus 于2016 ...

- 转:JMeter监控内存及CPU ——plugin插件监控被测系统资源方法

JMeter监控内存及CPU ——plugin插件监控被测系统资源方法 jmeter中也可以监控服务器的CPU和内存使用情况,但是需要安装一些插件还需要在被监测服务器上开启服务. 1.需要的插件准备 ...

- Kafka动态增加Topic的副本

一.kafka的副本机制 由于Producer和Consumer都只会与Leader角色的分区副本相连,所以kafka需要以集群的组织形式提供主题下的消息高可用.kafka支持主备复制,所以消息具备高 ...

- Kafka vs RocketMQ—— Topic数量对单机性能的影响

引言 上一期我们对比了三类消息产品(Kafka.RabbitMQ.RocketMQ)单纯发送小消息的性能,受到了程序猿们的广泛关注,其中大家对这种单纯的发送场景感到并不过瘾,因为没有任何一个网站的业务 ...

- Kafka设计解析(十)Kafka如何创建topic

转载自 huxihx,原文链接 Kafka如何创建topic? 目录 一.命令行部分 二.后台逻辑部分 Kafka创建topic命令很简单,一条命令足矣: bin/kafka-topics. --re ...

随机推荐

- 【开源】.net微服务开发引擎Anno开源啦

1.Anno是什么? Anno是一个微服务框架引擎.入门简单.安全.稳定.高可用.全平台可监控.依赖第三方框架少.底层通讯RPC(Remote Procedure Call)采用稳定可靠经过无数成功项 ...

- js-根据日期获取本年所有周日

/** * 方法 描述 Date() 返回当日的日期和时间. getDate() 从 Date 对象返回一个月中的某一天 (1 ~ 31). getDay() 从 Date 对象返回一周中的某一天 ( ...

- 深度分析ReentrantLock源码及AQS源码,从入门到入坟,建议先收藏!

一.ReentrantLock与AQS简介 在Java5.0之前,在协调对共享对象的访问时可以使用的机制只有synchronized和volatile.Java5.0增加了一种新的机制:Reentra ...

- pandas 对时间索引进行分割

截取最近1个月时间,截取最近一段时间,进行统计分析 df.loc["2016-01-05":"2016-02-05",:].tail() 在index为有序数据 ...

- 在FL Studio中如何更好地为人声加上混响(进阶教程)

为人声加上混响是我们在处理人声过程中必不可少的一步.然而,除了直接在人声混音轨道加上混响插件进行调节以外,这里还有更为细节的做法可以达到更好的效果. 步骤一:使用均衡器 在为人声加上混响之前,我们应该 ...

- 自学linux——8.firewall-cmd的命令使用

firewall-cmd使用方法 1.firewall-cmd的含义 firewall-cmd 是 firewalld的字符界面管理工具,firewalld是centos7之后版本的一大特性, 最大的 ...

- yum安装软件时报错libmysqlclient.so.18()(64bit)

错误信息 yum -y install sysbench 安装sysbench提示缺少依赖包如下图: 主要原因 缺少Percona-XtraDB-Cluster-shared-55-5.5.37-25 ...

- 【模板】【P3605】【USACO17JAN】Promotion Counting 晋升者计数——动态开点和线段树合并(树状数组/主席树)

(题面来自Luogu) 题目描述 奶牛们又一次试图创建一家创业公司,还是没有从过去的经验中吸取教训--牛是可怕的管理者! 为了方便,把奶牛从 1⋯N(1≤N≤100,000) 编号,把公司组织成一棵树 ...

- 利用反射获取对象中的值等于x的字段

Field[] field = behavior.getClass().getDeclaredFields(); for (int i = 0; i < field.length; i++) { ...

- PyQt(Python+Qt)学习随笔:QMainWindow的tabifyDockWidget方法将QDockWidget两个停靠窗选项卡式排列

专栏:Python基础教程目录 专栏:使用PyQt开发图形界面Python应用 专栏:PyQt入门学习 老猿Python博文目录 主窗口的tabifyDockWidget方法用于将主窗口的两个停靠窗口 ...