kafka监控之topic的lag情况监控

需求描述:lag(滞后)是kafka消费队列性能监控的重要指标,lag的值越大,表示kafka的堆积越严重。本篇文章将使用python脚本+influxdb+grafana的方式对kafka的offset、logsiz和lag这三个参数进行监控,并以图形化的方式进行展现。

架构描述:使用python收集kafka的相关信息并存储到influxdb里;配置grafana,将influxdb里的数据以图形化的方式展现出来。

一,准备工作

1,kafka,influxdb,grafana的安装(在此不详细描述,默认为阅读文章的各位对这三样工具的使用是熟悉的)

2,查询kafka消费状态的命令/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181。本篇文章也将以此条命令输出的信息作为基础编写脚本。

#/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181

Group Topic Pid Offset logSize Lag Owner

group1 topicname1 0 978337806 978390228 52422 none

group1 topicname1 1 978337840 978390295 52455 none

group1 topicname1 2 978263557 978316052 52495 none

group1 topicname1 3 978307075 978359597 52522 none

group1 topicname1 4 978337803 978390358 52555 none

group1 topicname1 5 978337812 978390394 52582 none

说明:

group1 组名

topicname1 topic名

我们要用脚本取的,就是输出的这段内容的Offset logSize Lag这三个值,并将所有分片的这些值相加,从而获取单个topic的Offset logSize Lag的值,并将值输出到一个txt文件暂存。我这里使用一个shell脚本来取数据和一个python脚本来讲数据存储到influxdb中的方式来实现。

二,编写脚本提取Offset logSize Lag这三个值

1,给脚本创建一个独立的目录,里面会存放脚本和临时文件。

mkdir /usr/monitor

cd /usr/monitor

mkdir tmp

2,vim topic-collect.sh

#!/bin/bash

#txt文件命名规则:组-topic名字-检查项名字

source /etc/profile

/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181 | awk '{print $4}' | grep -v Offset | awk '{sum+=$1}END{print sum}' > /usr/monitor/tmp/topic-group1-topicname1-Offset.txt

/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181 | awk '{print $5}' | grep -v logSize | awk '{sum+=$1}END{print sum}' > /usr/monitor/tmp/topic-group1-topicname1-logSize.txt

/kafka_2.11-0.10.1.0/bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group group1 --topic topicname1 --zookeeper zoo1:2181,zoo2:2181,zoo3:2181,zoo4:2181,zoo5:2181 | awk '{print $6}' | grep -v Lag | awk '{sum+=$1}END{print sum}' > /usr/monitor/tmp/topic-group1-topicname1-Lag.txt

其中txt是用来存储计算各分片之和的值的文件。对TXT文件名进行规范化管理会让后期增加监控十分方便清晰。

3,vim kafka-lag-collect.py #这是一个python写的脚本,用来将数据存储到influxdb中,在此之前在influxdb中建立对应的库,在这里用到的库的名称是elkDB

#!/usr/bin/python

# -*- coding: UTF-8 -*-

import time

import urllib2

import urllib

import json #Read the file

f = open('/usr/monitor/tmp/topic-group1-topicname1-Offset.txt')

Offset_sum = f.read()

f.close()

f = open('/usr/monitor/tmp/topic-group1-topicname1-logSize.txt')

logSize_sum = f.read()

f.close()

f = open('/usr/monitor/tmp/topic-group1-topicname1-Lag.txt')

Lag_sum = f.read()

f.close() dbreqdata = "group1,topic=topicname1,type=Offset value="+str(Offset_sum)+\

"\ngroup1,topic=topicname1,type=logSize value="+str(logSize_sum)+\

"\ngroup1,topic=topicname1,type=Lag value="+str(Lag_sum)

print dbreqdata

dbrequrl = "http://127.0.0.1:8086/write?db=elkDB"

dbreq= urllib2.Request(url = dbrequrl,data =dbreqdata)

print dbreq

urllib2.urlopen(dbreq)

4,脚本写完后给脚本增加一下可执行权限

chmod +x kafka-lag-collect.py

chmod +x topic-collect.sh

5,试着执行一下topic-collect.sh看能否执行成功

./topic-collect.sh

如果能执行成功的话,可以看到/usr/monitor/tmp/topic-group1-topicname1-Offset.txt里面已经有计算出来的offset总和了

6,试着执行一下kafka-lag-collect.py看能否执行成功

./kafka-lag-collect.py

如果能执行成功的话,就可以在influxdb里看到新建的表和相关数据了。

7,让topic-collect.sh脚本调用kafka-lag-collect.py脚本,这样可以避免添加两条crontab定时任务

echo "/usr/monitor/kafka-lag-collect.py" >> topic-collect.sh

8,添加定时任务,让脚本可以每分钟收集一次信息到influxdb

crontab -e

* * * * * /usr/monitor/topic-collect.sh

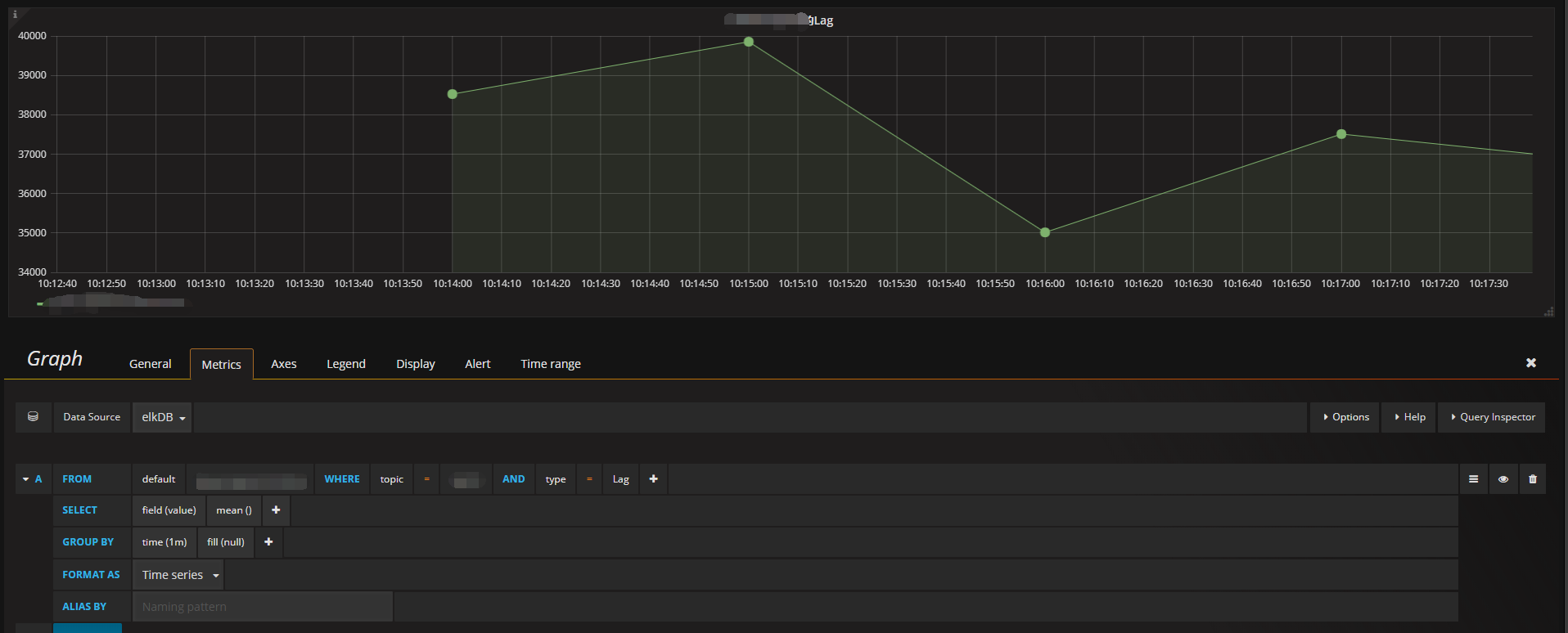

三,配置grafana展现数据

1,配置grafana数据源

2,新建图表

至此,就可以在grafana上看到监控的lag状态了。

kafka监控之topic的lag情况监控的更多相关文章

- 001使用smokeping监控idc机房网络质量情况

最近工作比较忙,也没有时间写博客,看到好友芮峰云最近一直在写博客,所以也手痒了,就先把之前的一些积累下来的文章分享给大家. 本文是介绍如何的使用smokeping来监控idc机房的网络质量情况,从监控 ...

- 限制UITextView的字数和字数监控,表情异常的情况和禁用表情

限制UITextView的字数和字数监控,表情异常的情况和禁用表情 3523FD80CC4350DE0AE7F89A8532B9A8.png 因为字数占一个字符,表情占两个字符.你要是限制15个字 ...

- Kafka vs RocketMQ—— Topic数量对单机性能的影响-转自阿里中间件

引言 上一期我们对比了三类消息产品(Kafka.RabbitMQ.RocketMQ)单纯发送小消息的性能,受到了程序猿们的广泛关注,其中大家对这种单纯的发送场景感到并不过瘾,因为没有任何一个网站的业务 ...

- (二)Kafka动态增加Topic的副本(Replication)

(二)Kafka动态增加Topic的副本(Replication) 1. 查看topic的原来的副本分布 [hadoop@sdf-nimbus-perf ~]$ le-kafka-topics.sh ...

- kubernetes之监控Prometheus实战--prometheus介绍--获取监控(一)

Prometheus介绍 Prometheus是一个最初在SoundCloud上构建的开源监控系统 .它现在是一个独立的开源项目,为了强调这一点,并说明项目的治理结构,Prometheus 于2016 ...

- 转:JMeter监控内存及CPU ——plugin插件监控被测系统资源方法

JMeter监控内存及CPU ——plugin插件监控被测系统资源方法 jmeter中也可以监控服务器的CPU和内存使用情况,但是需要安装一些插件还需要在被监测服务器上开启服务. 1.需要的插件准备 ...

- Kafka动态增加Topic的副本

一.kafka的副本机制 由于Producer和Consumer都只会与Leader角色的分区副本相连,所以kafka需要以集群的组织形式提供主题下的消息高可用.kafka支持主备复制,所以消息具备高 ...

- Kafka vs RocketMQ—— Topic数量对单机性能的影响

引言 上一期我们对比了三类消息产品(Kafka.RabbitMQ.RocketMQ)单纯发送小消息的性能,受到了程序猿们的广泛关注,其中大家对这种单纯的发送场景感到并不过瘾,因为没有任何一个网站的业务 ...

- Kafka设计解析(十)Kafka如何创建topic

转载自 huxihx,原文链接 Kafka如何创建topic? 目录 一.命令行部分 二.后台逻辑部分 Kafka创建topic命令很简单,一条命令足矣: bin/kafka-topics. --re ...

随机推荐

- zabbix、Cacti、Nagios、open-falcon、Ganglia、Prometheus开源监控比较

Zabbix 一个基与WEB界面的提供分布式系统监视以及网络监视功能的企业级的开源解决方案(普遍) 能监视各种网络参数,保证服务器系统的安全运营:并提供灵活的通知机制以让系统管理员快速定位/解决存在的 ...

- Guitar Pro的10个非常实用的技巧(上)

Guitar Pro 7具有许多功能和编辑选项,只需点击几下即可随时创建与编辑我们的乐谱,.以下就为大家介绍10个Guitar Pro中实用的技巧,可以大大的节省我们的时间. 在开始之前,重要的是要知 ...

- 从数据仓库双集群系统模式探讨,看GaussDB(DWS)的容灾设计

摘要:本文主要是探讨OLAP关系型数据库框架的数据仓库平台如何设计双集群系统,即增强系统高可用的保障水准,然后讨论一下GaussDB(DWS)的容灾应该如何设计. 当前社会.企业运行当中,大数据分析. ...

- JS你所不知的小数取整方法

先介绍几种基本方法. 1.toFixed()方法 toFixed() 方法是属于 Number 对象的方法,可以把 Number 四舍五入到指定的小数位数,括号内为小数位数,范围为0~20,为0时即取 ...

- php进阶学习-单例设计模式

什么是单例模式(singleton)? 在整个应用程序的生命周期中,任何一个时刻,单例类的实例都只存在一个,同时这个类还必须提供一个访问该类的全局访问点. 单例模式的特点 一个类只有一个实例 私有克隆 ...

- 蓝桥杯——测试次数·摔手机(2018JavaB组第4题,17分)

x星球的居民脾气不太好,但好在他们生气的时候唯一的异常举动是:摔手机. 各大厂商也就纷纷推出各种耐摔型手机.x星球的质监局规定了手机必须经过耐摔测试,并且评定出一个耐摔指数来,之后才允许上市流通. x ...

- Eclipse中自动生成局部变量

方法调用后,返回值自动赋值到一个新的局部变量中: (1)鼠标放到方法上,点击Ctrl+1 (2)选择 :Assign statement to new local variable(将语句赋给新的局部 ...

- Windows 10系统运维之OpenSSH

随着PowerShell和OpenSSH的日渐成熟,在客户终端Windows居多的运维之中,使用Win32-OpenSSH和Powershell来管理一些客户机变成了相当实用的一种解决方案. Open ...

- java40

时隔小半年,重新捡起Java的学习 问题: 1.eclipse好久没用,再打开时,eclipse的项目都没有了,如何找回? 打开switch-workplace-other点开,选择以前的文件所在处. ...

- 【GDOI2014模拟】JZOJ2020年8月14日T2 网格

[GDOI2014模拟]JZOJ2020年8月14日T2 网格 题目 Time and Memory Limits Description 某城市的街道呈网格状,左下角坐标为A(0, 0),右上角坐标 ...