逻辑回归模型(Logistic Regression)及Python实现

逻辑回归模型(Logistic Regression)及Python实现

1.模型

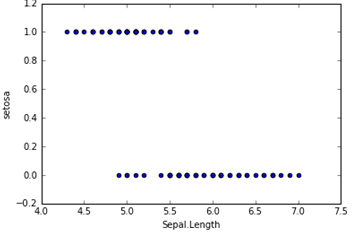

在分类问题中,比如判断邮件是否为垃圾邮件,判断肿瘤是否为阳性,目标变量是离散的,只有两种取值,通常会编码为0和1。假设我们有一个特征X,画出散点图,结果如下所示。这时候如果我们用线性回归去拟合一条直线:hθ(X) = θ0+θ1X,若Y≥0.5则判断为1,否则为0。这样我们也可以构建出一个模型去进行分类,但是会存在很多的缺点,比如稳健性差、准确率低。而逻辑回归对于这样的问题会更加合适。

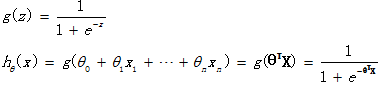

逻辑回归假设函数如下,它对θTX作了一个函数g变换,映射至0到1的范围之内,而函数g称为sigmoid function或者logistic function,函数图像如下图所示。当我们输入特征,得到的hθ(x)其实是这个样本属于1这个分类的概率值。也就是说,逻辑回归是用来得到样本属于某个分类的概率。

2.评价

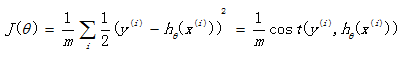

回想起之前线性回归中所用到的损失函数:

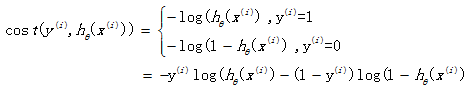

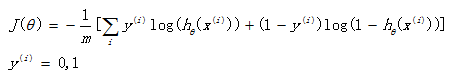

如果在逻辑回归中也运用这种损失函数,得到的函数J是一个非凸函数,存在多个局部最小值,很难进行求解,因此需要换一个cost函数。重新定义个cost函数如下:

当实际样本属于1类别时,如果预测概率也为1,那么损失为0,预测正确。相反,如果预测为0,那么损失将是无穷大。这样构造的损失函数是合理的,并且它还是一个凸函数,十分方便求得参数θ,使得损失函数J达到最小。

3.优化

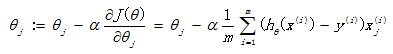

我们已经定义好了损失函数J(θ),接下来的任务就是求出参数θ。我们的目标很明确,就是找到一组θ,使得我们的损失函数J(θ)最小。最常用的求解方法有两种:批量梯度下降法(batch gradient descent), 牛顿迭代方法((Newton's method)。两种方法都是通过迭代求得的数值解,但是牛顿迭代方法的收敛速度更加快。

批量梯度下降法:

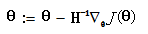

牛顿迭代方法:  (H为海瑟矩阵)

(H为海瑟矩阵)

4.python代码实现

# -*- coding: utf-8 -*-

"""

Created on Wed Feb 24 11:04:11 2016 @author: SumaiWong

""" import numpy as np

import pandas as pd

from numpy import dot

from numpy.linalg import inv iris = pd.read_csv('D:\iris.csv')

dummy = pd.get_dummies(iris['Species']) # 对Species生成哑变量

iris = pd.concat([iris, dummy], axis =1 )

iris = iris.iloc[0:100, :] # 截取前一百行样本 # 构建Logistic Regression , 对Species是否为setosa进行分类 setosa ~ Sepal.Length

# Y = g(BX) = 1/(1+exp(-BX))

def logit(x):

return 1./(1+np.exp(-x)) temp = pd.DataFrame(iris.iloc[:, 0])

temp['x0'] = 1.

X = temp.iloc[:,[1,0]]

Y = iris['setosa'].reshape(len(iris), 1) #整理出X矩阵 和 Y矩阵 # 批量梯度下降法

m,n = X.shape #矩阵大小

alpha = 0.0065 #设定学习速率

theta_g = np.zeros((n,1)) #初始化参数

maxCycles = 3000 #迭代次数

J = pd.Series(np.arange(maxCycles, dtype = float)) #损失函数 for i in range(maxCycles):

h = logit(dot(X, theta_g)) #估计值

J[i] = -(1/100.)*np.sum(Y*np.log(h)+(1-Y)*np.log(1-h)) #计算损失函数值

error = h - Y #误差

grad = dot(X.T, error) #梯度

theta_g -= alpha * grad

print theta_g

print J.plot() # 牛顿方法

theta_n = np.zeros((n,1)) #初始化参数

maxCycles = 10 #迭代次数

C = pd.Series(np.arange(maxCycles, dtype = float)) #损失函数

for i in range(maxCycles):

h = logit(dot(X, theta_n)) #估计值

C[i] = -(1/100.)*np.sum(Y*np.log(h)+(1-Y)*np.log(1-h)) #计算损失函数值

error = h - Y #误差

grad = dot(X.T, error) #梯度

A = h*(1-h)* np.eye(len(X))

H = np.mat(X.T)* A * np.mat(X) #海瑟矩阵, H = X`AX

theta_n -= inv(H)*grad

print theta_n

print C.plot()

代码所用的数据下载地址:http://files.cnblogs.com/files/sumai/iris.rar

逻辑回归模型(Logistic Regression)及Python实现的更多相关文章

- 逻辑回归模型(Logistic Regression, LR)基础

逻辑回归模型(Logistic Regression, LR)基础 逻辑回归(Logistic Regression, LR)模型其实仅在线性回归的基础上,套用了一个逻辑函数,但也就由于这个逻辑函 ...

- 逻辑回归模型(Logistic Regression, LR)--分类

逻辑回归(Logistic Regression, LR)模型其实仅在线性回归的基础上,套用了一个逻辑函数,但也就由于这个逻辑函数,使得逻辑回归模型成为了机器学习领域一颗耀眼的明星,更是计算广告学的核 ...

- Python实践之(七)逻辑回归(Logistic Regression)

机器学习算法与Python实践之(七)逻辑回归(Logistic Regression) zouxy09@qq.com http://blog.csdn.net/zouxy09 机器学习算法与Pyth ...

- 机器学习算法与Python实践之(七)逻辑回归(Logistic Regression)

http://blog.csdn.net/zouxy09/article/details/20319673 机器学习算法与Python实践之(七)逻辑回归(Logistic Regression) z ...

- 机器学习/逻辑回归(logistic regression)/--附python代码

个人分类: 机器学习 本文为吴恩达<机器学习>课程的读书笔记,并用python实现. 前一篇讲了线性回归,这一篇讲逻辑回归,有了上一篇的基础,这一篇的内容会显得比较简单. 逻辑回归(log ...

- Python机器学习算法 — 逻辑回归(Logistic Regression)

逻辑回归--简介 逻辑回归(Logistic Regression)就是这样的一个过程:面对一个回归或者分类问题,建立代价函数,然后通过优化方法迭代求解出最优的模型参数,然后测试验证我们这个求解的模型 ...

- 机器学习二 逻辑回归作业、逻辑回归(Logistic Regression)

机器学习二 逻辑回归作业 作业在这,http://speech.ee.ntu.edu.tw/~tlkagk/courses/ML_2016/Lecture/hw2.pdf 是区分spam的. 57 ...

- 机器学习——逻辑回归(Logistic Regression)

1 前言 虽然该机器学习算法名字里面有"回归",但是它其实是个分类算法.取名逻辑回归主要是因为是从线性回归转变而来的. logistic回归,又叫对数几率回归. 2 回归模型 2. ...

- 逻辑回归(Logistic Regression)算法小结

一.逻辑回归简述: 回顾线性回归算法,对于给定的一些n维特征(x1,x2,x3,......xn),我们想通过对这些特征进行加权求和汇总的方法来描绘出事物的最终运算结果.从而衍生出我们线性回归的计算公 ...

- [机器学习] Coursera ML笔记 - 逻辑回归(Logistic Regression)

引言 机器学习栏目记录我在学习Machine Learning过程的一些心得笔记,涵盖线性回归.逻辑回归.Softmax回归.神经网络和SVM等等.主要学习资料来自Standford Andrew N ...

随机推荐

- [GeekBand] 设计模式之观察者模式学习笔记

本文参考文献::GeekBand课堂内容,授课老师:李建忠 :网络资料: http://blog.csdn.net/hguisu/article/details/7556625 本文仅作为自己的学习笔 ...

- 一起学Python:字典介绍

字典介绍 想一想: 如果有列表 nameList = ['xiaoZhang', 'xiaoWang', 'xiaoLi']; 需要对"xiaoWang"这个名字写错了,通过代码修 ...

- python request爬取百度贴吧

import requests import os import shutil import time class PostBarSpider(object): def __init__(self, ...

- 阿里云centos7.2自己安装mysql5.7远程不能访问解决方案

版权声明:转载也行 https://blog.csdn.net/u010955892/article/details/72774920 最近,无意中看到阿里云服务器降价,所以一时手痒,买了一年的服务器 ...

- Array类型判断

http://www.cnblogs.com/YaoAzhen/archive/2010/01/27/1657696.html

- LeetCode: Generate Parentheses [021]

[称号] Given n pairs of parentheses, write a function to generate all combinations of well-formed pare ...

- 基于JUnit和Ant测试程序正在运行使用Kieker(AspectJ)监测方法

这篇日志的目的从标题里能够看出来.这也是我们实验须要,必须总结一下,方便其它师弟师妹在这个基础上做实验. 我已经介绍了非常多基于Kieker的监控方法,这里以Prefuse这个开源可视化Java框架为 ...

- JDBC 使用这个是MySQL下的

import java.sql.Connection;import java.sql.DriverManager;import java.sql.ResultSet;import java.sql.R ...

- IOC学习1

学习蒋金楠的 ASP.NET Core中的依赖注入(1):控制反转(IoC) 而来,这篇文章经典异常.一定要多读.反复读. 这篇文章举了一个例子,就是所谓的mvc框架,一开始介绍mvc的思想,由一个d ...

- Leetcode 226 Invert Binary Tree 二叉树

交换左右叶子节点 /** * Definition for a binary tree node. * struct TreeNode { * int val; * TreeNode *left; * ...