zookeeper+kafka集群搭建

一、ZK集群安装。

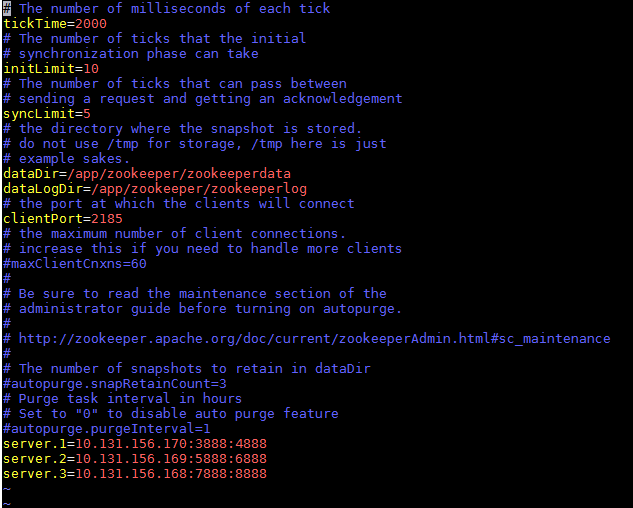

解压安装包后进入conf目录,conf/zoo_sample.cfg拷贝一份命名为zoo.cfg,同时也放在conf下面。

zookeeper配置文件:

# The number of milliseconds of each tick

tickTime=

# The number of ticks that the initial

# synchronization phase can take

initLimit=

# The number of ticks that can pass between

# sending a request and getting an acknowledgement

syncLimit=

# the directory where the snapshot is stored.

# do not use /tmp for storage, /tmp here is just

# example sakes.

dataDir=/app/zookeeper/zookeeperdata

dataLogDir=/app/zookeeper/zookeeperlog

# the port at which the clients will connect

clientPort=

# the maximum number of client connections.

# increase this if you need to handle more clients

#maxClientCnxns=

#

# Be sure to read the maintenance section of the

# administrator guide before turning on autopurge.

#

# http://zookeeper.apache.org/doc/current/zookeeperAdmin.html#sc_maintenance

#

# The number of snapshots to retain in dataDir

#autopurge.snapRetainCount=

# Purge task interval in hours

# Set to "" to disable auto purge feature

#autopurge.purgeInterval=

server.=10.131.156.170::

server.=10.131.156.169::

server.=10.131.156.168::

配置参数说明:

tickTime:这个时间是作为 Zookeeper 服务器之间或客户端与服务器之间维持心跳的时间间隔,也就是每个 tickTime 时间就会发送一个心跳。

dataDir:顾名思义就是 Zookeeper 保存数据的目录,默认情况下,Zookeeper 将写数据的日志文件也保存在这个目录里。

clientPort:这个端口就是客户端连接 Zookeeper 服务器的端口,Zookeeper 会监听这个端口,接受客户端的访问请求。

initLimit:这个配置项是用来配置 Zookeeper 接受客户端(这里所说的客户端不是用户连接 Zookeeper 服务器的客户端,而是 Zookeeper 服务器集群中连接到 Leader 的 Follower 服务器)初始化连接时最长能忍受多少个心跳时间间隔数。当已经超过 5个心跳的时间(也就是 tickTime)长度后 Zookeeper 服务器还没有收到客户端的返回信息,那么表明这个客户端连接失败。总的时间长度就是 *= 秒

syncLimit:这个配置项标识 Leader 与Follower 之间发送消息,请求和应答时间长度,最长不能超过多少个 tickTime 的时间长度,总的时间长度就是2*= 秒

server.A=B:C:D:其中 A 是一个数字,表示这个是第几号服务器;B 是这个服务器的 ip 地址;C 表示的是这个服务器与集群中的 Leader 服务器交换信息的端口;D 表示的是万一集群中的 Leader 服务器挂了,需要一个端口来重新进行选举,选出一个新的 Leader,而这个端口就是用来执行选举时服务器相互通信的端口。如果是伪集群的配置方式,由于 B 都是一样,所以不同的 Zookeeper 实例通信端口号不能一样,所以要给它们分配不同的端口号

注意:dataDir,dataLogDir中的wwb是当前登录用户名,data,logs目录开始是不存在,需要使用mkdir命令创建相应的目录。并且在该目录下创建文件myid,serve1,server2,server3该文件内容分别为1,,。

针对服务器server2,server3可以将server1复制到相应的目录,不过需要注意dataDir,dataLogDir目录,并且文件myid内容分别为2,

依次用bin/zkServer.sh start启动三台服务器即可。

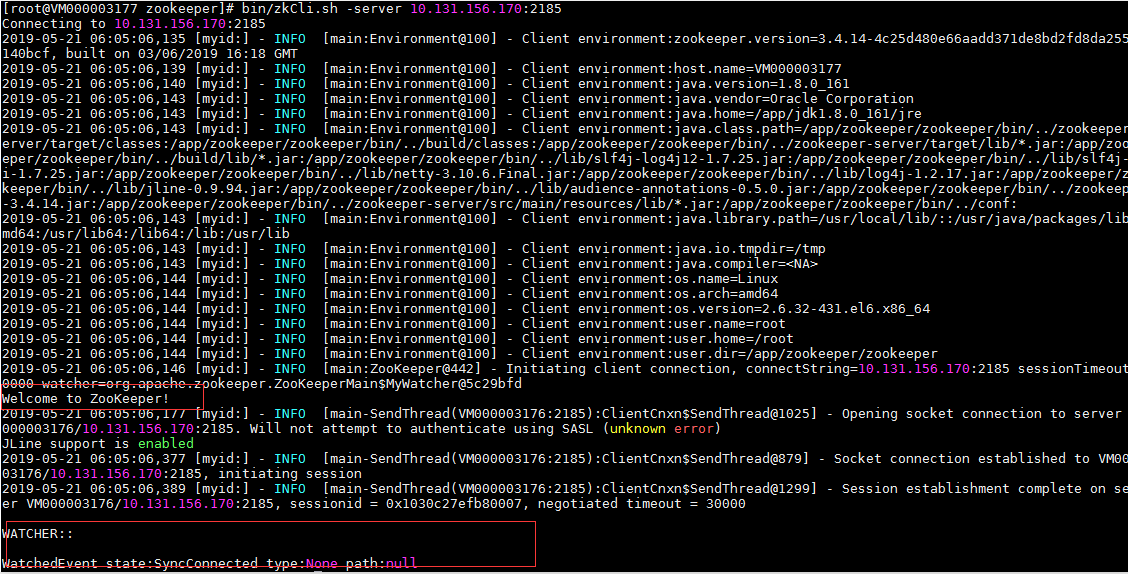

启动成功后可以用命令bin/zkCli.sh -server 10.131.156.170 : 去链接服务。链接成功后如图:

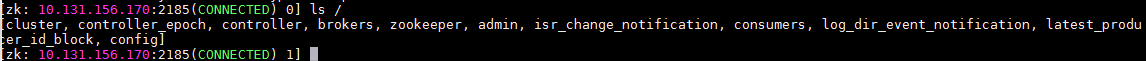

用ls / 起查看zk内部结构:

kafka配置文件: broker.id=

port=

num.network.threads=

num.io.threads=

socket.send.buffer.bytes=

socket.receive.buffer.bytes=

socket.request.max.bytes=

log.dirs=/app/kafka/kafka-logs

num.partitions=

num.recovery.threads.per.data.dir=

offsets.topic.replication.factor=

transaction.state.log.replication.factor=

transaction.state.log.min.isr=

log.retention.hours=

log.segment.bytes=

log.retention.check.interval.ms=

zookeeper.connect=10.131.156.170:,10.131.156.169:,10.131.156.168:

zookeeper.connection.timeout.ms=

group.initial.rebalance.delay.ms=

kafka.metrics.polling.interval.secs=

kafka.metrics.reporters=kafka.metrics.KafkaCSVMetricsReporter

kafka.csv.metrics.dir=/tmp/kafka_metrics

kafka.csv.metrics.reporter.enabled=false -----------------------------------------------------------------------------------------------------------

############################# Zookeeper ############################# # Zookeeper connection string (see zookeeper docs for details).

# This is a comma separated host:port pairs, each corresponding to a zk

# server. e.g. "127.0.0.1:3000,127.0.0.1:3001,127.0.0.1:3002".

# You can also append an optional chroot string to the urls to specify the

# root directory for all kafka znodes.

zookeeper.connect=10.131.156.170:,10.131.156.169:,10.131.156.168:

(2185对应为zk配置文件中的客户端端口,clientport) # Timeout in ms for connecting to zookeeper

zookeeper.connection.timeout.ms=

group.initial.rebalance.delay.ms=

kafka.metrics.polling.interval.secs=

kafka.metrics.reporters=kafka.metrics.KafkaCSVMetricsReporter

kafka.csv.metrics.dir=/tmp/kafka_metrics

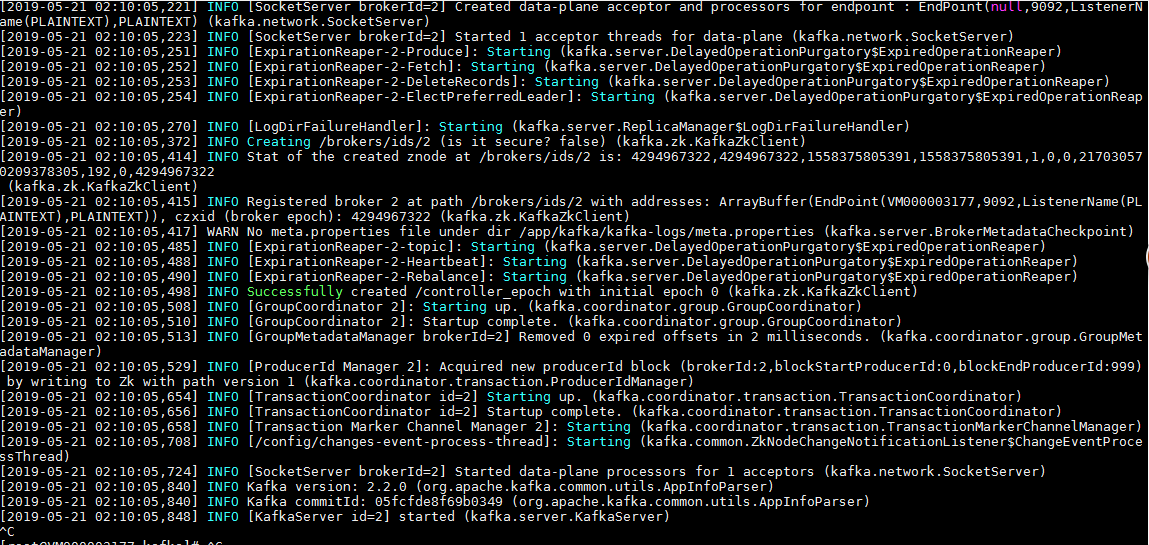

kafka.csv.metrics.reporter.enabled=false kafka启动:

bin/kafka-server-start.sh config/server.properties &

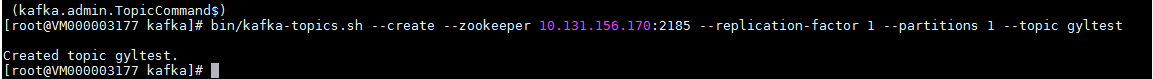

创建topic:

bin/kafka-topics.sh --create --zookeeper 10.131.156.170: --replication-factor --partitions --topic gyltest

查看已经存在的topic:

bin/kafka-topics.sh --list --zookeeper 10.131.156.170: 查看指定Topic状态

bin/kafka-topics.sh --describe --zookeeper 10.131.156.170: --topic gyltest 启动Consumer读取消息并输出到标准输出

bin/kafka-console-consumer.sh --zookeeper 10.131.156.170: --topic gyltest --from-beginning 创建发送者

>bin/kafka-console-producer.sh --broker-list 10.131.156.170: --topic gyltest

my test message1

my test message2 创建消费者:

bin/kafka-console-consumer.sh --zookeeper 10.131.156.170: --from-beginning --topic gyltest

...

my test message1

my test message2 bin/kafka-run-class.sh kafka.admin.ConsumerGroupCommand --zookeeper 10.131.156.169: --topic gyltest bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --zookeeper=10.131.156.169: --group=test-consumer-group bin/kafka-console-consumer.sh -zookeeper 10.131.156.169: --from-beginning --topic gyltest bin/kafka-console-producer.sh --broker-list 10.131.156.169: --topic gyltest kafka-run-class.sh kafka.tools.ConsumerOffsetChecker

#kafka查看topic各个分区的消息的信息

kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group ** --topic *** --zookeeper *:,*:,*:/kafka

--zookeeper 那里是指kafka在zk中的path,即使zk有多个机器,如果在其中一台上执行此命令,显示连接不上,只写那台机器的地址端口+kafka的path即可

指定自己的分组 自己消费的topic会显示kafka总共有多少数据,以及已经被消费了多少条

结果:

GROUP TOPIC PID OFFSET LOGSIZE LAG

消费者组 话题id 分区id 当前已消费的条数 总条数 未消费的条数 bin/kafka-run-class.sh kafka.tools.ConsumerOffsetChecker --group test-consumer-group --topic gyltest --zookeeper 10.131.156.170:,10.131.156.169:,10.131.156.168:/kafka

zookeeper+kafka集群搭建的更多相关文章

- Zookeeper + Kafka 集群搭建

第一步:准备 1. 操作系统 CentOS-7-x86_64-Everything-1511 2. 安装包 kafka_2.12-0.10.2.0.tgz zookeeper-3.4.9.tar.gz ...

- 搭建zookeeper+kafka集群

搭建zookeeper+kafka集群 一.环境及准备 集群环境: 软件版本: 部署前操作: 关闭防火墙,关闭selinux(生产环境按需关闭或打开) 同步服务器时间,选择公网ntpd服务器或 ...

- zookeeper及kafka集群搭建

zookeeper及kafka集群搭建 1.有关zookeeper的介绍可参考:http://www.cnblogs.com/wuxl360/p/5817471.html 2.zookeeper安装 ...

- zookeeper与Kafka集群搭建及python代码测试

Kafka初识 1.Kafka使用背景 在我们大量使用分布式数据库.分布式计算集群的时候,是否会遇到这样的一些问题: 我们想分析下用户行为(pageviews),以便我们设计出更好的广告位 我想对用户 ...

- Docker搭建Zookeeper&Kafka集群

最近在学习Kafka,准备测试集群状态的时候感觉无论是开三台虚拟机或者在一台虚拟机开辟三个不同的端口号都太麻烦了(嗯..主要是懒). 环境准备 一台可以上网且有CentOS7虚拟机的电脑 为什么使用虚 ...

- CentOS 7 Zookeeper 和 Kafka 集群搭建

环境 CentOS 7.4 Zookeeper-3.6.1 Kafka_2.13-2.4.1 Kafka-manager-2.0.0.2 本次安装的软件全部在 /home/javateam 目录下. ...

- zookeeper集群及kafka集群搭建

1.zookeeper集群搭建 1.1 上传安装包 官网推荐至少3个节点,我们这里也用三个节点192.169.2.18 192.169.1.82 192.169.1.95 准备好安装包,zooke ...

- kafka集群搭建和使用Java写kafka生产者消费者

1 kafka集群搭建 1.zookeeper集群 搭建在110, 111,112 2.kafka使用3个节点110, 111,112 修改配置文件config/server.properties ...

- Kafka【第一篇】Kafka集群搭建

Kafka初识 1.Kafka使用背景 在我们大量使用分布式数据库.分布式计算集群的时候,是否会遇到这样的一些问题: 我们想分析下用户行为(pageviews),以便我们设计出更好的广告位 我想对用户 ...

随机推荐

- MongoDB 学习笔记(二):shell中执行增删查改

一.查 1.查询集合中所有文档:db.集合名.find(). 2.查询集合中第一个文档:db.集合名.findOne(). 3.指定查询条件:第一个参数就是指定查询条件 查询全部文档:db.集合名.f ...

- 执行opatch apply 报错 OPatch failed with error code 73

.执行opatch apply 报错 OPatch failed [oracle@ora_11g 14275605]$ /opt/oracle/product/db_1/OPatch/opatch a ...

- GDI 直线和折线(6)

设置开始点 MoveToEx 函数用于移动画笔到指定的位置: BOOL MoveToEx( HDC hdc, // 设备环境句柄 int X, // 要移动到的 x 坐标 int Y, // 要移动到 ...

- Echarts堆积柱状图排序问题

Echarts堆积柱状图排序是按照堆积柱状图的柱子高度进行从大到小(或者从小到大)进行排序,方便查阅各坐标情况.以下是我自己研发的方法,有不对的地方敬请谅解,随时欢迎指教. 排序后效果如下图: (1) ...

- 以checked选中作为判断条件的各种写法

<input type="radio" name="choice" id="ipt1"> <label for=" ...

- HDU-1695 GCD(求一个区间内与一个数互质的个数)

题意: 给你一个T,是样例的个数,接下来是五个数l1,r1,l2,r2,k 前四个数代表两个区间(l1,r1),(l2,r2)这个题l1=1,l2=1; 取x1属于(1,r1),x2属于(1,r2) ...

- Cocos2d切换场景出现的问题-error C2653: “***”不是类或命名空间名称

1,在开头引入头文件 2,在要引入的头文件中,去除以下代码: #ifndef __HELLOWORLD_SCENE_H__ #define __HELLOWORLD_SCENE_H__ #endif ...

- Problem 7

Problem 7 # Problem_7.py """ By listing the first six prime numbers: 2, 3, 5, 7, 11, ...

- 【Codeforces Round #505 (rated, Div. 1 + Div. 2, based on VK Cup 2018 Final) B】Weakened Common Divisor

[链接] 我是链接,点我呀:) [题意] 给你n个数对(ai,bi). 让你求一个大于1的数字x 使得对于任意的i x|a[i] 或者 x|b[i] [题解] 求出第一个数对的两个数他们有哪些质因子. ...

- 开启WIFI

C:\Windows\system32>netsh wlan set hostednetwork mode=allow ssid=wuyechun-wifi k ey= 承载网络模式已设置为允许 ...