Spark 大数据文本统计

此程序功能:

1.完成对10.4G.csv文件各个元素频率的统计

2.获得最大的统计个数

3.对获取到的统计个数进行降序排列

4.对各个元素出现次数频率的统计

import org.apache.spark.{SparkConf, SparkContext}

/**

*/

object 大数据统计 {

def main(args: Array[String]): Unit = {

val conf=new SparkConf().setAppName("大数据").setMaster("local[4]")

val sc=new SparkContext(conf)

// val text= sc.textFile("/home/soyo/桌面/shell编程测试/1.txt")

val text= sc.textFile("/home/soyo/下载/Hadoop+Spark+Hbase/all2.csv")

//text.foreach(println)

val wordcount= text.flatMap(line=>line.split(",")).map(word=>(word,))

.reduceByKey((a,b)=>a+b)

wordcount.collect().foreach(println)

// wordcount.saveAsTextFile("/home/soyo/桌面/shell编程测试/1-1-1.txt")

println("单独文件中各个数的统计个数")

// wordcount.map(_._2).foreach(println)

println("获取统计的最大数")

// wordcount.map(_._2).saveAsTextFile("/home/soyo/下载/Hadoop+Spark+Hbase/77.txt")

println(wordcount.map(_._2).max())

println("对获取到的数降序排列")

wordcount.map(_._2).sortBy(x=>x,false).foreach(println) //false:降序 true:升序

println("转变为key-value形式")

wordcount.map(_._2).map(num=>(num,)).reduceByKey((a,b)=>a+b).foreach(println)

println("对key-value按key再排序,获得结果表示:假设文件中'soyo5'总共出现10次,可文件'soyo1'也出现10次,最后整个排序获得的是(10,2)10次的共出现2次")

wordcount.map(_._2).map(num=>(num,)).reduceByKey((a,b)=>a+b).sortByKey().foreach(println)

}

}

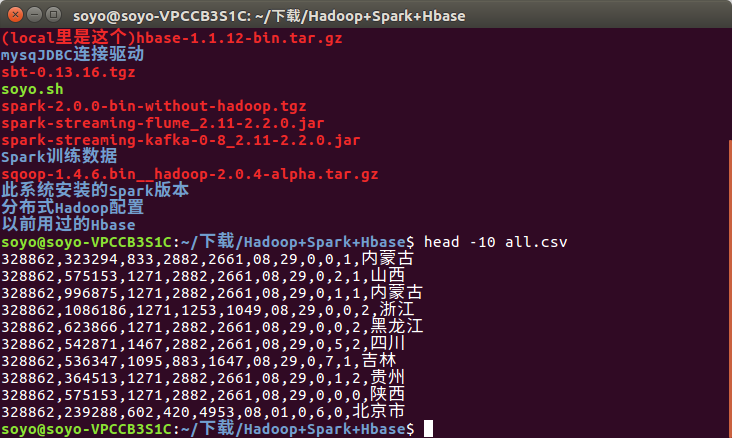

数据内容:

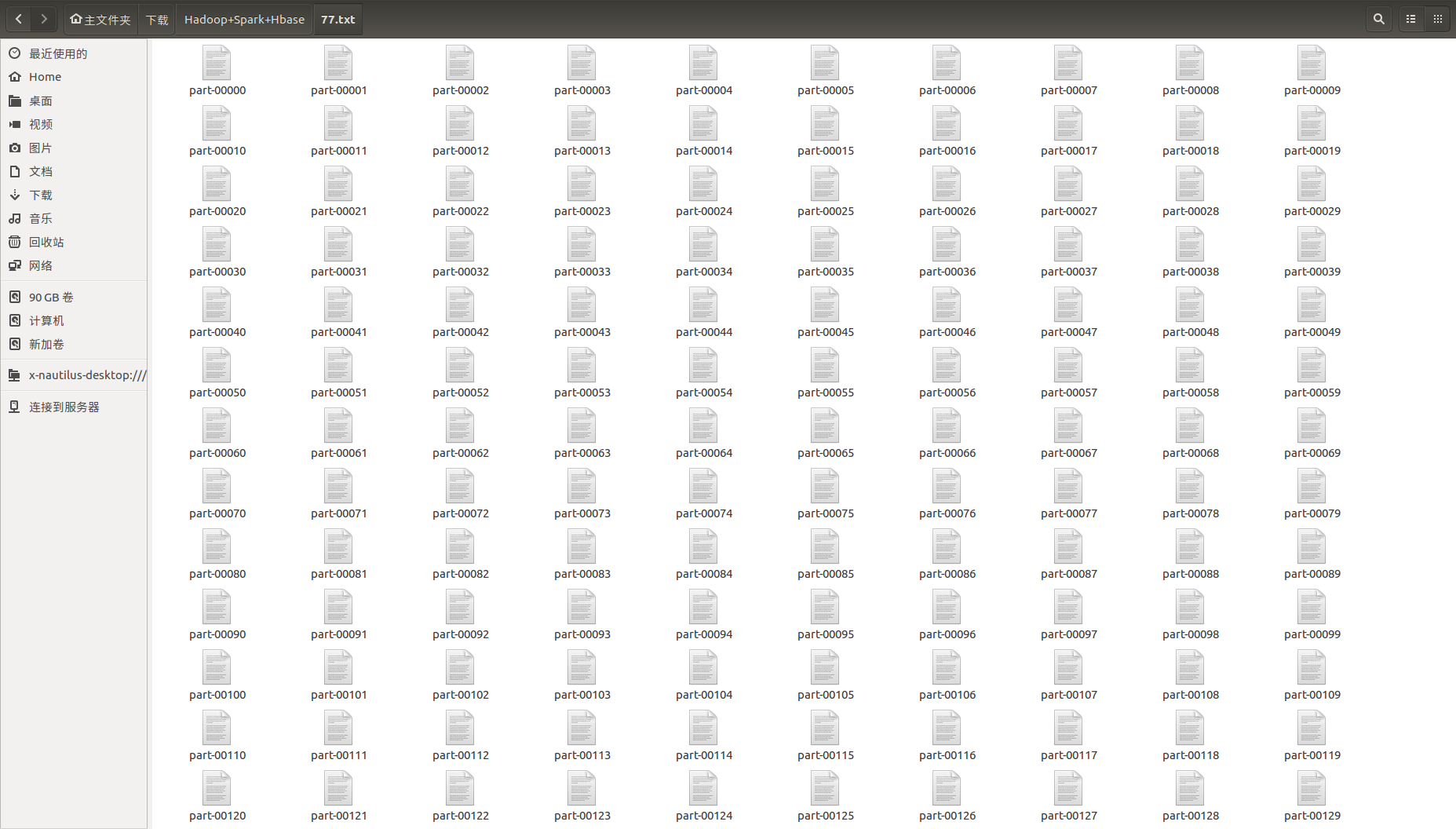

Spark 保存的文件是这样的:

这里可以用一个脚本将这么多的文件进行合并:

#!/bin/bash

cat * >>soyoo.txt

结果太多只写一个:

获取统计的最大数

294887496 (数据中有一个元素出现了这么多次)

Spark 大数据文本统计的更多相关文章

- C#大数据文本高效去重

C#大数据文本高效去重 转载请注明出处 http://www.cnblogs.com/Huerye/ TextReader reader = File.OpenText(@"C:\Users ...

- SQL大数据操作统计

SQL大数据操作统计 1:select count(*) from table的区别SELECT object_name(id) as TableName,indid,rows,rowcnt FROM ...

- 学习Hadoop+Spark大数据巨量分析与机器学习整合开发-windows利用虚拟机实现模拟多节点集群构建

记录学习<Hadoop+Spark大数据巨量分析与机器学习整合开发>这本书. 第五章 Hadoop Multi Node Cluster windows利用虚拟机实现模拟多节点集群构建 5 ...

- 教你如何成为Spark大数据高手?

教你如何成为Spark大数据高手? Spark目前被越来越多的企业使用,和Hadoop一样,Spark也是以作业的形式向集群提交任务,那么如何成为Spark大数据高手?下面就来个深度教程. Spark ...

- Spark大数据针对性问题。

1.海量日志数据,提取出某日访问百度次数最多的那个IP. 解决方案:首先是将这一天,并且是访问百度的日志中的IP取出来,逐个写入到一个大文件中.注意到IP是32位的,最多有个2^32个IP.同样可以采 ...

- Azure HDInsight 和 Spark 大数据实战(一)

What is HDInsight? Microsoft Azure HDInsight 是基于 Hortonoworks Data Platform (HDP) 的 Hadoop 集群,包括Stor ...

- Spark大数据的学习历程

Spark主要的编程语言是Scala,选择Scala是因为它的简洁性(Scala可以很方便在交互式下使用)和性能(JVM上的静态强类型语言).Spark支持Java编程,但对于使用Java就没有了Sp ...

- 【福利】送Spark大数据平台视频学习资料

没有套路真的是送!! 大家都知道,大数据行业spark很重要,那话我就不多说了,贴心的大叔给你找了份spark的资料. 多啰嗦两句,一个好的程序猿的基本素养是学习能力和自驱力.视频给了你们,能不能 ...

- 小试牛刀ElasticSearch大数据聚合统计

ElasticSearch相信有不少朋友都了解,即使没有了解过它那相信对ELK也有所认识E即是ElasticSearch.ElasticSearch最开始更多用于检索,作为一搜索的集群产品简单易用绝对 ...

随机推荐

- xhprof安装&&使用[转载]

编译安装 wget http://pecl.php.net/get/xhprof-0.9.2.tgz tar zxf xhprof-0.9.2.tgz cd xhprof-0.9.2/extensio ...

- CodeForces 596A Wilbur and Swimming Pool

水题. #include<cstdio> #include<cstring> #include<cmath> #include<algorithm> u ...

- 开头第一篇Hello World

以前在折腾个人博客的时候,使用过的WordpPress.Z-Blog.Typecho建站程序,开头第一篇都是Hello World,作为程序员的社区,开头第一篇当然也要是Hello World! 一句 ...

- http://www.ybtsoft.com/

http://www.ybtsoft.com/ 可视化作流建模 http://www.ybtsoft.com/t3/bpm/ 慧都控件网 写一本关于互联网商业变现的书

- Oracle Spatial中的空间索引

转自cryolite原文 Oracle Spatial中的空间索引 Oracle Spatial可对空间数据进行R-tree索引,每个空间图层(Spatial Layer)的空间索引元信息都可以在US ...

- SqlSugar最容易使用的ORM

SqlSugar官网

- 扫描控件Web在线Applet

基于JAVAEE的B/S架构由于java语言的跨平台性 所以操控Window客户端资源能力有限, 目前比较流行是用其他语言如Delphi,VB,C++开发客户端控件 然后再html中用js调用. ...

- 全文搜索引擎 Elasticsearch 安装

全文搜索引擎 Elasticsearch 安装 学习了:http://www.ruanyifeng.com/blog/2017/08/elasticsearch.html 拼音:https://www ...

- [Javascript] Use JavaScript's for-in Loop on Objects with Prototypes

Loops can behave differently when objects have chained prototype objects. Let's see the difference w ...

- Struts2之struts2标签库了解和使用

一.学习案例:通过演示项目了解和使用struts2的标签库. 二.案例分析:演示项目是我当初跟着马士兵老师的视频学习时关于标签的项目,里面都有凝视,大家执行了解下. 在此我仅仅解说下经常使用的标签. ...