cerely-分布式异步任务队列

Celery 是一个强大的 分布式任务队列 的 异步处理框架,它可以让任务的执行完全脱离主程序,甚至可以被分配到其他主机上运行。我们通常使用它来实现异步任务(async task)和定时任务(crontab)。

在Celery中几个基本的概念,需要先了解下,不然不知道为什么要安装下面的东西。概念:Broker、Backend。

broker

broker是一个消息传输的中间件或消息队列,可以理解为一个邮箱。

每当应用程序调用celery的异步任务的时候,会向broker传递消息,而后celery的worker将会取到消息,进行对于的程序执行。其中Broker的中文意思是 经纪人 ,其实就是一开始说的 消息队列 ,用来发送和接受消息。这个Broker有几个方案可供选择:RabbitMQ (消息队列),Redis(缓存数据库),数据库(不推荐),等等

backend

用于存储这些消息以及celery执行的一些消息和结果。

Backend是在Celery的配置中的一个配置项 CELERY_RESULT_BACKEND ,作用是保存结果和状态,如果你需要跟踪任务的状态,那么需要设置这一项,可以是Database backend,也可以是Cache backend,具体可以参考这里: CELERY_RESULT_BACKEND 。

brokers,官方推荐是 rabbitmq 和 redis,至于 backend,就是数据库。为了简单可以都使用 redis。

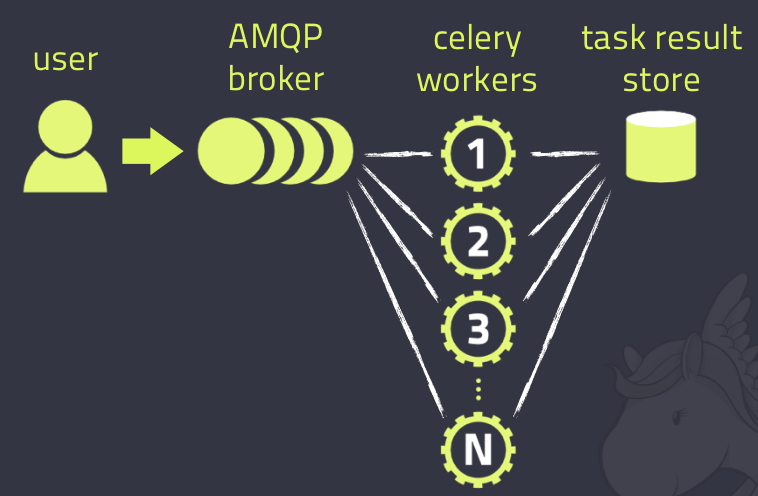

这是在网上最多的一张Celery的图

Celery的架构由三部分组成,消息中间件(message broker),任务执行单元(worker)和任务执行结果存储(task result store)组成。

1.消息中间件broker

Celery本身不提供消息服务,但是可以方便的和第三方提供的消息中间件集成。包括,RabbitMQ, Redis, MongoDB (experimental), Amazon SQS (experimental),CouchDB (experimental), SQLAlchemy (experimental),Django ORM (experimental), IronMQ

2.任务执行单元

Worker是Celery提供的任务执行的单元,worker并发的运行在分布式的系统节点中。

3.任务结果存储

Task result store用来存储Worker执行的任务的结果,Celery支持以不同方式存储任务的结果,包括AMQP, redis,memcached, mongodb,SQLAlchemy, Django ORM,Apache Cassandra, IronCache 等。

安装:

pip install redis

pip install celery

它的架构组成如下图:

Celery 主要包含以下几个模块:

任务模块 Task

包含异步任务和定时任务。其中,异步任务通常在业务逻辑中被触发并发往任务队列,而定时任务由 Celery Beat 进程周期性地将任务发往任务队列。

消息中间件 Broker

Broker,即为任务调度队列,接收任务生产者发来的消息(即任务),将任务存入队列。Celery 本身不提供队列服务,官方推荐使用 RabbitMQ 和 Redis 等。

任务执行单元 Worker

Worker 是执行任务的处理单元,它实时监控消息队列,获取队列中调度的任务,并执行它。

任务结果存储 Backend

Backend 用于存储任务的执行结果,以供查询。同消息中间件一样,存储也可使用 RabbitMQ, redis 和 MongoDB 等。

开始使用 Celery

使用celery包含三个方面:1. 定义任务函数。2. 运行celery服务。3. 客户应用程序的调用。

创建 Celery 实例

将下面的代码保存为文件 tasks.py:

# -*- coding: utf- -*- import time

from celery import Celery broker = 'redis://127.0.0.1:6379'

backend = 'redis://127.0.0.1:6379/0' app = Celery('my_task', broker=broker, backend=backend) @app.task

def add(x, y):

time.sleep() # 模拟耗时操作

return x + y

上面的代码做了几件事:

创建了一个 Celery 实例 app,名称为 my_task;

指定消息中间件用 redis,URL 为 redis://127.0.0.1:6379;

指定存储用 redis,URL 为 redis://127.0.0.1:6379/0;

创建了一个 Celery 任务 add,当函数被 @app.task 装饰后,就成为可被 Celery 调度的任务;

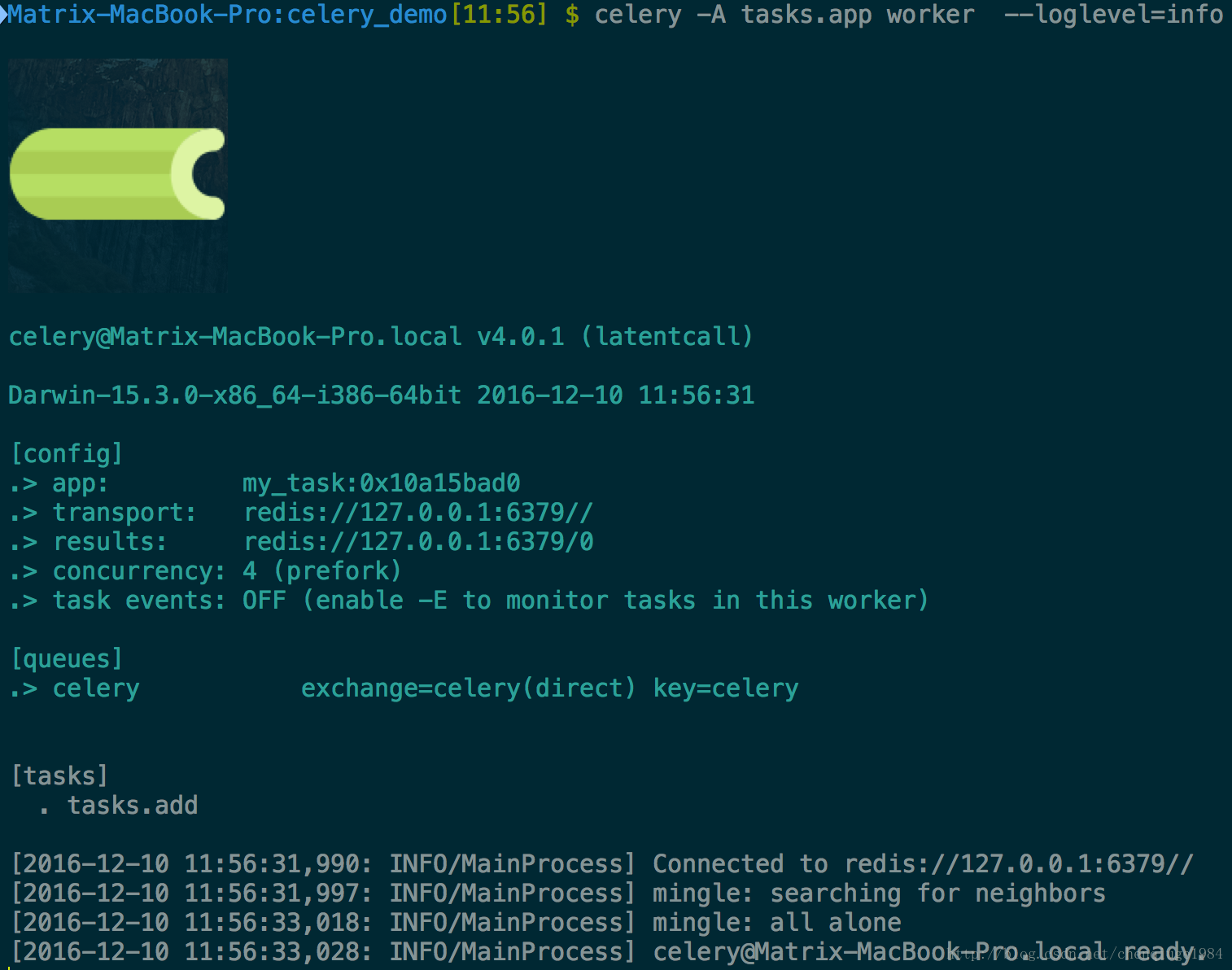

启动 Celery Worker

在当前目录,使用如下方式启动 Celery Worker:

celery worker -A tasks --loglevel=info

其中:

参数 -A 指定了 Celery 实例的位置,本例是在 tasks.py 中,Celery 会自动在该文件中寻找 Celery 对象实例,当然,我们也可以自己指定,在本例,使用 -A tasks.app;

参数 --loglevel 指定了日志级别,默认为 warning,也可以使用 -l info 来表示;

在生产环境中,我们通常会使用 Supervisor 来控制 Celery Worker 进程。

启动成功后,控制台会显示如下输出:

调用任务

现在,我们可以在应用程序中使用 delay() 或 apply_async() 方法来调用任务。

在当前目录打开 Python 控制台,输入以下代码:

>>> from tasks import add

>>> add.delay(, )

<AsyncResult: 2272ddce-8be5-493f-b5ff-35a0d9fe600f>

在上面,我们从 tasks.py 文件中导入了 add 任务对象,然后使用 delay() 方法将任务发送到消息中间件(Broker),Celery Worker 进程监控到该任务后,就会进行执行。我们将窗口切换到 Worker 的启动窗口,会看到多了两条日志:

[-- ::,: INFO/MainProcess] Received task: tasks.add[2272ddce-8be5-493f-b5ff-35a0d9fe600f]

[-- ::,: INFO/PoolWorker-] Task tasks.add[2272ddce-8be5-493f-b5ff-35a0d9fe600f] succeeded in .00642602402s:

这说明任务已经被调度并执行成功。

另外,我们如果想获取执行后的结果,可以这样做:

>>> result = add.delay(, )

>>> result.ready() # 使用 ready() 判断任务是否执行完毕

False

>>> result.ready()

False

>>> result.ready()

True

>>> result.get() # 使用 get() 获取任务结果

在上面,我们是在 Python 的环境中调用任务。事实上,我们通常在应用程序中调用任务。比如,将下面的代码保存为 client.py:

# -*- coding: utf- -*- from tasks import add # 异步任务

add.delay(, ) print 'hello world'

运行命令 python client.py,可以看到,虽然任务函数 add 需要等待 5 秒才返回执行结果,但由于它是一个异步任务,不会阻塞当前的主程序,因此主程序会往下执行 print 语句,打印出结果。

使用配置

在上面的例子中,我们直接把 Broker 和 Backend 的配置写在了程序当中,更好的做法是将配置项统一写入到一个配置文件中,通常我们将该文件命名为 celeryconfig.py。Celery 的配置比较多,可以在官方文档查询每个配置项的含义。

下面,我们再看一个例子。项目结构如下:

celery_demo # 项目根目录

├── celery_app # 存放 celery 相关文件

│ ├── __init__.py

│ ├── celeryconfig.py # 配置文件

│ ├── task1.py # 任务文件

│ └── task2.py # 任务文件

└── client.py # 应用程序

__init__.py 代码如下:

# -*- coding: utf- -*-

from celery import Celery

app = Celery('demo') # 创建 Celery 实例

app.config_from_object('celery_app.celeryconfig') # 通过 Celery 实例加载配置模块

celeryconfig.py 代码如下:

BROKER_URL = 'redis://127.0.0.1:6379' # 指定 Broker

CELERY_RESULT_BACKEND = 'redis://127.0.0.1:6379/0' # 指定 Backend CELERY_TIMEZONE='Asia/Shanghai' # 指定时区,默认是 UTC

# CELERY_TIMEZONE='UTC' CELERY_IMPORTS = ( # 指定导入的任务模块

'celery_app.task1',

'celery_app.task2'

)

task1.py 代码如下:

import time

from celery_app import app @app.task

def add(x, y):

time.sleep()

return x + y

task2.py 代码如下:

import time

from celery_app import app @app.task

def multiply(x, y):

time.sleep()

return x * y

client.py 代码如下:

# -*- coding: utf- -*- from celery_app import task1

from celery_app import task2 task1.add.apply_async(args=[, ]) # 也可用 task1.add.delay(, )

task2.multiply.apply_async(args=[, ]) # 也可用 task2.multiply.delay(, ) print 'hello world'

现在,让我们启动 Celery Worker 进程,在项目的根目录下执行下面命令:

celery -A celery_app worker --loglevel=info

接着,运行 python client.py,它会发送两个异步任务到 Broker,在 Worker 的窗口我们可以看到如下输出:

[-- ::,: INFO/MainProcess] Received task: celery_app.task1.add[9ccffad0-aca4--84ce-0ccfce5a83aa]

[-- ::,: INFO/MainProcess] Received task: celery_app.task2.multiply[64b1f889-c892--bd1d-ac667e677a8a]

[-- ::,: INFO/PoolWorker-] Task celery_app.task1.add[9ccffad0-aca4--84ce-0ccfce5a83aa] succeeded in .00600231002s:

[-- ::,: INFO/PoolWorker-] Task celery_app.task2.multiply[64b1f889-c892--bd1d-ac667e677a8a] succeeded in .00601326401s:

定时任务

Celery 除了可以执行异步任务,也支持执行周期性任务(Periodic Tasks),或者说定时任务。Celery Beat 进程通过读取配置文件的内容,周期性地将定时任务发往任务队列。

让我们看看例子,项目结构如下:

celery_demo # 项目根目录

├── celery_app # 存放 celery 相关文件

├── __init__.py

├── celeryconfig.py # 配置文件

├── task1.py # 任务文件

└── task2.py # 任务文件

__init__.py 代码如下:

# -*- coding: utf- -*-

from celery import Celery

app = Celery('demo')

app.config_from_object('celery_app.celeryconfig')

celeryconfig.py 代码如下:

# -*- coding: utf- -*- from datetime import timedelta

from celery.schedules import crontab # Broker and Backend

BROKER_URL = 'redis://127.0.0.1:6379'

CELERY_RESULT_BACKEND = 'redis://127.0.0.1:6379/0' # Timezone

CELERY_TIMEZONE='Asia/Shanghai' # 指定时区,不指定默认为 'UTC'

# CELERY_TIMEZONE='UTC' # import

CELERY_IMPORTS = (

'celery_app.task1',

'celery_app.task2'

) # schedules

CELERYBEAT_SCHEDULE = {

'add-every-30-seconds': {

'task': 'celery_app.task1.add',

'schedule': timedelta(seconds=), # 每 秒执行一次

'args': (, ) # 任务函数参数

},

'multiply-at-some-time': {

'task': 'celery_app.task2.multiply',

'schedule': crontab(hour=, minute=), # 每天早上 点 分执行一次

'args': (, ) # 任务函数参数

}

}

task1.py 代码如下:

import time

from celery_app import app @app.task

def add(x, y):

time.sleep()

return x + y

task2.py 代码如下:

import time

from celery_app import app @app.task

def multiply(x, y):

time.sleep()

return x * y

现在,让我们启动 Celery Worker 进程,在项目的根目录下执行下面命令:

celery -A celery_app worker --loglevel=info

接着,启动 Celery Beat 进程,定时将任务发送到 Broker,在项目根目录下执行下面命令:

celery_demo $ celery beat -A celery_app

celery beat v4.0.1 (latentcall) is starting.

__ - ... __ - _

LocalTime -> -- ::

Configuration ->

. broker -> redis://127.0.0.1:6379//

. loader -> celery.loaders.app.AppLoader

. scheduler -> celery.beat.PersistentScheduler

. db -> celerybeat-schedule

. logfile -> [stderr]@%WARNING

. maxinterval -> 5.00 minutes (300s)

之后,在 Worker 窗口我们可以看到,任务 task1 每 30 秒执行一次,而 task2 每天早上 9 点 50 分执行一次。

在上面,我们用两个命令启动了 Worker 进程和 Beat 进程,我们也可以将它们放在一个命令中:

$ celery -B -A celery_app worker --loglevel=info

错误:Celery ValueError: not enough values to unpack (expected 3, got 0)

解决方案:

pip install eventlet

运行:celery -A <mymodule> worker -l info -P eventlet

如果不加上-P eventlet,否则还会报错

参考文章:https://blog.csdn.net/chenqiuge1984/article/details/80127446

cerely-分布式异步任务队列的更多相关文章

- Python开发【模块】:Celery 分布式异步消息任务队列

Celery 前言: Celery 是一个 基于python开发的分布式异步消息任务队列,通过它可以轻松的实现任务的异步处理, 如果你的业务场景中需要用到异步任务,就可以考虑使用celery, 举几个 ...

- 异步任务队列Celery在Django中的使用

前段时间在Django Web平台开发中,碰到一些请求执行的任务时间较长(几分钟),为了加快用户的响应时间,因此决定采用异步任务的方式在后台执行这些任务.在同事的指引下接触了Celery这个异步任务队 ...

- Django使用Celery异步任务队列

1 Celery简介 Celery是异步任务队列,可以独立于主进程运行,在主进程退出后,也不影响队列中的任务执行. 任务执行异常退出,重新启动后,会继续执行队列中的其他任务,同时可以缓存停止期间接收 ...

- Celery异步任务队列/周期任务+ RabbitMQ + Django

一.Celery介绍和基本使用 Celery 是一个 基于python开发的分布式异步消息任务队列,通过它可以轻松的实现任务的异步处理, 如果你的业务场景中需要用到异步任务,就可以考虑使用celer ...

- 分布式异步框架celery

Celery 1.什么是Clelery Celery是一个简单.灵活且可靠的,处理大量消息的分布式系统 专注于实时处理的异步任务队列 同时也支持任务调度 Celery架构 Celery的架构由三部分组 ...

- Celery分布式异步任务框架

一.什么是Celery Celery是一个简单.灵活且可靠的,处理大量消息的分布式系统.专注于实时处理的异步任务队列,同时也支持定时任务 二.Celery架构 1.Celery的架构由三部分组成: 消 ...

- django celery的分布式异步之路(二) 高并发

当你跑通了前面一个demo,博客地址:http://www.cnblogs.com/kangoroo/p/7299920.html,那么你的分布式异步之旅已经起步了. 性能和稳定性是web服务的核心评 ...

- django celery的分布式异步之路(一) 起步

如果你看完本文还有兴趣的话,可以看看进阶篇:http://www.cnblogs.com/kangoroo/p/7300433.html 设想你遇到如下场景: 1)高并发 2)请求的执行相当消耗机器资 ...

- celery分布式异步框架

1.什么是Celery Celery是一个简单.灵活且可靠的,处理大量消息的分布式系统 专注于实时处理的异步任务队列 同时也支持任务调度 Celery架构 Celery的架构由三部分组成,消息中间件( ...

- Swoole来实现实时异步任务队列

假如要发100封邮件,for循环100遍,用户直接揭竿而起,什么破网站!但实际上,我们很可能有超过1万的邮件.怎么处理这个延迟的问题?答案就是用异步.把“发邮件”这个操作封装,然后后台异步地执行1万遍 ...

随机推荐

- JAVA基础系列:反射

1. 定义 在运行状态中,对于任意一个类,都能够知道这个类的所有属性和方法:对于任意一个对象,都能够调用它的任意一个方法:这 种动态获取的信息以及动态调用对象的方法的功能称为java语言的反射机制. ...

- 大话设计模式Python实现-外观模式

外观模式(Facade Pattern):为子系统中的一组接口提供一个一致界面,此模式定义一个高层接口,使得子系统更加容易使用 下面是一个外观模式的demo: #!/usr/bin/env pytho ...

- Gin框架 - 使用 Logrus 进行日志记录

概述 上篇文章分享了 Gin 框架的路由配置,这篇文章分享日志记录. 查了很多资料,Go 的日志记录用的最多的还是 github.com/sirupsen/logrus. Logrus is a st ...

- HTML+css基础 css的几种形式

1.行间样式:将style写在标签内的充当标签标签属性 2.行内样式

- python中pkl用法

原文连接:https://www.jianshu.com/p/2ecadebe6d13 python中pkl用法 经常遇到在Python程序运行得到了一些字符串.列表.字典等数据,想要长久的保存下来, ...

- Python 多进程池

def get_html(n): time.sleep(n) print("sub_progress success") return n # 多进程池 pool = multip ...

- Java对象依次取出属性,并去掉特殊字符

工作里从数据库往前台调数据的时候,庞大的数据量里难免有些字段里包含空格或者一些特殊字符,在前台显示出来会非常不美观,所以在此记录一个去对象内所有属性特殊字符的方法: //获得该对象属性的集合 Fiel ...

- Python 简单爬虫案例

Python 简单爬虫案例 import requests url = "https://www.sogou.com/web" # 封装参数 wd = input('enter a ...

- UWP 推荐 - 限时免费的RSS阅读器《RSS 追踪》登录 Windows 10

文/云之幻 前不久,博客作者 Bravo Yeung 写了一篇还算略受欢迎的关于 RSS 的文章 .Net开发者必知的技术类RSS订阅指南. RSS 现在用的人很少了,而且就算是我,也不过是在一周前才 ...

- Enum.GetUnderlyingType(obj.GetType())

Enum.GetUnderlyingType(obj.GetType())获取保存枚举值的数据类型: