超级AI助手:全新提升!中文NLP训练框架,快速上手,海量训练数据

“超级AI助手:全新提升!中文NLP训练框架,快速上手,海量训练数据,ChatGLM-v2、中文Bloom、Dolly_v2_3b助您实现更智能的应用!”

1.简介

目标:基于pytorch、transformers做中文领域的nlp开箱即用的训练框架,提供全套的训练、微调模型(包括大模型、文本转向量、文本生成、多模态等模型)的解决方案;数据:- 从开源社区,整理了海量的训练数据,帮助用户可以快速上手;

- 同时也开放训练数据模版,可以快速处理垂直领域数据;

- 结合多线程、内存映射等更高效的数据处理方式,即使需要处理

百GB规模的数据,也是轻而易举;

流程:每一个项目有完整的模型训练步骤,如:数据清洗、数据处理、模型构建、模型训练、模型部署、模型图解;模型:当前已经支持gpt2、clip、gpt-neox、dolly、llama、chatglm-6b、VisionEncoderDecoderModel等多模态大模型;多卡串联

:当前,多数的大模型的尺寸已经远远大于单个消费级显卡的显存,需要将多个显卡串联,才能训练大模型、才能部署大模型。因此对部分模型结构进行修改,实现了训练时、推理时

的多卡串联功能。

- 模型训练

| 中文名称 | 文件夹名称 | 数据 | 数据清洗 | 大模型 | 模型部署 | 图解 |

|---|---|---|---|---|---|---|

| 中文文本分类 | chinese_classifier | |||||

中文gpt2 |

chinese_gpt2 | |||||

中文clip |

chinese_clip | |||||

| 图像生成中文文本 | VisionEncoderDecoderModel | |||||

| vit核心源码介绍 | vit model | |||||

Thu-ChatGlm-6b(v1) |

simple_thu_chatglm6b | |||||

chatglm-v2-6b |

chatglm_v2_6b_lora | |||||

中文dolly_v2_3b |

dolly_v2_3b | |||||

中文llama |

chinese_llama | |||||

中文bloom |

chinese_bloom | |||||

中文falcon(注意:falcon模型和bloom结构类似) |

chinese_bloom | |||||

| 中文预训练代码 | model_clm | |||||

| 百川大模型 | model_baichuan | |||||

| 模型修剪️ | model_modify | |||||

| llama2 流水线并行 | pipeline |

2.thu-chatglm-6b模型教程

- 本文件夹只能进行单机单卡训练,如果想要使用单机多卡,请查看文件夹Chatglm6b_ModelParallel_ptuning。

| 介绍 | 路径 | 状态 |

|---|---|---|

使用lora训练chatglm6b |

就是本文件夹 | |

使用ptuning-v2模型并行训练chatglm6b |

https://github.com/yuanzhoulvpi2017/zero_nlp/tree/main/Chatglm6b_ModelParallel_ptuning |

在文件code02_训练模型全部流程.ipynb的cell-5代码的前面,创建一个新的cell,然后把下面的代码放到这个cell里面

q1 = '''您叫什么名字?

您是谁?

您叫什么名字?这个问题的答案可能会提示出您的名字。

您叫这个名字吗?

您有几个名字?

您最喜欢的名字是什么?

您的名字听起来很好听。

您的名字和某个历史人物有关吗?

您的名字和某个神话传说有关吗?

您的名字和某个地方有关吗?

您的名字和某个运动队有关吗?

您的名字和某个电影或电视剧有关吗?

您的名字和某个作家有关吗?

您的名字和某个动漫角色有关吗?

您的名字和某个节日有关吗?

您的名字和某个动物有关吗?

您的名字和某个历史时期有关吗?

您的名字和某个地理区域有关吗?

您的名字和某个物品有关吗?比如,如果您的名字和铅笔有关,就可以问“您叫什么名字?您是不是用铅笔的人?”

您的名字和某个梦想或目标有关吗?

您的名字和某个文化或传统有关吗?

您的名字和某个电影或电视节目的情节有关吗?

您的名字和某个流行歌手或演员有关吗?

您的名字和某个体育运动员有关吗?

您的名字和某个国际组织有关吗?

您的名字和某个地方的气候或环境有关吗?比如,如果您的名字和春天有关,就可以问“您叫什么名字?春天是不是一种温暖的季节?”

您的名字和某个电影或电视节目的主题有关吗?

您的名字和某个电视节目或电影的角色有关吗?

您的名字和某个歌曲或音乐有关吗?

您叫什么名字?

谁创造了你

'''

q1 = q1.split('\n')

a1 = ["我是良睦路程序员开发的一个人工智能助手", "我是良睦路程序员再2023年开发的AI人工智能助手"]

import random

target_len__ = 6000

d1 = pd.DataFrame({'instruction':[random.choice(q1) for i in range(target_len__)]}).pipe(

lambda x: x.assign(**{

'input':'',

'output':[random.choice(a1) for i in range(target_len__)]

})

)

d1

alldata = d1.copy()

注意:

- 如果想要覆盖模型老知识,你数据需要重复很多次才行~

- 文件不要搞错了,使用我最新的代码文件

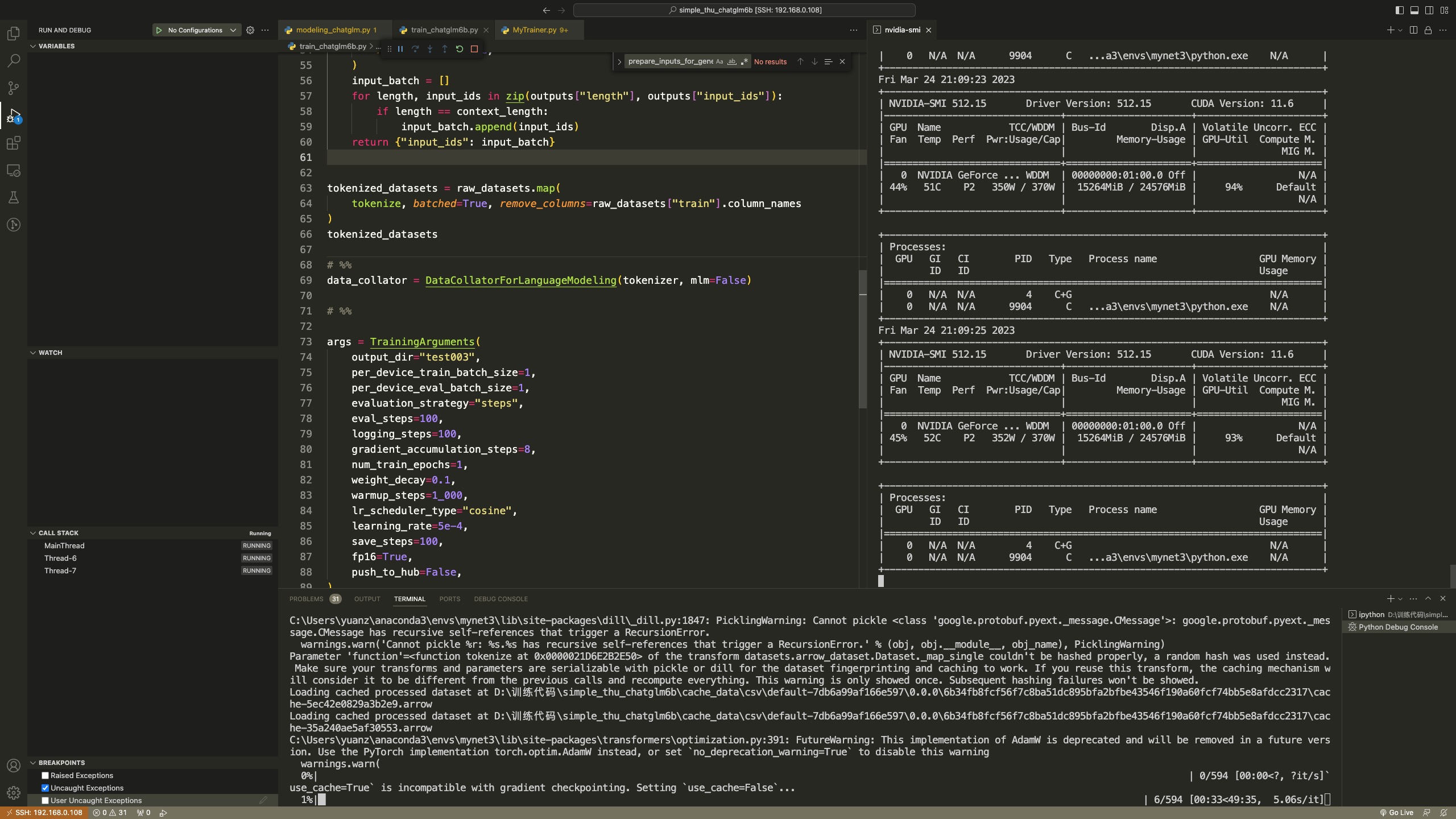

只是对transofrmers包的Trainer类做了修改,对modeling_chatglm.py代码也做了修改。

这么做,可以让你在拥有22G显存的情况下,可以训练thu-chatglm-6b模型。

那么,基于Trainer的丰富方法,你可以做很多事情。而且使用peft包https://github.com/huggingface/peft的lora算法,让你在一个消费级别的显卡上,就可以训练thu-chatglm-6b模型。

- 安装

上面是文件工程,这里开始说安装包,直接使用pip安装

pip install protobuf==3.20.0 transformers icetk cpm_kernels peft

就这么简单,不需要安装别的东西了

训练部分

在最新的版本中,只需要查看

code02_训练模型全部流程.ipynb文件就行了推理部分

- 推理部分,直接看

infer.ipynb代码 - 能到这里,也是恭喜你,微调模型已经成功了。这个时候,在这个文件夹下,肯定有一个文件夹叫

test003(就是上面output_dir="test003"对应的文件夹) - 在这个文件夹下,你肯定可以看到很多

checkpoint-xxx,选择一个你喜欢的(当然,肯定是最好选择最新的)。

3.chatglm_v2_6b_lora

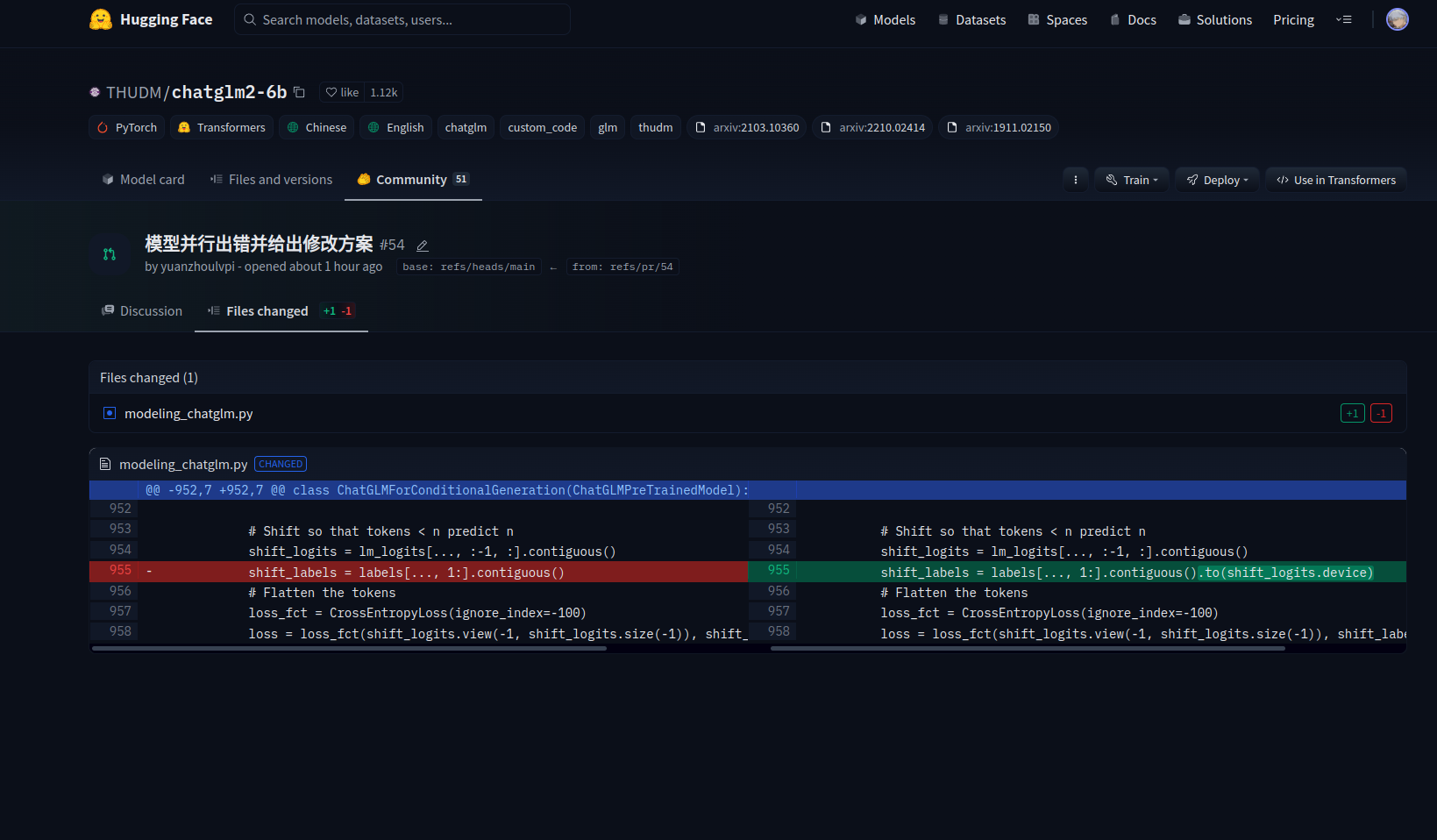

添加了上面的参数,确实可以进行模型并行,但是,这是在chatglm模型代码没有bug的情况下,目前已经定位到bug,并且修复了bug,我也提交PR给chatglm团队,可以点击这个链接查看https://huggingface.co/THUDM/chatglm2-6b/discussions/54#64b542b05c1ffb087056001c

考虑到他们团队效率问题,如果他们还没有修改这个bug,那你们可以自己修改,主要是这么做:

在modeling_chatglm.py的第955行代码附近(也就是modeling_chatglm.py/ChatGLMForConditionalGeneration.forward的loss部分):

原始代码:

loss = None

if labels is not None:

lm_logits = lm_logits.to(torch.float32)

# Shift so that tokens < n predict n

shift_logits = lm_logits[..., :-1, :].contiguous()

shift_labels = labels[..., 1:].contiguous() #<<<------------------看这里

# Flatten the tokens

loss_fct = CrossEntropyLoss(ignore_index=-100)

loss = loss_fct(shift_logits.view(-1, shift_logits.size(-1)), shift_labels.view(-1))

lm_logits = lm_logits.to(hidden_states.dtype)

loss = loss.to(hidden_states.dtype)

if not return_dict:

output = (lm_logits,) + transformer_outputs[1:]

return ((loss,) + output) if loss is not None else output

return CausalLMOutputWithPast(

loss=loss,

logits=lm_logits,

past_key_values=transformer_outputs.past_key_values,

hidden_states=transformer_outputs.hidden_states,

attentions=transformer_outputs.attentions,

)

修改为:

loss = None

if labels is not None:

lm_logits = lm_logits.to(torch.float32)

# Shift so that tokens < n predict n

shift_logits = lm_logits[..., :-1, :].contiguous()

shift_labels = labels[..., 1:].contiguous().to(shift_logits.device) #<<<--------------------看这里

# Flatten the tokens

loss_fct = CrossEntropyLoss(ignore_index=-100)

loss = loss_fct(shift_logits.view(-1, shift_logits.size(-1)), shift_labels.view(-1))

lm_logits = lm_logits.to(hidden_states.dtype)

loss = loss.to(hidden_states.dtype)

if not return_dict:

output = (lm_logits,) + transformer_outputs[1:]

return ((loss,) + output) if loss is not None else output

return CausalLMOutputWithPast(

loss=loss,

logits=lm_logits,

past_key_values=transformer_outputs.past_key_values,

hidden_states=transformer_outputs.hidden_states,

attentions=transformer_outputs.attentions,

)

是的,就修改那一行即可

然后就可以正常跑起来了~

- 下载数据集

ADGEN 数据集任务为根据输入(content)生成一段广告词(summary)。

{

"content": "类型#上衣*版型#宽松*版型#显瘦*图案#线条*衣样式#衬衫*衣袖型#泡泡袖*衣款式#抽绳",

"summary": "这件衬衫的款式非常的宽松,利落的线条可以很好的隐藏身材上的小缺点,穿在身上有着很好的显瘦效果。领口装饰了一个可爱的抽绳,漂亮的绳结展现出了十足的个性,配合时尚的泡泡袖型,尽显女性甜美可爱的气息。"

}

从 Google Drive

或者 Tsinghua Cloud 下载处理好的 ADGEN

数据集,将解压后的 AdvertiseGen 目录放到本目录下。

- 硬件要求

- 有个

3090显卡即可(24G显存左右) - 在下面这个参数下,显存只需要

14G

--max_source_length 64 \

--max_target_length 128 \

--per_device_train_batch_size 1 \

--per_device_eval_batch_size 1 \

--lora_r 32

- 训练脚本

- 使用vscode调试,就在

.vscode/launch.json里面; - 直接使用sh,

sh train.sh

- 推理

- 使用文件:

infer_lora.ipynb

- 使用

lora推理

from transformers import AutoTokenizer, AutoModel

from peft import PeftModel, PeftConfig

import torch

import os

os.environ['CUDA_VISIBLE_DEVICES'] = '1'

#原始的模型路径

model_name_or_path = "/media/yuanz/新加卷/训练代码/chatglm6b_v2_0716/chatglm2-6b_model"

#训练后的lora保存的路径

peft_model_id = "output/adgen-chatglm2-6b-lora_version/checkpoint-880"

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, trust_remote_code=True)

model = AutoModel.from_pretrained(model_name_or_path, trust_remote_code=True, device_map='auto',

torch_dtype=torch.bfloat16) # .half().cuda()

model = PeftModel.from_pretrained(model, peft_model_id)

model = model.eval()

response, history = model.chat(tokenizer, "类型#上衣*材质#牛仔布*颜色#白色*风格#简约*图案#刺绣*衣样式#外套*衣款式#破洞",

history=[])

print(response)

- 血的教训

- 一定要从

huggingface上把chatglm-v2-6b的所有文件都下载下来,放在一个文件夹下;这样即使他更新了,也不会影响到你。如果你不下载,你会很被动

- 相关的BUG

很多人在跑多卡的时候,会遇到一些莫名其妙的错误,建议您按照下面两个步骤进行排查:

- 一定要看我上面折叠的那一块东西,就是

注意部分。 - 检查

transformers的版本,如果太低,就更新一下,建议更新:pip install transformers -U

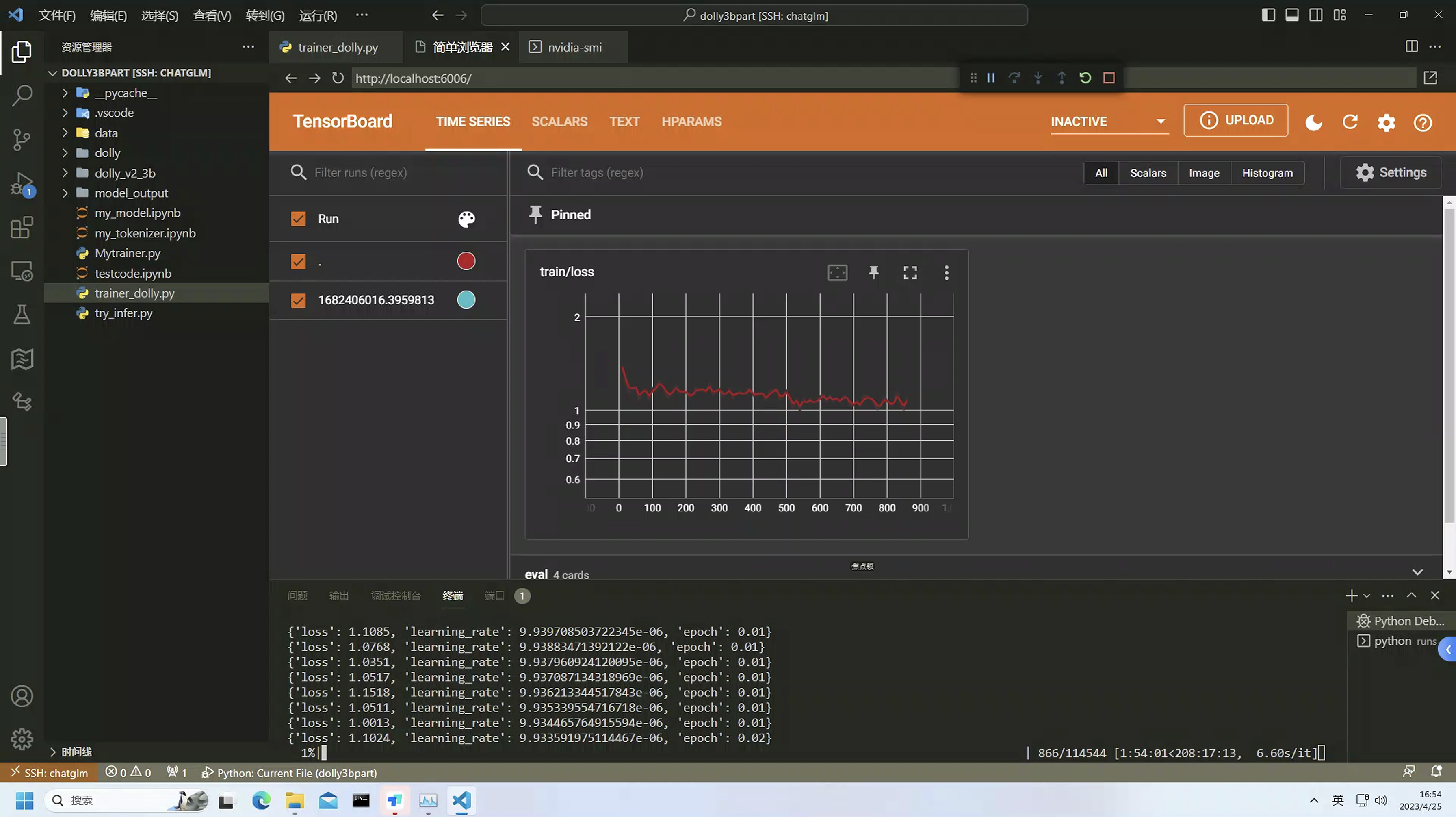

4.中文的dolly_v2_3b模型

训练中文的

dolly_v2_3b模型dolly_v2_3b模型本质上就是使用的gpt_neox模型框架,可以商用,而且也都出来很多年了。- 当前有很多人基于

llama、gptj、chatglm-6b等模型,做了很多微调,有些也都做过了,有些不能商用,有些还要申请,实在是太可惜了,太麻烦了。 - 既然

dolly_v2_3b可以商用,那我们就主打一个随意,稍微动动手就可以训练一个属于我们的模型。 - 本仓库用到的代码,来源于

databrickslabs/dolly,对代码做了部分调整和融合。反正就是复制粘贴、懂得都懂~ - 模型叫什么名字:

小黑子,已将模型放在https://huggingface.co/yuanzhoulvpi/xiaoheizi-3b

- 支持多卡模型并行:也不知道

databrickslabs/dolly为啥要使用gpt_neox模型,这个模型transformers对他支持的其实一般,于是我把代码魔改了一部分,增加了多卡并行计算功能(主要是是模型并行). - 虽然代码是从

databrickslabs/dolly复制的,但是简化了很多不必要的代码,更简单一点,我不喜欢复杂的代码,越简单越好。 - 支持

bp16:我原本的打算是说支持fp16的,但是发现fp16怎么搞都不行,但是bp16倒是可以。

下一步优化方向

- 添加

lora等微调训练代码,这个简单,等后面都训练好了,我添加一下。

- 支持多卡模型并行:也不知道

模型训练情况

- 训练数据:

BelleGroup/train_1M_CN - 训练时间:280小时左右

- 训练设备:

4台3090

- 训练数据:

- 更多

- 当前的模型参数是

3b,但是当你把整个流程跑通之后,可以很轻松的将3b模型换成7b模型或者更大的gpt_neox模型。而你只需要将硬件进行提升即可,无需调整代码~ - 当前的

3b模型是否满足你的需求还不确定,后面你可以试一试。(当前还没发布) - 到底是大模型好还是小模型好,可以看看这句话:

吴恩达:有多少应用程序需要用到像GPT-4这样的最大型模型,而不是云提供商提供的更小(更便宜)的模型,甚至是本地托管的模型(比如运行在桌面上的gpt4all)还有待观察 - 对于个人或者小企业,强调的的就是在

垂直领域做快速迭代,希望3b模型可以帮助到你!

- 当前的模型参数是

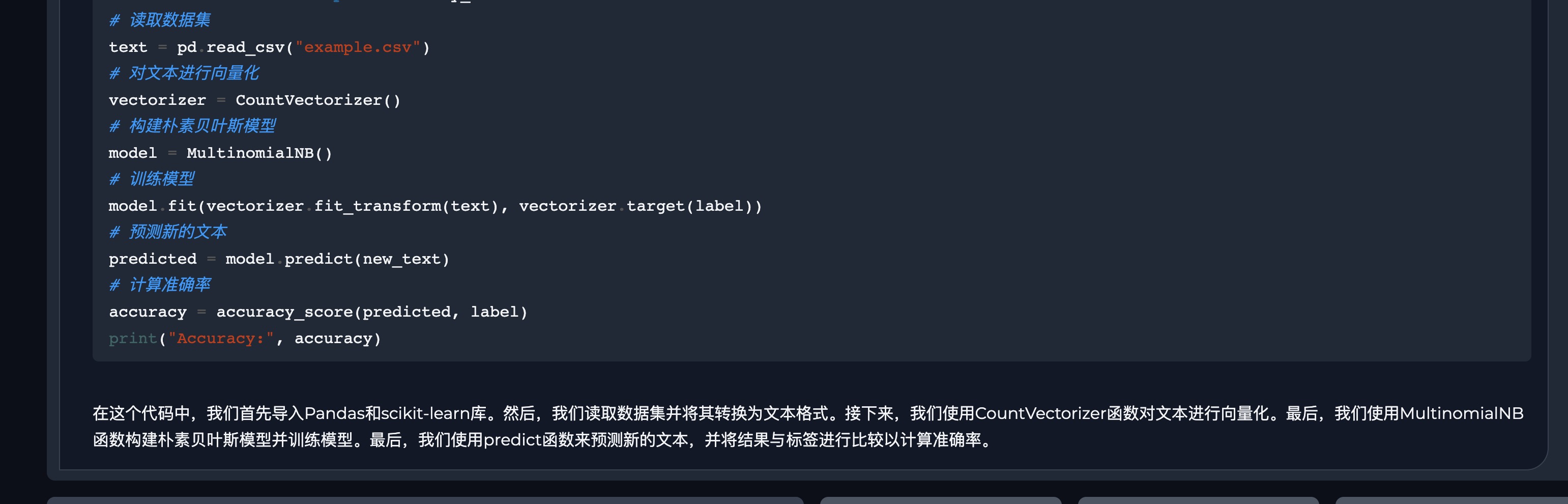

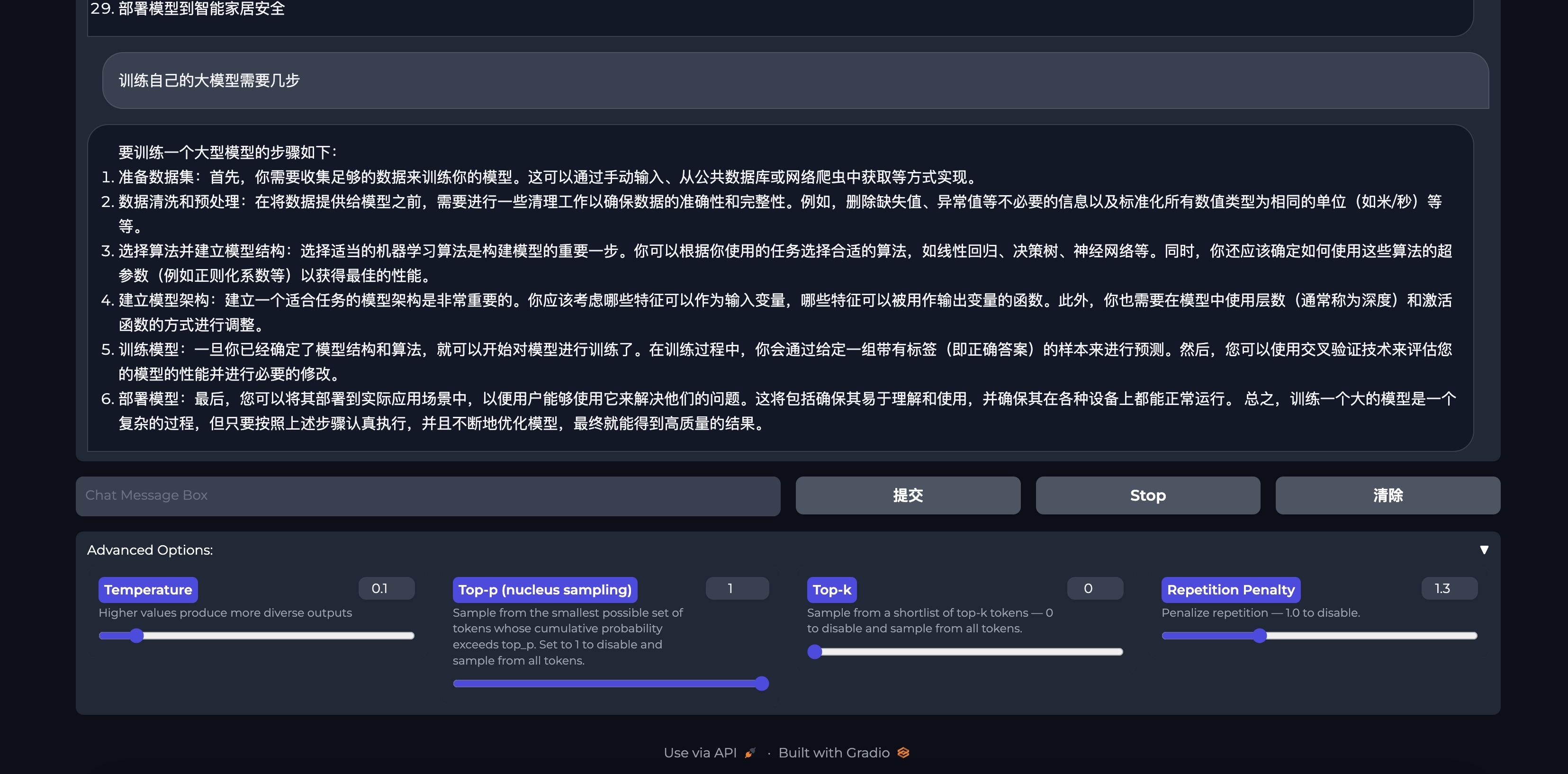

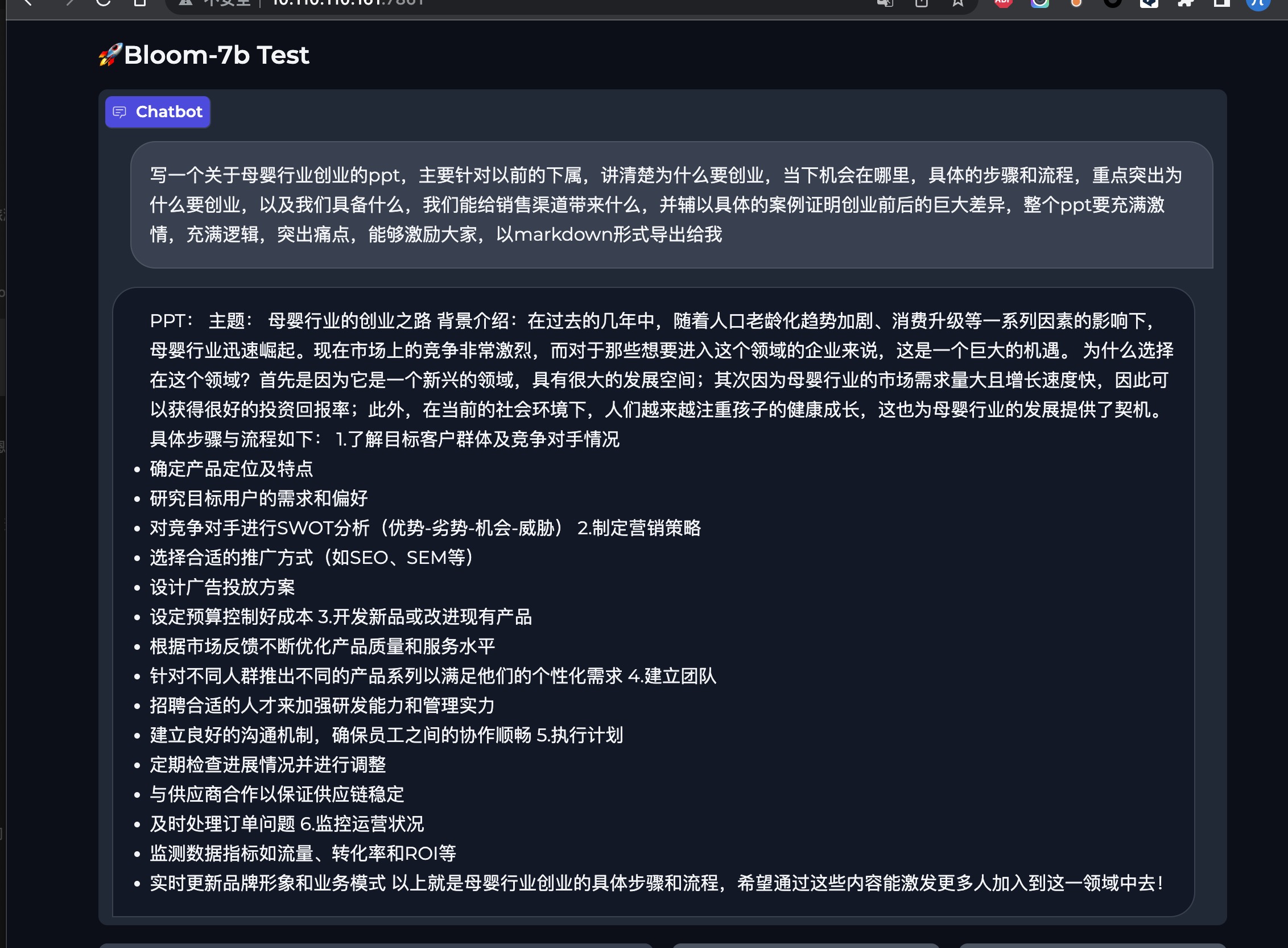

5.chinese_bloom

支持对

falcon模型做sft~基于stanford_alpaca项目,使用

sft格式数据对bloom、falcon模型微调;支持

deepspeed-zero2、deepspeed-zero3;支持自定义数据,支持大数据训练;

得益于

bloom本身的能力,微调后的模型支持中文、英文、代码、法语、西班牙语等;微调后的模型,中文能力显著提升;

支持不同尺寸

bloom模型,如560m、3b、7b、13b;支持

falcon模型,如https://huggingface.co/tiiuae/falcon-7b;

- 体验

bloom-560m_chat: 想要体验一个轻量的,那就直接体验5.6亿参数https://huggingface.co/yuanzhoulvpi/chinese_bloom_560mbloom-7b_chat: 想要体验一个更大的,那就可以试一试70亿参数https://huggingface.co/yuanzhoulvpi/chinese_bloom_7b_chat

- 在hugginface上部署了一个cpu版本的(有点慢,毕竟是)https://huggingface.co/spaces/yuanzhoulvpi/chinese_bloom_560_chat

- 模型

bloom模型支持中文、英文、代码、法语、西班牙语。bloom-系列模型: https://huggingface.co/bigscience

- 数据

- 数据来源于

BelleGroup,主要是用到这几个数据集:['BelleGroup/generated_chat_0.4M', 'BelleGroup/school_math_0.25M', 'BelleGroup/train_2M_CN', 'BelleGroup/train_1M_CN', 'BelleGroup/train_0.5M_CN', 'BelleGroup/multiturn_chat_0.8M']; - 可以基于这些数据样式,制作自己的数据,并训练;

步骤

数据部分

- 运行

data_proj/process_data.ipynb代码;或者模仿结果,制作自己的数据集; - 运行结束之后,有一个文件夹

data_proj/opendata。文件夹下有若干个json格式的文件。

- 运行

运行模型

- 基础运行策略

sh base_run.sh

deepspeed运行策略

sh ds_all.sh

- 推理代码

infer.ipynb文件gradio交互界面:https://huggingface.co/spaces/yuanzhoulvpi/chinese_bloom_560_chat 因为是使用的huggingface的免费的cpu版本,所以推理速度比较慢。

- 效果

不管是写代码还是写文案,bloom-7b在中文领域有极大的潜力

- 体验

chinese_bloom_560m模型,可以在这里体验https://huggingface.co/spaces/yuanzhoulvpi/chinese_bloom_560_chatchinese_bloom_7b模型,可以在这里体验http://101.68.79.42:7861

项目链接:https://github.com/yuanzhoulvpi2017/zero_nlp

更多优质内容请关注公号:汀丶人工智能;会提供一些相关的资源和优质文章,免费获取阅读。

超级AI助手:全新提升!中文NLP训练框架,快速上手,海量训练数据的更多相关文章

- [源码解析] 深度学习分布式训练框架 horovod (16) --- 弹性训练之Worker生命周期

[源码解析] 深度学习分布式训练框架 horovod (16) --- 弹性训练之Worker生命周期 目录 [源码解析] 深度学习分布式训练框架 horovod (16) --- 弹性训练之Work ...

- [源码解析] 深度学习分布式训练框架 horovod (12) --- 弹性训练总体架构

[源码解析] 深度学习分布式训练框架 horovod (12) --- 弹性训练总体架构 目录 [源码解析] 深度学习分布式训练框架 horovod (12) --- 弹性训练总体架构 0x00 摘要 ...

- [源码解析] 深度学习分布式训练框架 horovod (13) --- 弹性训练之 Driver

[源码解析] 深度学习分布式训练框架 horovod (13) --- 弹性训练之 Driver 目录 [源码解析] 深度学习分布式训练框架 horovod (13) --- 弹性训练之 Driver ...

- [源码解析] 深度学习分布式训练框架 horovod (14) --- 弹性训练发现节点 & State

[源码解析] 深度学习分布式训练框架 horovod (14) --- 弹性训练发现节点 & State 目录 [源码解析] 深度学习分布式训练框架 horovod (14) --- 弹性训练 ...

- [源码解析] 深度学习分布式训练框架 horovod (17) --- 弹性训练之容错

[源码解析] 深度学习分布式训练框架 horovod (17) --- 弹性训练之容错 目录 [源码解析] 深度学习分布式训练框架 horovod (17) --- 弹性训练之容错 0x00 摘要 0 ...

- 使用紧凑的序列化器,数倍提升性能 —— ESFramework 4.0 快速上手(11)

在分布式通信系统中,网络传递的是二进制流,而内存中是我们基于对象模型构建的各种各样的对象,当我们需要将一个对象通过网络传递给另一个节点时,首先需要将其序列化为字节流,然后通过网络发送给目标节点,目标节 ...

- [源码解析] 深度学习分布式训练框架 horovod (18) --- kubeflow tf-operator

[源码解析] 深度学习分布式训练框架 horovod (18) --- kubeflow tf-operator 目录 [源码解析] 深度学习分布式训练框架 horovod (18) --- kube ...

- [源码解析] 深度学习分布式训练框架 horovod (19) --- kubeflow MPI-operator

[源码解析] 深度学习分布式训练框架 horovod (19) --- kubeflow MPI-operator 目录 [源码解析] 深度学习分布式训练框架 horovod (19) --- kub ...

- [源码解析] 深度学习分布式训练框架 horovod (21) --- 之如何恢复训练

[源码解析] 深度学习分布式训练框架 horovod (21) --- 之如何恢复训练 目录 [源码解析] 深度学习分布式训练框架 horovod (21) --- 之如何恢复训练 0x00 摘要 0 ...

- [源码解析] 深度学习分布式训练框架 horovod (15) --- 广播 & 通知

[源码解析] 深度学习分布式训练框架 horovod (15) --- 广播 & 通知 目录 [源码解析] 深度学习分布式训练框架 horovod (15) --- 广播 & 通知 0 ...

随机推荐

- 2016年第七届 蓝桥杯C组 C/C++决赛题解

蓝桥杯历年国赛真题汇总:Here 1.平方末尾 能够表示为某个整数的平方的数字称为"平方数" 比如,25,64 虽然无法立即说出某个数是平方数,但经常可以断定某个数不是平方数. 因 ...

- Codeforces Round #707 (Div. 2, based on Moscow Open Olympiad in Informatics Editorial

Codeforces Round #707 (Div. 2, based on Moscow Open Olympiad in Informatics) Problem 1501A. Alexey a ...

- 为什么我要迁移SpringBoot到函数计算

前言 为什么要迁移? 我们的业务有很多对外提供服务的 RESTful API,并且要执行很多不同的任务,例如同步连锁 ERP 中的商品信息到美团/饿了么等平台,在线开发票等.由于各种 API 和任务执 ...

- element-ui 实现行合并-亲测有效!

目标样式: 首先先来看下我们拿到的返回数据: scheduleList: [ { date: '第一天', journey: '报道', lecturer: '', }, { date: '第二天', ...

- freeswitch的mod_xml_curl模块动态获取configuration

概述 freeswitch是一款简单好用的VOIP开源软交换平台. mod_xml_curl模块支持从web服务获取xml配置,本文介绍如何动态获取acl配置. 环境 centos:CentOS r ...

- 解决Xshell/Xftp提示“要继续使用此程序必须应用到最新的更新或者新版本”(临时规避和彻底解决方案)

一.xshell与xftp登录时提示,但是更新却又每次都失败,无法登录 二. 临时规避方案:手动修改日期为1年前,问题解决软件可以打开,但是每次启动都要手动修改,甚是麻烦 三.彻底解决方案,修改xs ...

- 01-Linux命令和C语言基础

1 Linux开发环境搭建 1.1 虚拟机安装 1.安装VM Ware 2.安装ubuntu 分区 -- Linux没有盘符的概念 / -- 5000M /boot -- 系统启动过程中读取的重要文件 ...

- 【PHP】 延时跳转

echo "<meta http-equiv=\"refresh\" content=\"5;url="."register.php& ...

- Laravel - 使用ajax

一,前台模板文件 index.blade.php <!DOCTYPE html> <meta name="_token" content="{{ cs ...

- IL合集二

引言 在第一篇关于IL的文章中,我们写了一些IL的相加,创建对象,循环以及实现TryCatch的一些功能,接下来,为大家带上后续关于IL的更新,其中包括,类型转换,以及条件判断,还有定义字段,定义属性 ...