【深度学习】基础--NumPy

因为深度学习会应用到我们大学时候学习的数学知识---线性代数。(矩阵当年想起来还是挺有意思的,有考研的经历都有感觉)

而在计算机里面如何展示矩阵的计算和应用,就需要运用到NumPy,是Python的一个外部库。

开始学习一下如何应用Numpy进行数组和矩阵的运算。

1.生成一维数组和计算

import numpy as np

x= np.array([1.0,2.0,3.0])

print(x)

y = np.array([3.0, 6.0, 9.0])

print(x+y)

print(x-y)

演示效果如下:

(zsdpy1) zsd@zsd-virtual-machine:~/ZAI$ python section01.py

[1. 2. 3.]

[ 4. 8. 12.]

[-2. -4. -6.]

2.生成矩阵与计算

生成一个简单的2*2矩阵,并计算两个简单的矩阵

import numpy as np

A= np.array([[1,2],[5,6]])

print(A)

A.shape

B = np.array([[3, 0],[0, 6]])

print(A+B)

演示效果:

(zsdpy1) zsd@zsd-virtual-machine:~/ZAI$ python section02.py

[[1 2]

[5 6]]

[[ 4 2]

[ 5 12]]

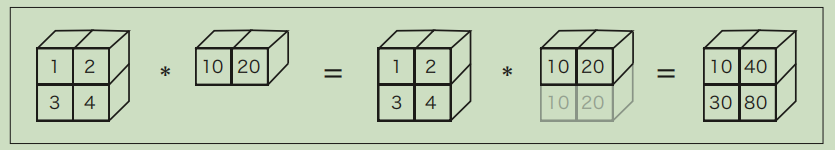

其中乘法计算的,就是读书时计算矩阵的方式,图片效果如下:

代码如下:

import numpy as np

A= np.array([[1,2],[5,6]])

B = np.array([10, 20])

print(A)

print(B)

print(A*B)

演示效果:

(zsdpy1) zsd@zsd-virtual-machine:~/ZAI$ python section03.py

[[1 2]

[5 6]]

[10 20]

[[ 10 40]

[ 50 120]]

【深度学习】基础--NumPy的更多相关文章

- 深度学习基础系列(九)| Dropout VS Batch Normalization? 是时候放弃Dropout了

Dropout是过去几年非常流行的正则化技术,可有效防止过拟合的发生.但从深度学习的发展趋势看,Batch Normalizaton(简称BN)正在逐步取代Dropout技术,特别是在卷积层.本文将首 ...

- 深度学习基础系列(五)| 深入理解交叉熵函数及其在tensorflow和keras中的实现

在统计学中,损失函数是一种衡量损失和错误(这种损失与“错误地”估计有关,如费用或者设备的损失)程度的函数.假设某样本的实际输出为a,而预计的输出为y,则y与a之间存在偏差,深度学习的目的即是通过不断地 ...

- [笔记] 基于nvidia/cuda的深度学习基础镜像构建流程 V0.2

之前的[笔记] 基于nvidia/cuda的深度学习基础镜像构建流程已经Out了,以这篇为准. 基于NVidia官方的nvidia/cuda image,构建适用于Deep Learning的基础im ...

- [Pytorch框架] 2.2 深度学习基础及数学原理

文章目录 2.2 深度学习基础及数学原理 2.2.1 监督学习和无监督学习 2.2.2 线性回归 (Linear Regreesion) 2.2.3 损失函数(Loss Function) nn.L1 ...

- 算法工程师<深度学习基础>

<深度学习基础> 卷积神经网络,循环神经网络,LSTM与GRU,梯度消失与梯度爆炸,激活函数,防止过拟合的方法,dropout,batch normalization,各类经典的网络结构, ...

- TensorFlow深度学习基础与应用实战高清视频教程

TensorFlow深度学习基础与应用实战高清视频教程,适合Python C++ C#视觉应用开发者,基于TensorFlow深度学习框架,讲解TensorFlow基础.图像分类.目标检测训练与测试以 ...

- 深度学习基础5:交叉熵损失函数、MSE、CTC损失适用于字识别语音等序列问题、Balanced L1 Loss适用于目标检测

深度学习基础5:交叉熵损失函数.MSE.CTC损失适用于字识别语音等序列问题.Balanced L1 Loss适用于目标检测 1.交叉熵损失函数 在物理学中,"熵"被用来表示热力学 ...

- 深度学习基础-基于Numpy的卷积神经网络(CNN)实现

本文是深度学习入门: 基于Python的实现.神经网络与深度学习(NNDL)以及动手学深度学习的读书笔记.本文将介绍基于Numpy的卷积神经网络(Convolutional Networks,CNN) ...

- 深度学习基础-基于Numpy的多层前馈神经网络(FFN)的构建和反向传播训练

本文是深度学习入门: 基于Python的实现.神经网络与深度学习(NNDL)以及花书的读书笔记.本文将以多分类任务为例,介绍多层的前馈神经网络(Feed Forward Networks,FFN)加上 ...

- 深度学习基础-基于Numpy的感知机Perception构建和训练

1. 感知机模型 感知机Perception是一个线性的分类器,其只适用于线性可分的数据. f(x) = sign(w.x + b) 其试图在所有线性可分超平面构成的假设空间中找 ...

随机推荐

- RelationNet:学习目标间关系来增强特征以及去除NMS | CVPR 2018

论文基于NLP的注意力机制提出了目标关系模块,通过与其它目标的比对增强当前目标的特征,而且还可以代替NMS进行端到端的重复结果去除,思想十分新颖,效果也不错 来源:晓飞的算法工程笔记 公众号 论文 ...

- CornerNet:经典keypoint-based方法,通过定位角点进行目标检测 | ECCV2018

论文提出了CornerNet,通过检测角点对的方式进行目标检测,与当前的SOTA检测模型有相当的性能.CornerNet借鉴人体姿态估计的方法,开创了目标检测领域的一个新框架,后面很多论文都基于Cor ...

- KingbaseES V8R6运维案例之---数据库resetwal后启动失败

KingbaseES V8R6运维案例之---数据库resetwal后启动失败 案例说明: KingbaseES V8R6集群触发failover切换后,原主库自动recovery失败,现在需要将原主 ...

- OpenHarmony——内核对象队列之算法详解(下)

前言 OpenAtom OpenHarmony(以下简称"OpenHarmony") LiteOS-M 内核是面向 IoT 领域构建的轻量级物联网操作系统内核,具有小体积.低功耗. ...

- R语言学习1:基本数据类型,文件读取

本系列是一个新的系列,在此系列中,我将和大家共同学习R语言.由于我对R语言的了解也甚少,所以本系列更多以一个学习者的视角来完成. 参考教材:<R语言实战>第二版(Robert I.Kaba ...

- HDC 2022 开发者主题演讲与技术分论坛干货分享(附课件)

原文:https://mp.weixin.qq.com/s/axm6HyX0PqKCKksFxIfehg,点击链接查看更多技术内容. 11月4日-11月6日,HDC 2022在东莞成功举办,这是 ...

- sql 语句系列(每个季度的开始日期和结束日期)[八百章之第二十二章]

前言 基本上统计财务一定会用到. mysql select QUARTER(ADDDATE(y.dy,-1)) QTR, DATE_ADD(y.dy,INTERVAL -3 MONTH) Q_star ...

- c# TryParse

c# tryparse和parse对比,大体内容是一致的. parse 会返回异常,主要表现为三种. 第一种ArgumentNullException,这里面表示,为空. 第二种formatexcep ...

- PTA三次作业

1.前言: 第一次作业难度较大,从无到有的设计,涉及到的主要类有Paper,Question,AnswerPaper,Main,主要题目方向为字符串判断与字符串处理(提取有效信息),判断对错算总分,配 ...

- 剑指offer05(Java)-替换空格(简单)

题目: 请实现一个函数,把字符串 s 中的每个空格替换成"%20". 示例 1: 输入:s = "We are happy."输出:"We%20are ...