Hadoop_04_Hadoop 的HDFS客户端shell命令

1.Hdfs shell客户端命令操作:

1.1.查看命令列表:hadoop fs

帮助如下:

Usage: hadoop fs [generic options]

[-appendToFile <localsrc> ... <dst>] //追加一个文件到已经存在的文件末尾

[-cat [-ignoreCrc] <src> ...]

[-checksum <src> ...]

[-chgrp [-R] GROUP PATH...]

[-chmod [-R] <MODE[,MODE]... | OCTALMODE> PATH...]

[-chown [-R] [OWNER][:[GROUP]] PATH...]

[-copyFromLocal [-f] [-p] [-l] <localsrc> ... <dst>]

[-copyToLocal [-p] [-ignoreCrc] [-crc] <src> ... <localdst>]

[-count [-q] [-h] <path> ...]

[-cp [-f] [-p | -p[topax]] <src> ... <dst>]

[-createSnapshot <snapshotDir> [<snapshotName>]]

[-deleteSnapshot <snapshotDir> <snapshotName>]

[-df [-h] [<path> ...]]

[-du [-s] [-h] <path> ...]

[-expunge]

[-find <path> ... <expression> ...]

[-get [-p] [-ignoreCrc] [-crc] <src> ... <localdst>]

[-getfacl [-R] <path>]

[-getfattr [-R] {-n name | -d} [-e en] <path>]

[-getmerge [-nl] <src> <localdst>]

[-help [cmd ...]]

[-ls [-d] [-h] [-R] [<path> ...]]

[-mkdir [-p] <path> ...]

[-moveFromLocal <localsrc> ... <dst>]

[-moveToLocal <src> <localdst>] //从hdfs剪切粘贴到本地

[-mv <src> ... <dst>]

[-put [-f] [-p] [-l] <localsrc> ... <dst>]

[-renameSnapshot <snapshotDir> <oldName> <newName>]

[-rm [-f] [-r|-R] [-skipTrash] <src> ...]

[-rmdir [--ignore-fail-on-non-empty] <dir> ...]

[-setfacl [-R] [{-b|-k} {-m|-x <acl_spec>} <path>]|[--set <acl_spec> <path>]]

[-setfattr {-n name [-v value] | -x name} <path>]

[-setrep [-R] [-w] <rep> <path> ...]

[-stat [format] <path> ...]

[-tail [-f] <file>]

[-test -[defsz] <path>]

[-text [-ignoreCrc] <src> ...]

[-touchz <path> ...]

[-truncate [-w] <length> <path> ...]

[-usage [cmd ...]] Generic options supported are

-conf <configuration file> specify an application configuration file

-D <property=value> use value for given property

-fs <local|namenode:port> specify a namenode

-jt <local|resourcemanager:port> specify a ResourceManager

-files <comma separated list of files> specify comma separated files to be copied to the map reduce cluster

-libjars <comma separated list of jars> specify comma separated jar files to include in the classpath.

-archives <comma separated list of archives> specify comma separated archives to be unarchived on the compute machines. The general command line syntax is

bin/hadoop command [genericOptions] [commandOptions]

1.1.1.查看文件列表:hadoop fs -ls / (/:HDFS文件系统的根目录)

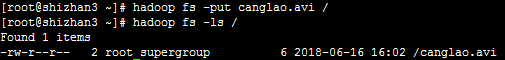

1.1.2.上传文件:hadoop fs -put canglao.avi /

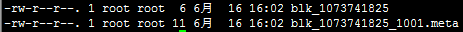

注意:真实的数据文件路径在DataNode节点数据目录的:/usr/local/src/hadoop-2.6.4/hdpdata3/dfs/data/current/BP-1438427861-192.168.232.201-1529131287527/current/finalized/subdir0/subdir0/下面有如下文件列表:

此时会发现在shizhan5的DataNode数据存放目录下面会有该blk_1073741825的副本

可以用下面的命令查看一下blk_1073741825文件的内容:cat blk_1073741825

然后会发现输出的内容是canglao.avi文件的内容。因为文件太小,没有切开。默认128M才切开,再放一个超过128M的文件:

hadoop fs -put /root/temp/hadoop-2.7.3.tar.gz /

在dataNode数据存放目录查看(同样存在副本):

-rw-r--r-- 1 root root 23562 2月 18 12:53 blk_1073741825

-rw-r--r-- 1 root root 195 2月 18 12:53 blk_1073741825_1001.meta

-rw-r--r-- 1 root root 134217728 2月 18 13:09 blk_1073741826

-rw-r--r-- 1 root root 1048583 2月 18 13:09 blk_1073741826_1002.meta

-rw-r--r-- 1 root root 79874467 2月 18 13:09 blk_1073741827

-rw-r--r-- 1 root root 624027 2月 18 13:09 blk_1073741827_1003.meta

接下来我们把blk_1073741826和blk_1073741827尝试拼接起来,然后试一下能不能解压:

cat blk_1073741826 >> tmp.file

cat blk_1073741827 >> tmp.file

tar -zxvf tmp.file

操作后的文件列表是:

-rw-r--r-- 1 root root 23562 2月 18 12:53 blk_1073741825

-rw-r--r-- 1 root root 195 2月 18 12:53 blk_1073741825_1001.meta

-rw-r--r-- 1 root root 134217728 2月 18 13:09 blk_1073741826

-rw-r--r-- 1 root root 1048583 2月 18 13:09 blk_1073741826_1002.meta

-rw-r--r-- 1 root root 79874467 2月 18 13:09 blk_1073741827

-rw-r--r-- 1 root root 624027 2月 18 13:09 blk_1073741827_1003.meta

drwxr-xr-x 9 root root 4096 8月 18 2016 hadoop-2.7.3/ ----解压tmp.file后的文件

-rw-r--r-- 1 root root 214092195 2月 18 13:16 tmp.file

1.1.3.获取文件:hadoop fs -get /hadoop-2.7.3.tar.gz(完整文件)

1.1.4.删除文件:hadoop fs -rm /canglao.avi

1.1.5.从本地剪切粘贴到HDFS:hadoop fs -moveFromLocal /home/hadoop/a.txt /aaa/bbb

1.1.5.查看集群状态:hdfs dfsadmin -report

[root@shizhan3 subdir0]# hdfs dfsadmin -report

Configured Capacity: 55306051584 (51.51 GB)

Present Capacity: 23346880478 (21.74 GB)

DFS Remaining: 23346765824 (21.74 GB)

DFS Used: 114654 (111.97 KB)

DFS Used%: 0.00%

Under replicated blocks: 0

Blocks with corrupt replicas: 0

Missing blocks: 0 -------------------------------------------------

Live datanodes (3): Name: 192.168.232.208:50010 (192.168.232.208)

Hostname: shizhan6

Decommission Status : Normal

Configured Capacity: 18435350528 (17.17 GB)

DFS Used: 24576 (24 KB)

Non DFS Used: 10881404928 (10.13 GB)

DFS Remaining: 7553921024 (7.04 GB)

DFS Used%: 0.00%

DFS Remaining%: 40.98%

Configured Cache Capacity: 0 (0 B)

Cache Used: 0 (0 B)

Cache Remaining: 0 (0 B)

Cache Used%: 100.00%

Cache Remaining%: 0.00%

Xceivers: 1

Last contact: Sat Jun 16 16:44:28 CST 2018 Name: 192.168.232.205:50010 (shizhan3)

Hostname: shizhan3

Decommission Status : Normal

Configured Capacity: 18435350528 (17.17 GB)

DFS Used: 45039 (43.98 KB)

Non DFS Used: 10236620817 (9.53 GB)

DFS Remaining: 8198684672 (7.64 GB)

DFS Used%: 0.00%

DFS Remaining%: 44.47%

Configured Cache Capacity: 0 (0 B)

Cache Used: 0 (0 B)

Cache Remaining: 0 (0 B)

Cache Used%: 100.00%

Cache Remaining%: 0.00%

Xceivers: 1

Last contact: Sat Jun 16 16:44:27 CST 2018 Name: 192.168.232.207:50010 (shizhan5)

Hostname: shizhan5

Decommission Status : Normal

Configured Capacity: 18435350528 (17.17 GB)

DFS Used: 45039 (43.98 KB)

Non DFS Used: 10841145361 (10.10 GB)

DFS Remaining: 7594160128 (7.07 GB)

DFS Used%: 0.00%

DFS Remaining%: 41.19%

Configured Cache Capacity: 0 (0 B)

Cache Used: 0 (0 B)

Cache Remaining: 0 (0 B)

Cache Used%: 100.00%

Cache Remaining%: 0.00%

Xceivers: 1

Last contact: Sat Jun 16 16:44:26 CST 2018

可以看出,集群共有3个datanode可用

也可以打开web控制台查看HDFS集群信息:http://shizhan2:50070

Hadoop_04_Hadoop 的HDFS客户端shell命令的更多相关文章

- Hadoop HDFS的shell(命令行客户端)操作实例

HDFS的shell(命令行客户端)操作实例 3.2 常用命令参数介绍 -help 功能:输出这个命令参数手册 -ls 功能:显示目录信息 示例: hadoop fs ...

- HDFS 常用Shell命令

HDFS Shell命令 概述 HDFS Shell命令允许使用命令行在HDFS存储中进行文件夹和文件操作. 如文件夹的增删改查.文件的增删改查等. 开始练习hadoop时,打开Linux之后要用 s ...

- 009 HDFS的shell命令(里面有一个安全模式)

一:dfs的命令 1.所有的领命 2.解释 -appendToFile <localsrc> ... <dst> :追加文件 -checksum <src> . ...

- HDFS基本Shell命令

bin目录下: 1. hadoop fs 基本操作命令,类似linux shell 2. hadoop dfsadmin 管理命令 3. hadoop fsck (1. 检查hdfs中文件的健康 ...

- HDFS常用shell命令

注,其实常用命令不用网上搜,和linux下的命令很类似,触类旁通,直接在linux 上 hadoop fs 看一下就行了,不需要刻意去记我把 linux 上的 help 列举下,方便直接看吧,hdfs ...

- Hadoop 学习之路(六)—— HDFS 常用 Shell 命令

1. 显示当前目录结构 # 显示当前目录结构 hadoop fs -ls <path> # 递归显示当前目录结构 hadoop fs -ls -R <path> # 显示根目录 ...

- Hadoop 系列(六)—— HDFS 常用 Shell 命令

一.基本命令 打开 Hbase Shell: # hbase shell 1.1 获取帮助 # 获取帮助 help # 获取命令的详细信息 help 'status' 1.2 查看服务器状态 stat ...

- hadoop系列二:HDFS文件系统的命令及JAVA客户端API

转载请在页首明显处注明作者与出处 一:说明 此为大数据系列的一些博文,有空的话会陆续更新,包含大数据的一些内容,如hadoop,spark,storm,机器学习等. 当前使用的hadoop版本为2.6 ...

- Hadoop学习笔记(2)-HDFS的基本操作(Shell命令)

在这里我给大家继续分享一些关于HDFS分布式文件的经验哈,其中包括一些hdfs的基本的shell命令的操作,再加上hdfs java程序设计.在前面我已经写了关于如何去搭建hadoop这样一个大数据平 ...

随机推荐

- lumen返回网站base url

可以使用全局帮助函数url() echo url(); //输出http://test.domain.com

- Java数组(4):数组实用功能

Java标准类库的System.arraycopy()方法,及在java.utils.Arrays类中一套用于数组的static方法,都是操纵数组实用功能.下面分别介绍. (1) 数组的复制 (2) ...

- Java内部类(4):静态内部类&接口内部类

使用static修饰的内部类我们称之为静态内部类,不过我们更喜欢称之为嵌套内部类.静态内部类与非静态内部类之间存在一个最大的区别,我们知道非静态内部类在编译完成之后会隐含地保存着一个引用,该引用是指向 ...

- JS GZIP压缩

GZIP压缩,GZIP解压需要用到 pako.js 文件:下载地址:https://download.csdn.net/download/qq_35713752/10627338 使用方法: JS压缩 ...

- Unity小白文——单例的定义

当类继承与MonoBehaviour时 public class TestSingle : MonoBehaviour { public static TestSingle Instance; voi ...

- centos启动排障

centos6 启动引导第一阶段破坏 破坏mbr前446字节 先备份 [root@centos6 ~]# dd if=/dev/sda of=/root/mbr bs=1 count=446 破坏 [ ...

- ThinkPHP 使用 SwaggerUi 自动生成 api 文档

1.下载swagger-ui GitHub地址:https://github.com/swagger-api/swagger-ui 2.修改 ThinkPHP 的 build.php ,执行命令生成需 ...

- Mac下使用sshpass让iterm2支持多ssh登录信息保存

mac下没有xshell等连接linux服务器的工具,当需要管理的服务器越来越多之后,密码管理就成了一个很头疼的问题,每次都需要去复制粘贴密码,浪费了很多时间,在网上查了不少资料,发现mac下可以使用 ...

- PHP7 下安装 memcache 和 memcached 扩展

转载自:https://www.jianshu.com/p/c06051207f6e Memcached 是高性能的分布式内存缓存服务器,而PHP memcache 和 memcached 都是 Me ...

- luogu P4513 小白逛公园 (区间合并)

链接:https://www.luogu.org/problemnew/show/P4513 思路: 很基础的区间合并,开四个数组: num: 区间数字的和 lsum:从左端点起最大连续字段和 rsu ...