c#批量插入

一、创建一个用来测试的数据库和表

USE [Test]

GO

/****** Object: Table [dbo].[student] Script Date: 2019/4/11 15:38:59 ******/

SET ANSI_NULLS ON

GO

SET QUOTED_IDENTIFIER ON

GO

CREATE TABLE [dbo].[student](

[id] [int] IDENTITY(,) NOT NULL,

[name] [nvarchar]() NULL,

[age] [int] NULL,

[createDate] [datetime] NULL,

CONSTRAINT [PK_student] PRIMARY KEY CLUSTERED

(

[id] ASC

)WITH (PAD_INDEX = OFF, STATISTICS_NORECOMPUTE = OFF, IGNORE_DUP_KEY = OFF, ALLOW_ROW_LOCKS = ON, ALLOW_PAGE_LOCKS = ON) ON [PRIMARY]

) ON [PRIMARY] GO

方式1:一条一条插入,性能最差

INSERT INTO student(name,age,createDate) VALUES('苏拉自摸1',,'2018-4-11');

INSERT INTO student(name,age,createDate) VALUES('苏拉自摸2',2,'2018-4-11');

public void InsertOne()

{

Console.WriteLine("采用一条一条插入的方式实现");

Stopwatch sw = new Stopwatch(); using (SqlConnection conn = new SqlConnection(Conn)) //using中会自动Open和Close 连接。

{

string sql = "INSERT INTO student(name,age,createDate) VALUES(@a,@p,@d)";

conn.Open();

for (int i = ; i < ; i++)

{

using (SqlCommand cmd = new SqlCommand(sql, conn))

{

cmd.Parameters.AddWithValue("@a", "花拉子模" + i);

cmd.Parameters.AddWithValue("@p", i);

cmd.Parameters.AddWithValue("@d", DateTime.Now);

sw.Start();

cmd.ExecuteNonQuery();

Console.WriteLine(string.Format("插入{0}条记录,已耗时{1}毫秒",i, sw.ElapsedMilliseconds));

}

if (i == )

{

sw.Stop();

break;

}

}

}

Console.WriteLine(string.Format("插入{0}条记录,每{4}条的插入时间是{1}毫秒,预估总得插入时间是{2}毫秒,{3}分钟",

, sw.ElapsedMilliseconds, ((sw.ElapsedMilliseconds / ) * ), GetMinute((sw.ElapsedMilliseconds / * )), ));

}

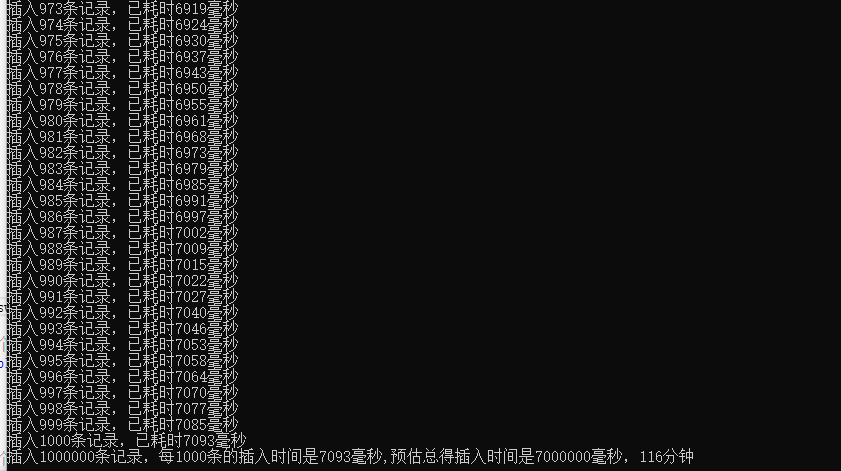

运行结果:

100w条记录,插完要俩小时了

方式2:使用sqlBulk

语法如下:

BULK INSERT [ [ 'database_name'.][ 'owner' ].]{ 'table_name' FROM 'data_file' }

WITH (

[ BATCHSIZE [ = batch_size ] ],

[ CHECK_CONSTRAINTS ],

[ CODEPAGE [ = 'ACP' | 'OEM' | 'RAW' | 'code_page' ] ],

[ DATAFILETYPE [ = 'char' | 'native'| 'widechar' | 'widenative' ] ],

[ FIELDTERMINATOR [ = 'field_terminator' ] ],

[ FIRSTROW [ = first_row ] ],

[ FIRE_TRIGGERS ],

[ FORMATFILE = 'format_file_path' ],

[ KEEPIDENTITY ],

[ KEEPNULLS ],

[ KILOBYTES_PER_BATCH [ = kilobytes_per_batch ] ],

[ LASTROW [ = last_row ] ],

[ MAXERRORS [ = max_errors ] ],

[ ORDER ( { column [ ASC | DESC ] } [ ,...n ] ) ],

[ ROWS_PER_BATCH [ = rows_per_batch ] ],

[ ROWTERMINATOR [ = 'row_terminator' ] ],

[ TABLOCK ],

)

相关参数说明:

BULK INSERT

[ database_name . [ schema_name ] . | schema_name . ] [ table_name | view_name ]

FROM 'data_file'

[ WITH

(

[ [ , ] BATCHSIZE = batch_size ] --BATCHSIZE指令来设置在单个事务中可以插入到表中的记录的数量

[ [ , ] CHECK_CONSTRAINTS ] --指定在大容量导入操作期间,必须检查所有对目标表或视图的约束。若没有 CHECK_CONSTRAINTS 选项,则所有 CHECK 和 FOREIGN KEY 约束都将被忽略,并且在此操作之后表的约束将标记为不可信。

[ [ , ] CODEPAGE = { 'ACP' | 'OEM' | 'RAW' | 'code_page' } ] --指定该数据文件中数据的代码页

[ [ , ] DATAFILETYPE =

{ 'char' | 'native'| 'widechar' | 'widenative' } ] --指定 BULK INSERT 使用指定的数据文件类型值执行导入操作。

[ [ , ] FIELDTERMINATOR = 'field_terminator' ] --标识分隔内容的符号

[ [ , ] FIRSTROW = first_row ] --指定要加载的第一行的行号。默认值是指定数据文件中的第一行

[ [ , ] FIRE_TRIGGERS ] --是否启动触发器

[ [ , ] FORMATFILE = 'format_file_path' ]

[ [ , ] KEEPIDENTITY ] --指定导入数据文件中的标识值用于标识列

[ [ , ] KEEPNULLS ] --指定在大容量导入操作期间空列应保留一个空值,而不插入用于列的任何默认值

[ [ , ] KILOBYTES_PER_BATCH = kilobytes_per_batch ]

[ [ , ] LASTROW = last_row ] --指定要加载的最后一行的行号

[ [ , ] MAXERRORS = max_errors ] --指定允许在数据中出现的最多语法错误数,超过该数量后将取消大容量导入操作。

[ [ , ] ORDER ( { column [ ASC | DESC ] } [ ,...n ] ) ] --指定数据文件中的数据如何排序

[ [ , ] ROWS_PER_BATCH = rows_per_batch ]

[ [ , ] ROWTERMINATOR = 'row_terminator' ] --标识分隔行的符号

[ [ , ] TABLOCK ] --指定为大容量导入操作持续时间获取一个表级锁

[ [ , ] ERRORFILE = 'file_name' ] --指定用于收集格式有误且不能转换为 OLE DB 行集的行的文件。

)]

代码:

public void InsertTwo()

{

Console.WriteLine("使用Bulk插入的实现方式");

Stopwatch sw = new Stopwatch();

DataTable dt = GetTableSchema(); using (SqlConnection conn = new SqlConnection(Conn))

{

SqlBulkCopy bulkCopy = new SqlBulkCopy(conn);

bulkCopy.DestinationTableName = "student";

bulkCopy.BatchSize = dt.Rows.Count;

conn.Open();

sw.Start(); for (int i = ; i < ; i++)

{

DataRow dr = dt.NewRow();

dr["name"] = "蔑儿乞人" + i;

dr["age"] = i;

dr["createDate"] = DateTime.Now.ToString("yyyy-MM-dd HH:mm:ss");

dt.Rows.Add(dr);

}

if (dt != null && dt.Rows.Count != )

{

bulkCopy.WriteToServer(dt);

sw.Stop();

}

Console.WriteLine(string.Format("插入{0}条记录共花费{1}毫秒,{2}分钟", , sw.ElapsedMilliseconds, GetMinute(sw.ElapsedMilliseconds)));

}

}

public DataTable GetTableSchema()

{

DataTable dt = new DataTable();

dt.Columns.AddRange(

new DataColumn[] {

new DataColumn("name",typeof(string)),

new DataColumn("age",typeof(int)),

new DataColumn("createDate",typeof(DateTime ))});

return dt;

}

方式3:insert into

INSERT INTO student(name,age,createDate)

SELECT '托多1','2019-4-11',

UNION ALL

SELECT '托多2','2019-4-11',

UNION ALL

......

四、拼接sql

INSERT INTO student(name,age,createDate)VALUES

('牛栏1段',160,'2019-4-11')

,('牛栏2段',260,'2019-4-11')

......

c#批量插入的更多相关文章

- MyBatis魔法堂:Insert操作详解(返回主键、批量插入)

一.前言 数据库操作怎能少了INSERT操作呢?下面记录MyBatis关于INSERT操作的笔记,以便日后查阅. 二. insert元素 属性详解 其属性如下: parameterType ...

- C#批量插入数据到Sqlserver中的四种方式

我的新书ASP.NET MVC企业级实战预计明年2月份出版,感谢大家关注! 本篇,我将来讲解一下在Sqlserver中批量插入数据. 先创建一个用来测试的数据库和表,为了让插入数据更快,表中主键采用的 ...

- [小干货]SqlBulkCopy简单封装,让批量插入更方便

关于 SqlServer 批量插入的方式,前段时间也有大神给出了好几种批量插入的方式及对比测试(http://www.cnblogs.com/jiekzou/p/6145550.html),估计大家也 ...

- Mysql 如何批量插入百万行测试数据

Mysql 如何批量插入百万行测试数据

- mybits批量插入

<!--批量插入--> <insert id="batchSave" parameterType="java.util.List"> i ...

- C# 数据批量插入到数据库SqlBulkCopy(源数据类型:List<T> Or DataTable)

/*_____________________ List<T>类型数据 To Sql_______________________________*/ /// <summary& ...

- mybatis Oracle 批量插入,批量更新

传入的参数只要是list类型的参数就行了..............1.批量插入<insert id="insertBatch" parameterType="ja ...

- Entity Framework与ADO.NET批量插入数据性能测试

Entity Framework是.NET平台下的一种简单易用的ORM框架,它既便于Domain Model和持久层的OO设计,也提高了代码的可维护性.但在使用中发现,有几类业务场景是EF不太擅长的, ...

- .Net批量插入数据到SQLServer数据库,System.Data.SqlClient.SqlBulkCopy类批量插入大数据到数据库

批量的的数据导入数据库中,尽量少的访问数据库,高性能的对数据库进行存储. 采用SqlBulkCopy来处理存储数据.SqlBulkCopy存储大批量的数据非常的高效,将内存中的数据表直接的一次性的存储 ...

- .Net中DataAdapter批量插入和更新数据总结

前言 前段时间一直在忙着项目上线,在做项目的同时遇到了一些之前不曾碰到的问题,因为没有经验,只能从网上找一些相关的解决方案,但是网上提供的资料实在是太杂,有的根本不能用,耗时又耗力. 我希望把我这段时 ...

随机推荐

- 用Nginx代理请求,处理前后端跨域

自从前端spa框架出现后,都是前后端分离开发了.我们在开发的时候难免会遇到跨域的问题.跨域这种问题解决的方法基本都是在服务端实现的.以java为例,我知道的有3种方法处理跨域: 1.使用 @Cross ...

- Spark 计算人员三度关系

1.一度人脉:双方直接是好友 2.二度人脉:双方有一个以上共同的好友,这时朋友网可以计算出你们有几个共同的好友并且呈现数字给你.你们的关系是: 你->朋友->陌生人 3.三度人脉:即你朋友 ...

- CSS3弹性盒模型flexbox布局

属性介绍 display: flex | inline-flex; (适用于父类容器元素上) 定义一个flex容器,内联或者根据指定的值,来作用于下面的子类容器.· box:将对象作为弹性伸缩盒显示. ...

- poj 3468 : A Simple Problem with Integers 【线段树 区间修改】

题目链接 题目是对一个数组,支持两种操作 操作C:对下标从a到b的每个元素,值增加c: 操作Q:对求下标从a到b的元素值之和. #include<cstdio> #include<c ...

- 2019最新create-react-app创建的react中使用sass/scss,以及在react中使用sass/scss公共变量的方法

Sass(英文全称:Syntactically Awesome Stylesheets)是一个最初由Hampton Catlin设计并由Natalie Weizenbaum开发的层叠样式表语言.Sas ...

- 在idea中把springboot项目打成jar包遇到的问题(没有主清单属性)

正确的姿势:<plugin> <groupId>org.springframework.boot</groupId> <artifactId>sprin ...

- 第四周作业—N42-虚怀若谷

一.统计出/etc/passwd文件中其默认shell为非/sbin/nologin的用户个数,并将用户都显示出来 [root@centos7 ~]# grep -v "/sbin/nolo ...

- 使用linkedlist封装简单的先进先出队列

创建一个类Queue代表队列(先进先出),添加add(Object obj) 及get()方法, 并添加main()方法进行验证 思路: 使用LinkedList实现队列,在向LinkedList中添 ...

- CKEDITOR无缝粘贴word

由于工作需要必须将word文档内容粘贴到编辑器中使用 但发现word中的图片粘贴后变成了file:///xxxx.jpg这种内容,如果上传到服务器后其他人也访问不了,网上找了很多编辑器发现没有一个能直 ...

- CF576D Flights for Regular Customers 矩阵乘法 + Bitset优化

%%%cxhscst2's blog Codeforces 576D Flights for Regular Customers(矩阵加速DP) 代码非常优美 + 简洁,学习到了 Code: #inc ...