多层全连接神经网络实现minist手写数字分类

import torch

import numpy as np

import torch.nn as nn

from torch.autograd import Variable

import torch.optim as optim

from torch.utils.data import DataLoader

from torchvision import datasets, transforms

batch_size = 64

learning_rate = 1e-2

num_epoches = 20

data_tf = transforms.Compose([transforms.ToTensor(), transforms.Normalize([0.5],[0.5])])

#transform.Compose() 将各种预处理操作组合在一起

#transform.ToTensor() 将数据转化为Tensor类型,并自动标准化,Tensor的取值是(0,1)

#transform.Normalize()是标准化操作,类似正太分布的标准化,第一个值是均值,第二个值是方差

#如果图像是三个通道,则transform.Normalize([a,b,c],[d,e,f])

train_dataset = datasets.MNIST(root = './mnist_data', train = True, transform = data_tf, download = True) #用datasets加载数据集,传入预处理

test_dataset = datasets.MNIST(root = './mnist_data', train = False,transform = data_tf)

train_loader = DataLoader(train_dataset, batch_size = batch_size, shuffle = True) #利用DataLoader建立一个数据迭代器

test_loader = DataLoader(test_dataset, batch_size = batch_size, shuffle = False)

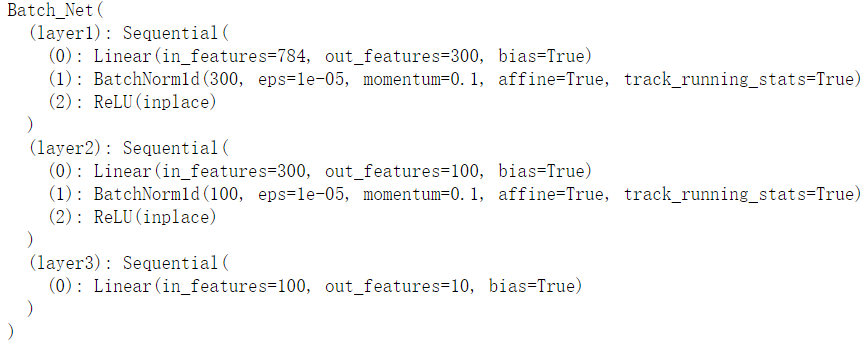

class Batch_Net(nn.Module):

def __init__(self, inputdim, hidden1, hidden2, outputdim):

super(Batch_Net, self).__init__()

self.layer1 = nn.Sequential(nn.Linear(inputdim, hidden1), nn.BatchNorm1d(hidden1), nn.ReLU(True))

self.layer2 = nn.Sequential(nn.Linear(hidden1, hidden2), nn.BatchNorm1d(hidden2), nn.ReLU(True))

self.layer3 = nn.Sequential(nn.Linear(hidden2, outputdim)) def forward(self, x):

x = self.layer1(x)

x = self.layer2(x)

x = self.layer3(x)

return x

model = Batch_Net(28*28, 300, 100, 10)

model

定义损失函数和优化器

criterion = nn.CrossEntropyLoss()

optimizer = optim.SGD(model.parameters(), lr = learning_rate)

训练模型

for epoch in range(num_epoches):

train_loss = 0

train_acc = 0

model.train() #这句话会自动调整batch_normalize和dropout值,很关键!

for img, label in train_loader:

img = img.view(img.size(0), -1) #将数据扁平化为一维

img = Variable(img)

label = Variable(label)

# 前向传播

out = model(img)

loss = criterion(out, label)

# 反向传播

optimizer.zero_grad()

loss.backward()

optimizer.step()

# 记录误差

train_loss += loss.item()

# 计算分类的准确率

_, pred = out.max(1)

num_correct = (pred == label).sum().item()

acc = num_correct / img.shape[0]

train_acc += acc print('epoch:{},train_loss:{:.6f},acc:{:.6f}'.format(epoch+1, train_loss/len(train_loader), train_acc/len(train_loader)))

epoch:1,train_loss:0.002079,acc:0.999767

......

epoch:19,train_loss:0.001532,acc:0.999917

epoch:20,train_loss:0.001670,acc:0.999850

测试集

model.eval() #在评估模型时使用,固定BN 和 Dropout

eval_loss = 0

val_acc = 0

for img , label in test_loader:

img = img.view(img.size(0), -1)

img = Variable(img, volatile = True) #volatile=TRUE表示前向传播是不会保留缓存,因为测试集不需要反向传播

label = Variable(label, volatile = True)

out = model(img)

loss = criterion(out, label)

eval_loss += loss.item()

_,pred = torch.max(out, 1)

num_correct = (pred == label).sum().item()

print(num_correct)

eval_acc = num_correct / label.shape[0]

val_acc += eval_acc print('Test Loss:{:.6f}, Acc:{:.6f}'.format(eval_loss/len(test_loader), val_acc/len(test_loader)))

Test Loss:0.062413, Acc:0.981091

多层全连接神经网络实现minist手写数字分类的更多相关文章

- keras与卷积神经网络(CNN)实现识别minist手写数字

在本篇博文当中,笔者采用了卷积神经网络来对手写数字进行识别,采用的神经网络的结构是:输入图片——卷积层——池化层——卷积层——池化层——卷积层——池化层——Flatten层——全连接层(64个神经元) ...

- Tensorflow 多层全连接神经网络

本节涉及: 身份证问题 单层网络的模型 多层全连接神经网络 激活函数 tanh 身份证问题新模型的代码实现 模型的优化 一.身份证问题 身份证号码是18位的数字[此处暂不考虑字母的情况],身份证倒数第 ...

- python手写神经网络实现识别手写数字

写在开头:这个实验和matlab手写神经网络实现识别手写数字一样. 实验说明 一直想自己写一个神经网络来实现手写数字的识别,而不是套用别人的框架.恰巧前几天,有幸从同学那拿到5000张已经贴好标签的手 ...

- matlab手写神经网络实现识别手写数字

实验说明 一直想自己写一个神经网络来实现手写数字的识别,而不是套用别人的框架.恰巧前几天,有幸从同学那拿到5000张已经贴好标签的手写数字图片,于是我就尝试用matlab写一个网络. 实验数据:500 ...

- MNIST手写数字分类simple版(03-2)

simple版本nn模型 训练手写数字处理 MNIST_data数据 百度网盘链接:https://pan.baidu.com/s/19lhmrts-vz0-w5wv2A97gg 提取码:cgnx ...

- Tensorflow-线性回归与手写数字分类

线性回归 步骤 构造线性回归数据 定义输入层 设计神经网络中间层 定义神经网络输出层 计算二次代价函数,构建梯度下降 进行训练,获取预测值 画图展示 代码 import tensorflow as t ...

- 使用神经网络来识别手写数字【译】(三)- 用Python代码实现

实现我们分类数字的网络 好,让我们使用随机梯度下降和 MNIST训练数据来写一个程序来学习怎样识别手写数字. 我们用Python (2.7) 来实现.只有 74 行代码!我们需要的第一个东西是 MNI ...

- Pytorch1.0入门实战一:LeNet神经网络实现 MNIST手写数字识别

记得第一次接触手写数字识别数据集还在学习TensorFlow,各种sess.run(),头都绕晕了.自从接触pytorch以来,一直想写点什么.曾经在2017年5月,Andrej Karpathy发表 ...

- C#中调用Matlab人工神经网络算法实现手写数字识别

手写数字识别实现 设计技术参数:通过由数字构成的图像,自动实现几个不同数字的识别,设计识别方法,有较高的识别率 关键字:二值化 投影 矩阵 目标定位 Matlab 手写数字图像识别简介: 手写 ...

随机推荐

- jQuery中outerWidth()方法

截图自:菜鸟教程https://www.runoob.com/jquery/html-outerwidth.html

- Apple历史应用以及开发工具版本(Xcode官方历史版本等等)

1.Xcode 官方历史版本下载:(需要登录开发者账号) https://developer.apple.com/download/more/

- Spring Boot自定义Redis缓存配置,保存value格式JSON字符串

Spring Boot自定义Redis缓存,保存格式JSON字符串 部分内容转自 https://blog.csdn.net/caojidasabi/article/details/83059642 ...

- [PyQt5]动态显示matplotlib作图(一)

完整实例 import sys from PyQt5.QtWidgets import QApplication, QMainWindow, QMenu, QVBoxLayout, QSizePoli ...

- [转载]一个支持Verilog的Vim插件——AutoDef

原文地址:一个支持Verilog的Vim插件--AutoDef作者:hover 支持一下四种类型的变量声明: 1)时序always块中的寄存器变量reg 2)组合always块中的组合reg变量reg ...

- 【原】iptables 交叉编译

防火墙在做数据包过滤决定时,有一套遵循和组成的规则,这些规则存储在专用的数据包过滤表中,而这些表集成在 Linux 内核中.在数据包过滤表中,规则被分组放在我们所谓的链(chain)中.而netfil ...

- 校内题目T2691 桶哥的问题——送桶

这是一道校内题目,但迷路的蒟蒻们同样被欢迎来此学习QWQ 题目描述: 题目背景 @桶哥本校——皎月pks大佬OrzOrz 买完了桶,桶哥要去送桶. 题目描述 桶哥买了nn个桶, 他要将这些桶送去nn个 ...

- ubuntu 16.04 安装Opencv-3.2.0_GPU 与 opencv_contrib-3.2.0

1.准备依赖库 sudo apt-get install build-essential sudo apt-get install cmake git libgtk2.0-dev pkg-config ...

- 拯救诺基亚X6

现象:充电不稳,冲不进去电,后来直接黑屏了. 维修方式:更换手机尾插.或者更换整个尾插小板. 手机主板应该没有问题,这是本人某友的手机,据了解磕碰进水等问题.先前先后因为此问题找手机店,维修过两次,费 ...

- jQuery $.ajax传递数组的traditional参数传递必须true 对象的序列化

数组类型参数传递: 若一个请求中包含多个值,如:(test.action?tid=1&tid=2&tid=3),参数都是同一个,只是指定多个值,这样请求时后台会发生解析错误,应先使用 ...