kafka+storm 单机运行

环境:

1、kafka+zookeeper

2、window平台

3、eclipse

设置:

1、kafka和zookeeper安装,另一篇有介绍(https://www.cnblogs.com/51python/p/10870258.html)

2、eclipse代码(建立maven工程)

pom.xml

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion> <groupId>hadoop</groupId>

<artifactId>eclipseandmaven</artifactId>

<version>0.0.1-SNAPSHOT</version>

<packaging>jar</packaging> <name>eclipseandmaven</name>

<url>http://maven.apache.org</url> <properties>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

</properties>

<dependencies> <dependency>

<groupId>org.apache.storm</groupId>

<artifactId>storm-kafka-client</artifactId>

<version>1.1.1</version>

</dependency>

<dependency>

<groupId>org.apache.kafka</groupId>

<artifactId>kafka-clients</artifactId>

<version>0.10.0.0</version>

</dependency>

<dependency>

<groupId>org.apache.storm</groupId>

<artifactId>storm-core</artifactId>

<version>1.1.1</version>

<!-- 本地测试注释集群运行打开 -->

<!-- <scope>provided</scope>-->

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>3.8.1</version>

<scope>test</scope>

</dependency>

</dependencies>

</project>

主函数

import org.apache.storm.Config;

import org.apache.storm.LocalCluster;

import org.apache.storm.StormSubmitter;

import org.apache.storm.kafka.spout.KafkaSpout;

import org.apache.storm.kafka.spout.KafkaSpoutConfig;

import org.apache.storm.topology.TopologyBuilder; public class MainTopology {

public static void main(String[] args) throws Exception {

TopologyBuilder builder = new TopologyBuilder();

KafkaSpoutConfig.Builder<String, String> kafkaBuilder = KafkaSpoutConfig.builder("127.0.0.1:9092", "test0811");

// .builder("127.0.0.1:9092,node-2:9092,node-3:9092", "test0811");

// 设置kafka属于哪个组

kafkaBuilder.setGroupId("testgroup");

// 创建kafkaspoutConfig

KafkaSpoutConfig<String, String> build = kafkaBuilder.build();

// 通过kafkaspoutConfig获得kafkaspout

KafkaSpout<String, String> kafkaSpout = new KafkaSpout<String, String>(build);

// 设置5个线程接收数据

builder.setSpout("kafkaSpout", kafkaSpout, 5);

// 设置2个线程处理数据

builder.setBolt("printBolt", new PrintBolt(), 2).localOrShuffleGrouping("kafkaSpout");

Config config = new Config();

if (args.length > 0) {

// 集群提交模式

config.setDebug(false);

StormSubmitter.submitTopology(args[0], config, builder.createTopology());

} else {

// 本地测试模式

config.setDebug(true);

// 设置2个进程

config.setNumWorkers(2);

LocalCluster cluster = new LocalCluster();

cluster.submitTopology("kafkaSpout", config, builder.createTopology());

}

}

}

storm输出

import org.apache.storm.topology.BasicOutputCollector;

import org.apache.storm.topology.OutputFieldsDeclarer;

import org.apache.storm.topology.base.BaseBasicBolt;

import org.apache.storm.tuple.Tuple; public class PrintBolt extends BaseBasicBolt {

/**

* execute会被storm一直调用

*

* @param tuple

* @param basicOutputCollector

*/

public void execute(Tuple tuple, BasicOutputCollector basicOutputCollector) {

// 为了便于查看消息用err标红

System.err.println(tuple.getValue(4));

System.err.println(tuple.getValues());

} public void declareOutputFields(OutputFieldsDeclarer outputFieldsDeclarer) { }

}

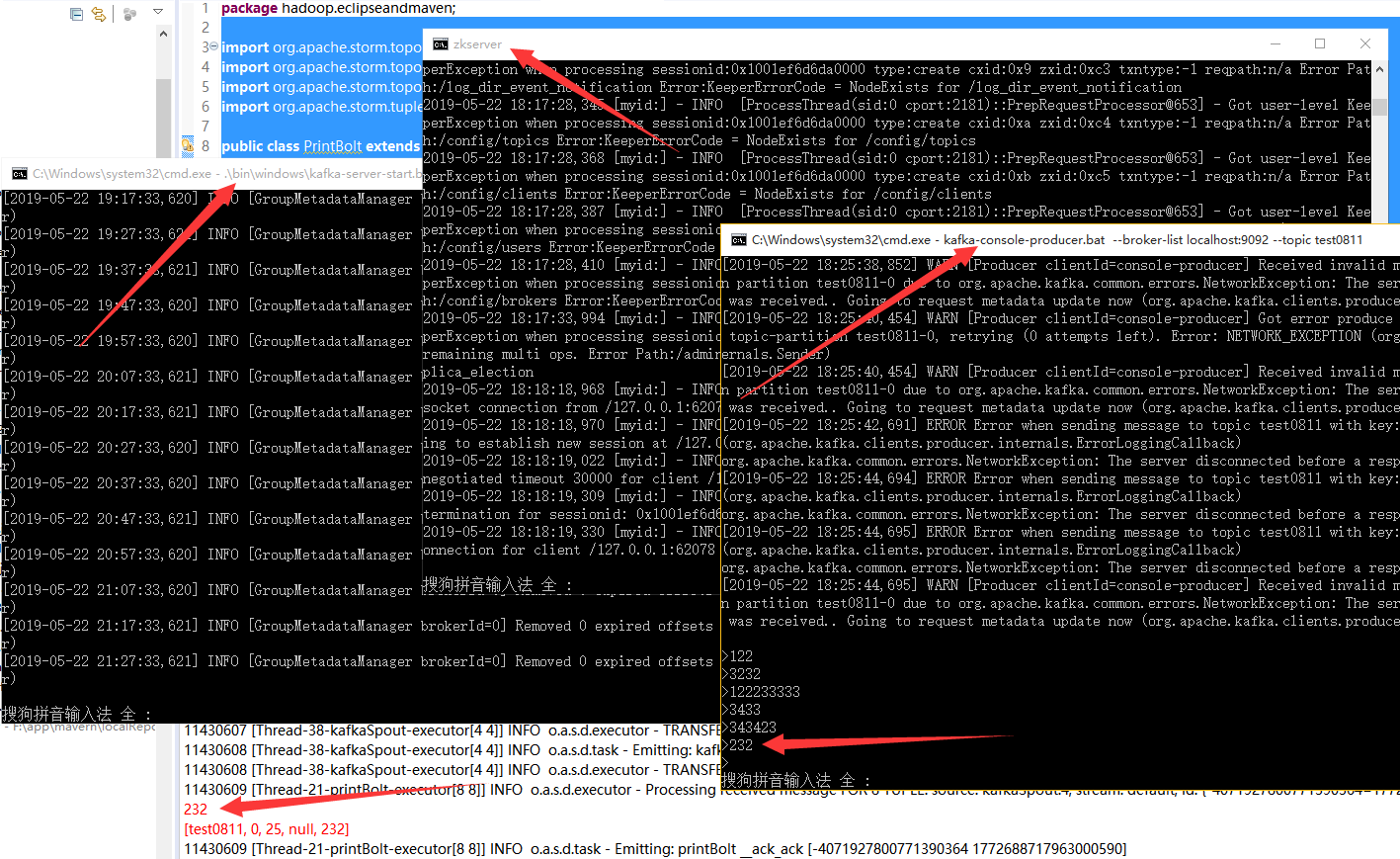

3、运行

1)启动zookeeper

zkserver

2)启动kafka服务(在D:\bigdata\kafka_2.11-0.9.0.1安装目录打开cmd)

.\bin\windows\kafka-server-start.bat .\config\server.properties

3)创建主题(在D:\bigdata\kafka_2.11-0.9.0.1\bin\windows安装目录打开cmd)

kafka-topics.bat --create --zookeeper localhost:2181 --replication-factor 1 --partitions 1 --topic test0811

4)创建生产者(在D:\bigdata\kafka_2.11-0.9.0.1\bin\windows安装目录打开cmd)

kafka-console-producer.bat --broker-list localhost:9092 --topic test0811

5)启动主函数

运行eclipse主函数

结果:

在4中的cmd窗口输入字符串,会在eclipse中收到。

这是单机版,后面会做多机通信,敬请期待!

参考:https://blog.csdn.net/qq_41455420/article/details/79385566

kafka+storm 单机运行的更多相关文章

- storm单机运行与集群运行问题

使用trident接口时,storm读取kafka数据会将kafka消费记录保存起来,将消费记录的位置保存在tridentTopology.newStream()的第一个参数里, 如果设置成从头开始消 ...

- storm单机运行报错 ERROR backtype.storm.daemon.executor -

单机本地运行storm报错: 错误如下: java.lang.NullPointerException: null at test2.Spot2.nextTuple(Spot2.java:) ~[cl ...

- flume+kafka+storm单机部署

flume-1.6.0 kafka0.9.0.0 storm0.9.6 一.部署flume 1.解压 tar -xzvf apache-flume-1.6.0-bin.tar.gz -C ../app ...

- 简单测试flume+kafka+storm的集成

集成 Flume/kafka/storm 是为了收集日志文件而引入的方法,最终将日志转到storm中进行分析.storm的分析方法见后面文章,这里只讨论集成方法. 以下为具体步骤及测试方法: 1.分别 ...

- storm单机环境部署

前面说过storm集群的部署,这篇主要介绍storm单机环境部署,其实他们之间很类似,就是将之前配置文件中所有的集群条目改成本机的地址即可,部署之前应该按前面solr和zookeeper单机环境部署那 ...

- Kafka+Storm+HDFS整合实践

在基于Hadoop平台的很多应用场景中,我们需要对数据进行离线和实时分析,离线分析可以很容易地借助于Hive来实现统计分析,但是对于实时的需求Hive就不合适了.实时应用场景可以使用Storm,它是一 ...

- Flume-ng+Kafka+storm的学习笔记

Flume-ng Flume是一个分布式.可靠.和高可用的海量日志采集.聚合和传输的系统. Flume的文档可以看http://flume.apache.org/FlumeUserGuide.html ...

- Zookeeper+Kafka+Storm+HDFS实践

Kafka是一种高吞吐量的分布式发布订阅消息系统,它可以处理消费者规模的网站中的所有动作流数据. Hadoop一般用在离线的分析计算中,而storm区别于hadoop,用在实时的流式计算中,被广泛用来 ...

- [转载] Kafka+Storm+HDFS整合实践

转载自http://www.tuicool.com/articles/NzyqAn 在基于Hadoop平台的很多应用场景中,我们需要对数据进行离线和实时分析,离线分析可以很容易地借助于Hive来实现统 ...

随机推荐

- HttpWebRequest 知识点

string Url = System.Configuration.ConfigurationManager.AppSettings["CallPaperInvoiceURL"]; ...

- Yearning + Inception SQL审核平台搭建

Yearning 安装: 安装Nginxyum install nginx -y 按照顺序安装MySQLmysql-community-common-5.7.22-1.el6.x86_64.rpmmy ...

- SQL Server之十大存储过程

下面介绍十大不同类型存储过程. 用户自定义存储过程 . 创建语法 create proc | procedure pro_name [{@参数数据类型} [=默认值] [output], {@参数数据 ...

- (转)C#开发微信门户及应用(6)--微信门户菜单的管理操作

http://www.cnblogs.com/wuhuacong/p/3701961.html 前面几篇继续了我自己对于C#开发微信门户及应用的技术探索和相关的经验总结,继续探索微信API并分享相关的 ...

- Jmeter JSON断言和响应断言的区别是什么?

假设响应数据是{"code":0,"datas":{"informationStatus":1}} 响应断言:"code" ...

- python tips:作用域与名字空间

Python具有静态作用域,变量的作用域由它定义的位置决定,而与调用的位置无关. a = 2 def f(): a = 2 第一行的a的作用域是全局作用域,作用于定义位置后面的所有位置. 第四行的a的 ...

- 【转载】intellij idea如何将web项目打成war包

1.点击[File]->[Project Structure]菜单(或使用Shift+Ctrl+Alt+S快捷键),打开[Project Structure]窗口.如下图: 2.在[Projec ...

- eas之单据转换规则

/** * BOTP单据转换 * @param botpNum 转换规则编号 * @param BillInfo 原单据 */ public static void BOTP(String b ...

- Mybatis配置之别名配置元素详述

这里我们贴出之前的UserDao对应的mapper文件,如下所示 从这个配置文件中,我们可以看到<select>.<insert>和<update>三个标签元素的r ...

- 09.正则表达式re-2.complie函数

compile 函数用于编译正则表达式,生成一个 Pattern 对象,它的一般使用形式如下: import re # 将正则表达式编译成 Pattern 对象 pattern = re.compil ...