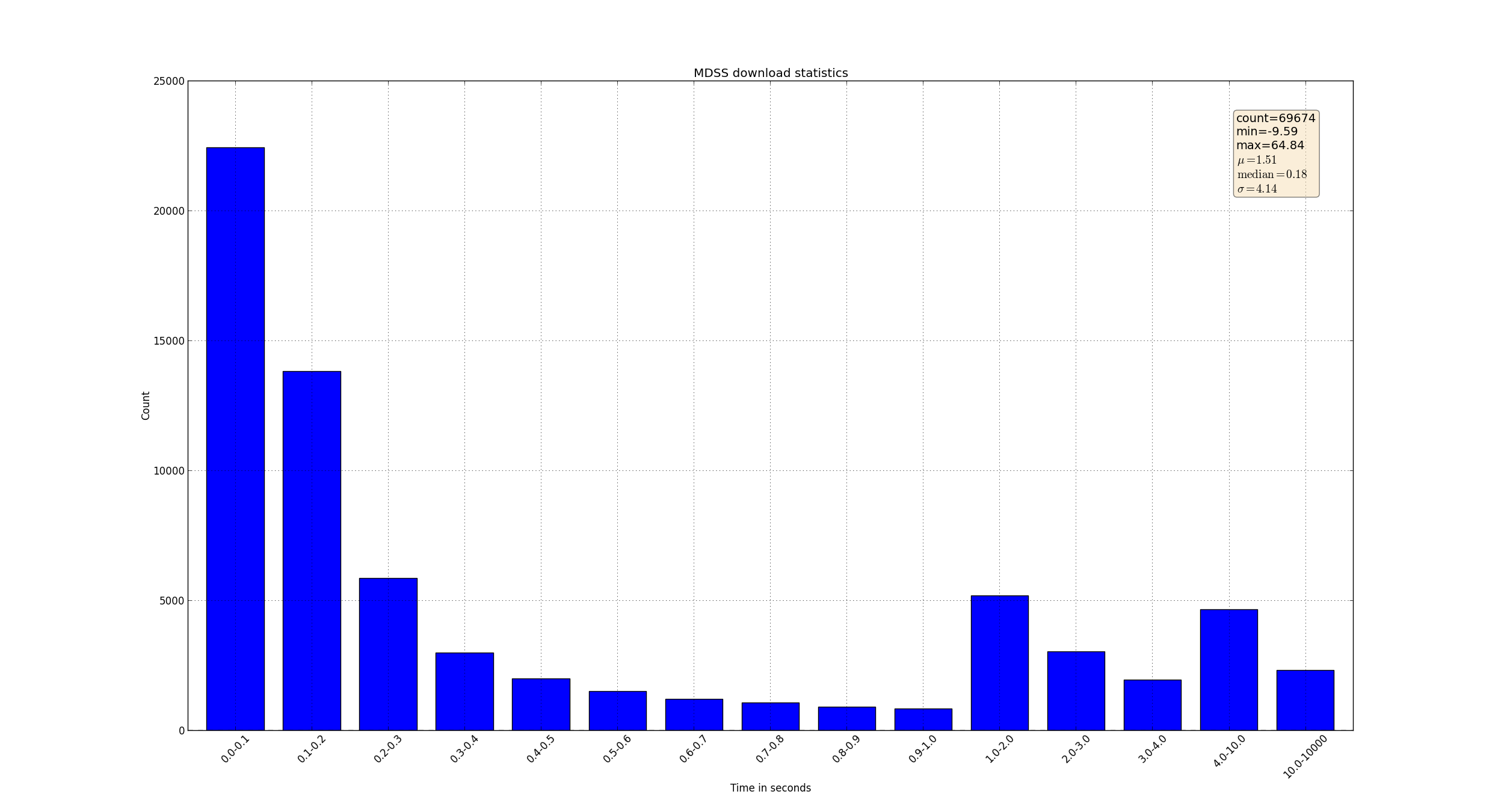

使用pandas处理数据并绘图的例子

import sys

import os

import re

import datetime

import csv def get_datetime(record):

request_time = ""

p = re.compile(r"(?P<time>\d{4}-\d{2}-\d{2} \d{2}:\d{2}:\d{2},\d+)")

# p = re.compile(r"(?P<time>[\d.]+)ms")

m = p.search(record)

if m:

request_time = m.group("time")

dt = datetime.datetime.strptime(request_time, '%Y-%m-%d %H:%M:%S,%f')

return dt def parse(log_file_name, result_csv_name):

start = 0

end = 0

start_time = ''

end_time = ''

md5crc32 = ''

csv_writer = csv.writer(open(result_csv_name, 'wb'),

delimiter = ',')

with open(log_file_name, 'rb') as log_file:

for i, line in enumerate(log_file):

line = line.strip()

if 'folderProcessing() INFO download from' in line:

start = i

start_time = get_datetime(line)

elif 'DownLoadFile() INFO download to' in line:

end = i

end_time = get_datetime(line)

# got one download action

if end - start == 1:

# parse hash

md5crc32 = line.rsplit('/', 1)[1]

print md5crc32, (end_time - start_time).total_seconds()

csv_writer.writerow((md5crc32, (end_time - start_time).total_seconds()))

# assert False def do_statistics(file_name):

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

df = pd.read_csv(file_name, header = None, names= ['hash', 'time'], dtype = {'time': np.float64},

# nrows = 10000

)

time_series = df.time

print time_series.describe()

plt.figure()

# fig = time_series.hist().get_figure()

# define range

ranges = (0.0, 0.1, 0.2, 0.3, 0.4, 0.5, 0.6, 0.7, 0.8, 0.9, 1.0, 2.0, 3.0, 4.0, 10.0, 10000)

bins = zip(ranges[:-1], ranges[1:])

labels = ['%s-%s'%(begin, end) for i ,(begin, end) in enumerate(bins) ]

print labels

#print bins

#fig = time_series.plot(kind='bar', xticks = ranges)

results = [0] * len(bins)

for i in time_series:

for j , (begin, end) in enumerate(bins):

if i > begin and i <= end:

results[j] += 1

print results mu = time_series.mean()

median = np.median(time_series)

sigma = time_series.std() ax = pd.Series(results).plot(kind='bar', logy = True, figsize=(25, 13.5))

# dpi = ax.figure.get_dpi()

# print 'dpi = ', dpi

# plt.gcf().set_size_inches(25, 13.5) ax.set_ylabel('Count')

ax.set_xlabel('Time in seconds')

# print dir(fig)

ax.set_xticklabels(labels, rotation = 45)

ax.set_title('MDSS download statistics') textstr = 'count=%s\nmin=%.2f\nmax=%.2f\n$\mu=%.2f$\n$\mathrm{median}=%.2f$\n$\sigma=%.2f$'%(time_series.count(),time_series.min(), time_series.max(),mu, median, sigma) # these are matplotlib.patch.Patch properties

props = dict(boxstyle='round', facecolor='wheat', alpha=0.5) # place a text box in upper right in axes coords

ax.text(0.90, 0.95, textstr, transform=ax.transAxes, fontsize=14,

verticalalignment='top', bbox=props) ax.figure.show()

#

ax.figure.set_size_inches(25, 13.5, forward = True)

print ax.figure.get_size_inches()

ax.figure.savefig('result.png', format='png',)

input('asdfasd') if __name__ == "__main__":

# print get_datetime("2014-10-23 09:19:34,251 pid=27850")

# parse('inpri_p_antiy.log', 'result.csv')

do_statistics('result.csv')

生成图像如下:

使用pandas处理数据并绘图的例子的更多相关文章

- 利用Python进行数据分析(12) pandas基础: 数据合并

pandas 提供了三种主要方法可以对数据进行合并: pandas.merge()方法:数据库风格的合并: pandas.concat()方法:轴向连接,即沿着一条轴将多个对象堆叠到一起: 实例方法c ...

- 【转载】使用Pandas对数据进行筛选和排序

使用Pandas对数据进行筛选和排序 本文转载自:蓝鲸的网站分析笔记 原文链接:使用Pandas对数据进行筛选和排序 目录: sort() 对单列数据进行排序 对多列数据进行排序 获取金额最小前10项 ...

- 【转载】使用Pandas进行数据提取

使用Pandas进行数据提取 本文转载自:蓝鲸的网站分析笔记 原文链接:使用python进行数据提取 目录 set_index() ix 按行提取信息 按列提取信息 按行与列提取信息 提取特定日期的信 ...

- 【转载】使用Pandas进行数据匹配

使用Pandas进行数据匹配 本文转载自:蓝鲸的网站分析笔记 原文链接:使用Pandas进行数据匹配 目录 merge()介绍 inner模式匹配 lefg模式匹配 right模式匹配 outer模式 ...

- 【转载】使用Pandas创建数据透视表

使用Pandas创建数据透视表 本文转载自:蓝鲸的网站分析笔记 原文链接:使用Pandas创建数据透视表 目录 pandas.pivot_table() 创建简单的数据透视表 增加一个行维度(inde ...

- Pandas 把数据写入csv

Pandas 把数据写入csv from sklearn import datasets import pandas as pd iris = datasets.load_iris() iris_X ...

- pandas学习(数据分组与分组运算、离散化处理、数据合并)

pandas学习(数据分组与分组运算.离散化处理.数据合并) 目录 数据分组与分组运算 离散化处理 数据合并 数据分组与分组运算 GroupBy技术:实现数据的分组,和分组运算,作用类似于数据透视表 ...

- Pandas DataFrame数据的增、删、改、查

Pandas DataFrame数据的增.删.改.查 https://blog.csdn.net/zhangchuang601/article/details/79583551 #删除列 df_2 = ...

- pandas 选取数据 修改数据 loc iloc []

pandas选取数据可以通过 loc iloc [] 来选取 使用loc选取某几列: user_fans_df = sample_data.loc[:,['uid','fans_count']] 使 ...

随机推荐

- JavaScipt 源码解析 回调函数

函数是第一类对象,这是javascript中的一个重要的概念,意味着函数可以像对象一样按照第一类管理被使用,所以在javascript中的函数: 能"存储"在变量中,能作为函数的实 ...

- 基于双向链表的增删改查和排序(C++实现)

双向链表也叫双链表,是链表的一种,它的每个数据结点中都有两个指针,分别指向直接后继和直接前驱.所以,从双向链表中的任意一个结点开始,都可以很方便地访问它的前驱结点和后继结点.一般我们都构造双向循环链表 ...

- DOM创建和删除节点、HTML DOM常用对象[转]

创建和删除节点:——核心DOM 1. 创建单个元素节点:3步: 1. 创建空元素节点对象: var elem=document.createElement("标 ...

- git push (第一次) (转)

原地址 http://blog.csdn.net/kazeik/article/details/9113891 下图是github在创建仓库后给的提示:按它一步步操作下去就可以了. 下图是在git命 ...

- Node.js 创建HTTP服务器

Node.js 创建HTTP服务器 如果我们使用PHP来编写后端的代码时,需要Apache 或者 Nginx 的HTTP 服务器,并配上 mod_php5 模块和php-cgi. 从这个角度看,整个& ...

- Hive Over HBase

1. 在hbase上建测试表 hbase(main)::> create 'test_hive_over_hbase','f' row(s) in 2.5810 seconds hbase(ma ...

- 002 C#学前入门

2016-01-16 1..Net平台 .Net FrameWork框架.Net FrameWork框架提供了一个稳定的运行环境,:来保障我们.Net平台正常的运转 2.C#语言 c sharp编程 ...

- poj2502 最短路

//Accepted 504 KB 16 ms //spfa最短路 //把n个地铁站作为n个顶点,边权为从一个站到另一个站的时间 //注意:地铁在相邻的两站之间是直线行驶,但其他的就不是了 #incl ...

- javaEE(web)SEO优化 Yahoo军规

javaEE(web)SEO优化 Yahoo军规 1.尽可能减少HTTP请求数2.使用CDN3.添加Expire/Cache-Control头4.启用Gzip压缩5.将CSS房在页面最上方6.将Scr ...

- 2016 - 1 - 24 NSURLSession (一)

一: NSURLSession简介 1.实施步骤 1.1 使用 NSURLSession对象 创建TASK ,然后执行TASK 2.TASK的类型: 二: NSURLSession的简单使用: - ( ...