用python爬取B站在线用户人数

最近在自学Python爬虫,所以想练一下手,用python来爬取B站在线人数,应该可以拿来小小分析一下

设计思路

首先查看网页源代码,找到相应的html,然后利用各种工具(BeautifulSoup或者直接正则表达式)得到数据, 然后把数据和当且时间保存到本地,并且设置一定的时间间隔,反复得到数据, 不过后面我发现B站在线人数是通过js动态生成的,后面会提到

实现过程

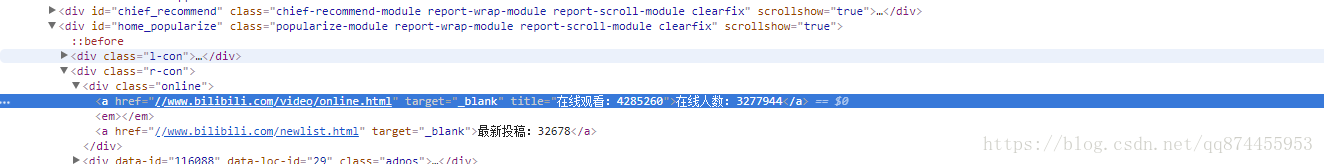

观察HTML网页

打开B站,查看网页源代码

我们发现

<div class="online">

<a href="//www.bilibili.com/video/online.html" target="_blank" title="在线观看:4285260">

在线人数:3277944

</a>

<a href="//www.bilibili.com/newlist.html" target="_blank">

最新投稿:32678

</a>

</div>在线人数是存储在类名为online的div中的a标签,当得到a标签的内容,然后把数字分割出来就可以

提取信息

提取代码片段如下:

url = "https://www.bilibili.com/"

html = get_page_source(url)

#得到网页的string

soup = BeautifulSoup(html, 'html.parser')

viewInfo = soup.find_all('div', attrs={'class': 'online'})[0]

#找到相应div

numberStr = viewInfo.a.string

#提取标签a的内容

number = str(numberStr.split(':')[1])

#把得到的字符串按照":"来分割所以数字就分到标为1的位置 提取出来就可以然后发现 我们每次得到的number都为0,这显然是有问题的。

问题的关键在于B站在线人数的数据是动态生成的,这是一个动态的网页,这个数字是通过js代码填进去的,所以我们每次得到的是没经过js处理的HTML,所以需要另外的解决方法

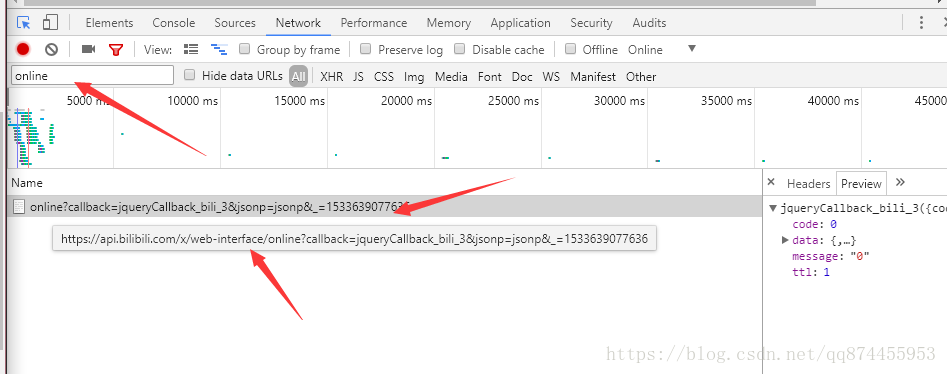

解决问题

这里我们在network里查找关键词online可以找到相应的的api

https://api.bilibili.com/x/web-interface/online?callback=jqueryCallback_bili_3&jsonp=jsonp&_=1533639077636

但是打开网址是找不到的, 主要因为我的url是有问题的 把后面的参数去掉就可以访问

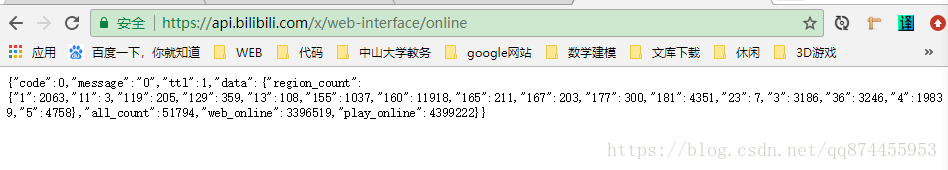

得到最后的api网址

https://api.bilibili.com/x/web-interface/online所以后面我们只需要用python解析json, 得到web_online的值就可以了

代码片段如下

url = "https://api.bilibili.com/x/web-interface/online"

html = get_page_source(url)

#获得url的

json_data = json.loads(html)

#解析json

number = (json_data['data']['web_online'])

#得到值把结果写到txt 以做研究

把当前时间 和 在线人数写到一起,以做研究

with open(fpath, 'a', encoding='utf-8') as f:

nowTime = str(datetime.datetime.now().strftime('%Y-%m-%d %H:%M'))

f.write(nowTime + " " + str(number) + '\n')全部代码

import requests

import re

import time

import datetime

from bs4 import BeautifulSoup

import traceback

import json

def get_page_source(url):

try:

r = requests.get(url, timeout=30)

r.raise_for_status()

r.encoding = r.apparent_encoding

return r.text

except:

return "failed"

def getViewInfo(url, fpath):

html = get_page_source(url)

try:

# soup = BeautifulSoup(html, 'html.parser')

# viewInfo = soup.find_all('div', attrs={'class': 'online'})[0]

# viewInfo = soup.find_all('div', attrs={'class':'ebox'})[0]

# title = viewInfo.p.string

# print(title)

# numberStr = viewInfo.a.string

# number = numberStr.split(':')[1]

#print(number)

#使用python来解析json

json_data = json.loads(html)

number = (json_data['data']['web_online'])

#保存文件

with open(fpath, 'a', encoding='utf-8') as f:

nowTime = str(datetime.datetime.now().strftime('%Y-%m-%d %H:%M'))

f.write(nowTime + " " + str(number) + '\n')

except:

traceback.print_exc()

def main():

count = 0

while 1:

url = "https://api.bilibili.com/x/web-interface/online"

#文件路径

output_path = "G://bilibiliInfo.txt"

getViewInfo(url, output_path)

#打印进度

count = count + 1

print(count)

#延时一分钟

time.sleep(60)

if __name__=="__main__":

main()

小结

最终可以把此程序 放到服务器上(毕竟电脑也不能总是开着的)

当然在服务器 实现定时运行可以通过crontab 来实现,然后把代码的循环改一下,就能实时监控了!

关于如何在服务器定时运行python可以看这篇博客,还是减少了很多错误的

https://blog.csdn.net/qq874455953/article/details/81586508

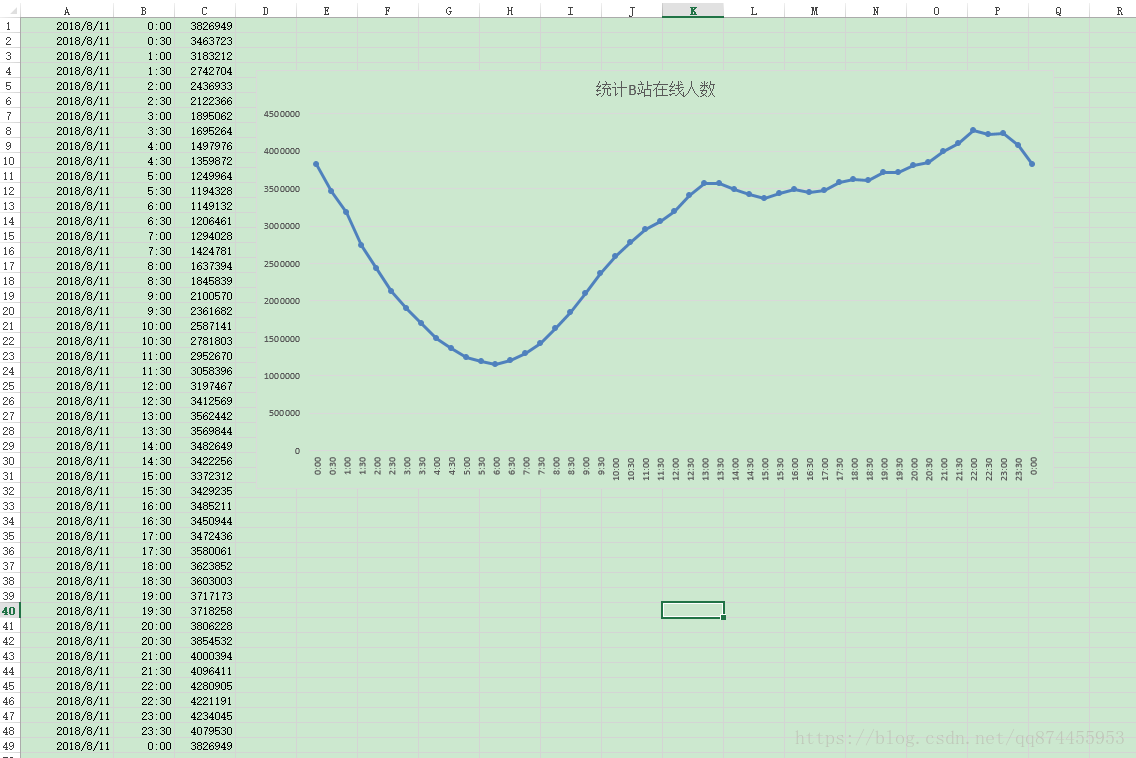

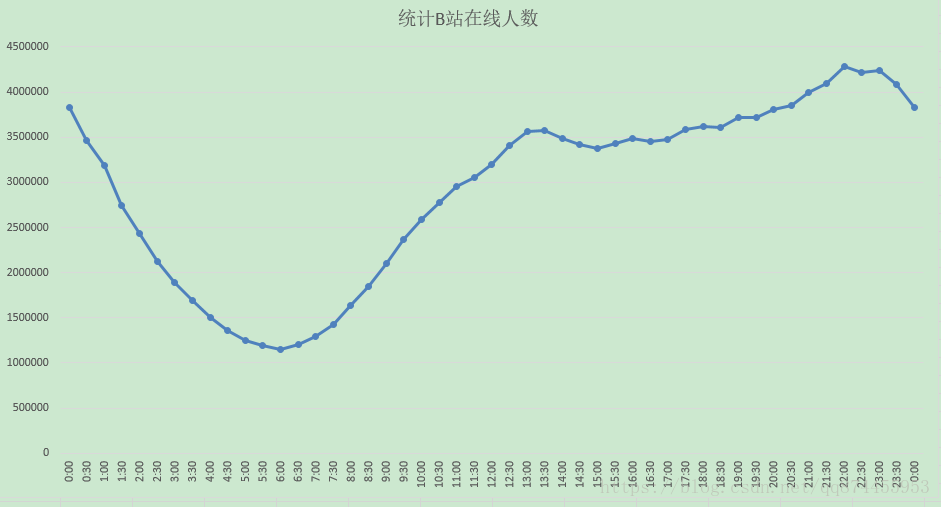

这是每隔30分钟的结果部分显示, 仅供参考

折线图

用python爬取B站在线用户人数的更多相关文章

- 萌新学习Python爬取B站弹幕+R语言分词demo说明

代码地址如下:http://www.demodashi.com/demo/11578.html 一.写在前面 之前在简书首页看到了Python爬虫的介绍,于是就想着爬取B站弹幕并绘制词云,因此有了这样 ...

- 用Python爬取B站、腾讯视频、爱奇艺和芒果TV视频弹幕!

众所周知,弹幕,即在网络上观看视频时弹出的评论性字幕.不知道大家看视频的时候会不会点开弹幕,于我而言,弹幕是视频内容的良好补充,是一个组织良好的评论序列.通过分析弹幕,我们可以快速洞察广大观众对于视频 ...

- Python爬取B站视频信息

该文内容已失效,现已实现scrapy+scrapy-splash来爬取该网站视频及用户信息,由于B站的反爬封IP,以及网上的免费代理IP绝大部分失效,无法实现一个可靠的IP代理池,免费代理网站又是各种 ...

- python爬取某站新闻,并分析最近新闻关键词

在爬取某站时并做简单分析时,遇到如下问题和大家分享,避免犯错: 一丶网站的path为 /info/1013/13930.htm ,其中13930为不同新闻的 ID 值,但是这个数虽然为升序,但是没有任 ...

- python爬取b站排行榜

爬取b站排行榜并存到mysql中 目的 b站是我平时看得最多的一个网站,最近接到了一个爬虫的课设.首先要选择一个网站,并对其进行爬取,最后将该网站的数据存储并使其可视化. 网站的结构 目标网站:bil ...

- Python爬取b站任意up主所有视频弹幕

爬取b站弹幕并不困难.要得到up主所有视频弹幕,我们首先进入up主视频页面,即https://space.bilibili.com/id号/video这个页面.按F12打开开发者菜单,刷新一下,在ne ...

- Python爬取B站耗子尾汁、不讲武德出处的视频弹幕

本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,如有问题请及时联系我们以作处理. 前言 耗子喂汁是什么意思什么梗呢?可能很多人不知道,这个梗是出自马保国,经常上网的人可能听说过这个 ...

- 使用python爬取P站图片

刚开学时有一段时间周末没事,于是经常在P站的特辑里收图,但是P站加载图片的速度比较感人,觉得自己身为计算机专业,怎么可以做一张张图慢慢下这么low的事,而且这样效率的确也太低了,于是就想写个程序来帮我 ...

- python爬取B站视频弹幕分析并制作词云

1.分析网页 视频地址: www.bilibili.com/video/BV19E… 本身博主同时也是一名up主,虽然已经断更好久了,但是不妨碍我爬取弹幕信息来分析呀. 这次我选取的是自己 唯一的爆款 ...

随机推荐

- 关于Java8的精心总结

前言 最近公司里比较新的项目里面,看到了很多关于java8新特性的用法,由于之前自己对java8的新特性不是很了解也没有去做深入研究,所以最近就系统的去学习了一下,然后总结了一篇文章第一时间和大家 ...

- python读取hdfs上的parquet文件方式

在使用python做大数据和机器学习处理过程中,首先需要读取hdfs数据,对于常用格式数据一般比较容易读取,parquet略微特殊.从hdfs上使用python获取parquet格式数据的方法(当然也 ...

- django-模板之标签

目录 模板 模版是纯文本文件,可以生成任何基于文本的文件格式,比如HTML,XML,CSV等.Django模版语言致力于在性能和简单性上取得平衡.Django的模版系统并不是简单的将Python嵌入到 ...

- NoSQL和SQL怎么选用?

NoSQL 有分很多种,其中key-value NoSQL (Redis, MemcacheD, etc) 的选用相对比较清楚些,大多是当后端Data storage的cache层来用.这篇主要想请教 ...

- 细说JavaScript 导出 上万条Excel数据

首先这是个鸡肋的方法 合理的做法是 后端直接生成 前端给个链接就行了 (先说原因与过程最后上代码) 1. 先说说为什么会出现这个需求吧. : 在写运维网站时 自己粗略的看了一下bootstarp-ta ...

- MySQL数据管理

3.MySQL数据管理 3.1外键 方式一: create table `grade`( `gradeid` int(10) not null auto_increment comment '年纪 ...

- BUUCTF-web Easyweb

从这道题学到了挺多 一打开题目就是登陆页面,遂扫描文件检测是否存在文件泄露 用dirsearch扫出了robots.txt,.DS_Store和其他php.DS_Store没有可用信息(buuoj的题 ...

- 跟老刘学运维day02~新手必须掌握的Linux命令(2)

第2章 Linux命令 1.Shell 计算机硬件:由运算器.控制器.存储器.输入/输出设备等共同组成 Shell:人与硬件的翻译官,人要想使用硬件,需要服务程序 Bash四大好处: (1)通过上下方 ...

- 修改python默认版本

查看默认Python版本 python -V 1.安装gcc,用于编译Python源码 yum install gcc 2.下载源码包,https://www.python.org/ftp/pytho ...

- transaction already active

这个问题是使用spring 事务管理时经常出现的错误,最开始时相当令我头疼,也不知道是哪里出现的问题.在网上找了一阵后,依然无解.意思就是说上一个事务处于激活状态中,不能开始新的数据库更新操作. // ...