[Pytorch框架] 4.2.3 可视化理解卷积神经网络

文章目录

%load_ext autoreload

%autoreload 2

import torch

import numpy as np

import torch.nn as nn

import torch.nn.functional as F

from PIL import Image

from torchvision import transforms

from torchvision import models,datasets

import matplotlib.pyplot as plt

torch.__version__

'1.0.0'

4.2.3 可视化理解卷积神经网络

在上一节中我们已经通过一个预训练的VGG16模型对一张图片进行了分类,下面我们粘贴上一节的代码

cat_img=Image.open('./1280px-Felis_silvestris_catus_lying_on_rice_straw.jpg')

transform_224= transforms.Compose([

transforms.Resize(224),

transforms.CenterCrop((224,224)),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406],

std=[0.229, 0.224, 0.225])

])

cat_img_224=transform_224(cat_img)

上面的代码是我们读取了一张图片,并对图片进行了一些预处理,下面我们来创建vgg16的预训练好网络模型

net = models.vgg16(pretrained=True)# 修改这里可以更换其他与训练的模型

inputs=cat_img_224[np.newaxis] #这两个方法都可以cat_img_224[None,::]

进行一次前向的传播,看看得到了什么结果

out = net(inputs)

_, preds = torch.max(out.data, 1)

preds

label=preds.numpy()[0]

label

287

我们看到了,这里返回的是285,代码几乎一样,但是返回的结果与上一节的样例有差别,这是什么原因呢?

首先我们先看一下这个数字的含义,我们使用的是通过imagenet来作为预训练的模型,imagenet里面有1000个分类,我们如何去找这个含义呢?

有好心人已经给我们准备好了 这个连接

我们找一下 285: ‘Egyptian cat’, 说明识别出了是一只猫,种类还是埃及猫,应该还是比较准确的,但是这张图片是我特意寻找的,里面包含了很多隐藏的细节,这里就不多介绍了,大家如果有兴趣,可以换一个模型,或者修改下transforms方法,看看模型都会识别出来是什么类别。

注:不同的预训练权重也会出现不同的结果,我测试出现过277,282,287等结果

下面我们开始进入正题,卷积神经网络的可视化

背景

CNN模型虽然在图像处理上表现出非常良好的性能和准确性,但一直以来都被认为是一个黑盒模型,人们无法了解里面的工作机制。

针对这个问题,研究人员除了从理论层面去寻找解释外,也提出了一些可视化的方法直观地理解CNN的内部机理,毕竟眼见为实,看到了大家就相信了。

这里介绍两类方法,一种是基于Deconvolution, 另一种则是基于反向传播的方法。我们主要使用代码实现基于反向传播的方法的可视化。

基于Deconvolution的方法

Visualizing and Understanding Convolutional Networks

主要是将激活函数的特征映射回像素空间,来揭示什么样的输入模式能够产生特定的输出,因为网络是有层级关系的,所以越靠近输出的层级学到的特征越抽象,与实际任务越相关,这里就不多介绍了,这里有一个使用 keras的实现,有兴趣的可以看看

基于Backpropagation的方法

另外一类的实现就是基于Backpropagation的方法,这里我们主要进行介绍,在介绍之前,我们首先要引用一下别人写的代码

pytorch-cnn-visualizations,将这个代码的src目录放到与这个notebook同级别目录下,我们后面会直接调用他的代码进行演示操作。

首先,我们做一些准备工作

import sys

sys.path.insert(0, './src/')

def rgb2gray(rgb):

return np.dot(rgb[...,:3], [0.299, 0.587, 0.114])

def rescale_grads(map,gradtype="all"):

if(gradtype=="pos"):

map = (np.maximum(0, map) / map.max())

elif gradtype=="neg":

map = (np.maximum(0, -map) / -map.min())

else:

map = map - map.min()

map /= map.max()

return map

Guided-Backpropagation

这个方法来自于ICLR-2015 的文章《Striving for Simplicity: The All Convolutional Net》,文中提出了使用stride convolution 替代pooling 操作,这样整个结构都只有卷积操作。作者为了研究这种结构的有效性,提出了guided-backpropagation的方法。

大致的方法为:选择某一种输出模式,然后通过反向传播计算输出对输入的梯度。这种方式与上一种deconvnet的方式的唯一区别在于对ReLU梯度的处理。

ReLU在反向传播的计算采用的前向传播的特征作为门阀,而deconvnet采用的是梯度值,guided-backpropagation则将两者组合在一起使用,这样有助于得到的重构都是正数。

这段话可能有点绕,具体细节还是看论文吧,我们这里只关注如何实现

inputs.requires_grad=True # 这句话必须要有,否则会报错

from guided_backprop import GuidedBackprop #这里直接引用写好的方法,在src,目录找想对应的文件

GB=GuidedBackprop(net)

gp_grads=GB.generate_gradients(inputs, label)

gp_grads=np.moveaxis(gp_grads,0,-1)

#我们分别计算三类的gp

ag=rescale_grads(gp_grads,gradtype="all")

pg=rescale_grads(gp_grads,gradtype="pos")

ng=rescale_grads(gp_grads,gradtype="neg")

下面我们使用matplotlib看看结果

plt.imshow(cat_img)

<matplotlib.image.AxesImage at 0x23d840392e8>

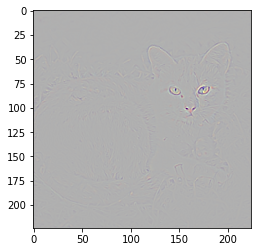

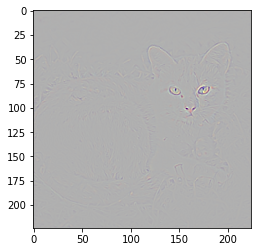

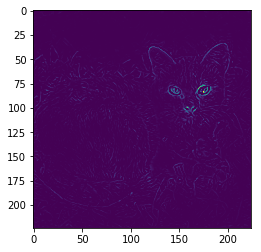

plt.imshow(ag)

<matplotlib.image.AxesImage at 0x23d8441c7f0>

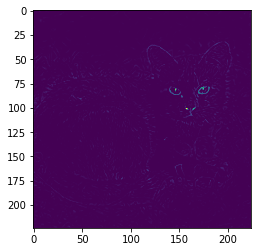

plt.imshow(ng)

<matplotlib.image.AxesImage at 0x23d84487080>

plt.imshow(ag)

<matplotlib.image.AxesImage at 0x23d854b44e0>

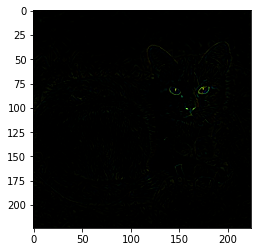

上面三张图是rbg三个通道的展示结果,下面我们合并成一个通道再看一下

gag=rgb2gray(ag)

plt.imshow(gag)

<matplotlib.image.AxesImage at 0x23d8550fe80>

gpg=rgb2gray(pg)

plt.imshow(gpg)

<matplotlib.image.AxesImage at 0x23d85576710>

gng=rgb2gray(ng)

plt.imshow(gng)

<matplotlib.image.AxesImage at 0x23d855d4fd0>

CAM(Class Activation Map)

这个方法严格来说不是基于梯度的,但是后面我们会将反向传播与CAM整合,所以简单的对CAM做个说明。

CAM 来自CVPR 2016 《Learning Deep Features for Discriminative Localization》,作者在研究global average pooling(GAP)时,发现GAP不止作为一种正则,减轻过拟合,在稍加改进后,可以使得CNN具有定位的能力,CAM(class activation map)是指输入中的什么区域能够指示CNN进行正确的识别。

通常特征图上每个位置的值在存在其感知野里面某种模式时被激活,最后的class activation map是这些模式的线性组合,我们可以通过上采样,将class activation map 还原到与原图一样的大小,通过叠加,我们就可以知道哪些区域是与最后分类结果息息相关的部分。

这里就不介绍了

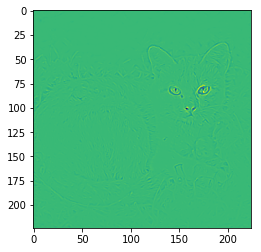

Grad-CAM

Grad-CAM: Visual Explanations from Deep Networks via Gradient-based Localization

顾名思义 Grad-CAM的加权系数是通过反向传播得到的,而CAM的特征加权系数是分类器的权值。

Grad-CAM 与 CAM相比,它的优点是适用的范围更广,Grad-CAM对各类结构,各种任务都可以使用。这两种方法也可以应用于进行弱监督下的目标检测,后续也有相关工作基于它们进行改进来做弱监督目标检测。

import math

from gradcam import GradCam

from guided_gradcam import guided_grad_cam

from guided_backprop import GuidedBackprop

nlayers=len(net.features._modules.items())-1

print(nlayers) # 打印一下一共有多少层

cam_list=[]

#下面我们循环每一层

for layer in range(nlayers):

#GradCam

grad_cam = GradCam(net,target_layer=layer)

cam = grad_cam.generate_cam(inputs, label)

#GuidedBackprop

GBP = GuidedBackprop(net)

guided_grads = GBP.generate_gradients(inputs, label)

# Guided Grad cam

cam_gb = guided_grad_cam(cam, guided_grads)

cam_list.append(rgb2gray(np.moveaxis(cam_gb,0,-1)))

30

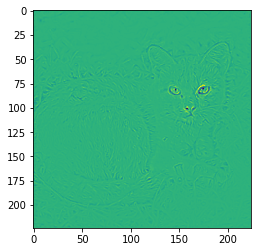

我们选个图,看看效果

plt.imshow(cam_list[0])

<matplotlib.image.AxesImage at 0x23d858b7588>

在 Visualizing and Understanding Convolutional Networks 中作者还给出了其他不同的方法,这里就不详细说明了

需要注意的是,在使用 Visualizing and Understanding Convolutional Networks的时候,对网络模型是有要求的,要求网络将模型包含名为features的组合层,这部分是代码中写死的,所以在pytorch的内置模型中,vgg、alexnet、densenet、squeezenet是可以直接使用的,inception(googlenet)和resnet没有名为features的组合层,如果要使用的话是需要对代码进行修改的。

[Pytorch框架] 4.2.3 可视化理解卷积神经网络的更多相关文章

- 用反卷积(Deconvnet)可视化理解卷积神经网络还有使用tensorboard

『cs231n』卷积神经网络的可视化与进一步理解 深度学习小白——卷积神经网络可视化(二) TensorBoard--TensorFlow可视化 原文地址:http://blog.csdn.net/h ...

- PyTorch框架+Python 3面向对象编程学习笔记

一.CNN情感分类中的面向对象部分 sparse.py super(Embedding, self).__init__() 表示需要父类初始化,即要运行父类的_init_(),如果没有这个,则要自定义 ...

- 手写数字识别 卷积神经网络 Pytorch框架实现

MNIST 手写数字识别 卷积神经网络 Pytorch框架 谨此纪念刚入门的我在卷积神经网络上面的摸爬滚打 说明 下面代码是使用pytorch来实现的LeNet,可以正常运行测试,自己添加了一些注释, ...

- 小白学习之pytorch框架(1)-torch.nn.Module+squeeze(unsqueeze)

我学习pytorch框架不是从框架开始,从代码中看不懂的pytorch代码开始的 可能由于是小白的原因,个人不喜欢一些一下子粘贴老多行代码的博主或者一些弄了一堆概念,导致我更迷惑还增加了畏惧的情绪(个 ...

- 全面解析Pytorch框架下模型存储,加载以及冻结

最近在做试验中遇到了一些深度网络模型加载以及存储的问题,因此整理了一份比较全面的在 PyTorch 框架下有关模型的问题.首先咱们先定义一个网络来进行后续的分析: 1.本文通用的网络模型 import ...

- 详解卷积神经网络(CNN)

详解卷积神经网络(CNN) 详解卷积神经网络CNN 概揽 Layers used to build ConvNets 卷积层Convolutional layer 池化层Pooling Layer 全 ...

- 小白学习之pytorch框架(4)-softmax回归(torch.gather()、torch.argmax()、torch.nn.CrossEntropyLoss())

学习pytorch路程之动手学深度学习-3.4-3.7 置信度.置信区间参考:https://cloud.tencent.com/developer/news/452418 本人感觉还是挺好理解的 交 ...

- 小白学习之pytorch框架(2)-动手学深度学习(begin-random.shuffle()、torch.index_select()、nn.Module、nn.Sequential())

在这向大家推荐一本书-花书-动手学深度学习pytorch版,原书用的深度学习框架是MXNet,这个框架经过Gluon重新再封装,使用风格非常接近pytorch,但是由于pytorch越来越火,个人又比 ...

- 深度学习框架PyTorch一书的学习-第四章-神经网络工具箱nn

参考https://github.com/chenyuntc/pytorch-book/tree/v1.0 希望大家直接到上面的网址去查看代码,下面是本人的笔记 本章介绍的nn模块是构建与autogr ...

- 【chainer框架】【pytorch框架】

教程: https://bennix.github.io/ https://bennix.github.io/blog/2017/12/14/chain_basic/ https://bennix.g ...

随机推荐

- Ansible 工具参数详解自动化运维

一.Ansible基本概述: Ansible是一个配置管理系统(configuration management sysytem )你只需要可以使用ssh访问你的服务器或设备就行 Ansible 是近 ...

- Executors.newScheduledThreadPool()定时任务线程池

定时任务线程池是由 Timer 进化而来 jdk中的计划任务 Timer 工具类提供了以计时器或计划任务的功能来实现按指定时间或时间间隔执行任务,但由于 Timer 工具类并不是以池 pool ,而是 ...

- Windhill获取团队角色、用户

//获取容器团队里的用户和角色,也可以获取容器团队里某一角色的用户 WTContainer pContainer = project.getContainer(); if (pContainer in ...

- 3、IOC创建对象的方法

目录 3.IOC创建对象的方法 4.Spring配置 4.1.别名 4.2.Bean的配置 4.3.import 5.依赖注入 5.1.构造器注入 5.2.Set方式注入[重点] 5.3.扩展方式注入 ...

- Activiti7开发(一)

0.前言 开发背景 项目开发设计审批工作流,企业微信的审批不错,但是下拉列表不支持后期添加,所以只能自己实现,通过gitee查找相关工作流的开源项目,参考有 闲鹿(RuoYi+Activiti6) h ...

- python爬虫基础教程

爬虫介绍 爬虫就是程序,是从互联网中,各个网站上爬取数据(能浏览到的网页才可以爬),做数据清洗,入库 爬虫本质: 模拟http请求,获取数据,入库 网站/app > 抓包 我们日常使用的baid ...

- Go语言 :使用简单的 for 迭代语句进行 TDD 驱动测试开发与 benchmark 基准测试

前提准备与运行环境请参考:(新手向)在Linux中使用VScode编写 "Hello,world"程序,并编写测试-Ubuntu20.4 在 Go 中 for 用来循环和迭代, ...

- WPF监听快捷键的几种方式

调用Win32 API(优先级最高,全局监听, 支持最小化失焦等情况) 那么,假如我要在一个WPF程序监听CTRL+5按键,首先在主窗口程序添加以下代码: /// <summary> // ...

- ABAP 调用HTTP上传附件(二)之中文乱码

1.这篇文章的由来 之前已经发表了<ABAP 调用HTTP上传附件>的文章,详细介绍了如何通过HTTP请求传输附件,可点击链接参考原有文档 因为之前对传输文件的中文文件名处理上解释不够详细 ...

- Java面试——搜索

更多内容,前往 IT-BLOG 一.Elasticsearch了解多少 ElasticSearch 是一个基于 Lucene的搜索服务器.它提供了一个分布式多用户能力的全文搜索引擎,基于 RESTfu ...