(转)Polynomial interpolation 多项式插值

This example demonstrates how to approximate a function with a polynomial of degree n_degree by using ridge regression. Concretely, from n_samples 1d points, it suffices to build the Vandermonde matrix, which is n_samples x n_degree+1 and has the following form:

这个例子演示了如何用岭回归去近似一个函数用n_degree级的多项式级数。具体而言,从n_samples 1d个点,这满足去建立一个范德蒙德矩阵,有n_samples行,n_degree+1列。有如下的形式:

[[1,x1,x1∗∗2,x1∗∗3,…],[1,x2,x2∗∗2,x2∗∗3,…],…][[1,x1,x1∗∗2,x1∗∗3,…],[1,x2,x2∗∗2,x2∗∗3,…],…] [[1, x_1, x_1 ** 2, x_1 ** 3, …], \\ [1, x_2, x_2 ** 2, x_2 ** 3, …], …] [[1,x1,x1∗∗2,x1∗∗3,…],[1,x2,x2∗∗2,x2∗∗3,…],…]

Intuitively, this matrix can be interpreted as a matrix of pseudo features (the points raised to some power). The matrix is akin to (but different from) the matrix induced by a polynomial kernel.

直觉上来说,这个矩阵可以被理解为伪特征的矩阵。这些点提升到能量。

这个矩阵类似于(但不同于) 多项式核生成的矩阵。

This example shows that you can do non-linear regression with a linear model, using a pipeline to add non-linear features. Kernel methods extend this idea and can induce very high (even infinite) dimensional feature spaces.

这个例子显示,你可以用线性模型做非线性回归,通过管道来添加非线性特征。核方法扩展了这个想法,可以导出非常高维的(甚至是无限维)的特征空间。

实验过程

- 注意:

- 这里是用高阶多项式来进行岭回归

- 本质上不是我们日常所说的插值,因为插值点其实并不在对应的位置上。

- 这里说的特征,在其实在fit之前只有一个多项式作为了特征。后面说到了这里采用的是岭回归。

# %pylab inline

# 如果是jupyter notebook就把上面一行注释去掉~

import numpy as np

import matplotlib.pyplot as plt

from sklearn.linear_model import Ridge

from sklearn.preprocessing import PolynomialFeatures

from sklearn.pipeline import make_pipeline

def f(x):

""" function to approximate by polynomial interpolation"""

return x * np.sin(x)

# generate points used to plot

x_plot = np.linspace(0, 10, 100)

# 随机获取20个插值点

# generate points and keep a subset of them

x = np.linspace(0, 10, 100) # 生成100个数据

rng = np.random.RandomState(0)

rng.shuffle(x) # 随机打乱这个数据

x = np.sort(x[:20]) # 将前20个数据排序

y = f(x) # 放入f之中,获取散点的值

# create matrix versions of these arrays

X = x[:, np.newaxis] # 将该数据提高一个维度

X_plot = x_plot[:, np.newaxis]

colors = ['teal', 'yellowgreen', 'gold'] # 颜色集合

lw = 2 # 线宽度

# 真实数据所构成的曲线

plt.plot(x_plot, f(x_plot), color='cornflowerblue', linewidth=lw,

label="ground truth")

# 散点图,描出插值点

plt.scatter(x, y, color='navy', s=30, marker='o', label="training points")

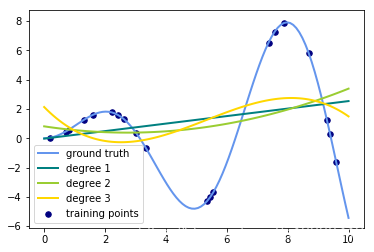

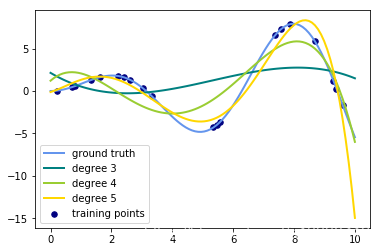

for count, degree in enumerate([3, 4, 5]):

# 用degree的多项式特征结合上岭回归放入到管道之中构建模型

model = make_pipeline(PolynomialFeatures(degree), Ridge())

# print(model)

model.fit(X, y) # 训练模型

y_plot = model.predict(X_plot) # 做出预测

# 描绘出插值曲线

plt.plot(x_plot, y_plot, color=colors[count], linewidth=lw,

label="degree %d" % degree)

plt.legend(loc='lower left')

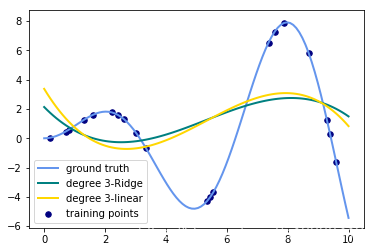

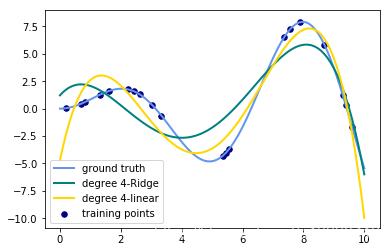

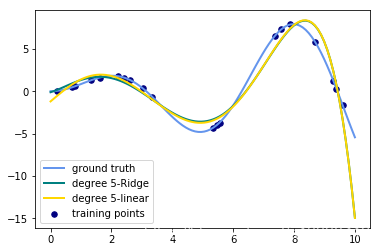

plt.show()将for循环部分改成这样子:

for count, degree in enumerate([3]):

# 用degree的多项式特征结合上岭回归放入到管道之中构建模型

model = make_pipeline(PolynomialFeatures(degree), Ridge())

model.fit(X, y) # 训练模型

y_plot = model.predict(X_plot) # 做出预测

# 描绘出插值曲线

plt.plot(x_plot, y_plot, color=colors[count], linewidth=lw,

label="degree %d-Ridge" % degree)

model = make_pipeline(PolynomialFeatures(degree), LinearRegression())

model.fit(X, y) # 训练模型

y_plot = model.predict(X_plot) # 做出预测

# 描绘出插值曲线

plt.plot(x_plot, y_plot, color=colors[len(colors) - 1 - count], linewidth=lw,

label="degree %d-linear" % degree)输出的图像为:(只需要将数值从3改成其他degree就可以生成其他图片了)

思考

- 观察:会发现岭回归的结果会线性回归的结果稍显波动小些。

- 回答:岭回归多加了一个L2的范数 约束了多项式特征的w的大小。

(转)Polynomial interpolation 多项式插值的更多相关文章

- 多项式函数插值:全域多项式插值(一)单项式基插值、拉格朗日插值、牛顿插值 [MATLAB]

全域多项式插值指的是在整个插值区域内形成一个多项式函数作为插值函数.关于多项式插值的基本知识,见“计算基本理论”. 在单项式基插值和牛顿插值形成的表达式中,求该表达式在某一点处的值使用的Horner嵌 ...

- 【转载】interpolation(插值)和 extrapolation(外推)的区别

根据已有数据以及模型(函数)预测未知区域的函数值,预测的点在已有数据范围内就是interpolation(插值), 范围外就是extrapolation(外推). The Difference Bet ...

- codeforces 955F Cowmpany Cowmpensation 树上DP+多项式插值

给一个树,每个点的权值为正整数,且不能超过自己的父节点,根节点的最高权值不超过D 问一共有多少种分配工资的方式? 题解: A immediate simple observation is that ...

- 【Codechef】Chef and Bike(二维多项式插值)

something wrong with my new blog! I can't type matrixs so I come back. qwq 题目:https://www.codechef.c ...

- 整数拆分 [dp+多项式插值]

题意 $1 \leq n \leq 10^{18}$ $2 \leq m \leq 10^{18}$ $1 \leq k \leq 20$ 思路 n,m较小 首先考虑朴素的$k=1$问题: $f[i] ...

- 数值计算方法实验之newton多项式插值 (Python 代码)

一.实验目的 在己知f(x),x∈[a,b]的表达式,但函数值不便计算或不知f(x),x∈[a,b]而又需要给出其在[a,b]上的值时,按插值原则f(xi)=yi (i=0,1,……, n)求出简单函 ...

- 数值计算方法实验之Hermite 多项式插值 (Python 代码)

一.实验目的 在已知f(x),x∈[a,b]的表达式,但函数值不便计算,或不知f(x),x∈[a,b]而又需要给出其在[a,b]上的值时,按插值原则f(xi)= yi(i= 0,1…….,n)求出简单 ...

- 数值计算方法实验之Newton 多项式插值(MATLAB代码)

一.实验目的 在己知f(x),x∈[a,b]的表达式,但函数值不便计算或不知f(x),x∈[a,b]而又需要给出其在[a,b]上的值时,按插值原则f(xi)=yi (i=0,1,……, n)求出简单函 ...

- 数值计算方法实验之Lagrange 多项式插值 (Python 代码)

一.实验目的 在已知f(x),x∈[a,b]的表达式,但函数值不便计算,或不知f(x),x∈[a,b]而又需要给出其在[a,b]上的值时,按插值原则f(xi)= yi(i= 0,1…….,n)求出简单 ...

随机推荐

- 简单使用一下IDEA 的HTTP Client

前言 只有光头才能变强. 文本已收录至我的GitHub精选文章,欢迎Star:https://github.com/ZhongFuCheng3y/3y 相信大家都用过POSTMAN吧,后端在开发的时候 ...

- KVM虚拟机快照备份

KVM 快照的定义:快照就是将虚机在某一个时间点上的磁盘.内存和设备状态保存一下,以备将来之用.它包括以下几类: (1)磁盘快照:磁盘的内容(可能是虚机的全部磁盘或者部分磁盘)在某个时间点上被保存,然 ...

- iOS WKWebView与JS的交互

参考链接:https://www.jianshu.com/p/524bc8699ac2

- web端百度地图API实现实时轨迹动态展现

最近在工作中遇到了一个百度地图api中的难题,恐怕有的程序员可能也遇到过.就是实时定位并显示轨迹,网上大部分都是通过创建polyline对象贴到地图上.当然,百度地图的画线就是这样实现的,但是好多人会 ...

- 利用百度AI快速开发出一款“问答机器人”并接入小程序

先看实现效果: 利用百度UNIT预置的智能问答技能和微信小程序,实现语音问答机器人.这里主要介绍小程序功能开发实现过程,分享主要功能实现的子程序模块,都是干货! 想了解UNIT预置技能调用,请参看我之 ...

- git到GitHub的操作和遇到的一些问题

一.新建完项目后执行git git status //查看状态,任何时候都可以用 1. git init //初始化文件夹,并创建.git本地仓库(.git默认隐藏) 2. git add . //把 ...

- C#开发微信小程序(三)

导航:C#开发微信小程序系列 关于小程序项目结构,框架介绍,组件说明等,请查看微信小程序官方文档,关于以下贴出来的代码部分我只是截取了一些片段,方便说明问题,如果需要查看完整源代码,可以在我的项目库中 ...

- Java 8——重复注解和注解的作用范围的扩大化

一.重复注解 在某些情况下,希望将相同的注解应用于声明或类型用途.从Java SE 8发行版开始,重复注解使可以执行此操作. 例如,正在编写代码以使用计时器服务,该服务使能够在给定时间或某个计划上运行 ...

- 一目了然卷积神经网络 - An Intuitive Explanation of Convolutional Neural Networks

An Intuitive Explanation of Convolutional Neural Networks 原文地址:https://ujjwalkarn.me/2016/08/11/intu ...

- C# 网络编程之简易聊天示例

还记得刚刚开始接触编程开发时,傻傻的将网站开发和网络编程混为一谈,常常因分不清楚而引为笑柄.后来勉强分清楚,又因为各种各样的协议端口之类的名词而倍感神秘,所以为了揭开网络编程的神秘面纱,本文尝试以一个 ...