SUSE CaaS Platform 4 - 使用 Ceph RBD 作为持久存储 (静态)

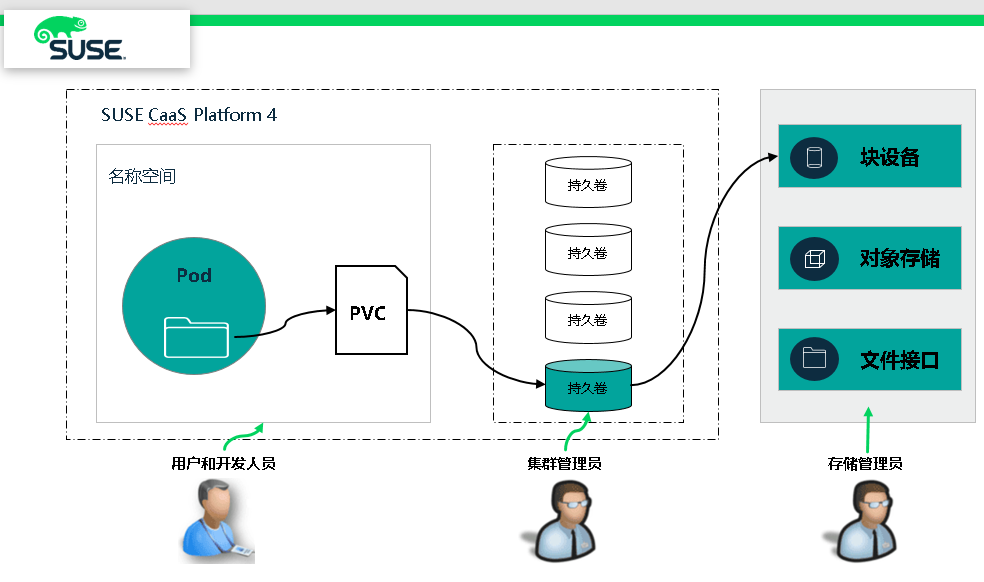

Kubernetes PersistentVolumes 持久化存储方案中,提供两种 API 资源方式: PersistentVolume(简称 PV) 和 PersistentVolumeClaim(简称 PVC)。PV 可理解为集群资源,PVC 可理解为对集群资源的请求,Kubernetes 支持很多种持久化卷存储类型。Ceph 是一个开源的分布式存储系统,支持对象存储、块设备、文件系统,具有可靠性高、管理方便、伸缩性强等特点。在日常工作中,我们会遇到使用 k8s 时后端存储需要持久化,这样不管 Pod 调度到哪个节点,都能挂载同一个卷,从而很容易读取或存储持久化数据,我们可以使用 Kubernetes 结合 Ceph 完成。

图1 Pod 存储卷、PVC 及存储设备的调用关系

实验环境搭建 - 静态供给

图2 实验环境架构

1、所有节点安装

# zypper -n in ceph-common

复制 ceph.conf 到 worker 节点上

# scp admin:/etc/ceph/ceph.conf /etc/ceph/

2、创建池

# ceph osd pool create caasp4

3、创建 key ,并存储到 /etc/ceph/ 目录中

# ceph auth get-or-create client.caasp4 mon 'allow r' \

osd 'allow rwx pool=caasp4' -o /etc/ceph/caasp4.keyring

4、创建 RBD 镜像,2G

# rbd create caasp4/ceph-image-test -s

5、查看 ceph 集群 key 信息,并生成基于 base64 编码的key

# ceph auth list

.......

client.admin

key: AQA9w4VdAAAAABAAHZr5bVwkALYo6aLVryt7YA==

caps: [mds] allow *

caps: [mgr] allow *

caps: [mon] allow *

caps: [osd] allow *

.......

client.caasp4

key: AQD1VJddM6QIJBAAlDbIWRT/eiGhG+aD8SB+5A==

caps: [mon] allow r

caps: [osd] allow rwx pool=caasp4

client.caasp4 密钥以 base64 编码

# echo AQD1VJddM6QIJBAAlDbIWRT/eiGhG+aD8SB+5A== | base64

QVFEMVZKZGRNNlFJSkJBQWxEYklXUlQvZWlHaEcrYUQ4U0IrNUE9PQo=

6、Master 节点上,创建 secret 资源,插入 base64 key

# vi ceph-secret-test.yaml

apiVersion: v1

kind: Secret

metadata:

name: ceph-secret-test

data:

key: QVFEMVZKZGRNNlFJSkJBQWxEYklXUlQvZWlHaEcrYUQ4U0IrNUE9PQo=

# kubectl create -f ceph-secret-test.yaml

secret/ceph-secret-test created

# kubectl get secrets ceph-secret-test

NAME TYPE DATA AGE

ceph-secret-test Opaque 14s

7、Master 节点上,创建 Persistent Volume

# vim ceph-pv-test.yaml

apiVersion: v1

kind: PersistentVolume

metadata:

name: ceph-pv-test

spec:

capacity:

storage: 2Gi

accessModes:

- ReadWriteOnce

rbd:

monitors:

- 192.168.2.40:6789

- 192.168.2.41:6789

- 192.168.2.42:6789

pool: caasp4

image: ceph-image-test

user: caasp4

secretRef:

name: ceph-secret-test

fsType: ext4

readOnly: false

persistentVolumeReclaimPolicy: Retain

# kubectl create -f ceph-pv-test.yaml

# kubectl get pv

NAME CAPACITY ACCESS MODES RECLAIM POLICY STATUS CLAIM STORAGECLASS REASON AGE

ceph-pv-test 2Gi RWO Retain Available 29s

8、创建 Persistent Volume Claim (PVC)

# vim ceph-claim-test.yaml

kind: PersistentVolumeClaim

apiVersion: v1

metadata:

name: ceph-claim-test

spec:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: 2Gi

# kubectl create -f ceph-claim-test.yaml

# kubectl get pvc

NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE

ceph-claim-test Bound ceph-pv-test 2Gi RWO 14s

9、创建 Pod

# vim ceph-pod-test.yaml

apiVersion: v1

kind: Pod

metadata:

name: ceph-pod-test

spec:

containers:

- name: ceph-busybox

image: busybox

command: ["sleep", ""]

volumeMounts:

- name: ceph-vol-test

mountPath: /usr/share/busybox

readOnly: false

volumes:

- name: ceph-vol-test

persistentVolumeClaim:

claimName: ceph-claim-test

# kubectl create -f ceph-pod-test.yaml

# kubectl get pods

NAME READY STATUS RESTARTS AGE

ceph-pod-test / ContainerCreating 6s

# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE

ceph-pod-test / ContainerCreating 32s <none> worker02

10、worker02 节点显示 RBD 映射

# rbd showmapped

id pool namespace image snap device

caasp4 ceph-image-test - /dev/rbd0

# df -Th | grep ceph

/dev/rbd0 ext4 2.0G 6.0M 1.9G 1% /var/lib/kubelet/plugins/kubernetes.io/rbd/mounts/caasp4-image-ceph-image-test

SUSE CaaS Platform 4 - 使用 Ceph RBD 作为持久存储 (静态)的更多相关文章

- SUSE CaaS Platform 4 - 使用 Ceph RBD 作为持久存储(动态)

图1 架构图 图2 各存储插件对动态供给方式的支持状况 1.所有节点安装 # yum install ceph-common 复制 ceph.conf 到 worker 节点上 # scp admin ...

- SUSE CaaS Platform 4 - Ceph RBD 作为 Pod 存储卷

RBD存储卷 目前 CaaSP4 支持多种 Volume 类型,这里选择 Ceph RBD(Rados Block Device),主要有如下好处: Ceph 经过多年开发,已经非常熟,社区也很活跃: ...

- SUSE CaaS Platform 4 - 安装部署

SUSE CaaS Platform 相关文章 (1)SUSE CaaS Platform 4 - 简介 (2)SUSE CaaS Platform 4 - 安装部署 (3)SUSE CaaS Pla ...

- SUSE CaaS Platform 4 - 简介

SUSE CaaS Platform KUBERNETES - 面向企业 SUSE CaaS Platform 是一款企业级容器管理解决方案,可让 IT 和 DevOps 专业人士更轻松地部署.管理和 ...

- SUSE CaaS Platform 4 - 使用 NFS 作为持久存储

SUSE CaaS Platform 4 - 持久存储使用 NFS

- SUSE CaaS Platform 4 - 安装技巧

1.虚拟化环境搭建 - 网络 首先,虚拟机其中一块网卡桥接到 VMnet8 上,通过 VMnet8 地址转换出去访问互联网,如果我们直接桥接到 WIFI 网卡上,由于在不同的的网络环境,地址会时长会 ...

- SUSE Ceph RBD Mirror - Storage 6

Ceph采用的是强一致性同步模型,所有副本都必须完成写操作才算一次写入成功,这就导致不能很好地支持跨域部署,因为如果副本在异地,网络延迟就会很大,拖垮整个集群的写性能.因此,Ceph集群很少有跨域部署 ...

- 理解 QEMU/KVM 和 Ceph(1):QEMU-KVM 和 Ceph RBD 的 缓存机制总结

本系列文章会总结 QEMU/KVM 和 Ceph 之间的整合: (1)QEMU-KVM 和 Ceph RBD 的 缓存机制总结 (2)QEMU 的 RBD 块驱动(block driver) (3)存 ...

- 理解 OpenStack + Ceph (3):Ceph RBD 接口和工具 [Ceph RBD API and Tools]

本系列文章会深入研究 Ceph 以及 Ceph 和 OpenStack 的集成: (1)安装和部署 (2)Ceph RBD 接口和工具 (3)Ceph 物理和逻辑结构 (4)Ceph 的基础数据结构 ...

随机推荐

- HDU 4280 Island Transport(无向图最大流)

HDU 4280:http://acm.hdu.edu.cn/showproblem.php?pid=4280 题意: 比较裸的最大流题目,就是这是个无向图,并且比较卡时间. 思路: 是这样的,由于是 ...

- ZOJ-1610 Count the Colors ( 线段树 )

题目链接: http://acm.zju.edu.cn/onlinejudge/showProblem.do?problemCode=1610 Description Painting some co ...

- poj 1511 Invitation Cards(dijstra优化)

题目链接:http://poj.org/problem?id=1511 题意:给出n个点和n条有向边,求所有点到源点1的来回最短路之和(保证每个点都可以往返源点1) 题目比较简单就是边和点的个数有点多 ...

- 接口请求失败处理,重新请求并限制请求次数.自己封装搞定retry函数

最近开发一款小程序的时候想到一个问题,如果接口突然挂掉怎么办呢,于是乎想到一个解决办法.接口请求重试功能.并限制请求次数 用最新的async函数语法实现.代码简洁明了. 测试代码如下: functio ...

- C++ STL vector的学习

vector就是一个不定长数组,vector是动态数组,随着元素的加入,它的内部机制会自行扩充空间以容纳新元素,使用vector之前,必须包含相应的头文件和命名空间. #include <vec ...

- Asterisk13.23.1如何增加G723编码和G729编码

文章主要将如何配置Asterisk G729的编码和G723的编码问题 今天在配置语音电话过程中踩到一个坑,就是在对接线路过程中出现了一个报错,在传到对方线路过程中出现无法转码从而导致报错. 查看了下 ...

- Java连载29-方法执行内存分析、方法重载

一.JVM包含三个内存区:栈内存.堆内存.方法区内存 二.注意点 (1)在MyEclipse中字体是红色的是一个类的名字,并且这个类除了我们自定义的类是JavaSE类库中自带的 (2)其实JavaSE ...

- java解决回文数

递归解决palindrome问题 如果String仅仅只是一个或者0个字符,则它就是palindrome 否则比较字符串第一个和最后一个字符 如果第一个和最后一个字符不同,那么就不是palindrom ...

- Springboot国际化信息(i18n)解析

国际化信息理解 国际化信息也称为本地化信息 . Java 通过 java.util.Locale 类来表示本地化对象,它通过 “语言类型” 和 “国家/地区” 来创建一个确定的本地化对象 .举个例子吧 ...

- 归并排序、jensen不等式、非线性、深度学习

前言 在此记录一些不太成熟的思考,希望对各位看官有所启发. 从题目可以看出来这篇文章的主题很杂,这篇文章中我主要讨论的是深度学习为什么要"深"这个问题.先给出结论吧:"深 ...