(3)pyspark----dataframe观察

1、读取:

- sparkDF = spark.read.csv(path)

- sparkDF = spark.read.text(path)

2、打印:

sparkDF.show()【这是pandas中没有的】:打印内容

sparkDF.head():打印前面的内容

sparkDF.describe():统计信息

sparkDF.printSchema():打印schema,列的属性信息打印出来【这是pandas中没有的】

sparkDF.columns:将列名打印出来

3、选择列

【select函数,原pandas中没有】

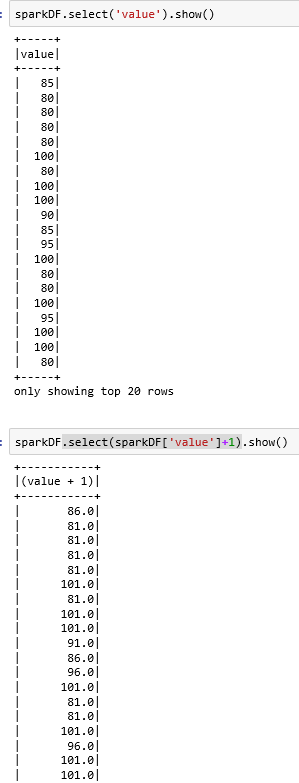

sparkDF.select('列名1','列名2‘).show():选择dataframe的两列数据显示出来

sparkDF.select ( sparkDF['列名1']+1 , '列名2' ).show():直接对列1进行操作(值+1)打印出来

4、筛选列:

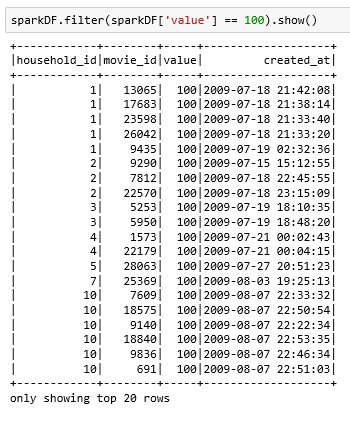

filter【类似pandas中dataframe的采用列名来筛选功能】

sparkDF.filter ( sparkDF['value'] == 100 ).show():将value这一列值为100的行筛选出来

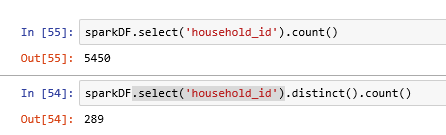

5、计算不重复值以及统计dataframe的行数

distinct()函数:将重复值去除

sparkDF.count():统计dataframe中有多少行

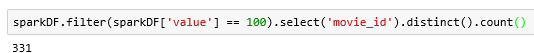

将评分为100的电影数量统计出来:

(3)pyspark----dataframe观察的更多相关文章

- PySpark DataFrame 添加自增 ID

PySpark DataFrame 添加自增 ID 本文原始地址:https://sitoi.cn/posts/62634.html 在用 Spark 处理数据的时候,经常需要给全量数据增加一列自增 ...

- pyspark dataframe 格式数据输入 做逻辑回归

该方法好处是可以调节阈值,可调参数比其他形式模型多很多. [参照]http://blog.csdn.net/u013719780/article/details/52277616 [3种模型效果比较: ...

- pyspark dataframe 常用操作

spark dataframe派生于RDD类,但是提供了非常强大的数据操作功能.当然主要对类SQL的支持. 在实际工作中会遇到这样的情况,主要是会进行两个数据集的筛选.合并,重新入库. 首先加 ...

- Pyspark 使用 Spark Udf 的一些经验

起初开始写一些 udf 的时候感觉有一些奇怪,在 spark 的计算中,一般通过转换(Transformation) 在不触发计算(Action) 的情况下就行一些预处理.udf 就是这样一个好用的东 ...

- 如何在Windows上的Jupyter Notebook中安装和运行PySpark

When I write PySpark code, I use Jupyter notebook to test my code before submitting a job on the clu ...

- Pyspark常用API总结

DF 类似于二维表的数据结果 mame age 狗山石 23 获取df的列名: df.columns 显示当前值 打印 df.show() show(2) show括号里面传入参数可以显示查看几行 s ...

- SQL->Python->PySpark计算KS,AUC及PSI

KS,AUC 和 PSI 是风控算法中最常计算的几个指标,本文记录了多种工具计算这些指标的方法. 生成本文的测试数据: import pandas as pd import numpy as np i ...

- pyspark中的dataframe的观察操作

来自于:http://www.bubuko.com/infodetail-2802814.html 1.读取: sparkDF = spark.read.csv(path) sparkDF = spa ...

- PySpark的DataFrame处理方法

转:https://blog.csdn.net/weimingyu945/article/details/77981884 感谢! ---------------------------------- ...

- 将 数据从数据库 直接通过 pyspark 读入到dataframe

from pyspark.sql import SparkSession spark = SparkSession \ .builder \ .appName("Python Spark S ...

随机推荐

- 小白学习Spark系列二:spark应用打包傻瓜式教程(IntelliJ+maven 和 pycharm+jar)

在做spark项目时,我们常常面临如何在本地将其打包,上传至装有spark服务器上运行的问题.下面是我在项目中尝试的两种方案,也踩了不少坑,两者相比,方案一比较简单,本博客提供的jar包适用于spar ...

- HDU1850 Being a Good Boy in Spring Festival

/* HDU1850 Being a Good Boy in Spring Festival http://acm.hdu.edu.cn/showproblem.php?pid=1850 博弈论 尼姆 ...

- Using index, using temporary, using filesort - how to fix this?

解释一: These are the following conditions under which temporary tables are created. UNION queries use ...

- BA-BACnet对象

BACNET协议有多少个对象呢,拿出西门子教程中的看看一下,居然有48个,其中的大部分都没有用到:

- Spring 注解学习笔记

声明Bean的注解: @Component : 组件,没有明确的角色 @Service : 在业务逻辑层(service层)使用 @Repository : 在数据访问层(dao层)使用. @Cont ...

- mongodb 学习笔记 07 -- 数据备份、恢复

mongoexport 导出json或者csv格式 mongoimport 导入json或者csv mongodump 导出二进制bson结构数据以及索引信息 mongorestore 导入二进制文件 ...

- php常量,提前定义常量,魔术常量及基本数据类型

常量 定义: 形式一 // define("PI",常量值); define("PI",3.14); define("school",&qu ...

- JavaScript、SSH知识点整理

七.Javascript部分 1:什么是Javascript JavaScript是一种基于对象(Object)和事件驱动(Event Driven)并具有安全性能的脚本语言. 2:Java和Java ...

- 从头认识java-13.5 利用泛型构建复杂模型

这一章节我们来展示一下如何利用泛型构建复杂模型? 1.元组列表 我们之前已经说过元组是一个复杂的模型,能够返回多对象. package com.ray.ch11; import java.util.A ...

- hibernate 管理 Session(单独使用session,非spring)

Hibernate 自身提供了三种管理 Session 对象的方法 Session 对象的生命周期与本地线程绑定 Session 对象的生命周期与 JTA 事务绑定 Hibernate 托付程序管理 ...