oozie coordinator 定时调度

(本段内容摘自http://blog.sina.com.cn/s/blog_e699b42b0102xjqw.html Oozie总结 行成于思的博客) Oozie提出了Coordinator的概念,它能够将每个工作流Job作为一个动作(Action)来运行,相当于工作流定义中的一个执行节点(我们可以理解为工作流的工作流),这样就能够将多个工作流Job组织起来,称为Coordinator Job,并指定触发时间和频率,还可以配置数据集、并发数等。一个Coordinator Job包含了在Job外部设置执行周期和频率的语义,类似于在工作流外部增加了一个协调器来管理这些工作流的工作流Job的运行。 相比较于单个任务的配置,Coordinator的配置是在job.properties中将oozie.wf.application.path修改为oozie.coord.application.path。并且还要定义一个coordinator.xml

coordinator application:

coordinator application是在满足一组条件时触发动作(通常是工作流作业)的程序。条件可以是时间频率、新数据集实例或其他外部事件。

coordinator application的类型:同步:它的协调器动作是在指定的时间间隔创建的,通常是参数化的。

coordinator job:

要创建一个coordinator job,必须向协调器引擎提供解决所有coordinator application参数的作业配置.

coordinator job是从开始时间到结束时间运行的coordinator application的运行实例,开始时间必须比结束时间早。

通常情况下,一个coordinator 作业是下列状态之一:PREP, RUNNING, RUNNINGWITHERROR, PREPSUSPENDED, SUSPENDED, SUSPENDEDWITHERROR, PREPPAUSED, PAUSED, PAUSEDWITHERROR, SUCCEEDED, DONEWITHERROR, KILLED, FAILED .

有效的coordinator job状态转换是:

PREP --> PREPSUSPENDED | PREPPAUSED | RUNNING | KILLED

RUNNING --> RUNNINGWITHERROR | SUSPENDED | PAUSED | SUCCEEDED | KILLED

RUNNINGWITHERROR --> RUNNING | SUSPENDEDWITHERROR | PAUSEDWITHERROR | DONEWITHERROR | KILLED | FAILED

PREPSUSPENDED --> PREP | KILLED

SUSPENDED --> RUNNING | KILLED

SUSPENDEDWITHERROR --> RUNNINGWITHERROR | KILLED

PREPPAUSED --> PREP | KILLED

PAUSED --> SUSPENDED | RUNNING | KILLED

PAUSEDWITHERROR --> SUSPENDEDWITHERROR | RUNNINGWITHERROR | KILLED

FAILED | KILLED --> IGNORED

IGNORED --> RUNNING

当一个coordinator 提交作业,Oozie解析 coordinator job XML。Oozie然后创建与状态准备coordinator 记录并返回一个唯一的ID,如果没有设置暂停时间coordinator 也立即开始.

Coordinator Action:

coordinator job 创建并执行 coordinator actions.

coordinator action通常是一个workflow job ,它消耗并生成数据集实例。

一旦创建了coordinator action(这也被称为正在实现的action), coordinator action 将一直等待,直到满足执行所需的所有输入,或者直到等待超时为止。

Synchronous Coordinator Application定义:

synchronous coordinator 是由 name, start time ,end time, the frequency of creation of its coordinator actions, the input events, the output events , action control information来定义的.

语法:

<coordinator-app name="[NAME]" frequency="[FREQUENCY]"

start="[DATETIME]" end="[DATETIME]" timezone="[TIMEZONE]"

xmlns="uri:oozie:coordinator:0.1">

#frequency:执行频率,小于五分钟要修改配置 start,end:开始与结束时间,若想跟北京时间一样也要修改配置文件,并修改时间格式

<controls>

<timeout>[TIME_PERIOD]</timeout>

<concurrency>[CONCURRENCY]</concurrency>

<execution>[EXECUTION_STRATEGY]</execution>

</controls>

.

<datasets>

<include>[SHARED_DATASETS]</include>

...

.

<!-- Synchronous datasets --> #---数据生成目录

<dataset name="[NAME]" frequency="[FREQUENCY]"

initial-instance="[DATETIME]" timezone="[TIMEZONE]">

<uri-template>[URI_TEMPLATE]</uri-template>

</dataset>

...

.

</datasets>

.

<input-events> #----定义了数据触发条件

<data-in name="[NAME]" dataset="[DATASET]">

<instance>[INSTANCE]</instance>

...

</data-in>

...

<data-in name="[NAME]" dataset="[DATASET]">

<start-instance>[INSTANCE]</start-instance>

<end-instance>[INSTANCE]</end-instance>

</data-in>

...

</input-events>

<output-events>

<data-out name="[NAME]" dataset="[DATASET]">

<instance>[INSTANCE]</instance>

</data-out>

...

</output-events>

<action>

<workflow>

<app-path>[WF-APPLICATION-PATH]</app-path> #---workflow.xml所在hdfs目录

<configuration>

<property> #----定义传给workflow的参数

<name>[PROPERTY-NAME]</name>

<value>[PROPERTY-VALUE]</value>

</property>

...

</configuration>

</workflow>

</action>

</coordinator-app>

官网给出的例子:

<coordinator-app name="hello-coord" frequency="${coord:days(1)}"

start="2009-01-02T08:00Z" end="2009-01-02T08:00Z"

timezone="America/Los_Angeles"

xmlns="uri:oozie:coordinator:0.1">

<datasets>

<dataset name="logs" frequency="${coord:days(1)}"

initial-instance="2009-01-02T08:00Z" timezone="America/Los_Angeles">

<uri-template>hdfs://bar:8020/app/logs/${YEAR}${MONTH}/${DAY}/data</uri-template>

</dataset>

<dataset name="siteAccessStats" frequency="${coord:days(1)}"

initial-instance="2009-01-02T08:00Z" timezone="America/Los_Angeles">

<uri-template>hdfs://bar:8020/app/stats/${YEAR}/${MONTH}/${DAY}/data</uri-template>

</dataset>

</datasets>

<input-events>

<data-in name="input" dataset="logs">

<instance>2009-01-02T08:00Z</instance>

</data-in>

</input-events>

<output-events>

<data-out name="output" dataset="siteAccessStats">

<instance>2009-01-02T08:00Z</instance>

</data-out>

</output-events>

<action>

<workflow>

<app-path>hdfs://bar:8020/usr/joe/logsprocessor-wf</app-path>

<configuration>

<property>

<name>wfInput</name>

<value>${coord:dataIn('input')}</value>

</property>

<property>

<name>wfOutput</name>

<value>${coord:dataOut('output')}</value>

</property>

</configuration>

</workflow>

</action>

</coordinator-app>

我们工作时写的:

coordinator.xml

<coordinator-app name="cron-coord" frequency="${coord:minutes(6)}" start="${start}" end="${end}" timezone="Asia/Shanghai"

xmlns="uri:oozie:coordinator:0.2">

<action>

<workflow>

<app-path>${workflowAppUri}</app-path>

<configuration>

<property>

<name>jobTracker</name>

<value>${jobTracker}</value>

</property>

<property>

<name>nameNode</name>

<value>${nameNode}</value>

</property>

<property>

<name>queueName</name>

<value>${queueName}</value>

</property>

<property>

<name>mainClass</name>

<value>com.ocn.itv.rinse.ErrorCollectRinse</value>

</property>

</configuration>

</workflow>

</action>

</coordinator-app>

workflow.xml

<workflow-app name="Spark-example1" xmlns="uri:oozie:workflow:0.5">

<start to="spark-SparkOozieAction"/>

<action name="spark-SparkOozieAction">

<spark xmlns="uri:oozie:spark-action:0.1">

<job-tracker>${jobTracker}</job-tracker>

<name-node>${nameNode}</name-node>

<configuration>

<property>

<name>mapred.job.queue.name</name>

<value>${queueName}</value>

</property>

</configuration>

<master>yarn-cluster</master>

<mode>cluster</mode>

<name>Spark Example</name>

<class>${mainClass}</class>

<jar>ocn-itv-spark-3.0.3-rc1.jar</jar>

<spark-opts>${sparkopts}</spark-opts>

<arg>${input}</arg>

</spark >

<ok to="end"/>

<error to="fail"/>

</action>

<kill name="fail">

<message>Action failed, error message[${wf:errorMessage(wf:lastErrorNode())}]</message>

</kill>

<end name="end"/>

</workflow-app>

job.properties nameNode=hdfs://hgdp-001:8020

jobTracker=hgdp-001:8032

queueName=default

input=2017-05-09 #输入参数

start=2017-08-28T17:50+0800 #开始时间

end=2017-08-28T18:50+0800 #结束时间

sparkopts=--executor-memory 1G

oozie.use.system.libpath=True #是否开启系统用户lib库(有action依赖的jar包)

hdfspath=user/root

examplesRoot=ocn-itv-oozie #全局目录

oozie.libpath=${nameNode}/${hdfspath}/${examplesRoot}/lib/ #用户lib库地址(自添加jar包)

workflowAppUri=${nameNode}/${hdfspath}/${examplesRoot}/wf/wf1/ #workflow.xml所在目录

oozie.coord.application.path=${nameNode}/${hdfspath}/${examplesRoot}/cd/cd1/ #coordinator.xml坐在目录

最后运行:

启动任务:oozie job -config job.properties -run -oozie http://xxxx(地址):11000/oozie

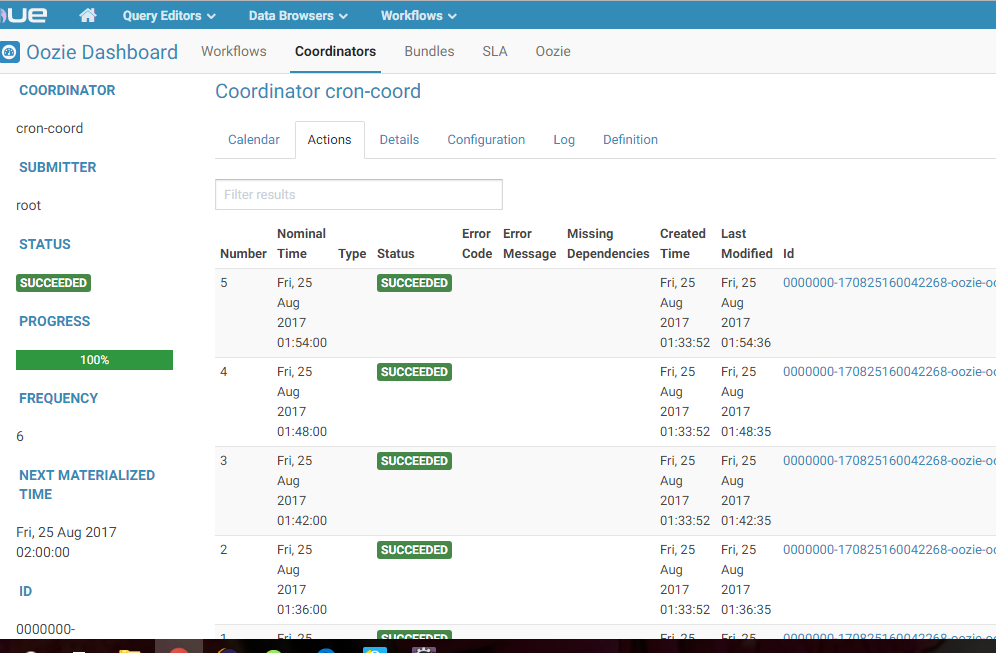

运行结果:

oozie coordinator 定时调度的更多相关文章

- 1.18-1.21 Oozie Coordinator调度

一.时区问题 1.修改系统时区 ## [root@hadoop-senior hadoop-2.5.0-cdh5.3.6]# rm -rf /etc/localtime [root@hadoop-se ...

- Oozie coordinator 作业自定义的配置的一些方法

Oozie的coordinator有啥用? The Oozie Coordinator system allows the user to define and execute recurrent a ...

- 基于Azkaban的任务定时调度实践

本文由云+社区发表 作者:maxluo 一.Azkaban介绍 Azkaban是LinkedIn开源的任务调度框架,类似于JavaEE中的JBPM和Activiti工作流框架. Azkaban功能和特 ...

- Apache Oozie Coordinator 作业自定义配置定时任务

一,介绍 Oozie是Hadoop的工作流系统,如果使用Oozie来提交MapReduce作业(Oozie 不仅仅支持MapReduce作业,还支持其他类型的作业),可以借助Oozie Coordin ...

- Oozie Coordinator job 之定时任务

使用 Coordinator job 可以执行定时任务和时间触发执行 需要注意的是 Oozie 默认使用的时区与中国时区不是一致的,需要进行一点修改 1.关于时区 a.修改 core-site.xml ...

- Quartz定时调度框架

Quartz定时调度框架CronTrigger时间配置格式说明 CronTrigger时间格式配置说明 CronTrigger配置格式: 格式: [秒] [分] [小时] [日] [月] [周] [年 ...

- Spring Quartz定时调度任务配置

applicationContext-quartz.xml定时调度任务启动代码: <?xml version="1.0" encoding="UTF-8" ...

- 定时调度框架Quartz随笔

最近项目中的定时批处理用到了quartz定时任务,在此记录下quartz的配置吧,一个小demo仅供参考,也方便自己今后复习! 下面直接来步骤吧! 一.首先,要搭起能让quartz正常运行的环境,至少 ...

- crontab 定时调度

crontab -e */1 8-23 * * * /www/target/sh/myorder.sh & 0 1 * * * /www/target/php/sh/mymoney.sh &a ...

随机推荐

- golang flag

本文主要对golang环境下命令行的解析进行了相关的总结.命令行在C下有getopt等函数, 在golang下提供了更为方便的处理方法. 1.命令行参数获取:命令行获得可通过os.Args参数, Ar ...

- 【总结】sqlmap命令

post -u url --forms --skip(指定跳过参数) "" --technique BEUST(自选) --dbms mysql --batch --threads ...

- python数组(列表、元组及字典)

python数组的使用 2010-07-28 17:17 1.Python的数组分三种类型: (1) list 普通的链表,初始化后可以通过特定方法动态增加元素. 定义方式:arr = [元素] (2 ...

- RedisClient 连接redis 提示 ERR Client sent AUTH, but no password is set

- Quartz和TopShelf Windows服务作业调度

上一次写了一遍关于Quartz作业调度的文章 Quartz.NET 作业调度使用 现在使用TopShelf和Quartz实现windows服务作业调度 TopShelf版本4.0 Quartz版本3. ...

- Proguard breaking audio file in assets or raw

http://stackoverflow.com/questions/21440572/proguard-breaking-audio-file-in-assets-or-raw Issue: I h ...

- jquery 添加关键字小插件

模块化封装,兼容seajs /** * User: c3t * Date: 14-3-25 * Time: 下午4:16 */ define(function (require, exports, m ...

- centOS查看apache版本的命令

在centOS 7下: 命令如下: httpd -v

- 深入理解JavaScript系列(17):面向对象编程之概论

介绍 在本篇文章,我们考虑在ECMAScript中的面向对象编程的各个方面(虽然以前在许多文章中已经讨论过这个话题).我们将更多地从理论方面看这些问题. 特别是,我们会考虑对象的创建算法,对象(包括基 ...

- [转]Debugging into .NET Core源代码的两种方式

本文转自:http://www.cnblogs.com/maxzhang1985/p/6015719.html 阅读目录 一.前言 二.符号服务器 三.项目中添加ASP.NET Core源代码 四.写 ...